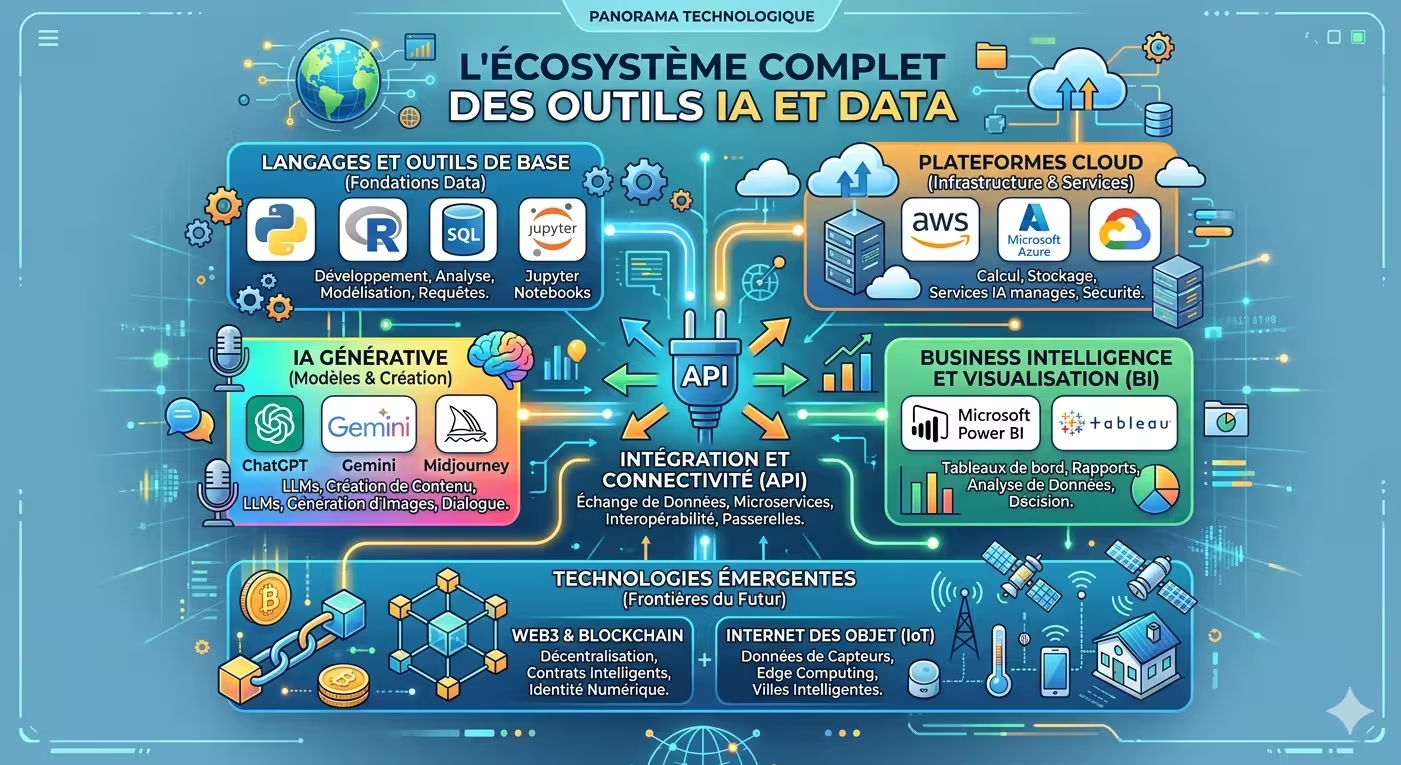

L’écosystème des outils IA et Data est devenu aussi vaste que complexe. Python, R, SQL, TensorFlow, PyTorch, AWS, Azure, GCP, Power BI, Tableau, API REST, GraphQL, Web3, blockchain, IoT, capteurs, OCR, automatisation documentaire, ChatGPT, Midjourney, Gemini — chaque jour, de nouvelles technologies promettent de révolutionner votre façon de travailler avec les données. Face à cette abondance, comment s’y retrouver ? Ce guide complet (plus de 3 500 mots) vous propose une cartographie raisonnée des outils essentiels en 2026, organisée par familles : langages, frameworks IA, cloud, visualisation, API, no-code, Web3, IoT, OCR et IA générative. Pour chaque famille, nous détaillons les usages, les avantages, les limites, les tendances, et nous vous orientons vers nos articles satellites pour approfondir. Que vous soyez data scientist, data analyst, data engineer, chef de projet ou dirigeant, vous trouverez ici les clés pour naviguer dans l’écosystème.

Infographie n°1 – Panorama de l’écosystème des outils IA et Data en 2026 : des langages aux plateformes cloud, en passant par la visualisation et l’IA générative.

Trois langages dominent l’écosystème de la donnée en 2026 : Python (polyvalent, écosystème riche), R (statistiques et recherche), et SQL (indispensable pour interroger les bases de données). Le choix dépend de votre profil (data scientist, data analyst, data engineer) et de votre secteur (industrie vs académique).

Python est devenu le langage de référence pour la data science, le machine learning et l’IA. Sa syntaxe claire, sa vaste bibliothèque standard et son écosystème de packages (pandas, numpy, scikit-learn, tensorflow, pytorch, matplotlib) en font un outil incontournable. Python est également utilisé pour le développement web (Django, Flask), l’automatisation (scripts ETL) et l’ingénierie des données. Selon l’enquête KDnuggets 2026, 62 % des data scientists utilisent Python comme langage principal. Pour approfondir, consultez nos articles dédiés : Python, le roi incontesté de la data science et de l’IA et Python vs R : quel langage choisir pour l’analyse des données ?.

Bibliothèques Python incontournables par domaine :

R reste le favori des statisticiens, des chercheurs en biostatistiques et des data scientists académiques. Son point fort : des bibliothèques de statistiques avancées (régression, ANOVA, modèles linéaires/non linéaires, séries temporelles) et de visualisation (ggplot2, lattice, plotly, shiny pour les applications web interactives). R est particulièrement adapté à l’analyse exploratoire et aux graphiques de qualité publication. L’environnement RStudio est l’IDE de référence – pour approfondir, consultez notre guide détaillé pour utiliser RStudio dans le cloud. Selon la même enquête KDnuggets, 28 % des data scientists utilisent R, principalement dans les secteurs académique, pharmaceutique et financier.

Bibliothèques R incontournables : dplyr (manipulation), tidyr (nettoyage), ggplot2 (visualisation), caret (machine learning), randomForest (forêts aléatoires), xgboost, glmnet (régularisation), shiny (applications web interactives), rmarkdown (rapports).

SQL (Structured Query Language) n’est pas un langage de programmation généraliste, mais sa maîtrise est indispensable pour tout professionnel de la donnée. SQL permet d’interroger, filtrer, agréger, joindre et manipuler des données stockées dans des bases relationnelles (PostgreSQL, MySQL, Oracle, SQL Server, SQLite) et des data warehouses cloud (BigQuery, Redshift, Snowflake, Azure Synapse). Sans SQL, impossible d’extraire les données nécessaires à une analyse ou à un modèle. Pour monter en compétence, explorez nos tutoriels : nettoyage de grands jeux de données avec SQL, prétraitement et inspection des données avec SQL, guide complet des principales fonctions SQL, guide complet sur les 4 clauses JOIN, guide pratique sur les sous-requêtes.

Si vous débutez en data, apprenez d’abord SQL (2-3 semaines), puis Python (2-3 mois). SQL est un prérequis pour tout poste de data analyst ou data engineer. Python vous ouvrira les portes de la data science et du machine learning.

Les frameworks IA sont les briques logicielles qui permettent de construire, entraîner et déployer des modèles de machine learning et de deep learning. Le choix du framework dépend de la maturité du projet (recherche vs production), du type de modèle (vision, NLP, tabulaire), de la courbe d’apprentissage et de l’écosystème.

TensorFlow est le framework deep learning le plus mature pour la production. Il dispose de TFX (TensorFlow Extended) pour l’industrialisation des pipelines ML, de TensorFlow Lite pour l’embarqué (mobile, IoT), et de TensorFlow.js pour le navigateur. Il supporte la distribution sur GPU/TPU. Idéal pour les applications industrielles nécessitant une mise en production robuste. Point faible : courbe d’apprentissage plus raide que PyTorch.

PyTorch est préféré en recherche pour sa flexibilité et son débogage facile (exécution dynamique, mode eager). Il a largement dépassé TensorFlow en recherche académique (80 % des papiers NeurIPS/ICML). Il dispose d’écosystèmes comme TorchVision (vision), TorchText (NLP), TorchAudio (audio) et PyTorch Lightning (simplification). Idéal pour le prototypage rapide et la recherche. Point faible : maturité en production légèrement inférieure à TensorFlow.

Bibliothèque historique pour le machine learning classique (non deep learning) : régression linéaire/logistique, arbres de décision, forêts aléatoires, SVM, clustering (K-Means, DBSCAN), réduction de dimension (PCA, t-SNE). API unifiée (fit/predict/transform), excellente documentation. Idéal pour les projets n’exigeant pas de deep learning.

Hugging Face est devenue la plateforme de référence pour le NLP et les grands modèles de langage (LLM). Elle propose une bibliothèque `transformers` (modèles pré-entraînés : BERT, GPT, T5, LLaMA, Mistral), une bibliothèque `datasets`, une bibliothèque `accelerate` pour l’entraînement distribué, et une plateforme de hubs de modèles (Model Hub). Idéal pour le NLP moderne, la génération de texte, la traduction, le résumé, la classification de texte, et le fine-tuning de LLM.

Keras est une API haut niveau intégrée à TensorFlow, conçue pour simplifier la construction de réseaux de neurones. Excellente pour débuter en deep learning (courbe d’apprentissage douce). Idéal pour le prototypage rapide et l’enseignement.

Le cloud computing a démocratisé l’accès aux infrastructures de data et d’IA. Plus besoin d’investir dans des serveurs surpuissants : louez des GPU à l’heure. Les trois géants — AWS (Amazon Web Services), Microsoft Azure et Google Cloud Platform (GCP) — dominent le marché. Pour les entreprises françaises soucieuses de souveraineté, des alternatives émergent (Bleu, NumSpot, Outscale, OVHcloud).

Leader historique (33 % parts de marché). Services clés : S3 (stockage objet), EC2 (machines virtuelles, GPU), EMR (Spark/Hadoop), Kinesis (streaming), Redshift (data warehouse), SageMaker (plateforme ML intégrée). SageMaker couvre tout le cycle : étiquetage (Ground Truth), entraînement (algorithmes natifs ou bring your own), optimisation (hyperparameter tuning), déploiement, monitoring (Model Monitor). Points forts : maturité, catalogue de services le plus large.

Deuxième acteur (22 % parts), intégration native avec l’écosystème Microsoft (Active Directory, Office 365, Teams, Power BI). Services clés : Blob Storage, Data Lake Storage, Databricks (partenariat), Synapse Analytics (intégration data warehouse + big data), Machine Learning (Azure ML), Cognitive Services (API de vision, NLP, recherche). Points forts : entreprise française, hybridation (Azure Stack).

Troisième acteur (11 % parts), mais leader en IA avec BigQuery (data warehouse serverless, requêtes SQL sur pétaoctets) et Vertex AI (plateforme ML unifiée, intégration avec TensorFlow/PyTorch, Kubeflow). Services clés : Cloud Storage, BigQuery, Dataflow (streaming/batch, Apache Beam), Pub/Sub, Vertex AI, AI Platform. Points forts : BigQuery, recherche, conteneurs (GKE).

Pour approfondir, consultez nos articles : Le cloud computing : la clé du stockage et du traitement de la Big Data et Comparatif AWS, Azure, Google Cloud pour l’IA.

La visualisation est l’étape finale de tout projet data : elle transforme des résultats statistiques en insights compréhensibles par les décideurs. Les deux leaders du marché sont Microsoft Power BI et Tableau. Pour les développeurs, des bibliothèques Python (Matplotlib, Seaborn, Plotly) et R (ggplot2) restent incontournables.

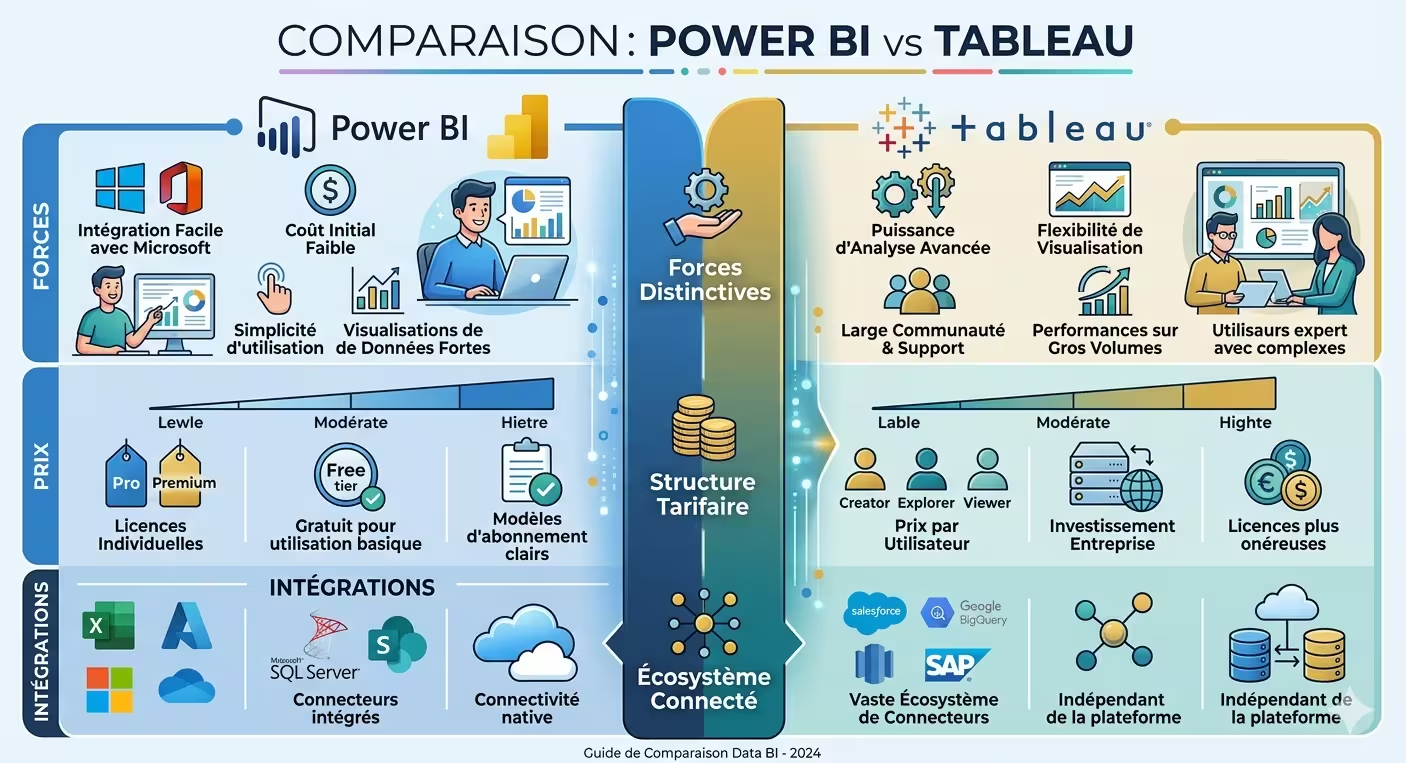

Power BI s’est imposé comme l’outil BI le plus utilisé en entreprise (modèle freemium, intégration native avec Excel, Teams, SharePoint, Dynamics). Points forts : prix attractif (licence Pro 10 €/utilisateur/mois, Premium à partir de 5 000 €/mois), courbe d’apprentissage douce (proche d’Excel), communauté importante. Points faibles : moins puissant que Tableau pour les graphiques très complexes, moins performant sur très gros volumes. Idéal pour les entreprises déjà équipées Microsoft.

Tableau (racheté par Salesforce en 2019) reste la référence pour la puissance visuelle et l’exploration de données interactive. Points forts : qualité esthétique, facilité de partage (Tableau Public), liaison avec de nombreuses sources de données, calculs de table avancés. Points faibles : prix plus élevé (Tableau Creator 70 $/utilisateur/mois), moins intégré à l’écosystème Microsoft. Idéal pour les équipes data dédiées. Découvrez notre comparatif Power BI vs Tableau.

Pour les data scientists, les bibliothèques de visualisation restent essentielles : Matplotlib (la fondation), Seaborn (statistique, haut niveau), Plotly (interactive, zoom, 3D), ggplot2 (grammaire des graphiques en R), shiny (applications web R). Articles associés : La visualisation des données, un langage universel, Une visualisation des données efficace, Visualisations statiques et dynamiques, Logiciels de visualisation incontournables.

Infographie n°2 – Comparatif des outils de visualisation : Power BI, Tableau, bibliothèques Python et R.

Les API (Application Programming Interfaces) sont les connecteurs du monde numérique. En data science, elles servent à collecter des données (API Twitter, OpenWeatherMap, API gouvernementales, API bancaires), à appeler des modèles IA en production (modèle exposé via API REST), ou à intégrer des services externes (paiement, géolocalisation).

Pour une introduction, lisez Les API, les passe-partout de l’intégration des données et Webservices vs API.

Le no-code et le low-code démocratisent la data science en permettant aux non-développeurs (analystes métier, chefs de produit, marketeurs) de construire des pipelines de données et des modèles de machine learning sans écrire de code. Ces outils accélèrent le prototypage et libèrent les data scientists pour des tâches plus complexes.

Pour une entreprise qui débute en data, commencez par des outils no-code (KNIME, Dataiku) pour la préparation et la visualisation. Passez à Python/Scikit-learn lorsque l’équipe monte en compétence et que les besoins deviennent plus spécifiques.

La blockchain (technologie de registre distribué) et le Web3 (internet décentralisé) sont des technologies émergentes avec des applications concrètes dans la donnée : preuve d’intégrité des datasets (horodatage, immuabilité), traçabilité des données (supply chain), stockage décentralisé (IPFS, Filecoin), identité auto-souveraine (DID), et marchés de données décentralisés (Ocean Protocol).

Une blockchain est une base de données distribuée, partagée, sécurisée par cryptographie, avec un consensus décentralisé. Il existe des blockchains publiques (Bitcoin, Ethereum) et privées/permissionnées (Hyperledger Fabric, Corda, Quorum). Les smart contracts (contrats intelligents) sont des programmes qui s’exécutent automatiquement sur la blockchain, sans intermédiaire de confiance.

Pour approfondir, consultez : La blockchain, une rupture historique de la notion de confiance et Web 3.0, l’évolution inéluctable vers un internet décentralisé.

L’IPFS (InterPlanetary File System) est un protocole de stockage distribué, adressé par le contenu (hash) plutôt que par la localisation (URL). Les données sont répliquées sur plusieurs nœuds. Filecoin est une couche incitative sur IPFS (location d’espace de stockage). Utilité en data science : archiver des datasets, garantir leur immuabilité, partager des données sans serveur central.

L’Internet des objets (IoT) désigne les milliards d’objets connectés (capteurs, caméras, montres, compteurs, véhicules) qui collectent des données en continu, souvent en temps réel, depuis l’environnement physique. En 2026, on compte environ 30 milliards d’objets IoT dans le monde (IoT Analytics), générant des pétaoctets de données par jour.

Pour une présentation détaillée, lisez notre article : Capteurs et IoT dans les infrastructures : la colonne vertébrale de l’IA.

L’OCR (Optical Character Recognition) convertit des documents scannés (PDF, images, photos) en texte exploitable (machine-encoded). Combiné à l’IA (modèles NLP), il automatise la saisie de factures, l’extraction de données d’identité, l’archivage intelligent et l’indexation.

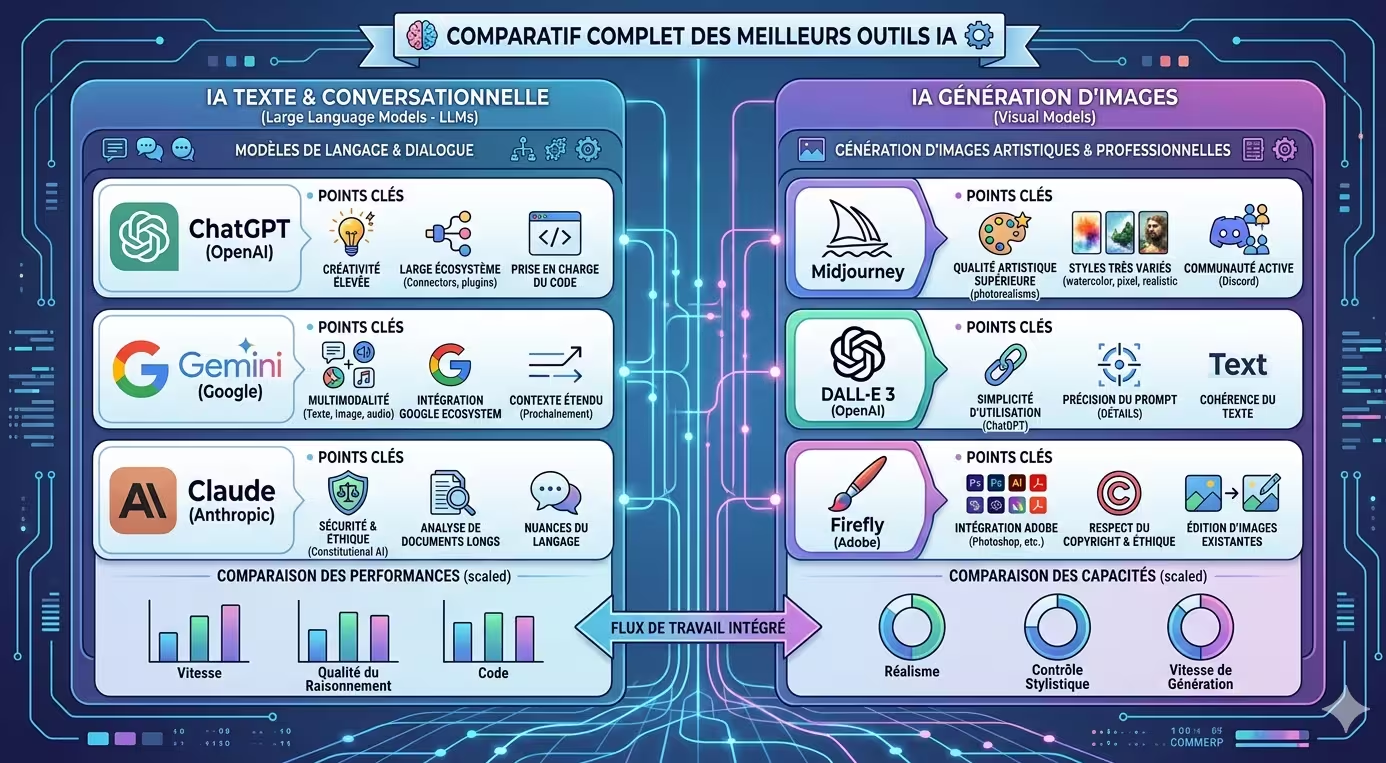

L’IA générative a bouleversé l’écosystème entre 2023 et 2026. Les principaux outils se répartissent en trois catégories : génération de texte (LLM), génération d’image, et modèles multimodaux.

ChatGPT (OpenAI) : modèles GPT-4o (multimodal), GPT-5 (partiel). Points forts : polyvalence, écosystème, API mature. Gemini (Google) : Gemini Ultra 2.0, Gemini Pro. Points forts : recherche web, très long contexte (2M tokens). Claude (Anthropic) : Claude 4 Opus. Points forts : meilleur rédacteur, sécurité (constitutional AI). LLaMA 4 (Meta) : open source.

Midjourney v7 : référence artistique (esthétique, styles). Accès via Discord. DALL-E 3 (OpenAI) : intégré à ChatGPT Plus, bonne compréhension du prompt, réaliste. Stable Diffusion 4 : open source, exécutable localement, liberté totale mais technique. Adobe Firefly : droits légaux (entraîné sur Adobe Stock).

GPT-4o : nativement multimodal (texte, image, audio, vidéo). Gemini Ultra 2.0 : multimodal également. Claude 4 : texte uniquement (pas d’image).

Pour un comparatif complet, consultez nos articles : Comparatif ChatGPT, Midjourney, DALL-E 2026, Comparatif GPT-4o / Gemini Ultra / Claude 4, et notre guide complet pour comprendre l’IA générative.

Infographie n°3 – Comparatif des outils IA génératifs 2026 par catégorie (texte, image, multimodal).

Face à l’écosystème pléthorique, voici une méthode simple en 4 étapes.

Open source : Python, R, PostgreSQL, Scikit-learn, TensorFlow, PyTorch, Superset (BI), Airflow (orchestration). Propriétaires abordables : Power BI (10 €/mois), Snowflake (crédits), Databricks (crédits). Propriétaires chers : Tableau (70 $/mois), Alteryx, solutions SAP.

Débutant : no-code/low-code (KNIME, Dataiku, Orange) → Python (scikit-learn) → deep learning (Keras/TensorFlow). Intermédiaire : Python + scikit-learn + SQL + Git + Docker. Avancé : deep learning (PyTorch/TensorFlow), cloud (AWS/GCP/Azure), MLOps (Kubeflow/MLflow), big data (Spark).

Tous les outils proposent des versions gratuites ou d’essai : Python (gratuit), Power BI Desktop (gratuit), Tableau Public (gratuit), KNIME (gratuit), Dataiku version gratuite limitée, cloud (AWS, GCP, Azure avec 300 $ de crédits). Testez sur quelques jours avec votre propre jeu de données.

Commencez par SQL (interroger vos bases) + Power BI (visualisation) + Python (analyse avancée). Investissez dans la formation des équipes plutôt que dans des outils coûteux.

Pour une carrière en data science en entreprise : Python (plus polyvalent, plus utilisé, meilleur pour le MLOps et le cloud). Pour la recherche statistique ou le milieu académique : R reste pertinent. Pour les débutants absolus, Python est recommandé (courbe d’apprentissage modérée, community importante).

Power BI : moins cher (à partir de 10 €/utilisateur/mois), intégré à l’écosystème Microsoft (Excel, Teams, SharePoint). Tableau : plus puissant visuellement, meilleur pour l’exploration interactive. Pour une PME/ETI déjà équipée Microsoft, Power BI est recommandé. Pour une équipe data dédiée avec budget, Tableau reste la référence.

AWS (marché, services comme Sagemaker, intégrations nombreuses). Azure (intégration Microsoft, entreprise française). Google Cloud (BigQuery leader, Vertex AI, recherche). Pour les débutants, l’offre gratuite de GCP (300 $ de crédits) est intéressante.

ChatGPT (GPT-4o) : polyvalence, large écosystème, API mature. Gemini Ultra 2.0 : recherche en temps réel, très long contexte (2M tokens), intégration Google Workspace. Claude 4 Opus : meilleur rédacteur, plus sûr (constitutional AI). Voir notre comparatif dédié.

Pour les équipes métiers (marketing, finance, RH) : oui, car ils permettent d’analyser des données sans dépendre de la DSI. Pour les data scientists confirmés : non, Python reste plus flexible. Investissez dans la formation des métiers sur KNIME ou Dataiku.