Python : le roi incontesté de la data science et de l'IA

Pourquoi Python domine l'écosystème data.

Langages de programmation, bases de données, frameworks deep learning, infrastructures cloud : plongez dans les coulisses des technologies qui alimentent l'IA et la data science.

L'intelligence artificielle (IA) et l'analyse de données, ou data science, sont des domaines en constante évolution, alimentés par une multitude d'outils et de technologies. Pour mieux comprendre comment fonctionnent ces systèmes intelligents, il est essentiel de connaître les principaux éléments qui les composent.

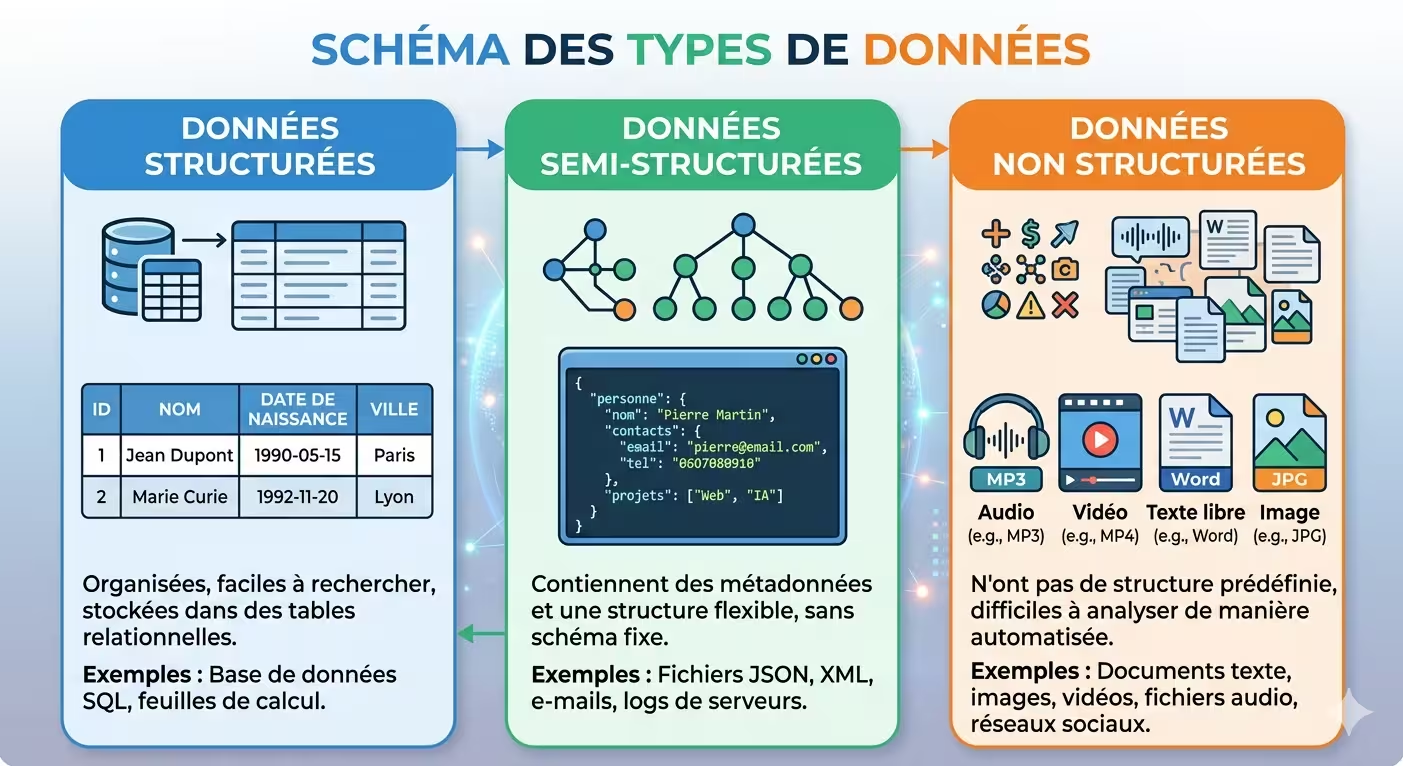

Sans données, pas d'IA. Les données sont le carburant des algorithmes d'apprentissage automatique.

Les données constituent la base essentielle. Leur provenance varie : réseaux sociaux, capteurs, bases de données d'entreprises, transactions en ligne, appareils connectés. Qualité et quantité déterminent directement la fiabilité des résultats obtenus.

Nous avons plus de données que jamais, mais leur qualité reste souvent médiocre. Une bonne IA commence par des données propres et bien documentées.

Schéma des types de données (structurées, semi-structurées, non structurées).

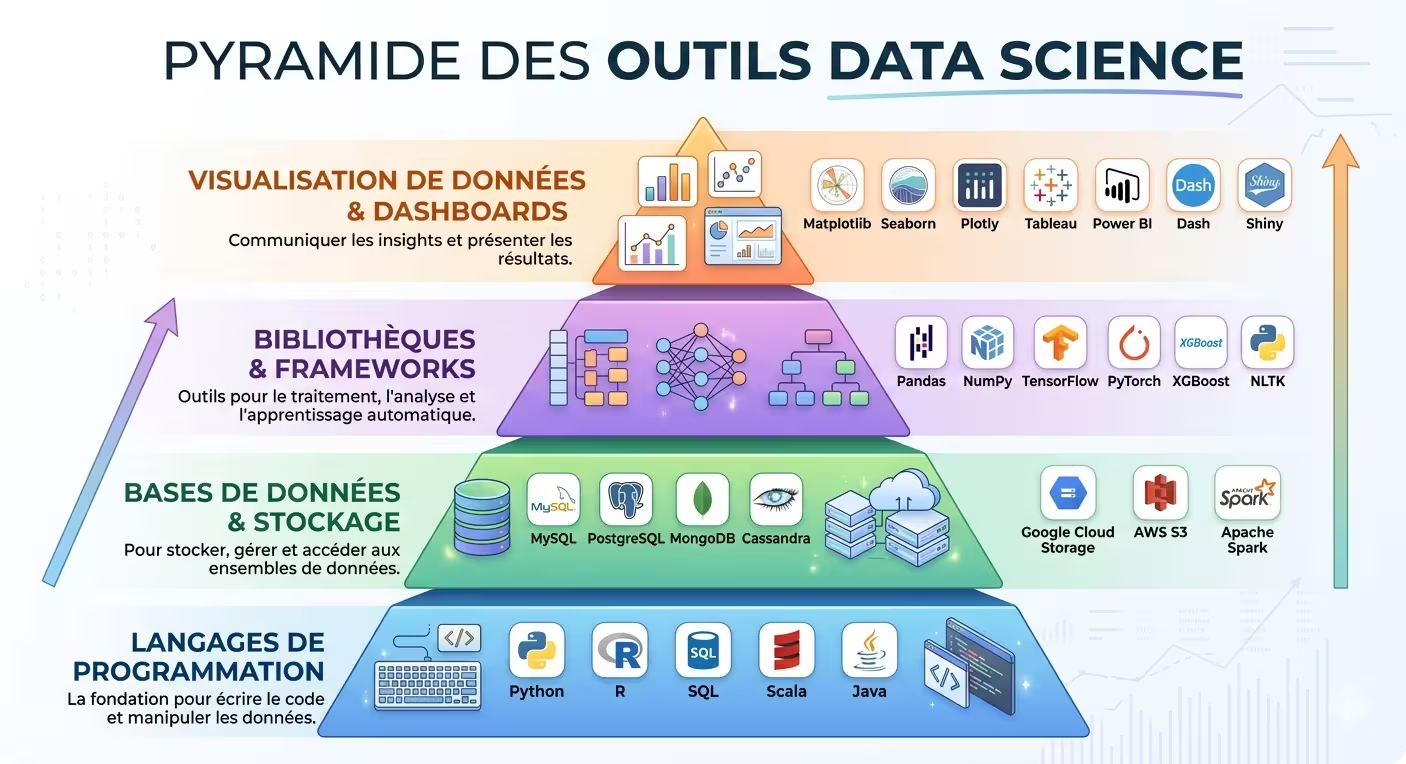

Pour transformer les données brutes en informations utiles, les data scientists s'appuient sur plusieurs technologies.

| Langage | Points forts | Utilisation typique | Part de marché |

|---|---|---|---|

| Python | Polyvalent, écosystème riche, facile à apprendre | Analyse, ML, deep learning, scraping, API | 66% des data scientists |

| R | Statistiques avancées, visualisation (ggplot2) | Analyse statistique, recherche académique | 17% des data scientists |

| SQL | Indispensable pour les bases de données relationnelles | Extraction, transformation, agrégation | 100% des projets (avec bases SQL) |

| Julia | Performance, calcul scientifique | Calcul haute performance, simulation | 4% (en croissance) |

Le stockage organisé des données nécessite des structures appropriées. Les bases relationnelles (SQL) restent les plus utilisées. Cependant, les solutions NoSQL gagnent rapidement du terrain, particulièrement pour la gestion des données non structurées.

Tableau, Power BI, Looker Studio et Matplotlib permettent la création de graphiques interactifs. Les professionnels extraient ainsi facilement des insights pertinents. La visualisation transforme les chiffres bruts en informations compréhensibles.

Pyramide des outils data science (langages → bases de données → bibliothèques → visualisation).

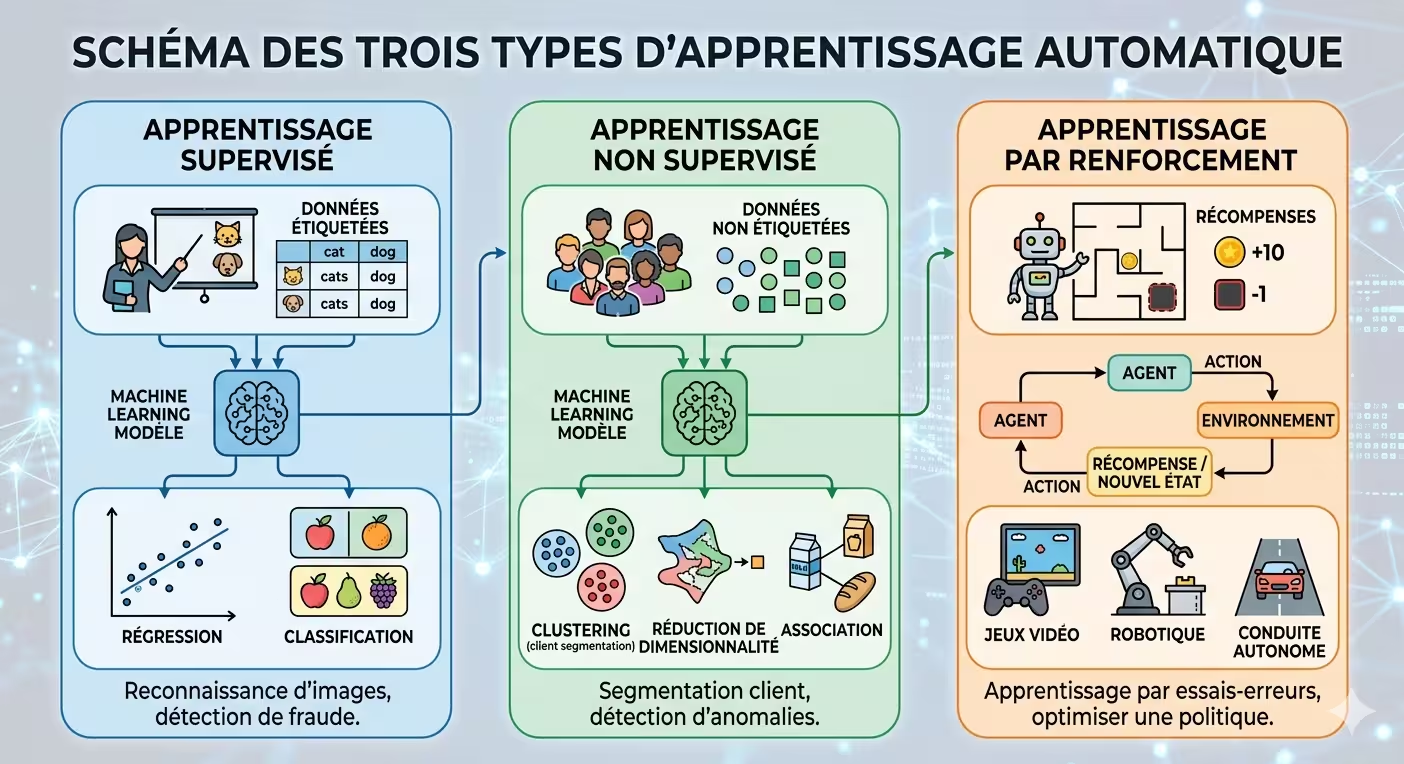

Ces algorithmes représentent l'intelligence des systèmes d'IA. Ils apprennent des données et prennent des décisions.

Utilise des données étiquetées. Un algorithme reconnaissant des chats examine des milliers d'images préalablement identifiées. Il construit ainsi sa compréhension par des entraînements.

Algorithmes clés : Régression linéaire, arbres de décision, Random Forest, SVM, XGBoost, réseaux de neurones

Applications : Classification (spam, image), régression (prix, prévisions)

Explore les données sans étiquette. Les patterns émergent naturellement. Les groupes se forment automatiquement.

Algorithmes clés : K-means, DBSCAN, PCA, t-SNE, autoencodeurs

Applications : Segmentation client, détection d'anomalies, réduction de dimension

Progresse par essais et erreurs. L'algorithme interagit avec son environnement. Il apprend de ses succès comme de ses échecs.

Algorithmes clés : Q-learning, Deep Q-Network (DQN), Policy Gradients, PPO

Applications : Jeux (AlphaGo), robotique, optimisation de processus

Schéma des 3 types d'apprentissage (supervisé, non supervisé, renforcement).

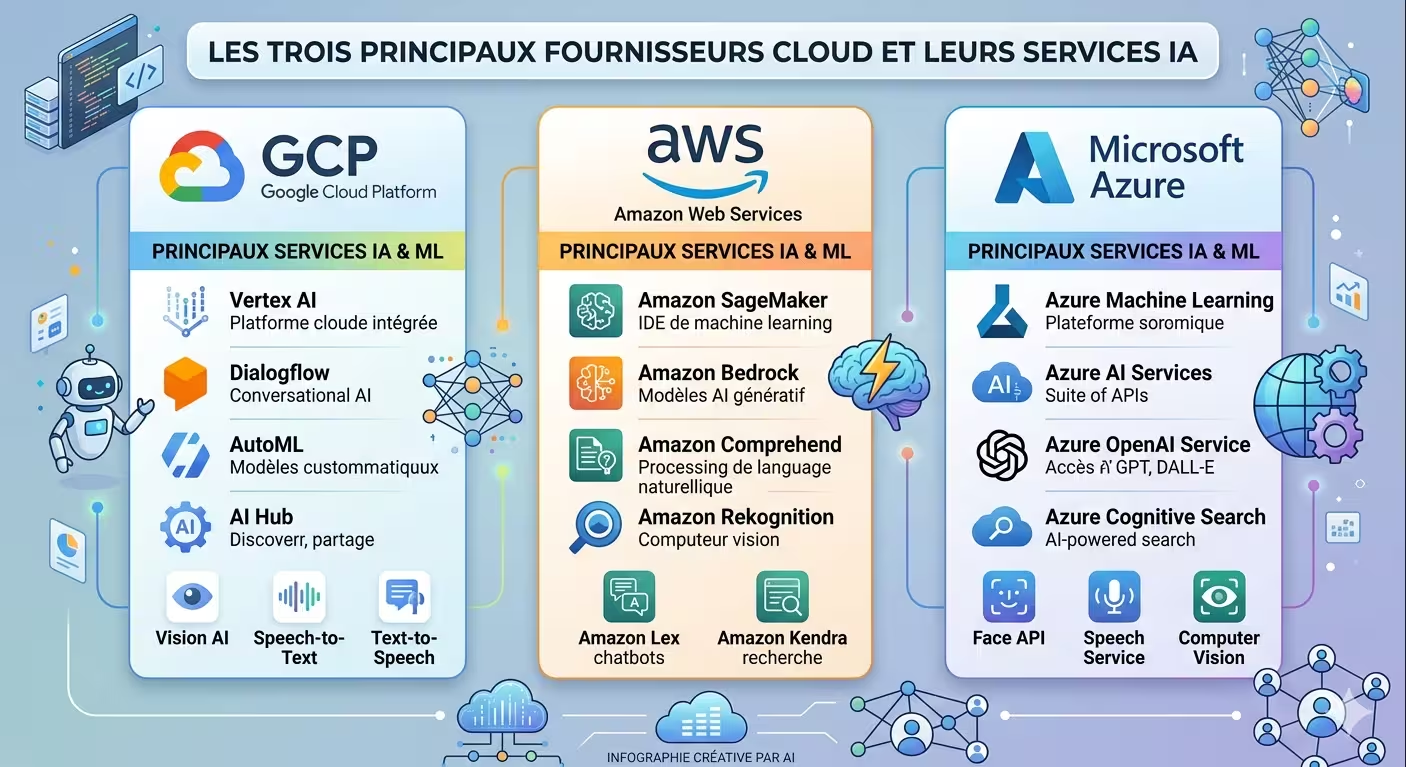

L'entraînement des modèles d'IA demande une puissance considérable. Les entreprises se tournent vers le cloud. Google, Amazon et Microsoft proposent des plateformes performantes. La flexibilité caractérise ces solutions.

| Type | Exemples | Cas d'usage |

|---|---|---|

| SQL (relationnelles) | PostgreSQL, MySQL, SQL Server, Oracle | Données structurées, transactions, reporting |

| NoSQL (documents) | MongoDB, Couchbase | Données JSON, contenu web, logs |

| NoSQL (colonnes) | Cassandra, HBase | Séries temporelles, IoT, analytics |

| Data Warehouses | Snowflake, BigQuery, Redshift | Analytics, BI, reporting avancé |

| Plateforme | Services IA phares | Atouts |

|---|---|---|

| Google Cloud Platform (GCP) | Vertex AI, BigQuery ML, TensorFlow | Recherche avancée, BigQuery, TensorFlow |

| Amazon Web Services (AWS) | SageMaker, Rekognition, Comprehend | Large gamme de services, maturité |

| Microsoft Azure | Azure Machine Learning, Cognitive Services | Intégration avec l'écosystème Microsoft |

Le cloud domine le marché (85% des projets IA en 2026) grâce à sa flexibilité, ses coûts variables et l'accès aux GPU. L'on-premise reste pertinent pour les données sensibles (santé, défense) ou les volumes déjà colossaux.

Logo des 3 principaux cloud providers avec leurs services IA.

La conception des réseaux neuronaux s'est faite en s'inspirant du cerveau humain. Ces réseaux neuronaux forment le cœur de l'apprentissage profond. TensorFlow, PyTorch et Keras facilitent leur création. Ces frameworks accélèrent considérablement le développement des modèles complexes.

| Framework | Créateur | Points forts | Idéal pour |

|---|---|---|---|

| TensorFlow | Production, écosystème complet (TFX, TF Lite, TF.js) | Applications industrielles, mobile, web | |

| PyTorch | Meta | Recherche, flexibilité, débogage facile | R&D, prototypage rapide, académique |

| Keras | François Chollet | API haut niveau, simplicité, intégré à TensorFlow | Débutants, prototypage rapide |

| JAX | Performance, calcul scientifique, accélération GPU/TPU | Recherche avancée, modèles géants |

En 2026, les deux sont d'excellents choix. PyTorch domine la recherche académique (80% des papiers). TensorFlow reste leader en production industrielle. La plupart des data scientists maîtrisent les deux.

Créer un modèle n'est que la moitié du travail. Le déployer en production et le maintenir est l'autre moitié. Les outils MLOps (Machine Learning Operations) automatisent ce cycle.

Les grands modèles de langage (LLM) open source rivalisent désormais avec les modèles propriétaires (GPT-4).

Les outils comme LangChain, LlamaIndex et RAG (Retrieval-Augmented Generation) se généralisent.

Des modèles capables d'exécuter des actions (réserver un billet, envoyer un email) se développent rapidement.

Face aux exigences réglementaires (AI Act), les outils d'explicabilité (SHAP, LIME) deviennent indispensables.

Python reste le choix numéro 1 (66% des data scientists). Sa courbe d'apprentissage est douce et son écosystème est inégalé. SQL est indispensable pour extraire des données. R est utile si vous travaillez en recherche académique ou en statistiques avancées.

Pour un débutant, commencez par Keras (intégré à TensorFlow). Ensuite, apprenez PyTorch si vous visez la recherche ou le prototypage rapide, ou TensorFlow si vous visez la production industrielle. Idéalement, apprenez les deux sur le long terme.

AWS est le plus mature et le plus utilisé. Google Cloud est excellent pour TensorFlow, BigQuery et la recherche. Azure est idéal si vous êtes déjà dans un environnement Microsoft. Le meilleur choix dépend de votre contexte existant.

Le data scientist explore les données, construit et entraîne des modèles (Jupyter, Python). Le ML engineer déploie ces modèles en production, construit les pipelines et assure la maintenance (DevOps, Docker, Kubernetes, MLOps).

Des plateformes comme Google AutoML, DataRobot, H2O.ai ou Teachable Machine permettent de créer des modèles d'IA sans code. C'est parfait pour découvrir les concepts avant d'apprendre la programmation.

Jupyter Notebook est un environnement interactif où vous pouvez écrire du code (Python, R, Julia), visualiser des graphiques et ajouter du texte explicatif dans un même document. C'est l'outil de prédilection des data scientists pour l'exploration et le prototypage.

L'univers de la data et de l'IA est vaste et en constante évolution. En comprenant les fondamentaux et les principaux outils utilisés, vous serez mieux équipés pour appréhender les enjeux de cette révolution technologique.