Derrière chaque algorithme d’intelligence artificielle performant se cache une réalité moins glamour mais tout aussi cruciale : des milliards de données brutes, collectées en continu par des capteurs, des caméras, des compteurs, et des objets connectés. Sans données, pas d’IA. Et sans données de qualité, pas d’IA fiable. Les infrastructures intelligentes — ponts, routes, usines, hôpitaux, réseaux électriques, bâtiments — sont aujourd’hui équipées de capteurs IoT (Internet of Things) qui produisent des flux massifs d’informations. Mais collecter des données ne suffit pas. Il faut les nettoyer, les synchroniser, les structurer, les enrichir. Cet article explore la chaîne de valeur de la donnée, des capteurs aux algorithmes, et explique comment les données brutes deviennent le carburant de l’IA.

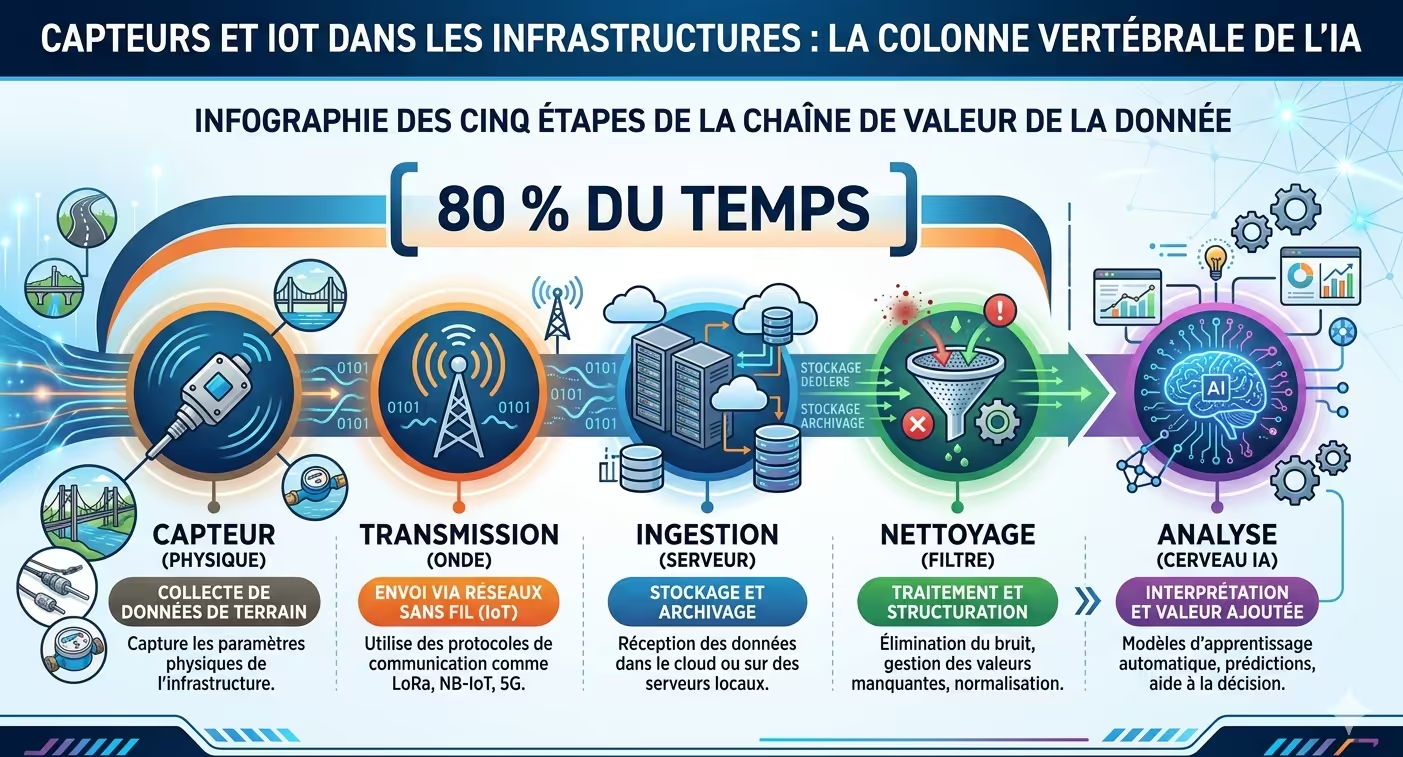

Une chaîne de valeur de la donnée se décompose en plusieurs étapes, de la production brute jusqu’à l’exploitation par l’IA. Chaque étape est essentielle et peut être réalisée par des outils spécialisés.

Les capteurs IoT (température, pression, mouvement, image, etc.) produisent des données brutes. Ces données sont transmises via des protocoles de communication (MQTT, CoAP, HTTP, LoRaWAN) vers des concentrateurs (gateways) ou directement vers le cloud.

Les données sont acheminées vers des systèmes de stockage (data lakes, bases de données temps réel). Les plateformes d’ingestion (Apache Kafka, Amazon Kinesis, Azure IoT Hub) gèrent les flux massifs.

Suppression des doublons, correction des erreurs, imputation des valeurs manquantes, filtrage du bruit, normalisation des unités. C’est l’étape la plus chronophage (souvent 60-80 % du temps projet).

Aggrégation, transformation (mise en forme), annotation (labelisation), enrichissement (croisement avec d’autres sources). Les données deviennent exploitables par les algorithmes de machine learning.

Les données nettoyées et préparées alimentent les modèles d’IA : classification, régression, clustering, deep learning. Les résultats sont interprétés et déployés en production.

80 % du temps d’un projet d’IA est consacré à la collecte, au nettoyage et à la préparation des données. Seuls 20 % sont dédiés au modelage et à l’entraînement. Pourtant, la plupart des formations et des articles se concentrent sur les algorithmes, négligeant l’amont. Cette asymétrie explique pourquoi de nombreux projets d’IA échouent ou déçoivent.

Infographie n°1 – Les cinq étapes de la chaîne de valeur de la donnée : collecte, transmission, nettoyage, préparation, analyse.

Les capteurs sont les organes sensoriels des infrastructures intelligentes. Ils transforment des phénomènes physiques (température, mouvement, lumière, pression, humidité, vibration, etc.) en signaux électriques, puis en données numériques.

| Type de capteur | Grandeur mesurée | Applications typiques | Exemples de modèles |

|---|---|---|---|

| Température / humidité | Degrés Celsius, % HR | CVC (chauffage ventilation climatisation), chaîne du froid, agriculture, data centers | Sensirion SHT3x, DHT22, BME280 |

| Pression | Pascal (Pa), bar | Surveillance des canalisations d’eau, pneumatiques, processus industriels | Bosch BMP388, Honeywell MIP |

| Vibration / accélération | m/s², g | Maintenance prédictive (machines tournantes, ponts), détection de séismes | Analog Devices ADXL345, ST LIS3DH |

| Proximité / distance | mm, cm, m | Stationnement intelligent, détection de présence, robotique | Ultrason HC-SR04, Lidar TFmini |

| Image / vision | Pixels (RGB, infrarouge) | Surveillance, comptage de flux, inspection qualité, reconnaissance faciale | Caméras IP (Hikvision, Axis), Raspberry Pi Camera |

| Gaz / qualité de l’air | ppm, ppb | Pollution urbaine, détection de fuites (CO, méthane), air intérieur | Sensirion SGP30, Figaro TGS |

Une fois la mesure effectuée, les données doivent être transmises. Le choix du protocole dépend de la bande passante, de la consommation énergétique, de la distance et de la fiabilité requise.

Une infrastructure intelligente peut produire des dizaines de téraoctets par jour. Une raffinerie équipée de 10 000 capteurs (température, pression, vibration) collecte des millions de mesures par seconde. Une ville intelligente (smart city) peut atteindre le pétaoctet par jour via ses caméras et capteurs de flux. La gestion de ces volumes (big data) est un défi technique à part entière.

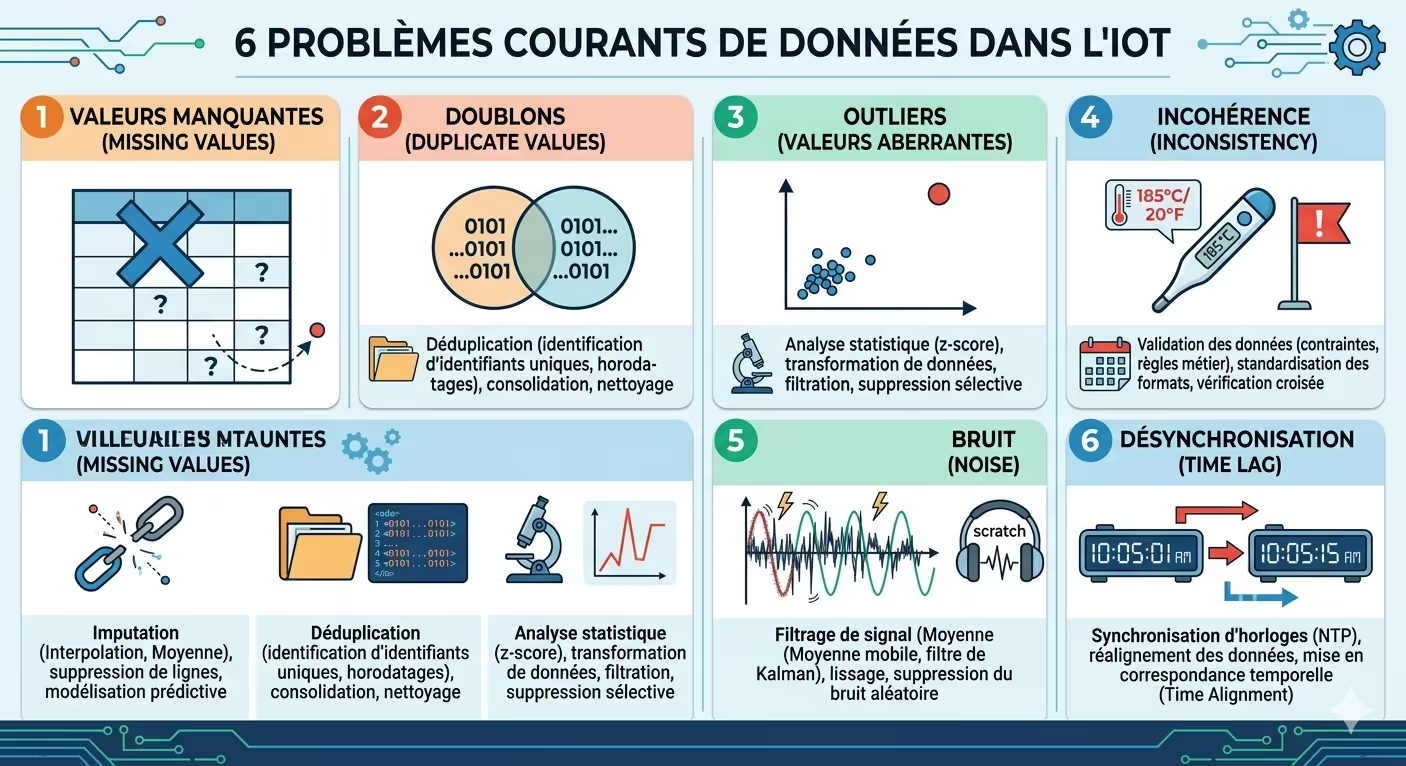

Les données brutes sont rarement exploitables directement. Elles contiennent des erreurs, des valeurs aberrantes, des doublons, des silences. Le nettoyage (data cleaning) est l’étape la plus chronophage (60-80 % du temps projet).

Un capteur de vibration sur un moteur produit 100 mesures par seconde. Si 1 % des mesures sont bruitées, cela représente des millions de valeurs à nettoyer. Un mauvais nettoyage conduirait à des fausses alarmes (prédiction d’une pane inexistante) ou au contraire à une non-détection d’une vraie anomalie. Les algorithmes de nettoyage automatique (détection d’anomalies, filtrage adaptatif) sont essentiels.

Infographie n°2 – Les six problèmes courants dans les données brutes et leurs solutions de nettoyage.

Une fois les données nettoyées, elles doivent être transformées dans un format exploitable par les algorithmes de machine learning.

Pour l’apprentissage supervisé, il est nécessaire de « labelliser » les données. Exemples :

L’annotation est coûteuse et chronophage. Des techniques d’apprentissage semi-supervisé ou par renforcement (RL) réduisent le besoin de labelisation.

On crée de nouvelles variables (features) à partir des données brutes pour améliorer les performances du modèle. Exemples :

La qualité des données d’entrée détermine la performance maximale de n’importe quel modèle d’IA. Des données mal nettoyées ou mal préparées produiront des résultats médiocres, même avec l’algorithme le plus sophistiqué. Investir dans la qualité des données est plus rentable que d’optimiser le moindre paramètre d’un réseau de neurones.

Face à l’explosion des volumes, il devient impossible (ou coûteux) de tout envoyer dans le cloud. L’edge computing (ou « fog computing ») consiste à traiter les données localement, sur le capteur ou sur une passerelle (gateway) proche, avant d’envoyer des résultats agrégés ou des alertes.

La qualité des données se mesure selon plusieurs dimensions. Une infrastructure IoT doit garantir un niveau de qualité suffisant pour l’usage prévu (pas nécessairement parfait).

Des capteurs de vibration sur chaque robot de production. Les données (2000 mesures/seconde) sont envoyées à une passerelle edge qui calcule des indicateurs de santé. Seules les alertes sont transmises au cloud. Nettoyage : détection et correction des pics d’usure anormaux via filtrage médian. Enrichissement : calcul du RMS (Root Mean Square) et des fréquences de résonance. Résultat : maintenance prédictive (alertes 2 semaines avant une panne réelle).

Capteurs de flux (boucles magnétiques) et caméras de comptage aux carrefours. Les données brutes (nombre de véhicules, vitesses) sont agrégées toutes les 5 minutes. Nettoyage : suppression des valeurs aberrantes (boucle défaillante). Enrichissement : croisement avec les données météo et les jours fériés. Résultat : prédiction des embouteillages et optimisation des feux tricolores.

Capteurs d’humidité du sol dans les champs (réseau LoRaWAN). Collectes toutes les heures. Nettoyage : suppression des valeurs aberrantes liées aux rongeurs ou aux chocs. Agrégation : moyenne sur la parcelle. Résultat : déclenchement automatique de l’irrigation uniquement quand une parcelle atteint un seuil bas.

Un capteur (capteur) mesure une grandeur physique (température, pression, lumière) et convertit cette mesure en signal électrique → entrée de données. Un actionneur reçoit un signal électrique et agit sur le monde physique (ouvrir une vanne, actionner un moteur, allumer une lumière) → sortie de commande. Dans un système IoT intelligent, le capteur alimente l’IA, et l’IA commande l’actionneur.

Cela dépend de l’application. Pour la température d’un local, une mesure par heure suffit. Pour la vibration d’une turbine, une mesure par milliseconde peut être nécessaire. La règle : collecter à une fréquence au moins double de la fréquence maximale du phénomène (théorème de Shannon-Nyquist). Attention : collecter trop de données inutiles coûte de l’énergie et de la bande passante. Le sur-échantillonnage n’est pas toujours une bonne idée.

Plusieurs catégories : 1) Langages et bibliothèques : Python (pandas, numpy), R (dplyr, tidyr), SQL (requêtes de nettoyage). 2) Outils open source : Apache Spark (grands volumes), Apache Beam, TensorFlow Data Validation. 3) Plateformes cloud : AWS Glue, Azure Data Factory, Google Dataflow. 4) Outils spécialisés IoT : ThingSpeak, Ubidots. Le choix dépend de la taille des données et de l’infrastructure.

Multiples couches : 1) Authentification du capteur (certificat, clé prépartagée). 2) Chiffrement des communications (TLS). 3) Intégrité des messages (signature). 4) Sécurisation du cloud (IAM, journalisation). 5) Mises à jour régulières des firmwares. 6) Détection d’anomalie (un capteur qui envoie des valeurs aberrantes peut être compromis).

Très variable. Pour quelques capteurs (température, humidité) avec une passerelle LoRaWAN : quelques centaines d’euros. Pour une usine intelligente (milliers de capteurs, edge computing, cloud) : centaine de milliers à millions d’euros. Les coûts incluent : capteurs (5-200 € pièce), réseau (gateways, abonnement LPWAN), stockage cloud (0,01-0,1 € par Go/mois), analyse (ingénieurs data, plateforme).