Intelligence artificielle expliquée simplement

Les fondamentaux de l'IA pour bien comprendre l'IA générative.

De ChatGPT à DALL-E, en passant par Midjourney et Gemini : découvrez comment fonctionne l'IA générative, son histoire, ses applications par secteur, ses limites et ses enjeux éthiques.

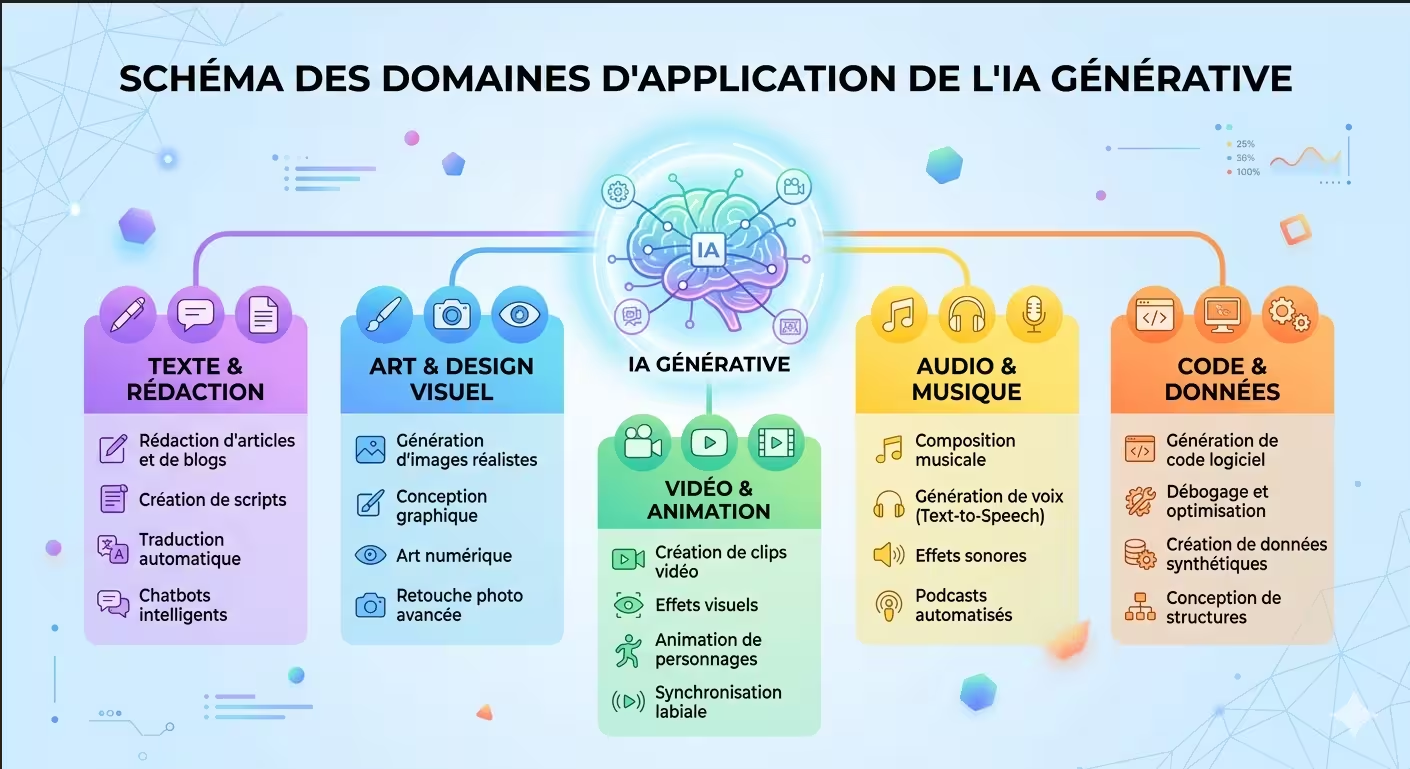

L'intelligence artificielle générative (IA générative) est une branche de l'IA capable de produire de nouveaux contenus et idées, comme des conversations, des histoires, des images, des vidéos et même de la musique. Cette technologie imite certaines capacités humaines dans des domaines variés, tels que la reconnaissance d'images et le traitement du langage naturel.

L'IA générative crée du contenu original à partir de données existantes. Contrairement à une IA classique qui classifie ou prédit, une IA générative invente (texte, image, son).

Considérée comme l'évolution majeure de l'intelligence artificielle, l'IA générative peut être formée sur des sujets complexes comme le langage humain, les langages de programmation, ou encore des disciplines scientifiques comme la chimie et la biologie. Les entreprises peuvent tirer parti de l'IA générative dans divers domaines, notamment les chatbots, la création de contenus multimédias, ainsi que le développement et la conception de produits.

Schéma des domaines d'application de l'IA générative

Les racines de l'IA remontent aux années 1950, avec des pionniers comme Alan Turing, qui a proposé le célèbre "Test de Turing" pour évaluer la capacité d'une machine à imiter l'intelligence humaine. L'IA générative telle que nous la connaissons aujourd'hui a commencé à prendre forme dans les années 1980 et 1990, avec des recherches sur les réseaux de neurones et les algorithmes d'apprentissage automatique.

Les réseaux de neurones artificiels, inspirés par la structure du cerveau humain, permettent aux machines d'apprendre à partir de données en ajustant leurs connexions internes. Cette approche a été au cœur du développement de l'IA générative moderne.

Au début des années 2000, l'émergence de grandes quantités de données sur Internet a facilité le développement de modèles d'apprentissage profond. L'une des avancées majeures a été l'introduction des transformers en 2017, une architecture qui a révolutionné le traitement du langage naturel (NLP).

Les modèles basés sur cette architecture, tels que BERT (Google) et GPT (OpenAI), ont montré une capacité impressionnante à générer du texte de manière fluide et cohérente.

L'IA générative fonctionne par prédiction. Elle n'a pas de pensées ou d'opinions propres, mais elle prédit des séquences de mots (ou de pixels) qui sont susceptibles d'avoir un sens pour l'utilisateur.

Les modèles de langage, souvent désignés sous l'appellation de LLM (Large Language Models), sont au cœur de l'IA générative. Ces modèles apprennent à partir de vastes ensembles de données textuelles disponibles sur Internet (livres, articles, sites web, code source), leur permettant d'assimiler les règles linguistiques et de réaliser diverses tâches.

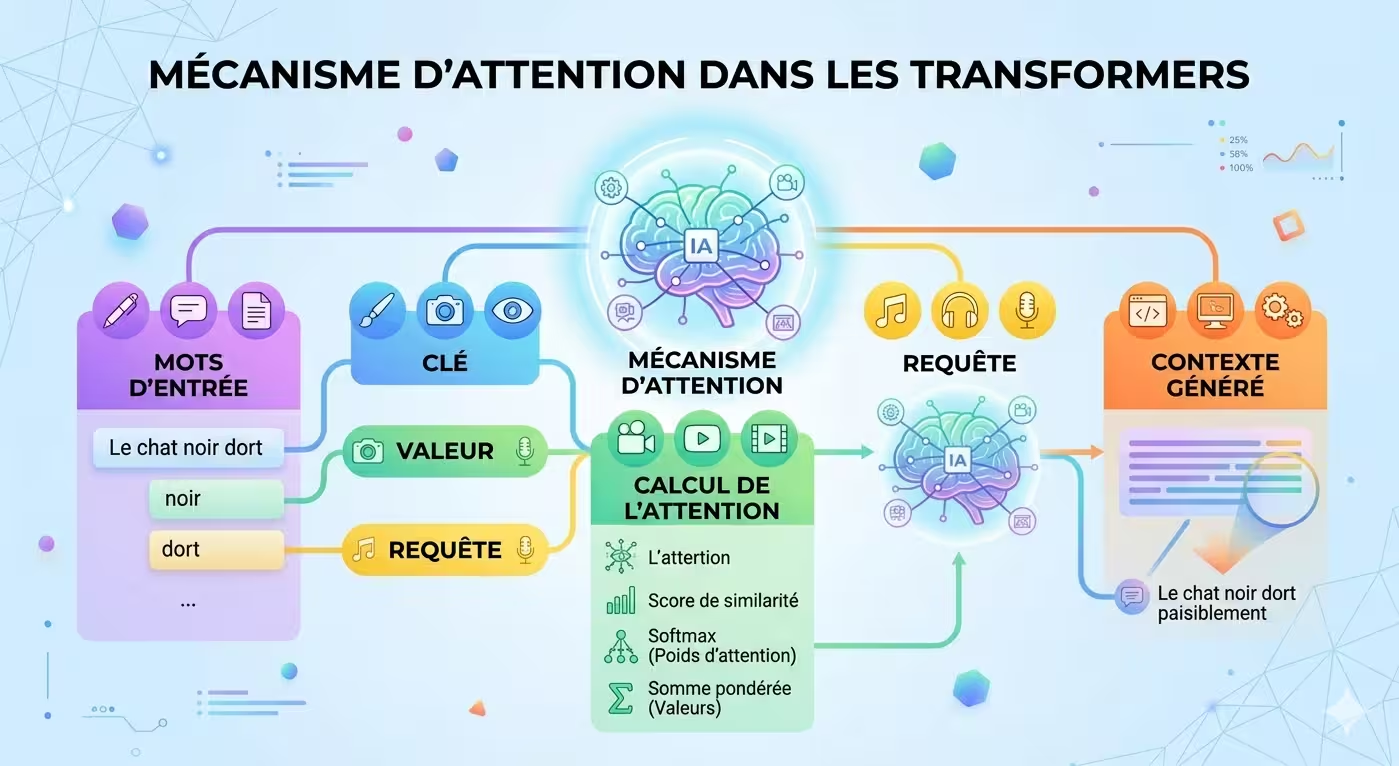

Le modèle Transformer utilise un mécanisme d'attention qui permet au réseau de se concentrer sur différentes parties d'un texte, même si elles sont éloignées les unes des autres. Cette capacité a permis aux IA de mieux comprendre le contexte et les relations entre les mots.

175 zettaoctets de données numériques sont disponibles dans le monde (IDC, 2025). Les modèles sont entraînés sur des milliards de pages web, livres et articles.

Le mécanisme d'attention permet de comprendre le contexte sur de longues distances (100 000+ tokens).

Des clusters de milliers de GPU (Nvidia A100, H100) permettent d'entraîner ces modèles en quelques semaines ou mois.

Illustration du mécanisme d'attention dans les Transformers

| Capacité | Exemple | Outil emblématique | |

|---|---|---|---|

| Synthèse de texte | Résumer un article ou un document | ChatGPT, Claude, Gemini | |

| Traduction | Traduire d'une langue à l'autre | DeepL, Google Translate | |

| Correction d'erreurs | Orthographe, grammaire, style | Grammarly, Antidote | |

| Réponse aux questions | Q&A, support client | ChatGPT, Gemini | |

| Génération d'images | Créer une image à partir d'une description | DALL-E, Midjourney, Stable Diffusion | |

| Synthèse vocale | Convertir du texte en parole réaliste | ElevenLabs, Resemble AI | |

| Génération de code | Écrire, compléter, debugger du code | GitHub Copilot, Cursor | |

| Génération vidéo | Créer des vidéos à partir de texte | Sora (OpenAI), Runway Gen-2 |

Si vous demandez à un modèle "Quel est le meilleur livre de science-fiction ?", il n'a pas d'opinion personnelle. Il génère une réponse basée sur des données qu'il a analysées (critiques, classements, mentions). Les réponses sont le produit d'analyses statistiques, pas de réflexions conscientes.

Selon l'International Data Corporation (IDC), d'ici 2025, la quantité de données numériques dans le monde devrait atteindre 175 zettaoctets. Cette croissance exponentielle des données (réseaux sociaux, sites web, capteurs IoT, applications mobiles) offre un immense réservoir d'informations pour l'entraînement des modèles.

L'architecture des réseaux neuronaux a subi des transformations majeures, notamment avec l'introduction des modèles de type "transformateur" (article « Attention is All You Need », Google 2017). BERT (Google) a révolutionné le traitement du langage naturel en analysant le texte dans les deux sens (gauche→droite et droite→gauche).

L'essor des unités de traitement graphique (GPU) et des architectures de calcul parallèles a transformé le paysage. Nvidia a développé des GPU adaptés à l'apprentissage profond (série A100, H100), permettant d'accélérer considérablement l'entraînement des modèles.

Les plateformes cloud (AWS, Microsoft Azure, Google Cloud) offrent des services de cloud computing qui permettent aux développeurs d'accéder à une puissance de calcul à la demande, démocratisant l'accès à des ressources autrefois réservées aux grandes entreprises.

| Acteur | Modèles phares | Particularité |

|---|---|---|

| OpenAI | GPT-4, GPT-5, DALL-E 3, Sora | Pionnier, API très utilisée |

| Google DeepMind | Gemini, Gemini 2.5 Pro, Imagen, Veo | Multimodal intégré à l'écosystème Google |

| Anthropic | Claude 3, Claude 4 | Focalisé sur la sécurité et l'éthique |

| Meta (Facebook) | Llama 2, Llama 3 | Modèles open source, recherche académique |

| Mistral AI | Mistral 7B, Mixtral, Mistral Large | Start-up française, modèles efficaces |

| Stability AI | Stable Diffusion | Génération d'images open source |

| Midjourney | Midjourney v6 | Génération d'images (qualité artistique) |

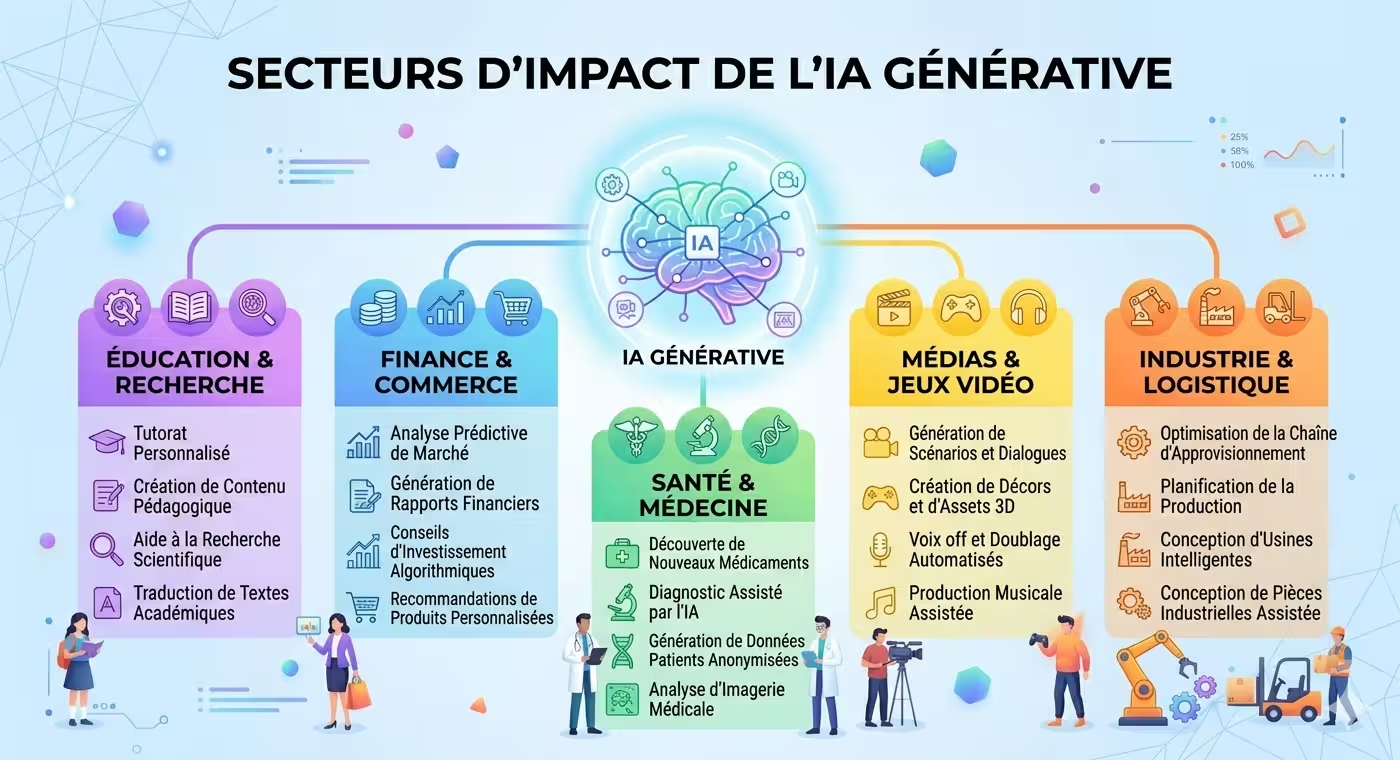

Infographie des secteurs impactés par l'IA générative

Malgré leurs capacités impressionnantes, les modèles d'IA génératifs présentent des limitations. L'un des problèmes majeurs est celui des hallucinations, où le modèle produit des informations incorrectes ou incohérentes (faits inventés, citations inexistantes).

Ces hallucinations peuvent avoir des conséquences graves dans des domaines comme le journalisme ou la recherche scientifique, où la précision est essentielle. Les utilisateurs doivent donc être conscients des limites des modèles et valider les informations générées.

Lorsque les entreprises ajustent les modèles de fondation avec des données sensibles, il existe un risque de fuite d'informations. Des cas ont été signalés où des données personnelles ont été involontairement intégrées dans des modèles d'IA, mettant en danger la vie privée des individus.

Les modèles d'IA, en s'appuyant sur des données d'entraînement disponibles publiquement, peuvent parfois reproduire des phrases ou des styles sans crédit adéquat. Des artistes ont exprimé des préoccupations concernant l'utilisation non autorisée de leur style artistique.

La capacité de l'IA générative à créer des contenus réalistes soulève des inquiétudes concernant les deepfakes (vidéos manipulées) et les fausses identités en ligne.

Un modèle interrogé sur "Qui a inventé l'ampoule électrique ?" pourrait répondre "Albert Einstein" si ses données d'entraînement contiennent cette fausse association. Les modèles ne "savent" pas, ils "prédisent" le mot le plus probable.

Qui possède le contenu généré par l'IA ? L'utilisateur ? L'entreprise qui a créé le modèle ? Les auteurs des données d'entraînement ? Ces questions sont au cœur des débats juridiques actuels.

L'IA générative peut être utilisée pour créer des fausses nouvelles, des avis de produits frauduleux, ou des campagnes de désinformation à grande échelle.

Selon le Forum économique mondial, l'IA générative pourrait supprimer 85 millions d'emplois d'ici 2030, mais en créer 97 millions. Les métiers de création de contenu, de traduction et de support client sont particulièrement concernés.

L'Union européenne a adopté l'AI Act, la première réglementation mondiale sur l'IA. Les systèmes d'IA générative sont classés comme "risque limité" mais doivent respecter des obligations de transparence (mention que le contenu est généré par IA).

L'IA traditionnelle (discriminative) classifie ou prédit à partir de données existantes (ex: détection de spam). L'IA générative crée du contenu nouveau (texte, image, son) à partir d'apprentissages. L'une analyse, l'autre crée.

ChatGPT existe en version gratuite (GPT-3.5) avec des limitations (connexion, vitesse). La version payante ChatGPT Plus (environ 20$/mois) donne accès à GPT-4, plus rapide et avec des capacités multimodales (analyse d'images).

Non, mais elle va transformer leur travail. L'IA devient un assistant qui génère des premières versions, des idées ou automatise des tâches répétitives. La créativité, la direction artistique et le jugement humain restent essentiels.

Un prompt est l'instruction textuelle donnée à un modèle d'IA générative. La qualité de la réponse dépend beaucoup de la qualité du prompt (précision, contexte, exemples). L'art du "prompt engineering" est devenu une compétence recherchée.

Pour le texte : GPT-5 (OpenAI), Gemini 2.5 Pro (Google), Claude 4 (Anthropic), Mistral Large. Pour les images : DALL-E 3, Midjourney v6, Stable Diffusion 3. Pour le code : GitHub Copilot, Cursor. Le "meilleur" dépend de l'usage (prix, vitesse, qualité).

L'entraînement se fait en trois étapes : (1) Pré-entraînement sur des milliards de textes/images (apprentissage non supervisé), (2) Supervised fine-tuning (exemples avec réponses correctes), (3) Reinforcement Learning from Human Feedback (RLHF) pour aligner le modèle sur les préférences humaines.

L'IA générative offre des possibilités fascinantes dans de nombreux domaines, tant professionnels que créatifs. Bien qu'elle ait le potentiel de transformer notre façon de travailler et d'interagir avec la technologie, il est crucial de rester conscient des limites et des défis qui l'accompagnent.