L’intelligence artificielle n’est pas neutre. Derrière les algorithmes se cachent des choix de conception, des données biaisées, des arbitrages entre efficacité et équité, des tensions entre sécurité et libertés individuelles. En 2026, alors que l’IA générative se généralise et que les systèmes de recommandation structurent nos vies numériques, les questions éthiques ne sont plus optionnelles. Elles sont au cœur du débat public, des régulations (IA Act, RGPD) et des préoccupations citoyennes. Cette page pilier (plus de 4 500 mots) explore les principaux enjeux éthiques et sociétaux de l’IA : biais algorithmiques, vie privée et surveillance, droit d’auteur, automatisation du travail, addiction numérique, désinformation, et impact cognitif. Elle vise à fournir une analyse critique, pédagogique et documentée pour comprendre les risques, les limites et les garde-fous nécessaires à une IA responsable. Que vous soyez citoyen, étudiant, professionnel ou décideur, vous trouverez ici les clés pour naviguer dans ce champ complexe.

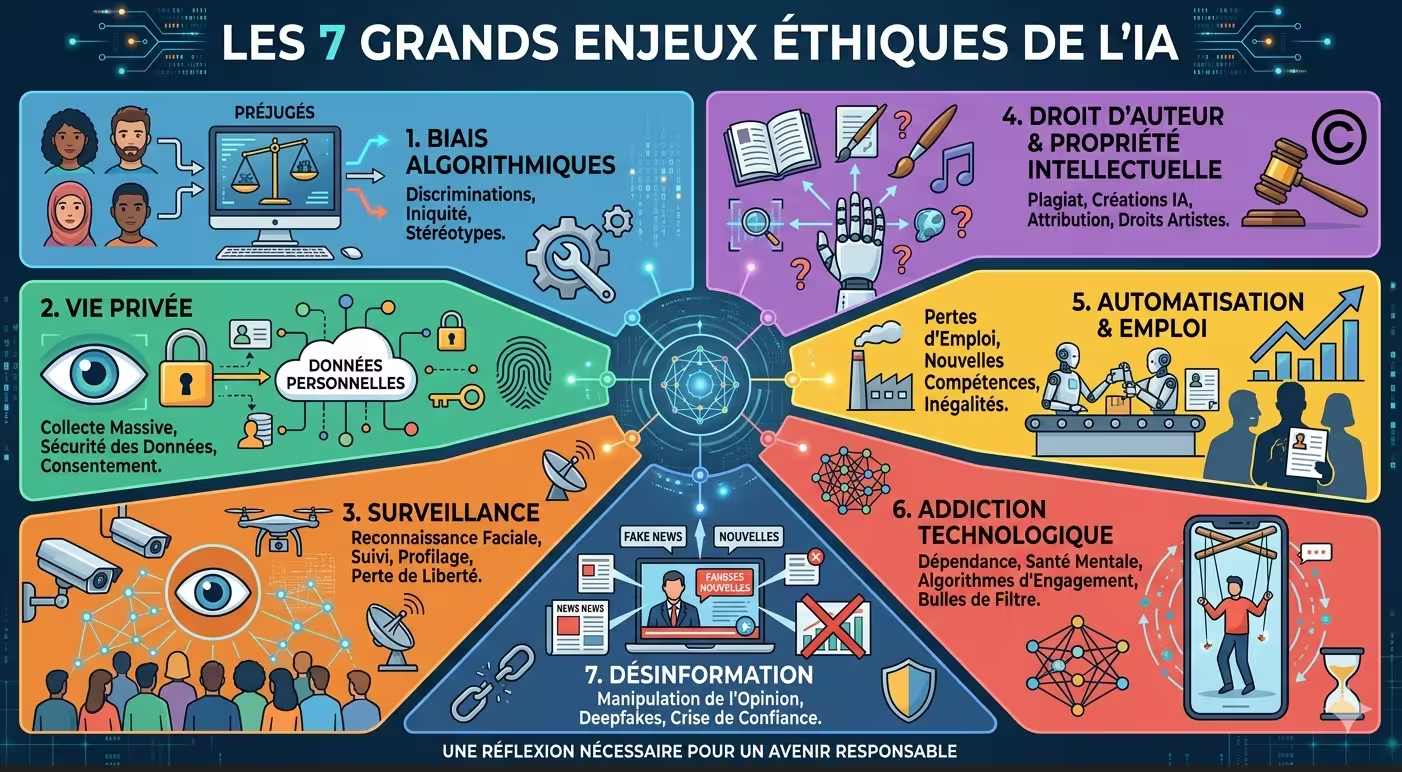

Infographie n°1 – Les sept grands enjeux éthiques de l’IA en 2026 : biais, vie privée, surveillance, droit d’auteur, automatisation, addiction, désinformation.

L’éthique de l’intelligence artificielle est devenue un sujet central pour plusieurs raisons. L’IA est désormais omniprésente ; elle influence les décisions d’embauche, d’octroi de crédit, de maintien à domicile, de maintien en détention, et même de soins médicaux. Les biais algorithmiques peuvent reproduire ou amplifier les discriminations historiques. Les systèmes de recommandation peuvent enfermer les utilisateurs dans des bulles de filtres et favoriser l’addiction. La surveillance de masse par IA menace les libertés individuelles. Et l’IA générative bouleverse le droit d’auteur et la propriété intellectuelle. Face à ces défis, les citoyens, les entreprises et les régulateurs cherchent un équilibre entre innovation et protection. Cette page pilier analyse ces enjeux de manière critique et pédagogique.

Les biais algorithmiques sont des erreurs systématiques qui produisent des résultats injustes, discriminatoires ou non représentatifs. Ils proviennent généralement des données d’entraînement (biais historiques), des choix de conception (variables proxy discriminantes), ou du déploiement dans des contextes non prévus. Pour une exploration approfondie, consultez notre article dédié : Biais algorithmiques : danger pour équité et justice.

Un modèle peut être très précis sur l’ensemble de la population mais très biaisé sur des sous-groupes. L’équité ne s’oppose pas à la performance ; c’est une exigence éthique et légale dans de nombreux pays (loi sur la non-discrimination).

L’IA repose sur la collecte massive de données personnelles. Cette collecte, si elle n’est pas encadrée, menace la vie privée et peut conduire à des dérives autoritaires. Pour approfondir la protection des données, consultez notre article : Protection de la vie privée : peut-on concilier IA et RGPD ? et L’IA et l’atteinte à la vie privée : une préoccupation croissante.

Le RGPD impose : un consentement explicite pour la collecte (pas de case pré-cochée), un droit d’accès, de rectification, à l’effacement (« droit à l’oubli »), à la portabilité des données, et une notification des fuites en moins de 72 heures. Les sanctions peuvent atteindre 20 M€ ou 4 % du CA mondial. En 2025, la CNIL a sanctionné Amazon à 30 M€ et Google à 50 M€ pour manquements (cookie wall, consentement).

Pour les enjeux de surveillance, voir section 9.

L’IA générative (ChatGPT, Midjourney, DALL-E, Stable Diffusion) est entraînée sur des millions d’œuvres protégées par le droit d’auteur (livres, images, musiques), souvent sans autorisation explicite ni rémunération des ayants droit. De plus, une œuvre générée par IA peut-elle être protégée par le droit d’auteur ? Pour approfondir, consultez notre article : Droit d’auteur et IA générative : ce qu’il faut savoir en 2026.

Une œuvre générée entièrement par IA (sans intervention humaine créative) n’est pas protégeable par le droit d’auteur, faute d’« auteur humain ». En revanche, une œuvre « augmentée » par l’IA avec contribution humaine significative (prompt détaillé, modifications manuelles, sélection créative) peut être protégée. L’AI Act européen impose aux fournisseurs de modèles de publier un résumé détaillé des données d’entraînement, permettant aux ayants droit de s’opposer.

L’IA suscite des craintes légitimes sur l’avenir du travail. Selon les études, 45 % des tâches professionnelles sont potentiellement automatisables avec les technologies actuelles (McKinsey, 2026). Cependant, cela ne signifie pas que 45 % des emplois vont disparaître : la plupart des métiers verront une partie de leurs tâches automatisées (augmentation, pas remplacement). Pour approfondir, consultez notre article : Automatisation des tâches par l’IA : quels métiers sont concernés ?

Formez-vous à l’IA pour augmenter votre productivité. Les compétences en prompt engineering, analyse de données, et compréhension des modèles deviennent différenciantes. Anticipez les évolutions de votre métier.

Les algorithmes de recommandation (TikTok, Instagram, YouTube) sont optimisés pour maximiser le temps passé sur l’application (« engagement »). Ils exploitent la dopamine, le renforcement intermittent, et les biais cognitifs (FOMO – peur de manquer) pour créer une dépendance comportementale. Pour approfondir, consultez nos articles : Comment les algorithmes de recommandation influencent nos choix et Le doomscrolling : quand l’info devient toxique.

Le doomscrolling est l’acte compulsif de parcourir des informations négatives ou anxiogènes sans parvenir à s’arrêter. 68 % des adultes déclarent pratiquer le doomscrolling (Pew Research 2025). Ses effets : anxiété accrue, dépression, perturbation du sommeil, isolement social.

L’utilisation intensive de l’IA générative (ChatGPT pour rédiger, résumer, calculer) peut-elle atrophier nos capacités cognitives ? Pour approfondir, consultez notre article : L’utilisation exagérée d’outils d’IA altère les capacités cognitives humaines.

L’« effet Google » désigne la tendance à oublier les informations que l’on sait pouvoir retrouver facilement via un moteur de recherche. De même, le GPS a réduit notre capacité à nous orienter et à mémoriser les trajets. Avec l’IA générative, on peut craindre un « effet ChatGPT » : on ne fait plus l’effort de rédiger, de synthétiser, de calculer mentalement.

Utilisez l’IA comme assistant, pas comme substitut. Relisez, corrigez, reformulez. Apprenez les mécanismes, pas seulement les résultats. Variez les outils (ne pas tout faire avec l’IA).

L’IA générative permet de créer des deepfakes (vidéos truquées) hyper-réalistes, des articles de désinformation à grande échelle, et des campagnes de manipulation ciblées. Selon une étude du Reuters Institute (2025), 55 % des personnes interrogées se disent préoccupées par l’utilisation de l’IA pour manipuler les élections. Des entreprises comme META (Facebook) et Google ont mis en place des politiques de détection et de suppression des deepfakes, mais l’efficacité reste limitée.

L’IA optimise la publicité en ligne en analysant les données des utilisateurs (historique de navigation, centre d’intérêts, localisation) pour afficher des annonces personnalisées. Cette personnalisation peut devenir manipulation : exploitation des vulnérabilités psychologiques, publicité mensongère, dark patterns (interfaces trompeuses). Pour approfondir, consultez nos articles : Comment la loi peut protéger les consommateurs face à la publicité mensongère optimisée par l’IA et Publicité ciblée : l’agressivité alimentée par l’IA.

Le Digital Services Act (DSA, 2024) interdit les dark patterns et impose aux grandes plateformes de fournir un registre public des publicités. L’IA Act interdit l’exploitation des vulnérabilités pour altérer le comportement. La DGCCRF en France peut sanctionner les pratiques trompeuses.

La reconnaissance faciale, l’analyse prédictive, la vidéosurveillance algorithmique, et les systèmes de notation sociale (crédit social chinois) transforment l’espace public en un espace de surveillance continu. Pour approfondir, consultez notre article : Technologie de surveillance par l’IA : une puissance entre les mains des gouvernements.

Les taux d’erreur sont plus élevés pour les femmes et les personnes à peau foncée (biais raciaux). Des villes comme San Francisco, Boston, et plusieurs communes françaises ont interdit son usage par les autorités. L’AI Act européen interdit la reconnaissance faciale en temps réel dans l’espace public, sauf exceptions très limitées (menace terroriste, recherche de victimes).

Le Social Credit System (SES) évalue les citoyens sur leur comportement : respect des lois, ponctualité des paiements, comportement en ligne, participation à des manifestations. Un score bas entraîne des sanctions concrètes (interdiction de prendre l’avion ou le train, refus de prêt bancaire). L’AI Act interdit la notation sociale par les gouvernements.

Des algorithmes prédisent les zones à risque de criminalité. Expérimenté à Los Angeles, Chicago. Risques : effet de prophétie autoréalisatrice (surveillance accrue dans certains quartiers → plus d’infractions détectées → plus de prédictions pour ces quartiers). Problèmes de biais raciaux.

Face aux risques, les régulateurs réagissent. L’AI Act européen (adopté en 2024, applicable progressivement 2025-2027) est le premier cadre réglementaire mondial sur l’IA. Pour approfondir, consultez nos articles : Régulation de l’IA : une nécessité pour la protection des droits humains et L’IA et les questions éthiques : un débat essentiel.

Amendes pouvant atteindre 15 M€ ou 3 % du CA mondial (7 % pour les infractions les plus graves – catégorie inacceptable).

Le DSA impose aux très grandes plateformes (Facebook, TikTok, YouTube) des obligations de modération des contenus, de transparence des algorithmes, et de retrait des contenus illicites. Le DMA vise à limiter les pratiques anticoncurrentielles des géants du numérique (Google, Apple, Meta, Amazon).

Un biais algorithmique est une erreur systématique qui produit des résultats injustes ou discriminatoires. Il survient lorsque les données d’entraînement reflètent des discriminations historiques ou lorsque les concepteurs introduisent des hypothèses non vérifiées.

Oui. Si une IA générative traite des données personnelles (non, si vous ne lui donnez pas vos données), le RGPD s’applique. Ne donnez jamais de données personnelles à ChatGPT en version gratuite (utilisées pour entraînement).

Les deepfakes ne sont pas interdits en soi, mais leur utilisation à des fins malveillantes (escroquerie, diffamation) est illégale. Le DSA impose aux plateformes de supprimer les deepfakes trompeurs. L’AI Act impose un marquage (watermark) des contenus générés par IA.

Les emplois de saisie de données, standardiste, traduction technique, préparateur de commandes, téléconseiller de premier niveau sont les plus exposés. Les métiers relationnels, manuels complexes, et créatifs haut niveau résistent mieux. L’IA transforme plus qu’elle ne supprime.

Oui, l’AI Act est un règlement européen, directement applicable dans tous les États membres. Les entreprises françaises doivent s’y conformer.