Vous avez déjà vu une publicité pour un produit miracle qui disparaît des cernes en 3 jours, pour une cryptomonnaie promettant 500 % de rendement, ou pour un complément alimentaire aux vertus exagérées. Ces publicités, parfois trompeuses, ne sont pas nouvelles. Mais ce qui change avec l’intelligence artificielle, c’est leur capacité à être hyper-ciblées, personnalisées, optimisées en temps réel, et diffusées à grande échelle sur les réseaux sociaux et les plateformes programmatiques. L’IA permet aux annonceurs malveillants d’exploiter les vulnérabilités psychologiques des consommateurs, de contourner les filtres, et de s’adapter aux réactions du public. Face à ces nouvelles formes de manipulation, la loi peut-elle encore protéger les consommateurs ? Quels sont les textes existants (RGPD, DSA, IA Act, directive sur les pratiques commerciales déloyales) et comment évoluent-ils ? Cet article explore les défis juridiques de la publicité algorithmique et les pistes pour une régulation efficace.

La publicité mensongère — ou publicité trompeuse — est une pratique commerciale interdite consistant à présenter un produit ou un service de manière fausse, exagérée ou de nature à induire en erreur le consommateur sur ses caractéristiques essentielles (prix, qualité, composition, performance, disponibilité, etc.). L’optimisation par l’IA ajoute une couche supplémentaire de sophistication et d’efficacité à cette tromperie.

Concrètement, les algorithmes d’IA (machine learning, programmatique) permettent :

Une entreprise vend un complément alimentaire sans efficacité prouvée. Elle utilise l’IA pour cibler les personnes ayant recherché « perte de poids rapide » ou « brûleur de graisse ». L’algorithme génère des centaines de variantes de publicités, avec des témoignages faux, des photos avant/après truquées, et des offres limitées dans le temps. Les plateformes sociales sont inondées, et les consommateurs vulnérables dépensent des centaines d’euros pour un produit inutile.

Infographie n°1 – Comment l’IA amplifie la publicité mensongère : micro-ciblage, personnalisation dynamique, contournement des filtres, déploiement massif.

La publicité trompeuse assistée par l’IA n’est pas un phénomène marginal. Les chiffres récents montrent son ampleur et sa croissance rapide.

Selon la DGCCRF (Direction générale de la concurrence, de la consommation et de la répression des fraudes), les signalements pour publicité trompeuse en ligne ont augmenté de 47 % entre 2024 et 2025, avec un préjudice annuel estimé à plus de 1,2 milliard d’euros pour les consommateurs français. Les secteurs les plus touchés sont : les compléments alimentaires et cosmétiques (28 %), les formations et coaching en ligne (22 %), les cryptomonnaies et investissements (18 %), et les abonnements cachés (15 %).

Une étude d’Adalytics (2025) a analysé 10 000 campagnes publicitaires programmatiques : 34 % contenaient des éléments potentiellement trompeurs (fausses promotions, comptes à rebours factices, allégations non prouvées). Les plateformes les plus concernées sont Meta (Facebook, Instagram), TikTok et Google Display Network.

Les publicitaires malveillants disposent d’un arsenal de techniques, amplifiées par l’IA, pour tromper les consommateurs.

Les dark patterns sont des interfaces conçues pour pousser l’utilisateur à faire des choix qu’il n’aurait pas faits en pleine conscience. Exemples : bouton de désabonnement caché, case à cocher pré-cochée pour un abonnement, faux comptes à rebours (« plus que 2 minutes pour profiter de cette offre »). L’IA permet de tester des milliers de variantes de dark patterns pour identifier ceux qui convertissent le mieux.

L’IA analyse l’historique de navigation, les centres d’intérêt, les interactions sociales, et même les données biométriques (quand disponibles) pour identifier les moments de vulnérabilité (ex. personnes ayant récemment vécu un divorce, un deuil, une perte d’emploi). Les publicités sont alors personnalisées pour exploiter ces émotions.

Des influenceurs entièrement générés par IA (comme Lil Miquela, Aitana Lopez, ou les avatars de marque) promeuvent des produits sans que le consommateur sache qu’il ne s’agit pas d’un humain. Ces influenceurs virtuels peuvent être programmés pour donner des témoignages positifs, répondre aux commentaires, et créer une illusion d’authenticité. En 2026, le marché des influenceurs virtuels dépasse 10 milliards de dollars, et une proportion croissante de leurs promotions est trompeuse (produits non testés, allégations fausses).

Infographie n°2 – Dark patterns, micro-ciblage, influenceurs virtuels : les nouvelles armes de la publicité trompeuse.

Les conséquences de ces pratiques sont multiples et peuvent être graves.

Le consommateur dépense de l’argent pour un produit ou un service qui ne correspond pas à ses attentes, voire qui est dangereux (compléments alimentaires non conformes, faux médicaments, crypto-arnaques). Les sommes en jeu peuvent être modestes (quelques dizaines d’euros) mais se cumulent sur des millions de consommateurs. Les cas de pertes importantes (plusieurs milliers d’euros) sont également fréquents dans les arnaques aux placements financiers ou aux formations professionnelles.

La manipulation algorithmique prive le consommateur de sa capacité à faire un choix éclairé. Il n’achète pas parce que le produit est bon, mais parce qu’il a été psychologiquement manipulé. Cette atteinte à l’autonomie est particulièrement problématique pour les populations vulnérables (personnes âgées, isolées, en situation de fragilité financière ou psychologique).

À force d’être exposé à des publicités trompeuses, le consommateur perd confiance dans les plateformes, les influenceurs, et le commerce en ligne en général. Cette défiance profite aux arnaqueurs (les consommateurs deviennent plus méfiants, mais aussi plus difficiles à toucher pour les entreprises honnêtes).

De nombreuses plateformes de réservation affichent des messages comme « Plus que 2 chambres disponibles à ce prix » ou « 15 personnes consultent cette offre ». Ces comptes à rebours sont souvent faux ou artificiellement créés par l’IA pour pousser à une décision rapide. La DGCCRF a condamné Booking à une amende de 3 millions d’euros en 2024 pour pratiques commerciales trompeuses.

Plusieurs textes européens et nationaux encadrent déjà la publicité en ligne et peuvent être mobilisés contre les dérives de l’IA.

Cette directive interdit les « pratiques commerciales trompeuses » et les « pratiques commerciales agressives ». Sa révision de 2025 (adoptée sous pression des associations de consommateurs) a ajouté des dispositions spécifiques sur : l’utilisation d’algorithmes pour manipuler les consommateurs (dark patterns interdits), l’obligation d’informer le consommateur lorsqu’il interagit avec une IA (chatbot, influenceur virtuel), et l’interdiction du micro-ciblage basé sur les vulnérabilités.

Le RGPD encadre la collecte et l’utilisation des données personnelles à des fins publicitaires. Il impose : un consentement explicite pour le ciblage comportemental, un droit d’accès (savoir quelles données sont utilisées), un droit d’opposition (se désinscrire du ciblage). En 2025, l’EDPB (Comité européen de la protection des données) a précisé que les dark patterns violant le consentement éclairé sont interdits.

Le DSA impose aux très grandes plateformes (Facebook, TikTok, YouTube, etc.) des obligations de transparence sur leurs systèmes de recommandation publicitaire. Elles doivent : publier des rapports sur les contenus publicitaires trompeurs, permettre aux utilisateurs de signaler facilement les publicités suspectes, et coopérer avec les autorités nationales (DGCCRF en France). Le DSA prévoit des amendes pouvant aller jusqu’à 6 % du chiffre d’affaires mondial.

En France, le Code de la consommation interdit les pratiques commerciales trompeuses (article L121-2 et suivants). La DGCCRF peut enquêter, infliger des amendes (jusqu’à 10 % du chiffre d’affaires pour les pratiques les plus graves), et ordonner la cessation de la publicité. En 2025, la DGCCRF a mené 380 enquêtes sur la publicité en ligne, avec 120 sanctions prononcées.

Le règlement européen sur l’intelligence artificielle (IA Act, applicable depuis 2025) classe certains usages publicitaires comme « à haut risque » ou « inacceptables ».

L’IA Act interdit les systèmes d’IA qui exploitent les vulnérabilités des personnes (âge, handicap, situation sociale ou économique) pour altérer leur comportement de manière susceptible de leur causer un préjudice. C’est le cas du micro-ciblage publicitaire exploitant les fragilités psychologiques. Les plateformes qui utilisent ces techniques s’exposent à des amendes de 15 millions d’euros ou 3 % du CA mondial.

Les systèmes de recommandation à grande échelle (ceux des très grandes plateformes) sont classés comme « à haut risque » lorsqu’ils sont utilisés pour le profilage des consommateurs à des fins publicitaires. Ils doivent alors respecter des obligations : transparence (explicabilité des décisions), supervision humaine, audit régulier, et enregistrement dans une base de données européenne.

L’IA Act interdit la notation sociale par les gouvernements, mais aussi par les entreprises privées pour discriminer les consommateurs (ex. attribuer un score de « fiabilité » pour moduler l’accès aux crédits ou aux assurances). Cette disposition vise indirectement certaines pratiques publicitaires trompeuses qui utilisent le profilage discriminatoire.

L’IA générative permet de créer des deepfakes publicitaires extrêmement réalistes : des vidéos d’influenceurs (ou de célébrités) qui n’ont jamais existé, ou des voix clonées de personnalités pour promouvoir des produits.

Les influenceurs virtuels (Lil Miquela, Aitana Lopez, etc.) posent une question juridique inédite : qui est responsable quand un avatar IA promeut un produit dangereux ou fait une allégation fausse ? L’influenceur virtuel n’a pas de personnalité juridique. Les créateurs de l’avatar et les marques qui le rémunèrent sont responsables, mais la traçabilité est parfois difficile. Le DSA impose désormais que toute publicité diffusée par un influenceur virtuel soit clairement identifiée comme « générée par IA ».

Des entreprises malveillantes clonent la voix d’un médecin réputé, d’une célébrité, ou d’un « expert » fictif pour créer des témoignages publicitaires falsifiés (ex. « ce complément alimentaire a été recommandé par le Dr X »). La loi française (loi sur la manipulation de l’information) et le DSA commencent à encadrer ces pratiques, mais la détection technique reste difficile.

Depuis 2025, toute publicité générée ou modifiée par IA (image, vidéo, audio) doit être clairement identifiée comme telle. Les plateformes doivent mettre en place des systèmes de signalement et de retrait rapide. Le non-respect expose à des amendes pouvant atteindre 6 % du chiffre d’affaires mondial.

L’un des principaux défis pour les consommateurs victimes de publicité trompeuse par IA est la preuve. Comment démontrer qu’une publicité était trompeuse si elle a été diffusée de manière éphémère, personnalisée, et sans laisser de trace ?

Une publicité ciblée par IA peut n’être montrée qu’à quelques centaines de personnes, pendant quelques heures, puis disparaître. Le consommateur qui veut porter plainte doit avoir conservé une capture d’écran, preuve souvent difficile à rapporter a posteriori.

Face à ces difficultés, les associations de consommateurs (UFC-Que Choisir, CLCV, Foodwatch) jouent un rôle clé. Elles peuvent mener des enquêtes, collecter des témoignages, et engager des actions collectives (class actions) au nom de l’ensemble des consommateurs lésés. En France, la loi Hamon (2014) et la loi Justice du XXIe siècle (2016) ont introduit l’action de groupe, encore peu utilisée mais qui se développe.

Paradoxalement, l’IA peut aussi aider à la preuve. Des outils de « web scraping » et d’analyse algorithmique permettent de détecter des campagnes publicitaires trompeuses à grande échelle, d’identifier leurs schémas, et de rassembler des preuves. Les autorités (DGCCRF, FTC) commencent à utiliser ces outils.

Face à l’évolution rapide des techniques, plusieurs pistes d’amélioration sont discutées.

La DGCCRF et ses homologues européennes manquent de moyens face à la masse des publicités programmatiques. Un investissement dans des équipes spécialisées (data scientists, juristes du numérique) et des outils d’investigation algorithmique est nécessaire.

Sur le modèle de la « Meta Ad Library », toutes les plateformes devraient maintenir un registre public des publicités ciblées, accessible aux chercheurs et aux associations, avec les critères de ciblage et les performances. Le DSA l’impose déjà pour les très grandes plateformes, mais son application reste perfectible.

Le ciblage basé sur les données de santé, les opinions politiques, la religion, l’orientation sexuelle, ou les vulnérabilités psychologiques devrait être interdit, sauf consentement explicite et démonstration de l’absence de caractère trompeur. L’IA Act interdit déjà l’exploitation des vulnérabilités, mais la définition est floue.

Les amendes actuelles (quelques millions d’euros) sont insuffisantes face aux gains potentiels des campagnes trompeuses. Le DSA (6 % du CA mondial) et le Code de la consommation (10 % du CA) prévoient des plafonds élevés, mais ils sont rarement appliqués à ce niveau. Une application plus ferme est nécessaire.

Face à une publicité suspecte : 1) Méfiez-vous des offres trop belles (miracle, rendement exceptionnel). 2) Vérifiez l’identité de l’annonceur (site officiel, mentions légales). 3) Recherchez des avis indépendants (pas seulement les témoignages du site). 4) Signalez la publicité à la plateforme (bouton « signaler ») et à la DGCCFR (site SignalConso). 5) Conservez une capture d’écran pour la preuve.

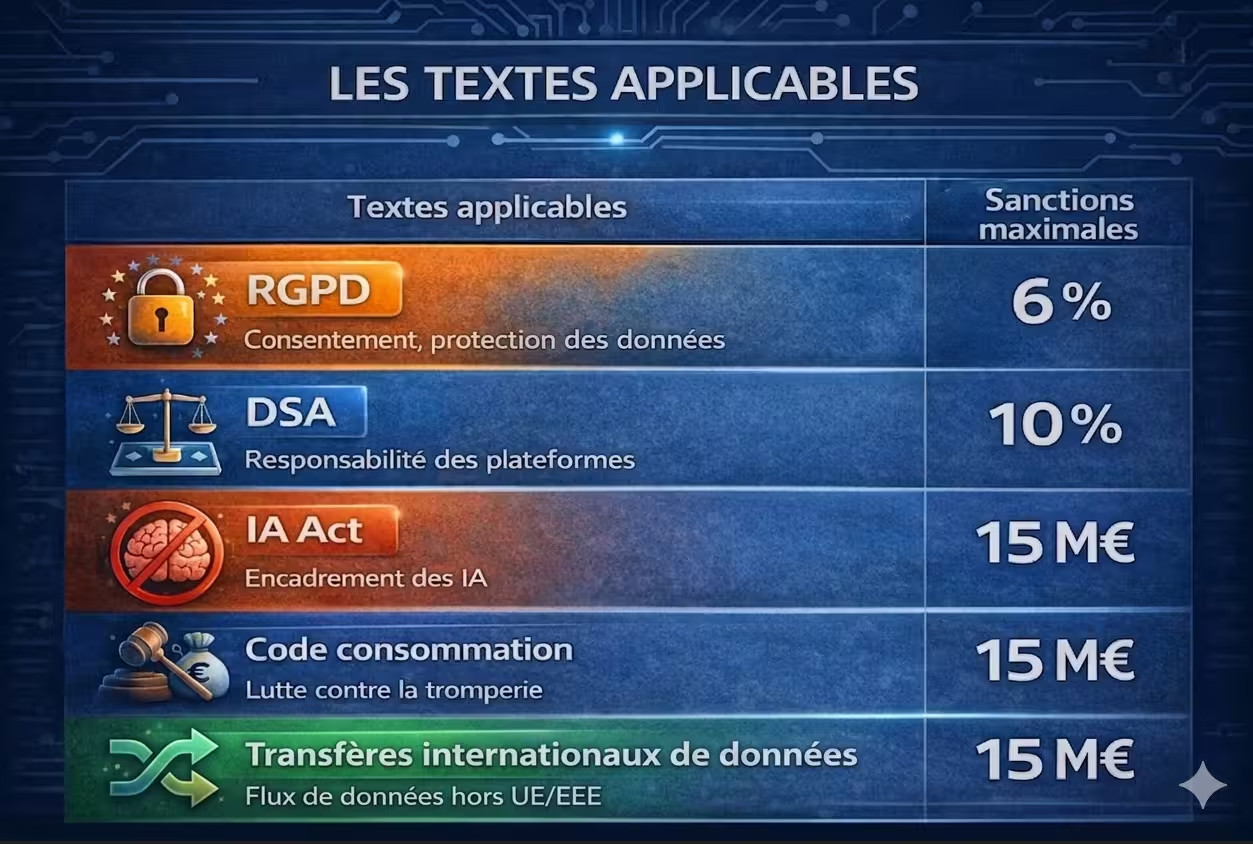

Infographie n°3 – Les textes applicables : RGPD, DSA, IA Act, Code de la consommation. Sanctions et obligations.

Plusieurs actions : 1) Signalez la publicité à Meta via le bouton « … » en haut à droite de l’annonce. 2) Conservez une capture d’écran. 3) Signalez sur SignalConso (site de la DGCCRF). 4) Si vous avez acheté un produit, contactez votre banque pour une opposition de paiement (droit de rétractation). 5) En cas de préjudice important, consultez une association de consommateurs (UFC-Que Choisir, CLCV) ou un avocat. Les plateformes sont légalement responsables du contenu publicitaire qu’elles hébergent (DSA).

Oui, les influenceurs virtuels sont légaux, mais leurs promotions doivent respecter les mêmes règles que les influenceurs humains : transparence (indiquer qu’il s’agit d’un avatar IA), honnêteté (ne pas faire d’allégations fausses), et respect du droit des consommateurs. Depuis le DSA (2024), toute publicité diffusée par un influenceur virtuel doit être étiquetée « générée par IA » ou « avatar virtuel ». Les créateurs de l’avatar sont responsables des contenus trompeurs.

Les amendes varient selon le texte applicable : DSA (6 % du chiffre d’affaires mondial de la plateforme), IA Act (15 millions d’euros ou 3 % du CA mondial), Code de la consommation français (10 % du CA). En pratique, les amendes prononcées sont souvent plus faibles (quelques centaines de milliers à quelques millions d’euros), mais la tendance est à la hausse. En 2025, une société de compléments alimentaires a été condamnée à 2,5 millions d’euros par la DGCCRF pour publicité trompeuse sur TikTok.

Non, le ciblage publicitaire par IA est légal lorsqu’il respecte le RGPD (consentement, transparence) et qu’il n’est pas trompeur. Ce qui est interdit, c’est le micro-ciblage qui exploite les vulnérabilités des personnes (âge, handicap, fragilité psychologique) pour les manipuler (IA Act, article 5). Le ciblage basé sur les données sensibles (santé, politique, religion) est également interdit sans consentement explicite.

Les autorités (DGCCRF, FTC) utilisent des outils de « web scraping » et d’analyse algorithmique. Des programmes parcourent automatiquement les plateformes à la recherche de mots-clés suspects (« miracle », « 100 % naturel », « remboursement garanti »), de dark patterns (faux comptes à rebours), ou de contenus générés par IA non étiquetés. Ils croisent ensuite avec des bases de données de signalements consommateurs (SignalConso) pour prioriser les enquêtes. C’est une « IA contre IA ».

Oui, depuis la loi Hamon (2014) et la loi Justice du XXIe siècle (2016), l’action de groupe (class action) existe en droit français. Une association de consommateurs agréée peut intenter une action au nom de l’ensemble des consommateurs victimes d’une même pratique trompeuse. Les dommages et intérêts sont ensuite répartis entre les victimes. Cette procédure est encore peu utilisée pour la publicité en ligne, mais plusieurs actions sont en préparation.