L’intégration de l’intelligence artificielle dans les dispositifs de surveillance redéfinit l’équilibre entre sécurité nationale et libertés individuelles. Des caméras de rue capables de reconnaître un visage parmi des millions, des algorithmes qui prédisent les comportements criminels, des systèmes de notation sociale qui évaluent la « fiabilité » des citoyens : ces technologies ne relèvent plus de la science-fiction. Entre efficacité opérationnelle et risques de dérives autoritaires, cet article analyse un outil à double tranchant devenu incontournable dans les politiques sécuritaires mondiales.

La surveillance par l’IA désigne l’ensemble des systèmes automatisés qui collectent, analysent et interprètent des données comportementales, biométriques ou environnementales dans le but de surveiller, contrôler ou prédire les actions d’individus ou de groupes. Contrairement aux systèmes de vidéosurveillance traditionnels (CCTV), qui nécessitent une intervention humaine pour analyser les flux, la surveillance par l’IA repose sur l’automatisation et l’apprentissage statistique.

Trois grandes technologies structurent ce domaine :

Selon IDC (2026), le marché mondial de la surveillance par IA a atteint 45 milliards de dollars en 2025, avec une croissance annuelle de 18 %. Les principaux fournisseurs sont chinois (Hikvision, Dahua) et américains (Microsoft, Amazon, Palantir).

Infographie n°1 – Les trois technologies clés de la surveillance par IA : reconnaissance biométrique, analyse Big Data, algorithmes prédictifs.

La surveillance basée sur l’IA trouve ses racines dans le renforcement des mesures de sécurité consécutives aux attentats du 11 septembre 2001. La priorité donnée à la « sécurité nationale » aux États-Unis, puis dans d’autres pays occidentaux, a ouvert la voie à des investissements massifs dans l’analyse automatisée des communications (programme PRISM de la NSA, révélé par Edward Snowden en 2013) et des comportements.

L’accélération technologique des années 2010, marquée par l’explosion du Deep Learning (réseaux de neurones profonds), a permis de passer d’une surveillance passive (enregistrement pour consultation a posteriori) à une surveillance proactive (analyse en temps réel avec alertes automatiques). Aujourd’hui, la capacité de traitement des GPU modernes permet d’analyser des millions de flux vidéo en temps réel avec une précision chirurgicale. Les systèmes de reconnaissance faciale atteignent des taux de précision supérieurs à 99 % dans des conditions contrôlées, rendant l’anonymat dans l’espace public de plus en plus illusoire.

La pandémie de COVID-19 a agi comme un accélérateur brutal : de nombreux gouvernements ont déployé des systèmes de surveillance épidémiologique (traçage des contacts, analyse des flux de population) qui ont ensuite été reconvertis ou maintenus pour d’autres usages sécuritaires. Ce « glissement fonctionnel » (function creep) est l’un des principaux risques de la surveillance numérique.

Les gouvernements justifient le déploiement de ces technologies par quatre arguments principaux, qui forment les piliers de leur stratégie sécuritaire.

L’argument premier reste la prévention des menaces graves. L’IA excelle à détecter des anomalies dans des foules denses (comportement suspect, colis abandonné) ou à identifier des individus recherchés en quelques millisecondes parmi des millions de passants. Dans les aéroports, les gares et les stades, ces systèmes sont devenus monnaie courante. Après les attentats de Nice (2016) et de Bruxelles (2016), les investissements européens ont bondi.

Les « villes intelligentes » (smart cities) utilisent l’IA pour réguler le trafic, détecter les accidents, optimiser les mouvements de foule lors de grands événements, ou encore gérer l’éclairage public. Ces applications, perçues comme neutres ou bénéfiques par les citoyens, créent une infrastructure de surveillance massive qui peut ensuite être détournée pour des usages sécuritaires.

Dans certains régimes (Chine, Russie, Biélorussie, Iran), l’outil sert explicitement à surveiller la dissidence. La capacité d’identifier les leaders de mouvements sociaux (grâce à la reconnaissance faciale lors de manifestations), de restreindre l’accès à certains services (transports, banques) pour les opposants, ou de créer des « listes noires » devient un instrument de pouvoir redoutable.

La baisse spectaculaire des coûts des capteurs (caméras 4K à moins de 50 euros) et la démocratisation des frameworks d’IA open source (TensorFlow, PyTorch) rendent ces solutions accessibles non seulement aux superpuissances, mais aussi aux nations en développement et aux polices locales. Un système de reconnaissance faciale complet pour une ville moyenne coûte désormais moins de 500 000 euros.

Infographie n°2 – Reconnaissance faciale, biométrie comportementale, analyse prédictive : comment fonctionnent ces technologies.

La technologie la plus médiatisée. Un algorithme compare le visage d’un individu (capturé par une caméra) à une base de données (fichier des personnes recherchées, base de données des permis de conduire, réseau social). Les systèmes modernes (SenseTime, Hikvision, Clearview AI) atteignent une précision supérieure à 99,5 % dans des conditions idéales (visage face à la caméra, bonne luminosité). Mais la précision chute considérablement pour les femmes, les personnes âgées, et les personnes à peau foncée (biais raciaux).

Au-delà du visage, l’IA analyse la manière de marcher (gait analysis), la posture, les gestes, et même les micro-expressions faciales (pour détecter le stress ou la malhonnêteté). Ces technologies, encore expérimentales, sont utilisées dans certains aéroports (détection de « comportements suspects ») et dans le marketing (analyse des émotions des clients en magasin). Leur fiabilité scientifique est très contestée.

Des algorithmes analysent l’historique des crimes, les données météorologiques, les événements locaux, et parfois les données de réseaux sociaux pour prédire où et quand un crime est susceptible de se produire. Les patrouilles de police sont alors redirigées vers ces zones. Expérimenté à Los Angeles (PredPol) et Chicago, ce type d’outil est controversé : il peut créer un « effet de prophétie autoréalisatrice » (surveillance accrue dans certains quartiers → plus de crimes détectés → plus de prédictions pour ces quartiers), et il se base souvent sur des données historiques biaisées (sur-policage des minorités).

L’efficacité opérationnelle de ces outils s’accompagne d’effets secondaires critiques pour le corps social et les libertés individuelles.

De nombreuses études (MIT Media Lab, 2018 ; NIST, 2024) démontrent que les algorithmes de reconnaissance faciale présentent des taux d’erreur plus élevés pour les femmes et les personnes à peau foncée (jusqu’à 10 fois plus d’erreurs que pour les hommes blancs). Cela peut conduire à des arrestations injustifiées, comme le montrent plusieurs cas documentés aux États-Unis (ex. Robert Williams, arrêté en 2020 à Détroit sur la base d’une fausse correspondance faciale).

La conscience d’être observé en permanence modifie le comportement des citoyens, même en l’absence de toute intention illicite. Les études en psychologie sociale montrent que les individus sous surveillance se montrent moins spontanés, moins créatifs, et moins enclins à exprimer des opinions dissidentes. Cet « effet dissuasif » est particulièrement problématique pour la démocratie : les citoyens peuvent hésiter à manifester, à signer une pétition, ou même à critiquer le gouvernement en ligne, par peur de représailles.

Le manque de transparence sur la manière dont les données sont collectées, stockées, traitées et partagées empêche tout contrôle démocratique réel. Les citoyens ne savent pas quels algorithmes sont utilisés, quels critères président à leur décision, ni comment contester une décision automatisée (ex. inscription sur une liste noire). Le secret des affaires (ou le secret défense) est souvent invoqué pour justifier cette opacité.

Un système déployé pour une finalité légitime (ex. traçage des contacts COVID) peut être progressivement reconverti pour d’autres usages (ex. surveillance politique). C’est le « glissement fonctionnel ». Les citoyens qui ont accepté la surveillance pour une raison précise se retrouvent surveillés en permanence sans nouveau consentement.

Selon une étude du NIST (National Institute of Standards and Technology, 2025), les taux de faux positifs (personne identifiée à tort) varient de 0,1 % pour les hommes blancs à 1,2 % pour les femmes noires — soit 12 fois plus d’erreurs. Appliqué à une base de données de 10 millions de personnes, cela représente des milliers d’arrestations injustifiées potentielles.

Les approches varient considérablement selon les régimes politiques et les traditions juridiques. Voici un tableau comparatif actualisé en 2026.

| Zone géographique | Technologies dominantes | Objectifs principaux | Contexte réglementaire |

|---|---|---|---|

| Chine | Reconnaissance faciale généralisée (50 millions de caméras), crédit social (SES), surveillance des minorités (Xinjiang). | Maintien de l’ordre, contrôle social, suivi des dissidents, notation comportementale. | Très permissif. L’État justifie par la sécurité nationale. Peu de recours pour les citoyens. |

| États-Unis | Analyse prédictive (PredPol), reconnaissance faciale (usage fédéral), surveillance des réseaux sociaux. | Lutte contre le crime, sécurité intérieure (CBP, FBI, DHS). | Hétérogène : moratoires locaux (San Francisco, Boston) mais usage fédéral étendu. Pas de loi fédérale globale. |

| Union européenne | Vidéoprotection intelligente (expérimentale), reconnaissance faciale très encadrée. | Sécurité urbaine, grands événements (JO, Coupe du monde), lutte contre le terrorisme. | Très strict. IA Act (2025) interdit la notation sociale et la reconnaissance faciale en temps réel dans l’espace public (sauf exceptions). RGPD impose transparence. |

| Royaume-Uni (post-Brexit) | Reconnaissance faciale en temps réel (expérimentations à Londres, Cardiff), vidéosurveillance massive. | Lutte contre la criminalité, maintien de l’ordre lors des manifestations. 领域中 | Cadre en évolution. Les tribunaux britanniques ont jugé illégales certaines utilisations (Londres, 2020). Nouvelles lois en préparation. |

| Russie | Reconnaissance faciale en temps réel (système « Orlan » à Moscou, 200 000 caméras). | Répression des manifestations, contrôle de la dissidence, surveillance des opposants. | Usage politique assumé. Cadre légal très permissif pour l’État (loi Yarovaya). |

Tableau comparatif des approches de surveillance par IA en 2026. Les technologies et régulations évoluent rapidement.

Le Social Credit System (SES) est le dispositif le plus emblématique de la surveillance algorithmique à grande échelle. Les citoyens se voient attribuer un score (initialement entre 350 et 950) basé sur leur comportement : respect des lois, ponctualité des paiements, comportement en ligne, participation à des manifestations, etc. Un score bas entraîne des sanctions concrètes : interdiction de prendre l’avion ou le train à grande vitesse, refus de prêt bancaire, inscription sur des listes d’emploi, voire isolement social. En 2026, le système couvre plus de 1,4 milliard de personnes et s’étend à des entreprises et des administrations.

Dans la région autonome ouïghoure du Xinjiang, la Chine a déployé un système de surveillance massif : caméras de reconnaissance faciale dans chaque rue, puces GPS dans les plaques d’immatriculation, surveillance des applications mobiles, obligation de capteurs biométriques pour ouvrir un compte bancaire, et camps de « rééducation ». Selon des rapports des Nations unies (2024), plus d’un million de personnes auraient été détenues arbitrairement. Les technologies de surveillance chinoises (Hikvision, Dahua) sont exportées vers de nombreux pays, notamment en Afrique, Asie et Amérique latine.

À Hong Kong (2019-2020), les autorités ont utilisé la reconnaissance faciale pour identifier et arrêter des manifestants pro-démocratie. En France, l’usage de la reconnaissance faciale lors des manifestations (gilets jaunes, retraites) a été signalé à plusieurs reprises, bien que son utilisation en temps réel soit théoriquement interdite. Aux États-Unis, après les manifestations Black Lives Matter (2020), des rapports ont montré que le DHS et le FBI avaient utilisé la reconnaissance faciale sur des images de manifestants.

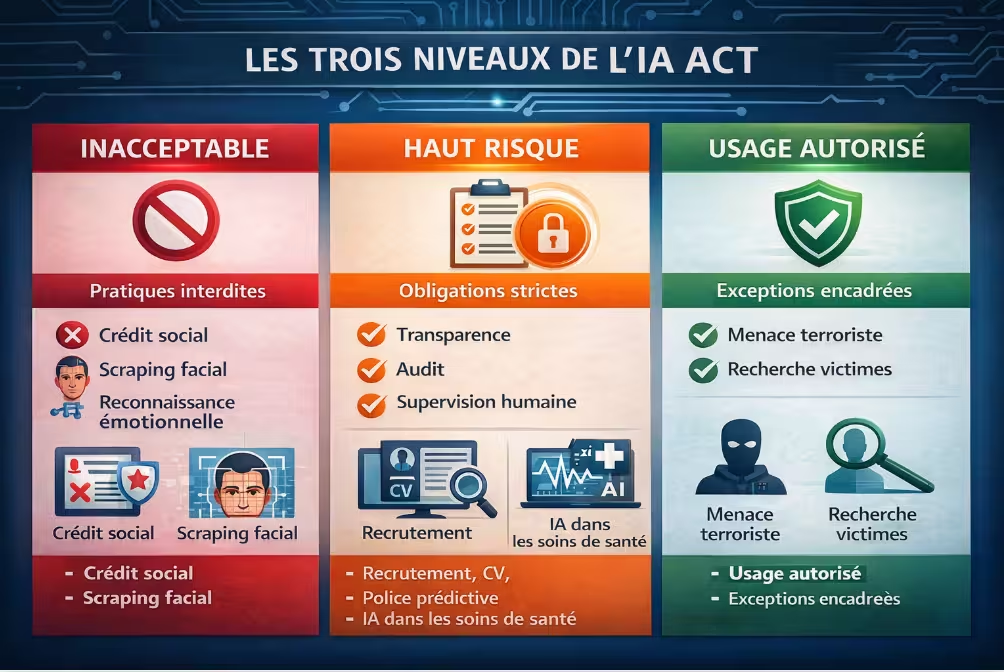

Face à ces enjeux, l’adoption de cadres légaux robustes n’est plus une option. L’entrée en vigueur de l’IA Act européen (applicable depuis 2025) marque une étape décisive.

L’IA Act ne s’applique qu’à l’Union européenne. Hors d’Europe, d’autres approches prévalent : la Chine encourage activement la surveillance massive ; les États-Unis ont une approche fragmentée (pas de loi fédérale, des moratoires locaux). De plus, l’IA Act ne couvre pas les usages militaires et de renseignement, ni la surveillance par des entreprises privées (ex. Clearview AI). Enfin, son application effective dépend des autorités nationales de contrôle (CNIL en France), dont les moyens sont parfois limités.

La CNIL (Commission nationale de l’informatique et des libertés) a publié en 2025 des recommandations spécifiques sur la vidéosurveillance algorithmique (vidéoprotection intelligente). Elle rappelle que : l’anonymisation doit être la règle (masquage des visages non suspects), les décisions automatisées sont interdites (un humain doit toujours valider une alerte), et les citoyens doivent être informés de manière claire de la présence de ces systèmes.

Face à la surveillance massive, des actions existent : 1) Informez-vous sur vos droits (CNIL, IA Act). 2) Utilisez des outils de protection (VPN, navigateurs privés, adblock). 3) Soutenez les associations de défense des libertés numériques (La Quadrature du Net, EFF, Access Now). 4) Interpellez vos élus sur l’usage de ces technologies dans votre ville. La vigilance citoyenne est un contre-pouvoir essentiel.

Infographie n°3 – L’IA Act européen : ce qui est interdit, encadré, et les sanctions encourues.

L’avenir de la surveillance par IA dépendra de l’équilibre entre avancées technologiques, pressions sécuritaires et mobilisations citoyennes.

Dans un scénario autoritaire, les technologies deviennent encore plus intrusives : reconnaissance faciale généralisée dans l’espace public, analyse prédictive des comportements (voire des pensées via les réseaux sociaux), couplage des bases de données (santé, éducation, transports, finances), et disparition de l’anonymat. La Chine montre la voie de ce scénario, qui pourrait s’étendre à d’autres pays.

Dans un scénario optimiste, les régulations (IA Act) s’étendent à d’autres régions (Amérique latine, Afrique, Asie du Sud-Est). La transparence devient la norme : les algorithmes sont audités, les citoyens ont un droit d’accès et de rectification, la surveillance est limitée dans le temps et dans l’espace. Des alternatives techniques émergent (chiffrement, anonymisation différentielle, fédération learning) pour concilier sécurité et vie privée.

Des lanceurs d’alerte (comme Edward Snowden en 2013, mais aussi des lanceurs d’alerte chinois plus récents) jouent un rôle crucial pour révéler l’ampleur réelle de la surveillance. Les associations de défense des libertés numériques (La Quadrature du Net, EFF, Amnesty International) documentent les abus, forment les citoyens, et portent les contentieux devant les tribunaux. Leur travail est essentiel pour maintenir une pression démocratique.

La reconnaissance faciale en temps réel dans l’espace public (sans consentement explicite) est théoriquement interdite en France. La CNIL l’a rappelé à plusieurs reprises. Cependant, des expérimentations encadrées existent (ex. aéroports, gares, stades) sur la base d’un arrêté préfectoral ou d’une loi spécifique (ex. JO 2024). L’IA Act européen (2025) renforce l’interdiction de principe, avec des exceptions très limitées (menace terroriste avérée). En pratique, le respect de la loi est perfectible, et des associations surveillent les dérives.

Les municipalités sont théoriquement tenues d’informer les citoyens de l’existence de tels dispositifs (affichage, site internet). Dans la pratique, cette information est souvent absente. Vous pouvez : consulter les délibérations du conseil municipal, interpeller votre maire (par courrier ou lors des réunions publiques), ou vous rapprocher d’associations locales (La Quadrature du Net, Ligue des droits de l’Homme) qui documentent ces déploiements. Certaines villes (comme Marseille, Nice) sont connues pour avoir expérimenté des systèmes de vidéoprotection intelligente.

Oui, le Social Credit System (SES) est bien réel. Lancé en 2014 sous forme d’expérimentations locales (Rongcheng, Suzhou), il a été généralisé à l’échelle nationale dans les années 2020. Le système attribue un score aux citoyens (et aux entreprises) en fonction de leur comportement. Les critères incluent le respect des lois, le remboursement des prêts, les comportements en ligne, et la participation à des activités politiques interdites. Les sanctions pour les mauvais scores sont concrètes : interdiction des transports (avion, train), exclusion de certains emplois, refus de prêts, isolement social. Le système est l’objet de critiques internationales massives.

Les études scientifiques sont très mitigées. Une méta-analyse de 2025 a montré que les systèmes de police prédictive (PredPol, HunchLab) ne réduisent pas significativement la criminalité globale. En revanche, ils présentent des risques majeurs : biais d’entraînement (les données historiques sont déjà biaisées, sur-policage des quartiers pauvres et minoritaires), effet de prophétie autoréalisatrice (surveillance accrue → plus d’arrestations → l’algorithme prédit encore plus de crimes dans ces zones), et détournement vers la surveillance politique. Plusieurs villes (Los Angeles, Chicago) ont abandonné ou suspendu ces programmes. L’IA Act européen les classe comme « haut risque ».

En Europe, l’usage par des entreprises privées est strictement encadré par le RGPD et l’IA Act. La reconnaissance faciale sans consentement explicite est interdite (ex. centre commercial qui scannerait les visages des clients). Les exceptions incluent : la sécurité dans les aéroports, les entreprises de transport, ou les stades (sur la base d’une loi ou d’un arrêté). Clearview AI, qui a scrappé des milliards de photos sur Internet sans consentement, a été condamné dans plusieurs pays (France, Italie, Royaume-Uni). Aux États-Unis, l’usage par le secteur privé est moins régulé (lois d’État variables).

En Europe, vous disposez d’un droit d’accès (RGPD) : vous pouvez demander à une organisation (publique ou privée) de vous communiquer les données qu’elle détient sur vous, et de corriger ou supprimer les données inexactes. En pratique, l’exercice est complexe (identifier l’organisation, formuler la demande, faire valoir ses droits). Des associations comme La Quadrature du Net proposent des aides et des modèles de courrier. Si vous suspectez une surveillance illégale (ex. reconnaissance faciale sans information), vous pouvez saisir la CNIL. Les recours collectifs (class actions) se développent également en Europe.