1. Panorama 2026 : une opinion publique partagée entre espoir et crainte

L’opinion publique mondiale sur l’intelligence artificielle n’est ni unanimement enthousiaste, ni systématiquement hostile. Elle est nuancée, contrastée, et évolue rapidement avec l’actualité technologique (sortie de ChatGPT, annonces de Google, régulations européennes). Les sondages récents (2025-2026) dessinent un portrait complexe.

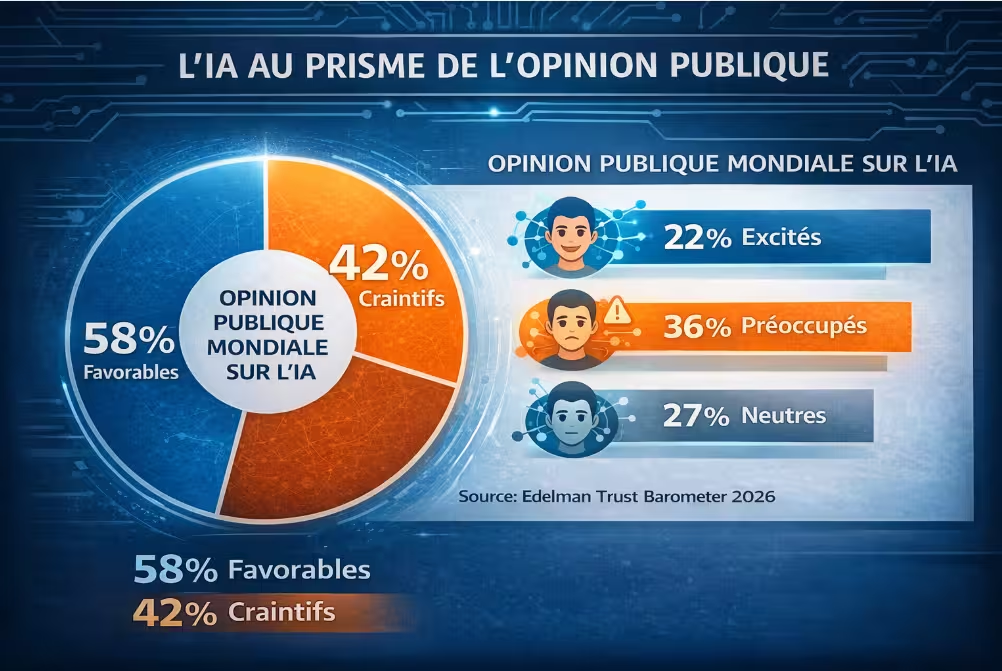

Selon le Edelman Trust Barometer 2026 (enquête dans 28 pays), 58 % des personnes interrogées estiment que l’IA aura un impact positif sur leur vie dans les 5 prochaines années, contre 42 % qui expriment des craintes. Ce chiffre est en hausse par rapport à 2022 (52 % positifs, 48 % craintifs), suggérant une lente progression de l’acceptation. Cependant, les chiffres varient considérablement selon les pays et les générations.

Pew Research Center (2025) a interrogé 10 000 Américains : 45 % se disent « aussi excités que préoccupés » par l’IA, 35 % « plus préoccupés qu’excités », et seulement 18 % « plus excités que préoccupés ». Un chiffre interpellant : 62 % pensent que l’IA aura un impact négatif sur la société américaine dans son ensemble, même si 52 % pensent qu’elle aura un impact positif sur leur vie personnelle. Ce paradoxe (l’IA pour les autres est dangereuse, pour moi elle est utile) est récurrent.

58 %

d’opinions positives sur l’IA (monde, 2026)

Edelman Trust Barometer

62 %

pensent que l’IA aura un impact négatif sur la société américaine

Pew Research, 2025

52 %

pensent qu’elle aura un impact positif sur leur vie personnelle

Pew Research, 2025

Infographie n°1 – Opinion publique mondiale sur l’IA : espoirs vs craintes (2026).

2. Confiance dans les acteurs : entreprises, gouvernements, chercheurs

Tous les acteurs de l’IA ne bénéficient pas de la même confiance. Les citoyens distinguent clairement entre les développeurs (big tech), les utilisateurs (gouvernements, entreprises privées), et les régulateurs.

Les chercheurs et universitaires : les plus dignes de confiance

Selon plusieurs sondages (YouGov 2025, IFOP 2025), les chercheurs académiques et les universités arrivent en tête de la confiance (76 % de confiance en moyenne). Leur indépendance présumée et leur mission de service public les rendent plus crédibles que les acteurs privés.

Les grandes entreprises technologiques (Google, Microsoft, OpenAI, Meta) : une confiance en baisse

Seuls 34 % des Américains font confiance aux grandes entreprises technologiques pour développer l’IA de manière responsable (Pew, 2025). En Europe, le chiffre est légèrement plus élevé (41 %), mais en baisse significative par rapport à 2020 (52 %). Les scandales de collecte de données (Cambridge Analytica, Clearview AI), les licenciements massifs et les dérives des algorithmes (biais, désinformation) ont érodé la confiance.

Les gouvernements : une confiance très variable selon les pays

En Chine, 85 % des citoyens font confiance à leur gouvernement pour réguler l’IA (sondage gouvernemental, à prendre avec précaution). Aux États-Unis, seulement 38 % font confiance au gouvernement fédéral sur ce sujet. En France, 45 % (IFOP, 2025). Les gouvernements européens bénéficient d’une confiance modérée, mais l’IA Act (perçu positivement par 58 % des Européens) redonne un peu de crédit aux institutions.

Le paradoxe de la confiance

Les citoyens font peu confiance aux grandes entreprises pour développer l’IA, mais ils utilisent massivement leurs produits (ChatGPT, Google Search, Alexa, etc.). Cette dissonance cognitive (je n’ai pas confiance mais j’utilise) est caractéristique de la relation ambivalente des consommateurs avec la technologie.

3. Les principales craintes : emploi, vie privée, manipulation

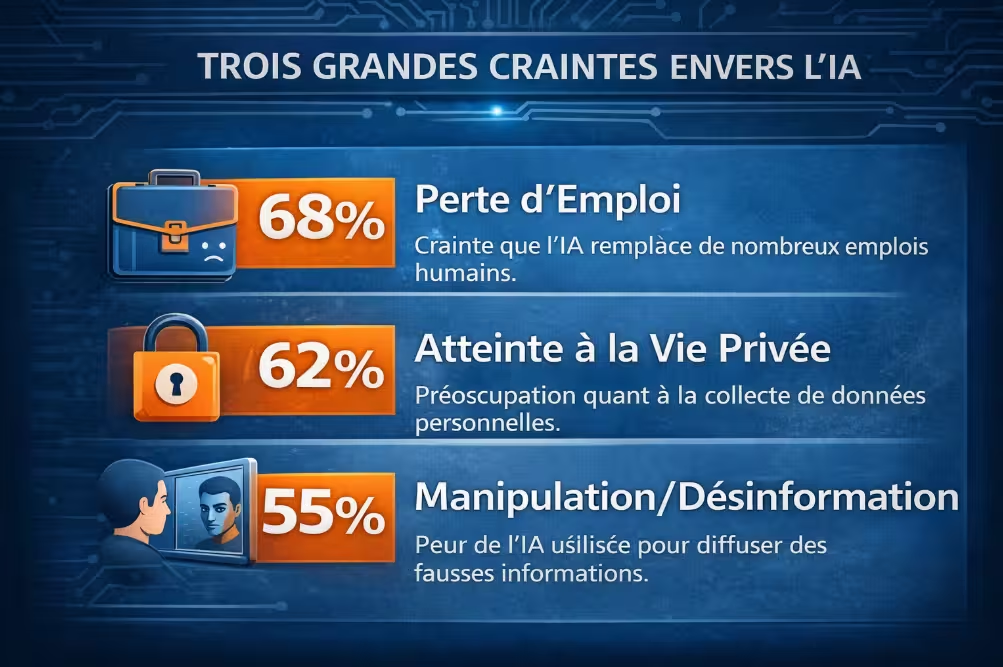

Trois grandes craintes ressortent systématiquement dans tous les sondages internationaux.

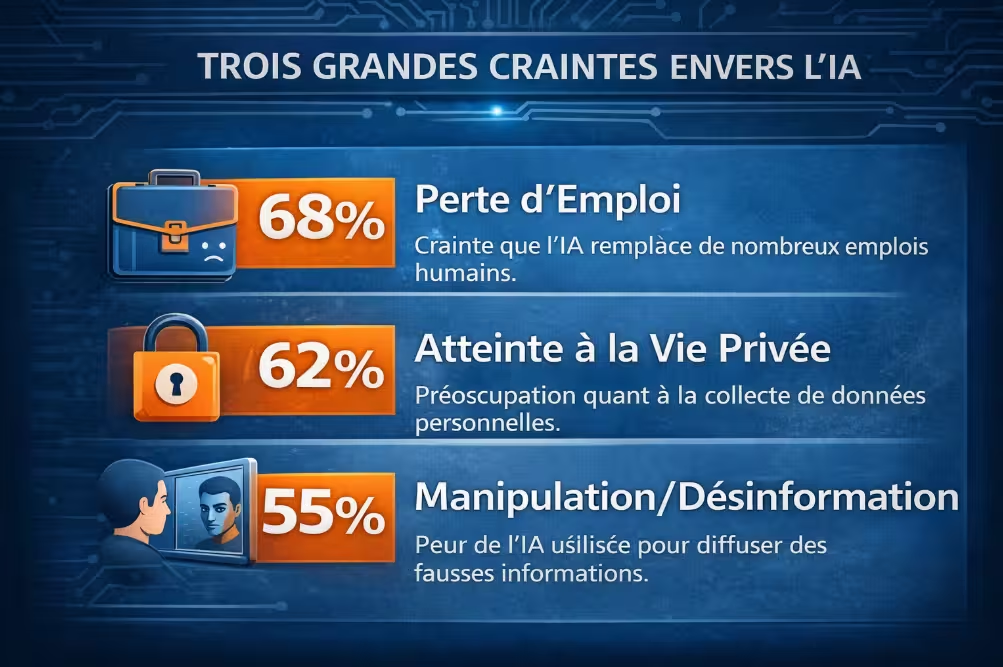

Infographie n°2 – Les trois grandes craintes : perte d’emploi (68 %), atteinte à la vie privée (62 %), manipulation et désinformation (55 %).

Perte d’emploi et automatisation (68 % des répondants inquiets – moyenne mondiale)

La crainte la plus répandue. Selon une enquête Ipsos (2025), 68 % des adultes dans 32 pays craignent que l’IA ne supprime des emplois dans leur secteur. Les pays où la crainte est la plus forte : France (78 %), Italie (76 %), Allemagne (72 %). Les pays où elle est la plus faible : Chine (48 %), Inde (52 %). Les jeunes (18-24 ans) sont paradoxalement plus inquiets que leurs aînés (ils entrent sur le marché du travail). Les cadres sont moins inquiets que les employés non qualifiés.

Atteinte à la vie privée et surveillance (62 %)

La deuxième grande crainte. Les citoyens sont de plus en plus conscients que l’IA repose sur la collecte massive de données personnelles. 62 % des Européens se disent « très inquiets » de l’utilisation de leurs données personnelles par les systèmes d’IA (Eurobaromètre, 2025). La reconnaissance faciale, la surveillance algorithmique, et le profilage commercial sont les applications les plus redoutées. Les Allemands (72 %) et les Français (68 %) sont les plus inquiets ; les Américains (52 %) et les Britanniques (48 %) le sont un peu moins.

Désinformation, deepfakes et manipulation de l’opinion (55 %)

L’IA générative (ChatGPT, Midjourney, Sora) a rendu la désinformation plus facile et plus crédible. 55 % des personnes interrogées dans le monde se disent préoccupées par les deepfakes (vidéos truquées) et leur impact sur la démocratie (sondage Reuters Institute, 2025). En France, 62 % craignent que l’IA ne soit utilisée pour manipuler les élections. Aux États-Unis, 58 % partagent cette crainte.

4. L’acceptation différenciée selon les domaines

L’acceptation de l’IA n’est pas uniforme : les citoyens acceptent beaucoup plus facilement l’IA dans la santé (diagnostic, aide à la décision) que dans la justice, l’éducation, ou la surveillance.

Santé : le domaine le plus accepté (82 % favorables)

L’IA diagnostique (radiologie, analyse d’images) et l’aide à la décision médicale bénéficient d’une large adhésion. Selon un sondage IFOP (2025), 82 % des Français accepteraient que leur médecin utilise un outil d’IA pour améliorer un diagnostic de cancer. Les patients voient l’IA comme un outil complémentaire, non comme un remplacement. L’acceptation est maximale pour les tâches techniques (analyse d’images) et minimale pour les tâches relationnelles (annonce d’un mauvais diagnostic).

Transports : véhicules autonomes (45 % favorables seulement)

L’acceptation des véhicules autonomes stagne. Selon Pew Research (2025), seulement 45 % des Américains accepteraient de monter dans une voiture autonome, contre 55 % en 2019. Les accidents médiatisés (Tesla, Uber) ont érodé la confiance. Les plus jeunes (18-29 ans) sont plus favorables (58 %) que les plus âgés (32 %).

Justice : IA prédictive et aide à la décision (38 % favorables)

L’acceptation est faible. L’utilisation d’algorithmes pour prédire la récidive ou aider à la décision de mise en liberté provisoire (comme le système COMPAS aux États-Unis) est très controversée. Seuls 38 % des Européens accepteraient qu’un algorithme aide un juge à décider d’une peine (Eurobaromètre, 2025). La crainte des biais (raciaux, sociaux) est dominante.

Recrutement : tri automatisé des CV (42 % favorables)

Les ATS (Applicant Tracking Systems) sont largement utilisés par les entreprises, mais les candidats les perçoivent négativement. Selon un sondage YouGov (2025), 42 % des demandeurs d’emploi acceptent le tri automatisé des CV, 58 % le rejettent. Les principales critiques : manque de transparence, rejet arbitraire, absence de prise en compte des parcours atypiques.

Surveillance : reconnaissance faciale dans l’espace public (28 % favorables)

Le domaine le moins accepté. Seuls 28 % des Européens accepteraient l’utilisation généralisée de la reconnaissance faciale dans les lieux publics (Eurobaromètre, 2025). En France, le chiffre est légèrement plus élevé (32 %). Aux États-Unis, 38 %. Les citoyens font une distinction claire entre surveillance ciblée (recherche d’un terroriste dans un aéroport) et surveillance généralisée (caméras dans toute la ville).

82 %

acceptation de l’IA en santé

IFOP, 2025

28 %

acceptation de la reconnaissance faciale généralisée

Eurobaromètre, 2025

45 %

acceptation des véhicules autonomes

Pew Research, 2025

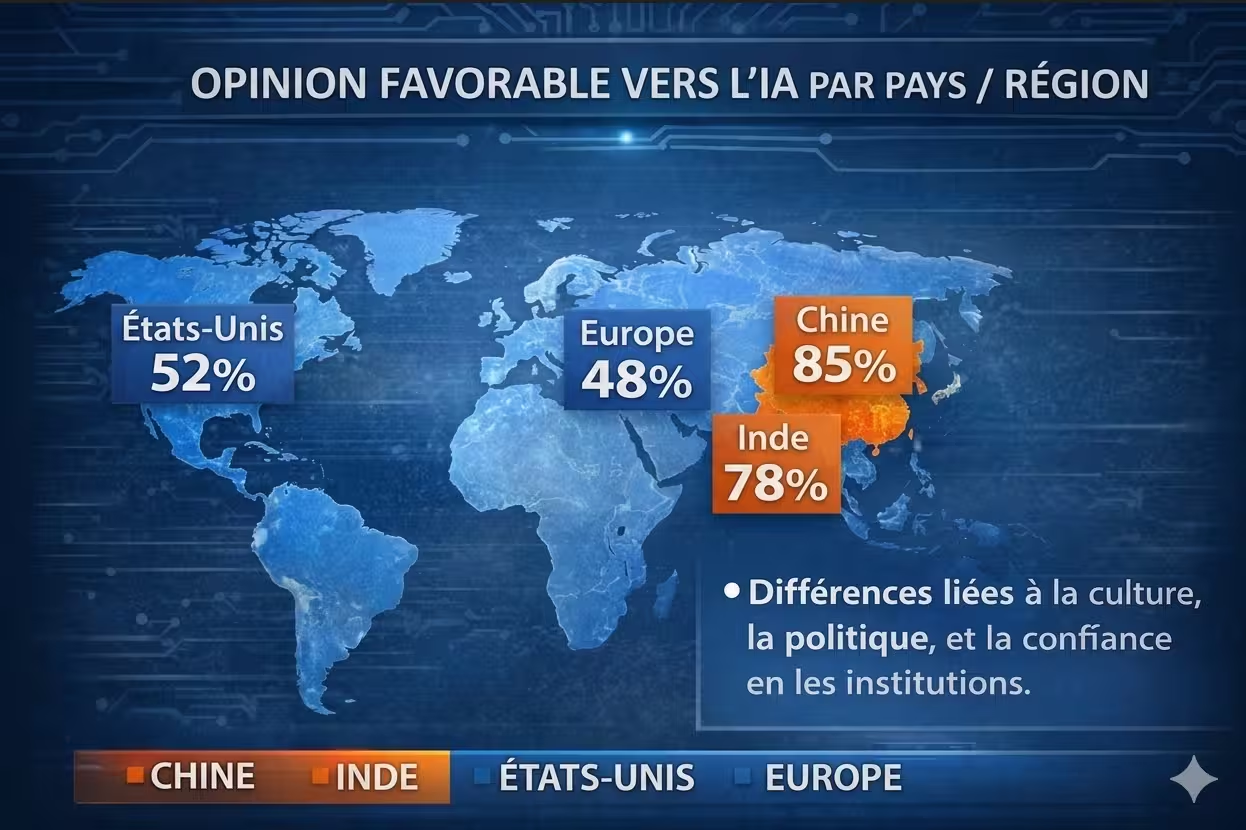

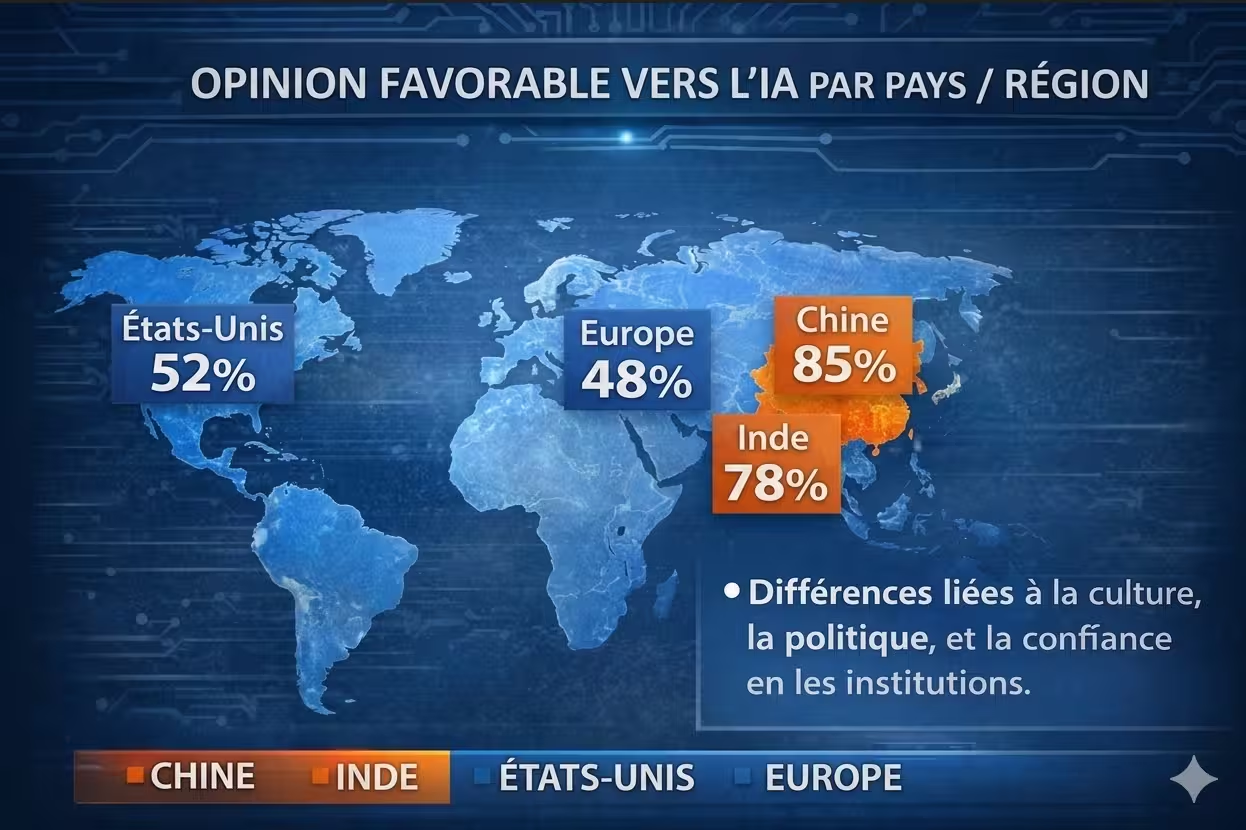

5. Comparaison internationale : Europe, États-Unis, Chine, Asie

Les perceptions de l’IA varient considérablement selon les pays, en fonction de la culture, des expériences technologiques et de la confiance dans les institutions.

Chine : la plus enthousiaste (85 % d’opinions favorables)

Selon un sondage de l’Université de Pékin (2025), 85 % des Chinois ont une opinion favorable de l’IA, et 78 % font confiance au gouvernement pour la réguler. Ce chiffre s’explique par : une politique étatique volontariste (plan « IA 2030 »), une couverture médiatique positive, et une moindre sensibilité à la vie privée (ou une acceptation de la surveillance au nom de la sécurité).

Inde : également très favorable (78 %)

L’Inde est un pays très optimiste vis-à-vis de l’IA, perçue comme un levier de développement économique et de modernisation. Selon une étude d’Ipsos (2025), 78 % des Indiens estiment que l’IA aura un impact positif sur leur vie. Le secteur technologique indien (infoservices, start-ups) promeut activement l’IA.

États-Unis : partagé (52 % favorables)

Les Américains sont plus sceptiques que les Asiatiques, mais moins inquiets que les Européens. 52 % ont une opinion favorable de l’IA, 48 % défavorable ou neutre. Les divisions politiques sont marquées : 62 % des démocrates sont favorables, contre 42 % des républicains. La Silicon Valley est très favorable, les zones rurales beaucoup moins.

Europe : la plus prudente (48 % favorables en moyenne)

Les Européens sont les plus sceptiques vis-à-vis de l’IA. Selon un Eurobaromètre (2025), seulement 48 % des Européens ont une opinion favorable de l’IA. Les pays les plus sceptiques : Allemagne (42 %), France (45 %), Autriche (43 %). Les plus favorables : Suède (58 %), Pays-Bas (56 %), Estonie (55 %). Les craintes portent sur la vie privée, l’emploi, et la manipulation politique. Le soutien à une régulation stricte (IA Act) est très élevé (78 %).

Infographie n°3 – Carte mondiale de l’opinion sur l’IA : Chine (85 % favorables), Inde (78 %), États-Unis (52 %), Europe (48 %).

6. Évolution 2018-2026 : vers une maturité de l’opinion

L’opinion publique sur l’IA n’est pas figée. Elle a évolué en fonction des annonces technologiques (ChatGPT en 2022-2023), des scandales, et des actions des régulateurs.

2018-2020 : l’enthousiasme naïf

L’IA était perçue comme une promesse lointaine. Les sondages montraient un optimisme modéré (environ 60 % favorables), mais une faible connaissance des enjeux. Les termes comme « deep learning » ou « LLM » étaient inconnus du grand public.

2021-2023 : la prise de conscience des risques

Les révélations sur les biais algorithmiques (reconnaissance faciale), la désinformation, et les deepfakes ont érodé la confiance. L’opinion favorable est passée de 60 % à environ 50 % dans les pays occidentaux. L’arrivée de ChatGPT a suscité fascination et inquiétude.

2024-2026 : la stabilisation et la maturation

L’opinion se stabilise autour de 50-55 % de favorables. Les citoyens sont mieux informés, font la distinction entre les applications, et réclament une régulation. L’IA Act européen est perçu positivement (58 % des Européens y sont favorables). Les craintes restent élevées, mais une certaine « accoutumance » (habituation) s’installe.

7. Soutien à la régulation : un large consensus

Si l’opinion sur l’IA est partagée, le soutien à une régulation stricte est, lui, très large — un point rare de consensus dans les sondages.

Europe : 78 % favorables à l’IA Act

Selon l’Eurobaromètre (2025), 78 % des Européens soutiennent l’adoption de règles strictes pour encadrer l’IA. Les mesures les plus populaires : interdiction de la notation sociale (84 %), interdiction de la reconnaissance faciale en temps réel dans l’espace public (76 %), obligation de transparence des algorithmes (82 %).

États-Unis : 72 % favorables à une régulation fédérale

Malgré les divisions politiques, 72 % des Américains estiment que le gouvernement fédéral devrait réguler l’IA (Pew, 2025). Le soutien est légèrement plus élevé chez les démocrates (82 %) que chez les républicains (62 %). Les Américains sont favorables à des règles sur la transparence (79 %), la non-discrimination (76 %), et la protection des données (81 %).

France : 81 % favorables à une régulation européenne renforcée

Selon un sondage IFOP (2025), 81 % des Français souhaitent que l’Union européenne renforce la régulation de l’IA. 72 % estiment que les entreprises technologiques ne sont pas assez contrôlées.

Un consensus inédit

Contrairement à d’autres sujets (climat, immigration, fiscalité), la régulation de l’IA bénéficie d’un large consensus transpartisan dans la plupart des pays occidentaux. Les citoyens, quels que soient leur âge, leur niveau d’éducation ou leur orientation politique, souhaitent que l’IA soit encadrée pour protéger l’emploi, la vie privée et la démocratie.

8. Biais de perception : surestimation et méconnaissance

L’opinion publique sur l’IA est souvent déformée par des biais cognitifs et un manque d’information.

La surestimation des capacités actuelles de l’IA

Beaucoup de citoyens surestiment ce que l’IA peut faire aujourd’hui. Selon une étude d’Ipsos (2025), 45 % des personnes interrogées pensent que l’IA est déjà capable d’éprouver des émotions humaines (faux, l’IA n’a pas de conscience). 38 % pensent que l’IA peut prendre des décisions morales complexes (c’est très contestable). 30 % pensent que l’IA peut remplacer un médecin généraliste (faux). Cette surestimation alimente à la fois les espoirs excessifs (l’IA va tout résoudre) et les craintes irrationnelles (l’IA va nous dominer).

La méconnaissance des mécanismes techniques

Seule une minorité de citoyens comprend ce qu’est un modèle de langage (LLM), comment fonctionne un réseau de neurones, ou ce qu’est l’apprentissage supervisé. Cette méconnaissance rend l’opinion vulnérable à la désinformation et aux discours simplistes (ex. « l’IA est une bulle marketing » ou « l’IA va prendre le pouvoir »).

L’influence des médias et des œuvres de fiction

Les films de science-fiction (Terminator, Matrix, Her) et les reportages alarmistes influencent fortement l’opinion. 25 % des Américains craignent que l’IA ne conduise à une extinction de l’humanité (Pew, 2025) — un scénario de science-fiction, pas une menace sérieuse à court terme. Les chercheurs en IA parlent de « P(doom) » (probabilité de catastrophe existentielle), mais les estimations varient de 0,1 % à 10 % — loin du fatalisme populaire.

9. Perspectives : l’opinion publique façonnera-t-elle l’avenir de l’IA ?

L’opinion publique n’est pas un simple observateur passif. Elle influence déjà les décisions politiques et économiques.

L’IA Act, produit de la pression citoyenne

L’adoption de l’IA Act européen (2024-2025) a été en partie motivée par la demande citoyenne de régulation. Les eurodéputés ont reçu des milliers de courriers d’électeurs inquiets. Les sondages montrant un large soutien à une régulation stricte ont pesé dans les négociations.

Les entreprises sous pression

Les grandes entreprises technologiques (Google, Microsoft, Meta) sont de plus en plus sensibles à leur image publique. Les scandales liés à l’IA (biais, désinformation, exploitation des données) peuvent entraîner des chutes de confiance et des défections de clients. Des entreprises comme Microsoft ont créé des comités d’éthique internes et ont accepté de principes de « IA responsable » (responsable AI) en partie sous la pression de l’opinion.

L’émergence d’un « consommateur éthique » de l’IA

Une frange croissante de citoyens (encore minoritaire, mais en croissance) choisit d’utiliser ou d’éviter certains produits en fonction de leur impact éthique. Exemples : préférer les modèles open source aux modèles propriétaires, boycotter les entreprises qui utilisent des données personnelles sans consentement, soutenir les alternatives éthiques (Ecosia vs Google, DuckDuckGo).

L’importance de l’éducation du public

Pour que l’opinion publique soit éclairée, des efforts d’éducation sont nécessaires. Plusieurs pays (France, Finlande, Singapour) ont intégré des modules sur l’IA dans les programmes scolaires. Des initiatives citoyennes (conférences, MOOC, musées des sciences) tentent de démystifier la technologie.

10. FAQ — IA et opinion publique

Les sondages sur l’IA sont-ils fiables ?

Ils le sont dans une certaine mesure, mais ils présentent des biais classiques : les répondants ne sont pas toujours représentatifs (sondages en ligne, populations connectées), les questions sont parfois orientées, et l’opinion évolue vite. Cependant, la convergence des résultats entre plusieurs instituts (Pew, YouGov, IFOP, Ipsos) sur les grandes tendances (craintes sur l’emploi, acceptation de l’IA en santé, soutien à la régulation) renforce leur crédibilité.

Pourquoi les Européens sont-ils plus sceptiques que les Chinois ?

Plusieurs raisons : une tradition de protection des données personnelles (RGPD) plus forte, une méfiance historique vis-à-vis des grandes entreprises technologiques (souvent américaines), une presse plus critique, et un débat public plus nourri sur les enjeux éthiques. En Chine, le discours officiel est très positif (l’IA est un outil de puissance nationale), la couverture médiatique est orientée, et la sensibilité à la vie privée est moindre (ou réprimée).

Les jeunes sont-ils plus favorables à l’IA que leurs aînés ?

Globalement, oui, mais la différence n’est pas aussi marquée qu’on pourrait le penser. Selon Pew Research (2025), 58 % des 18-29 ans ont une opinion favorable de l’IA, contre 48 % des 65 ans et plus. Les jeunes sont plus familiers avec la technologie (smartphones, réseaux sociaux, ChatGPT), mais aussi plus inquiets pour leur emploi (ils entrent sur le marché du travail). Les seniors sont moins familiers, mais moins menacés par l’automatisation (ils sont souvent déjà à la retraite).

L’opinion publique peut-elle freiner le développement de l’IA ?

Oui, indirectement. Une opinion très hostile pourrait pousser les régulateurs à adopter des lois très restrictives (interdiction de certaines applications, limitation des données d’entraînement), ce qui ralentirait le développement. À l’inverse, un soutien fort pourrait accélérer l’adoption (ex. acceptation de l’IA en santé). Pour l’instant, l’opinion est partagée, ce qui conduit à une régulation prudente (ex. IA Act) mais pas à un freinage radical.

Où trouver les sondages les plus récents sur l’IA ?

Les instituts suivants publient régulièrement des sondages sur l’IA : Pew Research Center (États-Unis, monde), YouGov (Royaume-Uni, Europe), IFOP (France), Ipsos (monde), Edelman (monde, confiance), Eurobaromètre (Europe). La plupart sont accessibles gratuitement en ligne. Suivez également les rapports de l’OCDE, de l’UNESCO (sur l’éthique de l’IA), et de la Commission européenne.

Les citoyens veulent-ils plus de transparence sur les algorithmes ?

Oui, très largement. Selon un sondage IFOP (2025), 86 % des Français estiment que les entreprises devraient rendre leurs algorithmes compréhensibles au public. 82 % souhaitent que les décisions automatisées (ex. refus de prêt, rejet de CV) soient explicables. La transparence algorithmique est une demande citoyenne forte, reprise par les régulateurs (IA Act, RGPD).

Articles connexes

Pour approfondir les thèmes de l’éthique de l’IA et de son impact sur la société, voici d’autres contenus disponibles sur iana-data.org.

Analyse des craintes liées à la collecte et l’utilisation des données personnelles.

Comment les algorithmes peuvent reproduire ou amplifier les discriminations.

L’impact de l’automatisation sur l’emploi et les compétences.

Sources

- Pew Research Center – AI and the future of work (2025)

- Pew Research Center – Americans’ views on AI (2025)

- Edelman Trust Barometer 2026 – AI special report (janvier 2026)

- Eurobaromètre – L’intelligence artificielle dans l’UE (2025)

- IFOP – Les Français et l’intelligence artificielle (2025)

- Ipsos – Global attitudes toward AI (2025)

- YouGov – AI acceptance by domain (2025)

- Reuters Institute – Deepfakes and public concern (2025)

- OCDE – AI and public opinion (2025)

- Université de Pékin – Public perception of AI in China (2025)