« Alexa, quelle est la météo ? », « OK Google, allume la lumière », « Dis Siri, rappelle-moi d’appeler le médecin » — chaque jour, des millions de personnes confient des informations à leurs assistants vocaux. Mais que deviennent ces enregistrements ? Qui peut les écouter ? Combien de temps sont-ils conservés ? Et surtout, que révèlent-ils vraiment de notre vie privée ? Entre confort d’utilisation et protection des données personnelles, le choix n’est pas toujours simple. Cet article explore en détail les pratiques d’Amazon (Alexa), Google (Assistant) et Apple (Siri) en matière de collecte, de stockage et d’exploitation des données vocales. Vous découvrirez ce que chaque assistant sait de vous, les risques réels, et les gestes simples pour reprendre le contrôle.

Contrairement à une idée reçue, les assistants vocaux n’enregistrent pas en permanence. Ils « écoutent » en continu (via un buffer mémoire local) uniquement pour détecter le mot de réveil (« Alexa », « OK Google », « Dis Siri »). Ce n’est qu’après la détection du mot de réveil que l’enregistrement commence, et qu’il est envoyé aux serveurs du fabricant pour traitement. Mais une fois dans les serveurs, que deviennent ces enregistrements ?

Chaque commande vocale est stockée sur les serveurs du fabricant (Amazon, Google, Apple). L’enregistrement audio est conservé, généralement associé à votre compte utilisateur. Vous pouvez consulter l’historique de vos commandes (sur Amazon Alexa app, Google Mon activité, ou dans les réglages Siri). Les durées de conservation varient : par défaut, jusqu’à ce que vous les supprimiez manuellement, ou avec une suppression automatique paramétrable (3, 18 ou 36 mois selon les services).

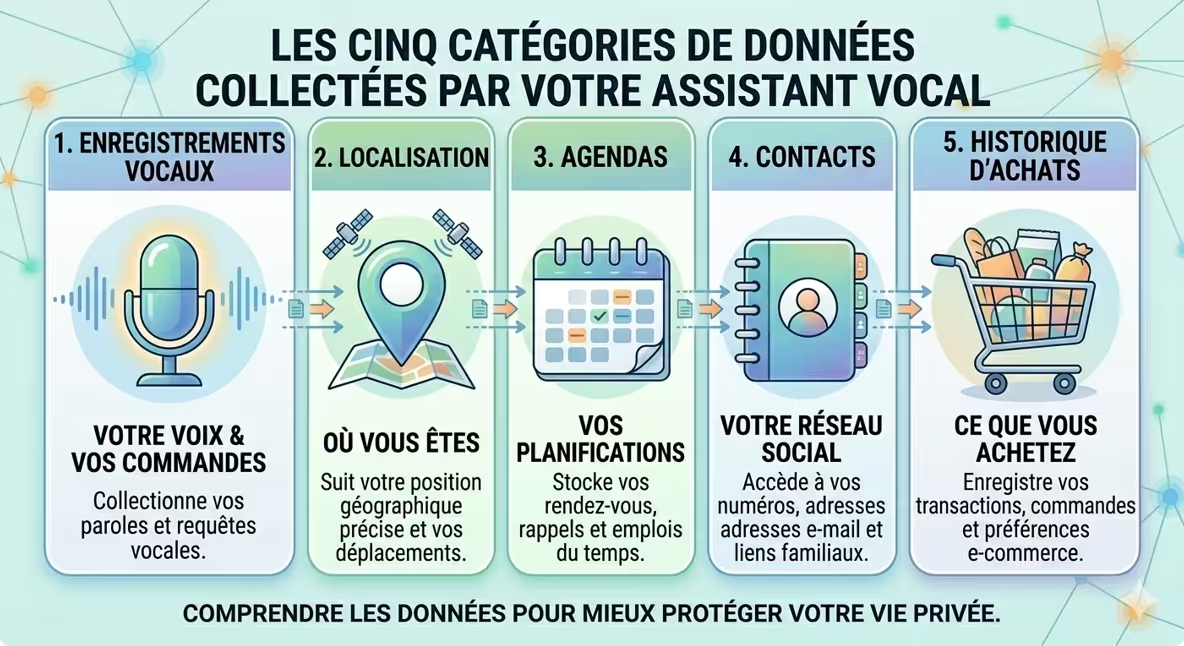

Au-delà de l’audio, les assistants collectent : votre localisation approximative (si vous demandez la météo), vos adresses (maison/travail), votre agenda (Google, Apple), votre historique d’achats (Amazon), vos contacts (si vous autorisez l’accès), et les conversations ambientales (lors des réveils accidentels).

Infographie n°1 – Les cinq catégories de données collectées : enregistrements vocaux, localisation, agendas, contacts, historique d’achats.

Les trois principaux assistants ont des politiques de confidentialité très différentes. Voici un comparatif détaillé.

| Critère | Amazon Alexa | Google Assistant | Apple Siri |

|---|---|---|---|

| Modèle économique \n | Vente de produits + publicité ciblée (Amazon Ads) \n | Publicité ciblée (Google Ads) + services \n | Vente de matériel (iPhone, HomePod) + services (Apple Music, iCloud) \n |

| Traitement par défaut \n | Cloud (serveurs Amazon) \n | Cloud (serveurs Google) \n | Sur l’appareil (on-device) pour la plupart des commandes ; cloud pour les requêtes complexes \n |

| Écoute humaine par défaut \n | Oui, sauf désactivation (pour amélioration des modèles) \n | Oui, sauf désactivation (pour amélioration des modèles) \n | Non (sauf consentement explicite) \n |

| Conservation des enregistrements \n | Jusqu’à suppression manuelle, ou suppression auto (3 ou 18 mois) \n | Jusqu’à suppression manuelle, ou suppression auto (3, 18 ou 36 mois) \n | Non conservés par défaut (sauf option pour améliorer Siri) \n |

| Utilisation pour publicité ciblée \n | Oui (Amazon utilise les données pour recommandations produits) \n | Oui (Google utilise les données pour profilage publicitaire) \n | Non (pas de publicité ciblée basée sur Siri) \n |

Apple Siri est le champion de la vie privée : traitement sur l’appareil, pas d’écoute humaine par défaut, enregistrements non conservés. Google Assistant et Amazon Alexa collectent beaucoup plus de données, mais offrent des contrôles (suppression automatique, désactivation de l’écoute humaine). Si la vie privée est votre critère numéro 1, choisissez Siri.

La raison officielle et légitime : vos enregistrements aident à entraîner les algorithmes à mieux comprendre les accents, les variations de débit, le bruit ambiant. Chez Amazon et Google, des extraits (anonymisés) sont écoutés par des humains (sous-traitants) pour vérifier la transcription. Cette pratique a fait scandale lorsqu’elle a été révélée en 2019. Aujourd’hui, vous pouvez désactiver l’écoute humaine dans les paramètres.

Amazon utilise votre historique vocal pour vous recommander des produits. Google associe vos commandes vocales à votre profil publicitaire pour afficher des annonces ciblées. La question « OK Google, quelle est la meilleure lessive ? » peut influencer les publicités que vous verrez ensuite. Apple, en revanche, n’utilise pas les données de Siri pour la publicité ciblée.

Les « skills » Alexa (applications tierces) peuvent collecter des données vocales. Amazon exige des développeurs qu’ils publient une politique de confidentialité, mais la vérification est imparfaite. Certaines skills ont été épinglées pour avoir collecté des données sans consentement explicite.

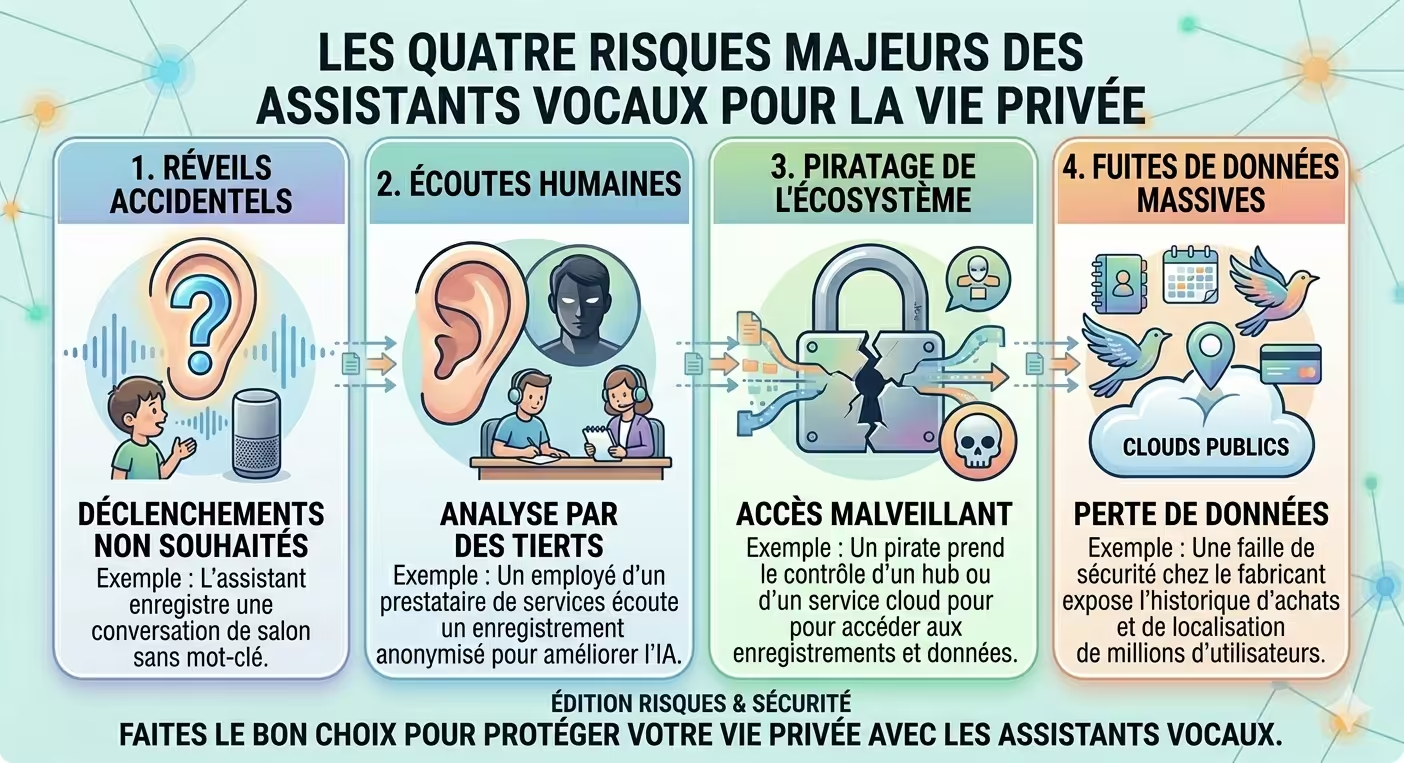

Infographie n°2 – Les quatre risques majeurs : écoutes humaines, piratage, réveils accidentels, fuites de données.

L’assistant peut se réveiller sans que vous ayez prononcé le mot de réveil. Une publicité à la télévision prononçant un mot proche, une conversation anodine, ou un bruit ambiant — l’assistant peut enregistrer quelques secondes de conversation privée sans votre consentement. Ces enregistrements sont envoyés aux serveurs. Amazon et Google ont reconnu des millions de réveils accidentels. Vous pouvez consulter votre historique pour identifier ces faux positifs et les supprimer.

Entre 2019 et 2020, des révélations ont montré que des sous-traitants d’Amazon, Google et Apple écoutaient des milliers d’enregistrements vocaux, y compris des conversations intimes (chambres à coucher, disputes, informations médicales). Apple a suspendu cette pratique et a rendu l’écoute humaine optionnelle (opt-in). Amazon et Google permettent de désactiver l’écoute humaine, mais elle est active par défaut.

Les enregistrements vocaux sont stockés sur des serveurs. Comme toute donnée numérique, ils peuvent être piratés. Aucune fuite massive de données vocales n’a été rendue publique à ce jour, mais des chercheurs ont démontré qu’il est possible d’extraire des enregistrements via certaines vulnérabilités. Le risque est faible, mais non nul.

Des lanceurs d’alerte (Bloomberg, The Guardian,比利时) révèlent que des milliers d’enregistrements vocaux sont écoutés par des sous-traitants. On entend des conversations privées, des enfants, des moments intimes. Les trois géants suspendent temporairement la pratique et modifient leurs politiques. Amazon et Google introduisent une option pour désactiver l’écoute humaine ; Apple rend l’option opt-in.

La CNIL sanctionne Amazon pour collecte excessive de données vocales et non-respect du consentement. Amazon conserve les enregistrements indéfiniment par défaut (jusqu’à suppression manuelle) et ne permettait pas une suppression automatique simple.

Un recours collectif (class action) accuse Google d’avoir collecté des enregistrements vocaux d’enfants via ses enceintes Nest, sans consentement parental. Google a payé une amende de 10 millions de dollars et a modifié ses conditions d’utilisation.

Un enregistrement vocal peut révéler bien plus que vous ne l’imaginez. Des chercheurs ont analysé des milliers de commandes et en ont extrait des informations sensibles.

À l’unité, une commande n’est pas très révélatrice. Mais agrégées sur des mois, les données permettent de dresser un profil très précis de votre vie quotidienne : heures de réveil, moments d’absence, habitudes alimentaires, centres d’intérêt, état de santé, relations familiales. C’est cette agrégation qui intéresse les annonceurs (Amazon, Google). Apple, en ne conservant pas les données par défaut, limite considérablement ce profilage.

Les assistants vocaux sont soumis à des régulations en Europe, mais leur application reste perfectible.

Le RGPD impose : une information claire sur la collecte, un consentement explicite (pas de cases pré-cochées), un droit d’accès (consulter vos enregistrements), un droit d’effacement (les supprimer), et un droit d’opposition (refuser certaines utilisations). Les amendes peuvent atteindre 20 millions d’euros ou 4 % du CA mondial. La CNIL a déjà sanctionné Amazon (30 M€) et Google (50 M€ en 2019 pour manque de transparence sur les données publicitaires).

L’IA Act classe la reconnaissance des émotions et l’exploitation des vulnérabilités comme « à haut risque » ou « inacceptable ». L’écoute humaine par défaut (sans consentement explicite) pourrait être interdite dans sa version finale (en discussion).

La CNIL a publié des recommandations spécifiques pour les assistants vocaux (2025) : information obligatoire sur les réveils accidentels, consentement préalable pour l’écoute humaine, droit de suppression facilement accessible.

Dans Amazon Alexa (Paramètres → Vie privée → Aide au développement Alexa) décochez « Utiliser mes enregistrement pour améliorer Alexa ». Dans Google Assistant (Mon activité → Activité vocale et audio) décochez « Inclure l’activité vocale et audio ».

Configurez la suppression des enregistrements tous les 3 mois (Amazon, Google) ou optez pour la non-conservation (Apple).

Amazon Alexa app → Activité → Historique vocal. Google → Mon activité → filtre « Assistant ». Apple → Réglages → Siri → Historique Siri. Supprimez les enregistrements accidentels ou sensibles.

La plupart des enceintes (Echo, Nest, HomePod) ont un bouton pour couper le micro. Utilisez-le lorsque vous ne souhaitez pas être écouté (conversations intimes, réunions).

Vous pouvez changer le mot de réveil sur Alexa (« Echo », « Amazon », « Computer »). Cela réduit les réveils accidentels.

La chambre est la pièce la plus intime. Évitez d’y placer un assistant vocal, ou coupez systématiquement son micro la nuit.

Dans les paramètres, limitez les permissions (contacts, agenda, localisation). Votre assistant a-t-il besoin de savoir qui sont vos amis ? Probablement pas.

Ne donnez pas accès à vos données personnelles à des skills non vérifiées. Consultez les avis et les politiques de confidentialité.

Avant une consultation médicale en visio, un entretien professionnel ou une conversation juridique, activez le mode muet sur votre enceinte.

Avez-vous vraiment besoin d’un assistant dans la salle de bain, la chambre d’amis, ou les toilettes ? Moins il y a d’enceintes, moins il y a de risques.

Apple a une longueur d’avance grâce au traitement sur l’appareil (on-device), à la non-conservation des enregistrements par défaut, à l’absence d’écoute humaine sans consentement explicite, et à son modèle économique (pas de publicité ciblée). Si la vie privée est votre priorité numéro 1, choisissez Siri — quitte à accepter un catalogue domotique un peu moins large.

Google Assistant collecte massivement, mais offre des contrôles détaillés (suppression automatique, désactivation de l’écoute humaine, consultation de l’historique). En configurant soigneusement les paramètres, vous pouvez limiter les risques. Idéal si vous êtes déjà dans l’écosystème Google et que vous acceptez une gestion active de votre vie privée.

Alexa est la plus transparente (beaucoup de paramètres disponibles), mais aussi la plus collectrice par défaut. La configuration de la vie privée est plus complexe (multiples menus). Désactiver l’écoute humaine et activer la suppression automatique est indispensable. En 2026, Alexa s’est améliorée, mais reste à la traîne sur la confidentialité par rapport à Google et Apple.

Non, ils n’enregistrent pas en permanence. Ils « écoutent » via un buffer local qui ne stocke rien. Lorsque le mot de réveil est détecté, les quelques secondes qui suivent sont enregistrées et envoyées aux serveurs. En revanche, des réveils accidentels (false wake) peuvent se produire, enregistrant ainsi des conversations privées sans votre consentement. Vous pouvez consulter votre historique pour voir ces réveils accidentels et les supprimer.

Oui. Dans Alexa : app → Activité → Historique vocal → tout supprimer. Dans Google Assistant : Mon activité → filtrer Assistant → supprimer. Dans Siri : Réglages → Siri → Historique Siri → supprimer. Attention : la suppression peut prendre quelques jours pour être effective sur tous les serveurs. De plus, les données anonymisées utilisées pour l’entraînement des modèles ne peuvent pas être supprimées (car non associées à votre compte).

Non, pas nécessairement. Les assistants vocaux apportent de réels bénéfices (confort, accessibilité, domotique). L’enjeu est de les utiliser en connaissance de cause, en configurant correctement les paramètres de vie privée, et en limitant leur présence aux pièces où c’est vraiment utile. Une utilisation raisonnée et configurée est possible. Si vous êtes très sensible à la vie privée, préférez Siri.

Le risque principal est économique (profilage publicitaire) : vous verrez des publicités ciblées basées sur vos conversations. Le risque d’écoute humaine est réel mais a été réduit depuis les scandales ; vous pouvez le désactiver. Le risque de piratage (fuite de vos enregistrements) est faible mais non nul. Le risque pour un particulier lambda est modéré. Pour une personnalité publique, un journaliste, un avocat, ou une personne sous protection, les risques sont plus élevés.

Pas nécessairement, mais certains paramètres par défaut ont été jugés non conformes au RGPD par la CNIL (ex. conservation indéfinie par défaut). Amazon et Google ont modifié leurs pratiques après sanctions. Aujourd’hui, en configurant correctement les paramètres (désactivation de l’écoute humaine, suppression automatique), on peut être en conformité. Malheureusement, les paramètres par défaut restent en faveur de la collecte.