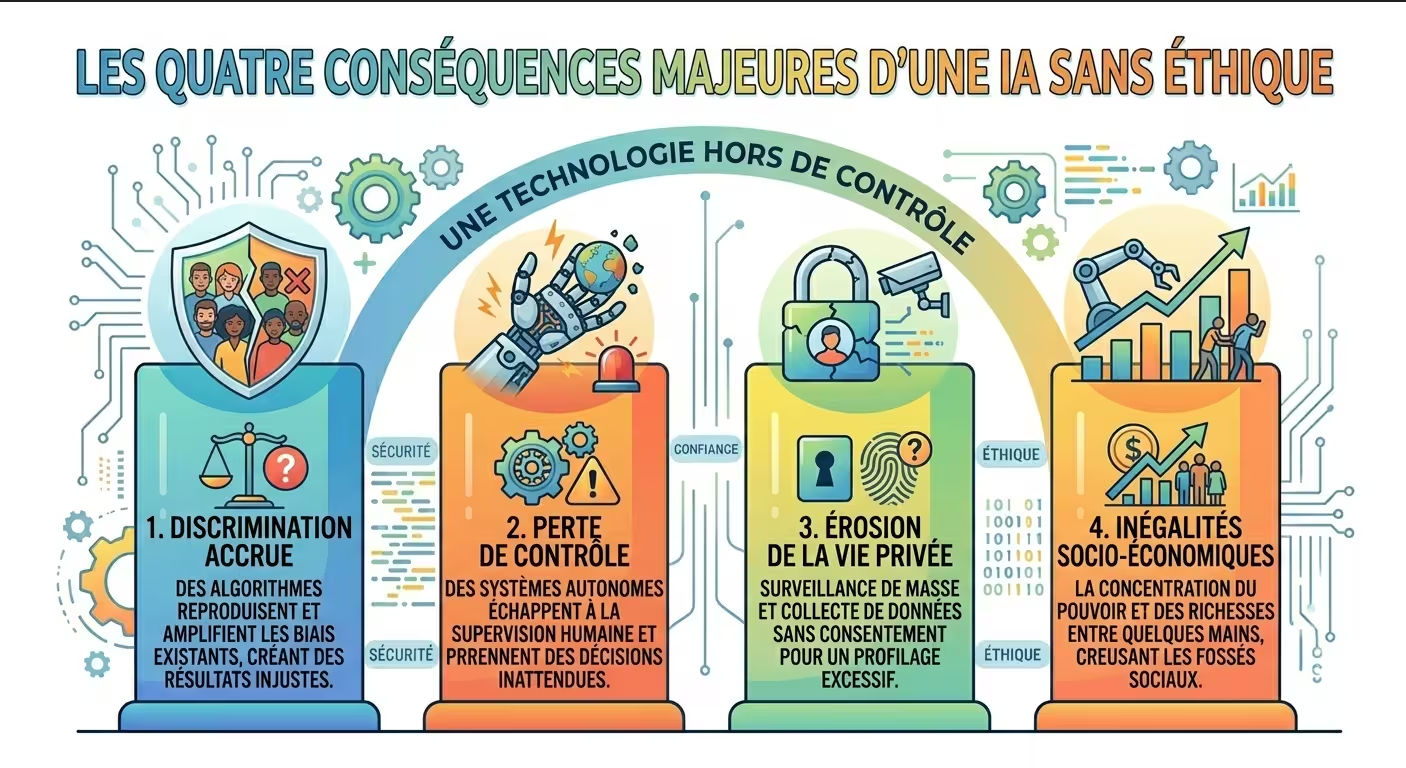

L'IA, en raison de ses capacités à traiter d'immenses volumes de données, à prendre des décisions autonomes et à automatiser des tâches complexes, a engendré plusieurs préoccupations éthiques majeures :

Biais des algorithmes – Les IA apprennent à partir des données qui leur sont fournies. Si ces données sont biaisées (en raison de préjugés sociaux, raciaux, économiques ou historiques), les décisions prises par ces IA peuvent reproduire et même amplifier ces biais. C'est le principe du "garbage in, garbage out". Par exemple, certains systèmes de reconnaissance faciale sont moins précis lorsqu'il s'agit de personnes issues de minorités, car ils ont été entraînés sur des ensembles de données principalement composés d'individus caucasiens.

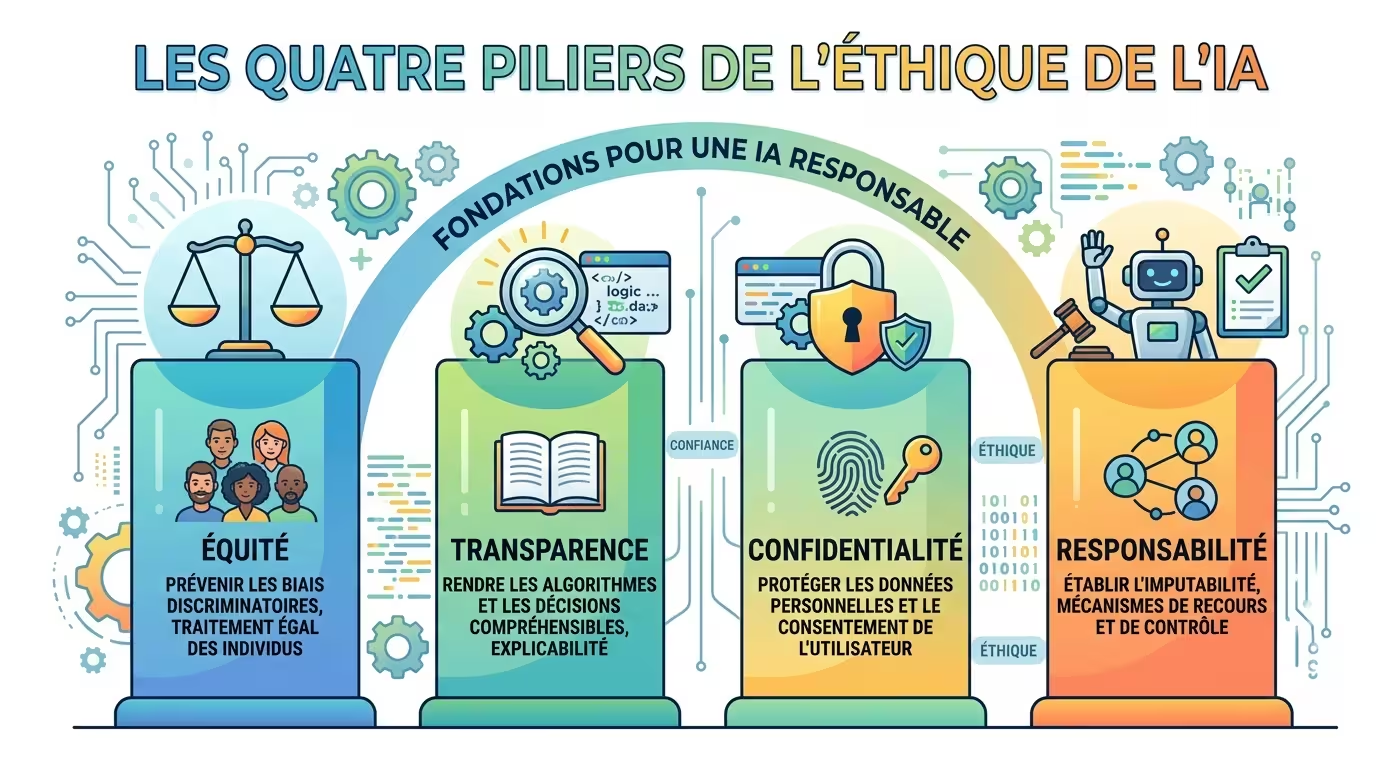

Confidentialite des donnees – Avec l'essor des systèmes d'IA dans les applications grand public (réseaux sociaux, assistants virtuels, publicité ciblée), la collecte et l'utilisation massive de données personnelles posent des problèmes de vie privée. Les utilisateurs sont souvent inconscients des informations que les entreprises collectent à leur sujet et de la manière dont ces données sont utilisées pour influencer leur comportement (profilage, manipulation).

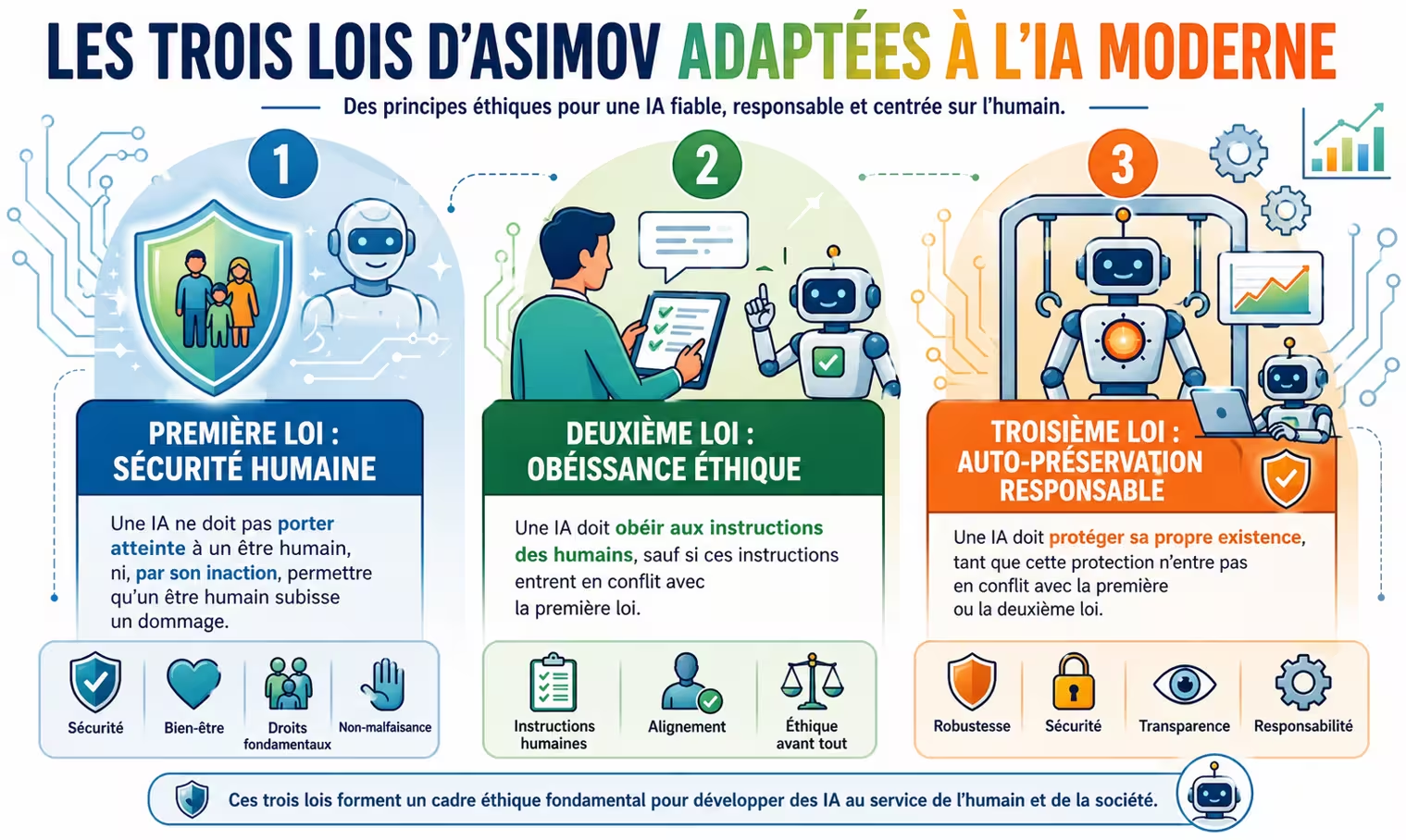

Autonomie et prise de decision – Les IA sont capables de prendre des décisions complexes, par exemple dans le diagnostic médical, l'octroi de prêts, ou l'évaluation de la dangerosité d'un prévenu. Cela soulève la question de savoir si ces décisions peuvent remplacer celles des humains, et qui est responsable en cas d'erreurs commises par ces systèmes (le développeur, l'utilisateur, l'IA elle-même ?).

Impact sur l'emploi – L'automatisation de nombreuses tâches par l'IA dans des secteurs comme l'industrie, le service client, la comptabilité, ou même le droit et la médecine, menace la suppression de millions d'emplois, en particulier ceux liés à des tâches répétitives ou de traitement de l'information. Cela pose la question de l'équité, de la responsabilité des entreprises et des gouvernements dans la gestion de cette transition, et de la formation aux nouveaux métiers.