L’intelligence artificielle a réalisé des progrès fulgurants ces dernières années. Elle dépasse l’humain dans la classification d’images, le jeu de Go, la détection de maladies sur des radiographies, et même la génération de textes convaincants. Pourtant, il existe des domaines où l’IA reste encore loin derrière : les mathématiques de haut niveau, le raisonnement de bon sens, et la planification complexe. Ces lacunes ne sont pas anecdotiques — elles révèlent les limites fondamentales des approches actuelles (deep learning, grands modèles de langage). Cet article explore pourquoi l’IA peine face à l’abstraction, au contexte et à l’incertitude, et ce que ces limites signifient pour l’avenir de la recherche en intelligence artificielle.

L’intelligence artificielle et l’intelligence humaine sont fondamentalement différentes. L’IA excelle dans les tâches répétitives, les environnements fermés, les problèmes bien définis avec des règles claires et des données abondantes. L’humain excelle dans l’adaptation, l’abstraction, le raisonnement avec des informations partielles, et la compréhension du contexte.

Cette asymétrie explique pourquoi l’IA bat les champions du monde de Go ou d’échecs (environnements fermés), mais reste incapable de comprendre une blague subtile, de planifier un déménagement, ou de résoudre un problème mathématique inédit sans millions d’exemples d’entraînement. Voici les trois domaines où l’écart reste le plus marqué en 2026.

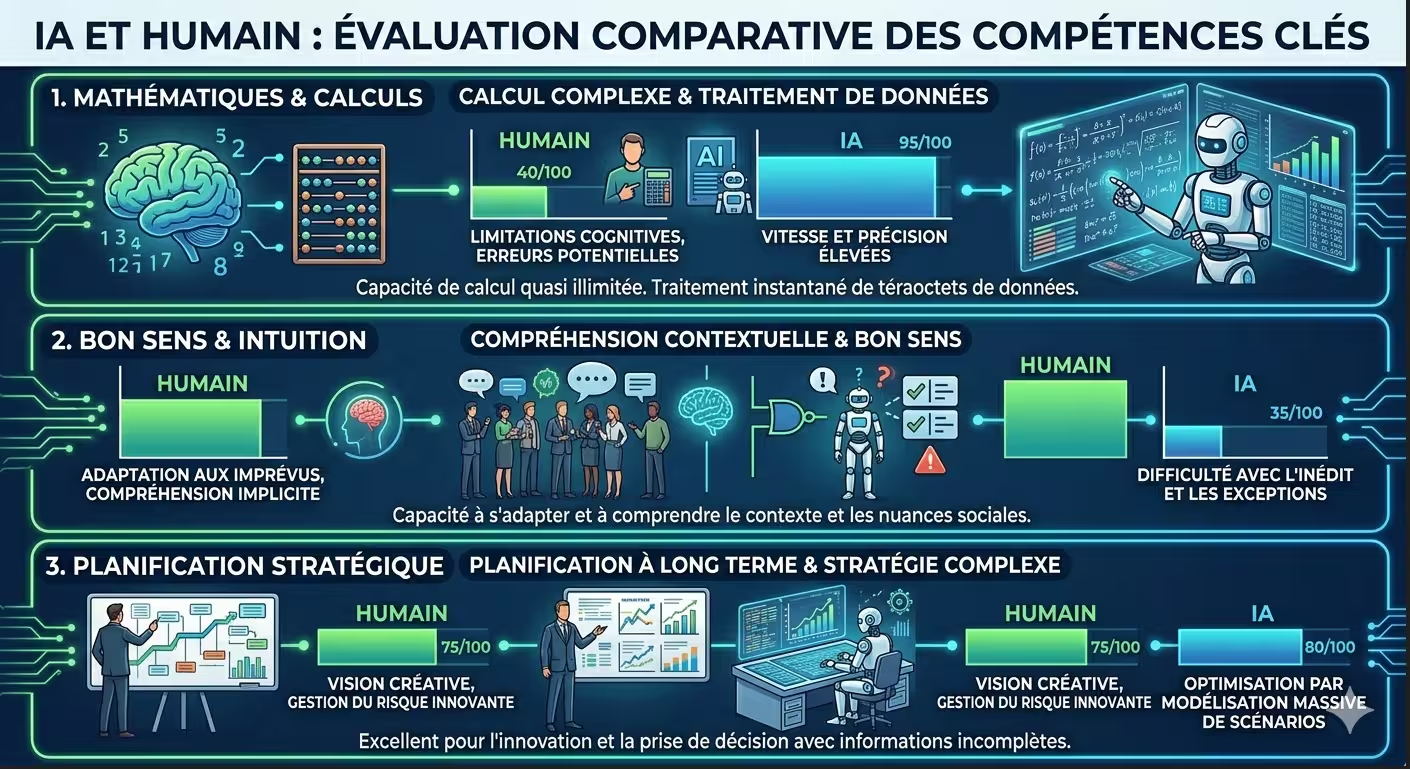

Infographie n°1 – Les trois domaines où l’IA n’a pas encore rattrapé l’humain : mathématiques avancées, raisonnement de bon sens, planification complexe.

Les mathématiques ne sont pas de simples calculs. Les mathématiques avancées exigent de l’abstraction, de la créativité, et la capacité à inventer de nouvelles démonstrations — des compétences que les IA actuelles (LLM) ne possèdent pas intrinsèquement.

L’abstraction et la généralisation hors distribution – L’IA apprend à partir de millions d’exemples. Si on lui donne un problème légèrement différent de ceux vus à l’entraînement, elle peut échouer. Un mathématicien humain, en revanche, peut comprendre la structure sous-jacente et généraliser à des situations nouvelles. L’incapacité à « inventer » – Les grands modèles de langage (LLM) régurgitent des motifs appris. Ils ne peuvent pas créer une démonstration véritablement nouvelle, s’appuyant sur une intuition non vue dans les données. La vérité n’est pas une question de statistique – Un LLM prédit la prochaine phrase la plus probable, pas la phrase mathématiquement vraie. En mathématiques, la vérité est une propriété logique, pas statistique.

AlphaProof (Google DeepMind, 2024) – Système combinant un modèle de langage et un moteur de recherche formelle, capable de résoudre des problèmes des Olympiades internationales de mathématiques (IMO) à un niveau médaille d’argent. AlphaProof a résolu 4 problèmes sur 6, égalant la performance d’un candidat médaillé d’argent. Mais il reste incapable de résoudre des problèmes de recherche en mathématiques pures (ex. conjecture de Hodge, hypothèse de Riemann). GPT-4o et les mathématiques – GPT-4o (mars 2026) obtient environ 70 % de bonnes réponses sur des problèmes de niveau lycée (Math benchmarks GSM8K), mais chute à 25 % sur des problèmes de mathématiques universitaires (MATH dataset). Gemini Ultra 2.0 fait légèrement mieux sur l’arithmétique (85 %) mais échoue sur les problèmes de démonstration.

Le bon sens est l’ensemble des connaissances et des capacités de raisonnement qu’un humain acquiert naturellement : qu’un objet ne peut pas être à deux endroits à la fois, que l’eau mouille, qu’il faut un manteau s’il fait froid. L’IA n’a pas de bon sens.

CommonsenseQA (2019) : les humains atteignent 87 % de bonnes réponses, les meilleures IA 45-55 %. Winograd Schema Challenge (WS) : questions basées sur des ambiguïtés de pronom que les humains résolvent par bon sens. Les IA progressent, mais plafonnent.

La planification à long horizon — organiser un voyage, gérer un projet de plusieurs mois, exécuter une stratégie militaire — exige de prévoir les conséquences de ses actions sur une longue période, de s’adapter aux imprévus, et de hiérarchiser des objectifs contradictoires. L’IA peine sur ces trois aspects.

Robotique domestique – Un robot aspirateur est excellent pour nettoyer une pièce (planification courte). Mais demandez à un robot IA de « préparer la maison pour une fête » (ranger, nettoyer, décorer, acheter des courses) : il échoue. Jeux de stratégie longue durée – AlphaStar (StarCraft II) bat les humains, mais en exploitant des micro-actions à très haute fréquence (APM). Privé de cet avantage de vitesse, il perd contre des joueurs utilisant des stratégies créatives. Planification dans l’incertitude (planning under uncertainty) – Dans une vraie organisation humaine (entreprise, hôpital), les imprévus sont constants. Les humains réévaluent et ajustent. Les IA modernes, même récurrentes, sont fragiles face à des surprises hors distribution.

Les LLM et modèles de deep learning sont entraînés sur des distributions de données. Pour toute question « hors distribution », la performance s’effondre drastiquement. Les humains généralisent hors distribution de manière robuste.

Un humain a un modèle interne du monde (physique, social, causal). L’IA moderne (LLM) n’a pas de modèle causal, juste des corrélations statistiques. Le bon sens est une forme de causalité.

Un humain peut reconnaître ses propres limites et dire « je ne sais pas ». L’IA actuelle ne le peut pas (sauf bricolage).

LLM ∝ prédiction, pas logique. Les modèles hybrides (AlphaProof, neuro-symboliques) progressent, mais restent lents et spécialisés.

AlphaProof (Google DeepMind, IMO 2024) – Résout 4 problèmes sur 6 des Olympiades mathématiques (niveau médaille d’argent). Progrès majeur mais ne s’étend pas à la recherche mathématique ouverte. o3 (OpenAI, 2025-2026) – Modèle de « raisonnement amélioré » (chain-of-thought + self-consistency). Meilleur en mathématiques et coding. Encore fragile sur le bon sens et la planification complexe. GPT-4o et Gemini 2.0 – Meilleurs en mathématiques générales (lycée), mais toujours faibles en bon sens comparé aux humains. ARC benchmark (Abstraction and Reasoning Corpus) – Test de généralisation hors distribution. Aucune IA ne dépasse 35 % de réussite, alors qu’un humain atteint 85 %.

Les modèles hybrides neuro-symboliques (réseaux de neurones + moteurs logiques), la recherche sur le raisonnement causal (causal inference), l’amélioration des modèles pour la généralisation hors distribution (meta-learning, few-shot learning) et l’intégration d’un “monde intérieur” simulé (world models) sont des pistes prometteuses. À court terme, l’IA restera inférieure aux humains sur l’abstraction, le bon sens, et la planification à long horizon.

L’IA n’a pas de « modèle du monde » causal. Elle ne comprend pas la physique, la psychologie, ou les chaînes de causalité — elle mémorise des corrélations. Un enfant de 5 ans, par expérience directe, accumule ces connaissances. Une IA les apprend via des textes, mais sans y croire ni les comprendre, et elle ne sait pas combiner ces fragments absurdes.

Pas à court terme. Les mathématiques de recherche exigent de l’intuition, des nouvelles constructions — pas juste une prédiction statistique. Les approches hybrides avec moteur de prouveur (AlphaProof) progressent, mais une machine seule ne remplace pas un mathématicien créatif.

Oui, par définition. Mais l’AGI reste hypothétique. Les problèmes listés sont précisément ceux qui manquent aux systèmes actuels pour atteindre l’AGI. Beaucoup de chercheurs pensent que franchir ces étapes nécessite des ruptures conceptuelles (causalité, world models, raisonnement symbolique).