Chaque minute, 500 heures de vidéo sont mises en ligne sur YouTube. Chaque jour, plus de 300 milliards d’e-mails sont envoyés dans le monde. Chaque année, le volume mondial de données créées dépasse les 150 zettaoctets (150 suivis de 21 zéros). Derrière ces chiffres vertigineux se cache un défi technique, économique et environnemental immense : comment stocker toutes ces données ? Comment les organiser pour qu’elles soient accessibles, exploitables et sécurisées ? Le stockage de la Big Data n’est pas une simple question de « disques durs plus gros ». C’est un problème d’architecture, de fiabilité, de coût, de souveraineté et d’impact climatique. Cet article explore les solutions — des data lakes aux clouds, en passant par la compression et l’edge computing — et les défis qui restent à relever en 2026.

Pour comprendre le défi du stockage, il faut d’abord mesurer l’ampleur du phénomène. Les données sont produites par une multitude de sources : capteurs IoT (objets connectés), vidéos de surveillance, réseaux sociaux, applications mobiles, véhicules autonomes, imagerie médicale, génomique, transactions financières, et bien sûr l’activité humaine numérique (photos, vidéos, documents).

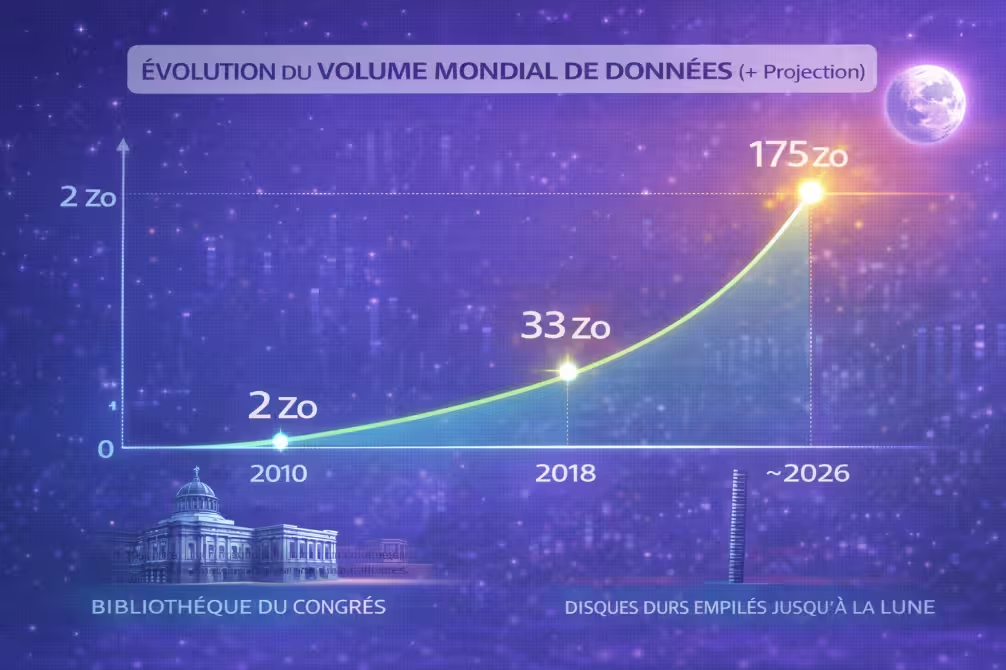

Selon le rapport Data Age 2026 d’IDC, le volume mondial de données créées, capturées, copiées et consommées atteindra 175 zettaoctets (Zo) en 2026, contre 33 Zo en 2018 et 2 Zo en 2010. Un zettaoctet équivaut à 1 milliard de téraoctets. Pour donner un ordre de grandeur : 175 Zo représentent l’équivalent de 175 milliards de disques durs de 1 téraoctet. Empilés, ces disques formeraient une tour haute de 2,6 millions de kilomètres — environ 6 fois la distance entre la Terre et la Lune.

Infographie n°1 – Croissance exponentielle des données mondiales (zettabytes) : de 2 Zo en 2010 à 175 Zo en 2026.

À cette création massive s’ajoute un autre phénomène : la conservation. Les entreprises ne suppriment plus leurs données par défaut, par crainte de « jeter une information qui pourrait servir un jour » (principe du « data hoarding »). Les obligations légales de conservation (5, 10, 30 ans selon les secteurs) renforcent cette tendance. Le résultat : les volumes stockés croissent encore plus vite que les volumes créés.

Pour 1 octet de données créé, on estime qu’il y a environ 10 à 15 octets de données stockées (réplication, sauvegardes, versions). Ainsi, 175 Zo créés en 2026 correspondent à environ 2 000 Zo stockés sur des supports physiques (disques, bandes).

Toutes les données n’ont pas la même valeur ni le même besoin de disponibilité. Une distinction classique (mais fondamentale) est celle des trois « températures » de stockage.

Données fréquemment consultées, nécessitant un accès en temps réel (latence < 1 milliseconde). Exemples : bases de données transactionnelles, caches, données de trading haute fréquence. Le stockage chaud utilise des disques SSD (solid-state drives) très rapides (NVMe) ou de la mémoire vive (RAM). C’est le plus coûteux (environ 0,10-0,50 $ par Go par mois).

Données consultées occasionnellement (quelques fois par jour ou par semaine), qui doivent être accessibles en quelques secondes. Exemples : données d’analyse (data lake), logs récents, archives opérationnelles. Le stockage tiède utilise des disques durs HDD (hard disk drives) classiques (7200 tr/min) ou des SSD moins chers (QLC). Coût : environ 0,02-0,05 $ par Go par mois.

Données rarement consultées (une fois par mois, par an, voire jamais), mais qu’on ne peut pas supprimer (obligations légales, valeur historique potentielle). Exemples : archives légales, sauvegardes anciennes, données scientifiques brutes. Le stockage froid utilise des disques durs à faible rotation (5400 tr/min), des bibliothèques de bandes (LTO, Linear Tape-Open), ou des services cloud de type « archive » (AWS Glacier, Azure Archive, Google Coldline). Coût : aussi bas que 0,001-0,005 $ par Go par mois, mais avec un délai de restauration de quelques minutes à plusieurs heures.

Le défi est de placer automatiquement les données dans la bonne température en fonction de leur âge et de leur fréquence d’accès (data lifecycle management). Des algorithmes d’IA aident aujourd’hui à prédire la « température » future des données pour optimiser les coûts.

Les entreprises doivent choisir entre stocker leurs données dans des datacenters cloud (AWS, Azure, Google Cloud, OVH, etc.) ou dans leurs propres datacenters internes (on-premise). Ce choix n’est pas binaire : les architectures hybrides (partie cloud, partie on-premise) sont de plus en plus courantes.

En 2026, la tendance est au multi-cloud (utiliser plusieurs fournisseurs pour éviter la dépendance) et au cloud hybride (on-premise pour les données sensibles, cloud pour l’élasticité). Les solutions de « data lake » (voir section suivante) peuvent s’étendre sur plusieurs environnements.

Selon Gartner (2026), 85 % des grandes entreprises ont adopté une stratégie cloud-first ou cloud-hybride pour leur stockage Big Data, contre 65 % en 2021. Le marché du stockage cloud a atteint 120 milliards de dollars en 2025.

Le stockage de la Big Data ne se limite pas à aligner des disques. L’organisation logique des données est tout aussi importante que le support physique.

Structure rigide, schéma défini à l’avance (schema-on-write). Les données sont nettoyées, transformées et agrégées avant d’être chargées. Idéal pour le reporting et la Business Intelligence (BI). Exemples : Snowflake, Google BigQuery, Amazon Redshift, Microsoft Azure Synapse.

Structure souple : on stocke les données brutes dans leur format natif (JSON, Parquet, Avro, vidéo, images). Le schéma est appliqué à la lecture (schema-on-read). Idéal pour l’exploration, le machine learning, et les données non structurées. Le data lake repose souvent sur Hadoop HDFS (Hadoop Distributed File System) ou sur des solutions cloud (AWS S3, Azure Data Lake Storage, Google Cloud Storage).

Sans gouvernance, un data lake dégénère rapidement en marécage de données (« data swamp ») : données non documentées, dupliquées, de qualité inconnue, inexploitables. La métadonnée (catalogue des données) est aussi importante que les données elles-mêmes. Des outils comme AWS Glue, Apache Atlas ou Collibra aident à maintenir un data lake propre.

Architecture émergente (popularisée par Databricks) qui combine la flexibilité du data lake (stockage de données brutes) avec les performances d’un data warehouse (requêtes SQL rapides, transactions ACID). Les formats ouverts comme Delta Lake, Apache Iceberg ou Apache Hudi permettent de gérer les mises à jour et suppressions dans un data lake.

Infographie n°2 – Comparaison des architectures de stockage : data warehouse, data lake, data lakehouse.

Avant même de choisir un support physique, on peut réduire drastiquement le volume à stocker grâce à des techniques logicielles.

Des algorithmes comme gzip, Snappy, Zstandard (zstd) ou LZ4 compressent les données, parfois jusqu’à 90 % de réduction pour les textes. Le choix du compromis vitesse/taux de compression dépend de l’usage : LZ4 pour la vitesse (très rapide, compression modérée), zstd pour un bon équilibre, gzip pour un taux élevé (mais plus lent).

Dans les sauvegardes ou les bases de données, les mêmes blocs de données apparaissent souvent en plusieurs exemplaires. La déduplication identifie les blocs identiques et ne les stocke qu’une seule fois, avec des pointeurs. Les taux de déduplication peuvent atteindre 20:1 pour les sauvegardes quotidiennes.

Les formats de colonne (columnar) stockent les données par colonne plutôt que par ligne. Pour les requêtes analytiques qui ne lisent que quelques colonnes (ex. « calculer la moyenne des ventes »), cela évite de lire toutes les colonnes inutiles. De plus, la compression est plus efficace car les valeurs d’une même colonne sont similaires. Le format Parquet (open source, utilisé par Spark, Hive, Presto) est devenu le standard du data lake.

Face à l’explosion des données générées par les objets connectés (IoT), il n’est plus envisageable de tout envoyer dans le cloud central. La latence serait trop élevée, la bande passante saturée. D’où l’émergence du « edge computing » et du « edge storage ».

Principe : les données sont traitées et stockées localement, à proximité de leur source (usine, voiture autonome, hôpital, magasin), seules les données agrégées ou pertinentes sont envoyées au cloud central. Exemples :

Le edge storage pose ses propres défis : fiabilité des disques dans des environnements hostiles (température, vibrations), sécurité physique des données (vol du boîtier edge), et synchronisation avec le cloud central.

Les données ne sont pas un bien comme les autres. Leur localisation géographique a des implications juridiques, politiques et de souveraineté nationale.

Le RGPD impose que les données personnelles de citoyens européens soient stockées dans l’Union européenne (ou dans des pays jugés « adéquats » par la Commission). Le transfert de données hors UE est strictement encadré (clauses contractuelles types, binding corporate rules). Le Cloud Act américain (2018) permet aux autorités américaines d’accéder aux données détenues par des entreprises américaines, où qu’elles soient stockées dans le monde — ce qui entre en conflit avec le RGPD. La jurisprudence « Schrems II » (2020) a invalidé le Privacy Shield, compliquant les transferts Europe-États-Unis. En 2026, un nouveau cadre (Data Privacy Framework) est en place mais reste fragile.

Plusieurs pays imposent que certaines données (santé, défense, données stratégiques) soient stockées sur leur territoire, parfois exclusivement chez des opérateurs nationaux (ex. Cloud de confiance en France : Bleu (Microsoft + Orange), NumSpot (Capgemini), etc.).

Des pays comme la Russie, la Chine, l’Inde, la Turquie imposent un stockage local (data localization) pour certaines catégories de données (données personnelles de leurs citoyens). Cela oblige les entreprises multinationales à construire des datacenters locaux.

Une entreprise européenne qui utilise AWS ou Azure doit choisir des régions (data centers) situées en Europe (ex. AWS eu-west-3 à Paris, Azure France Central). Elle doit s’assurer que son fournisseur cloud n’a pas d’accès incontrôlé aux données (problème du Cloud Act). Les offres « Cloud de confiance » (Bleu, NumSpot) visent à résoudre cette tension, mais elles sont plus chères et moins matures.

Le stockage de la Big Data a un coût écologique considérable, encore trop souvent ignoré. Les data centers (centres de données) consomment environ 1 à 2 % de l’électricité mondiale en 2026, soit l’équivalent de la consommation d’un pays comme le Japon ou l’Allemagne. Et cette part croît rapidement (+10-15 % par an).

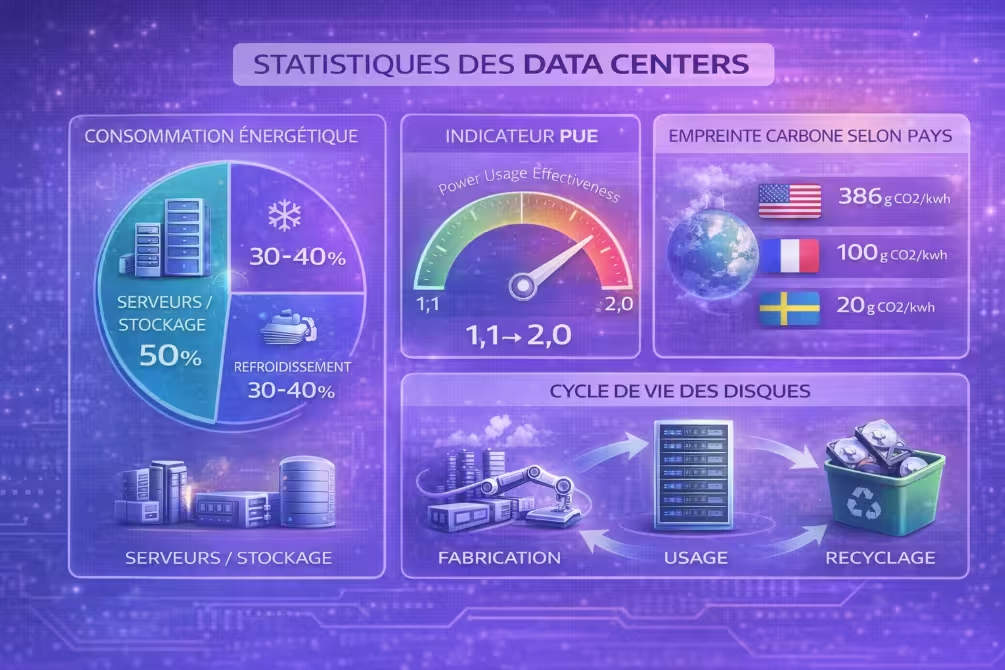

Un data center consomme de l’électricité pour : alimenter les serveurs et les disques (la moitié), refroidir les équipements (environ 30-40 %), et l’éclairage/sécurité. Le PUE (Power Usage Effectiveness) mesure l’efficacité énergétique : un PUE de 1,5 signifie que pour 1 watt utilisé par les serveurs, 0,5 watt est utilisé pour le refroidissement (perte). Les data centers modernes atteignent des PUE de 1,1-1,2, mais les plus anciens sont autour de 1,8-2,0.

L’impact carbone dépend de la source d’électricité. Les data centers placés dans des pays au mix électrique décarboné (France, Norvège, Suède, Québec) ont une empreinte bien moindre que ceux situés dans des pays très carbonés (Pologne, Allemagne (encore), Chine, Australie). Les géants du cloud (Google, Microsoft, AWS) affichent des objectifs de neutralité carbone, mais leur bilan réel est contesté (utilisation de crédits carbone, énergies renouvelables non directement connectées aux data centers).

Les disques durs et SSD ont une durée de vie limitée (3 à 5 ans pour les disques d’entreprise). Leur remplacement génère des déchets électroniques. La fabrication d’un disque dur nécessite des terres rares (néodyme, dysprosium, etc.) dont l’extraction est polluante.

Infographie n°3 – Data centers : consommation énergétique, PUE, empreinte carbone et électronique.

Pour réduire l’empreinte du stockage : 1) Nettoyez régulièrement les données inutiles (politique de suppression). 2) Utilisez la compression et la déduplication. 3) Classez les données par température (chaud/tiède/froid) pour utiliser des supports moins énergivores pour les archives. 4) Choisissez des data centers verts (énergies renouvelables, bon PUE). 5) Préférez le cloud mutualisé (meilleure mutualisation des ressources) plutôt que des datacenters internes sous-utilisés.

Face à l’explosion des volumes, les technologies de stockage actuelles (disques durs, bandes magnétiques, SSD) pourraient atteindre leurs limites physiques dans la prochaine décennie. Des solutions de rupture sont à l’étude.

Principe : synthétiser des molécules d’ADN (comme dans le vivant) pour encoder des données binaires (0/1) dans les 4 bases (A, T, G, C). L’ADN est extrêmement dense : on peut stocker 1 zettaoctet (1 milliard de téraoctets) dans un volume d’un centimètre cube. Et il est très stable (des milliers d’années à température ambiante). En 2026, le stockage ADN reste expérimental et très coûteux (environ 1 000 $ par mégaoctet), mais Microsoft et Twist Bioscience travaillent à le rendre viable pour l’archivage à très long terme.

Microsoft a développé une technique d’encodage de données dans du verre (femtoseconde laser qui crée des nano-structures). Le verre est inerte, résiste aux incendies, à l’eau, aux champs magnétiques, et pourrait durer des milliers d’années. Capacité : environ 100 téraoctets par disque de verre (taille DVD). En 2026, le projet est en phase pilote, pas encore commercialisé.

Principe : stocker des données dans tout le volume d’un cristal photosensible en utilisant des interférences de faisceaux laser. Théoriquement, une densité bien supérieure aux disques durs (plusieurs téraoctets par cm³). Après des décennies de recherche, quelques produits de niche existent, mais le stockage holographique n’a pas encore percé commercialement.

Une perspective encore lointaine. Les ordinateurs quantiques pourraient stocker des données dans des états quantiques (qubits), avec des capacités théoriquement phénoménales. Mais la décohérence (perte de l’information quantique) et la difficulté de lecture/écriture repoussent cette technologie à plusieurs décennies, si elle est un jour viable.

Un data warehouse stocke des données structurées, nettoyées et transformées (schema-on-write) pour le reporting et la BI. Un data lake stocke des données brutes, structurées ou non, dans leur format natif (schema-on-read) pour l’exploration et le machine learning. Un data lakehouse combine les deux approches. En pratique, beaucoup d’entreprises utilisent les deux : le data lake pour l’exploration, et le data warehouse pour les tableaux de bord.

Cela dépend. Les grands fournisseurs cloud (AWS, Azure, Google Cloud) ont des équipes de sécurité massive, des certifications (ISO 27001, SOC 2, HDS pour la santé) et des redondances géographiques. Pour une PME, le cloud est probablement plus sûr qu’un serveur dans un local technique non sécurisé. Pour une grande entreprise avec une équipe sécurité mature, l’on-premise peut offrir un contrôle plus fin (accès physiques, isolation). Le risque principal du cloud est la mauvaise configuration (bucket S3 public par erreur) ou l’insuffisance de la gestion des clés d’accès. La sécurité est une responsabilité partagée.

Le coût varie énormément selon la technologie. Un disque dur HDD grand public coûte environ 15-20 €/To (achat unique). Un disque SSD NVMe haut de gamme : 80-120 €/To. En cloud (AWS S3 standard), le coût est d’environ 20-25 $/To par mois (stockage seul, sans les transferts). Pour le stockage froid (AWS Glacier Deep Archive), c’est environ 1 $/To par mois, mais avec des délais de restauration de 12 heures. Le prix du stockage baisse d’environ 15-20 % par an (loi de Kryder, l’équivalent de Moore pour les disques).

Techniquement, oui. Les données vous appartiennent, mais vous dépendez du fournisseur pour y accéder. En cas de faillite (peu probable pour AWS, Azure, Google, mais possible pour un petit fournisseur), les actifs (dont les disques) seraient vendus à un repreneur. Les clauses contractuelles prévoient généralement un délai de récupération des données avant la cessation de service. Pour les données critiques, il est prudent de prévoir un backup chez un deuxième fournisseur (multi-cloud) ou sur des bandes en local.

Ils utilisent des data centers massifs (plusieurs centaines de milliers de disques) avec des systèmes de fichiers distribués (ex. GFS de Google, HDFS d’Hadoop). Les données sont répliquées (généralement 3 copies) sur des disques répartis géographiquement. Des techniques de compression (ex. JPEG déjà compressé, mais réduction supplémentaire pour les images similaires) et de déduplication (une même photo uploadée par plusieurs utilisateurs n’est stockée qu’une seule fois) réduisent les volumes. Enfin, le stockage « froid » pour les photos rarement consultées (anciennes, albums privés) est utilisé.

Plusieurs tendances : 1) Généralisation du stockage en cloud hybride (mix on-premise/cloud/edge). 2) Automatisation de la gestion du cycle de vie des données par l’IA (placement automatique sur le bon support). 3) Stockage « vert » avec des datacenters alimentés par des énergies renouvelables et des techniques de refroidissement passif (immersion, eau). 4) Émergence de nouvelles technologies (stockage ADN, verre) pour l’archivage très long terme. 5) Régulations plus strictes sur la souveraineté des données, favorisant les clouds locaux.