Analyse exploratoire des données (EDA) : guide complet

Maîtrisez l’étape la plus créative et la plus critique de tout projet Data Science.

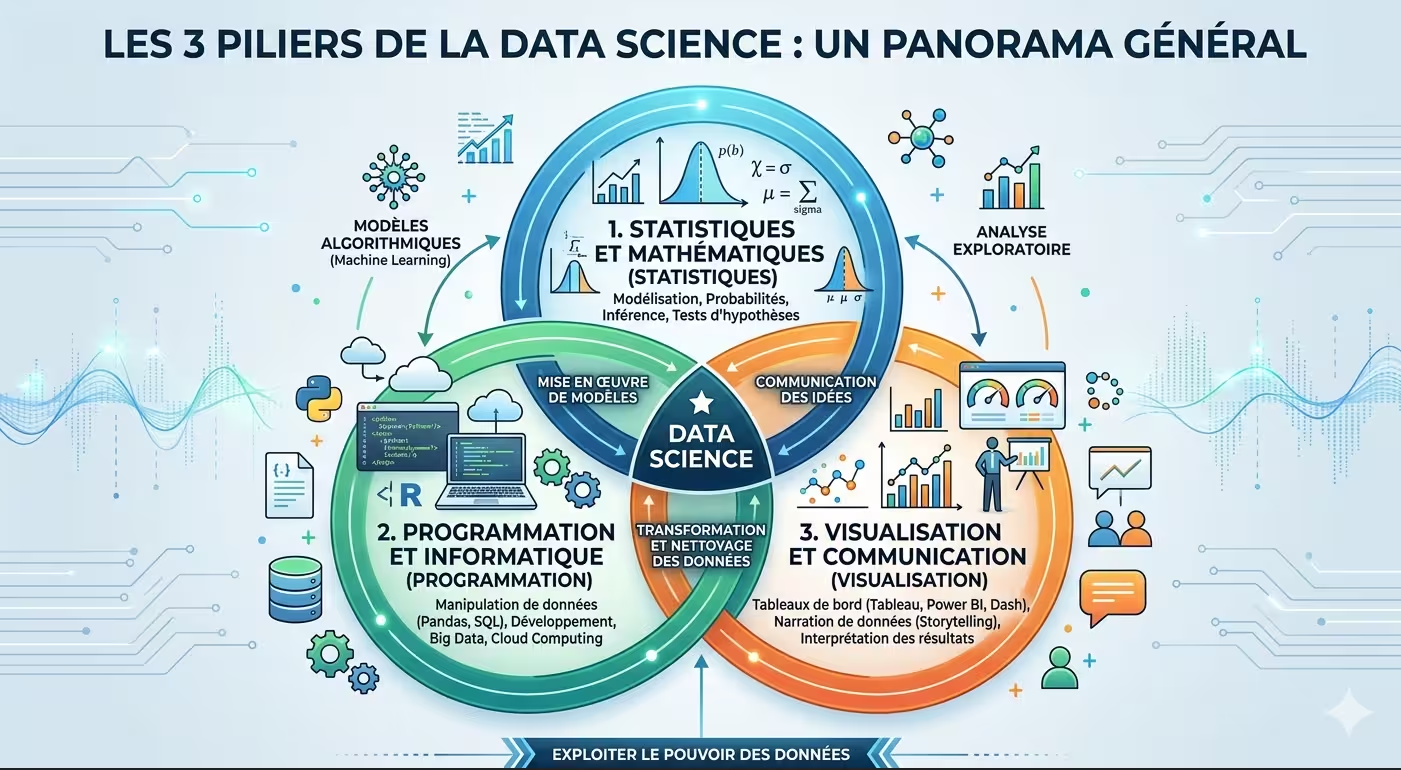

La Data Science est la discipline qui transforme les données en connaissance exploitable. Elle combine statistiques, programmation, visualisation et compréhension métier pour analyser, expliquer et parfois prédire des phénomènes à partir de données. En 2026, la Data Science n’est plus une option stratégique – c’est une nécessité opérationnelle. Mais derrière les algorithmes et les modèles sophistiqués se cache un processus rigoureux qui commence bien avant le Machine Learning. Ce guide complet vous accompagne de la définition aux cas pratiques, en passant par les outils, les méthodes et les pièges à éviter.

Infographie n°1 – Panorama de la Data Science : les trois piliers (statistiques, programmation, visualisation) et leurs interactions.

La Data Science est une discipline interdisciplinaire qui consiste à extraire des connaissances utiles à partir de données. Elle combine statistiques, informatique, analyse exploratoire des données (EDA), Machine Learning et compréhension métier afin de transformer des données brutes en informations exploitables.

Contrairement à une idée répandue, la Data Science ne consiste pas uniquement à entraîner des modèles de Machine Learning. Une grande partie du travail concerne la compréhension des données, leur nettoyage, leur exploration, leur visualisation et leur interprétation. Comme nous le verrons plus loin, l’EDA est souvent l’étape la plus chronophage et la plus critique – sans elle, aucun modèle fiable ne peut être construit.

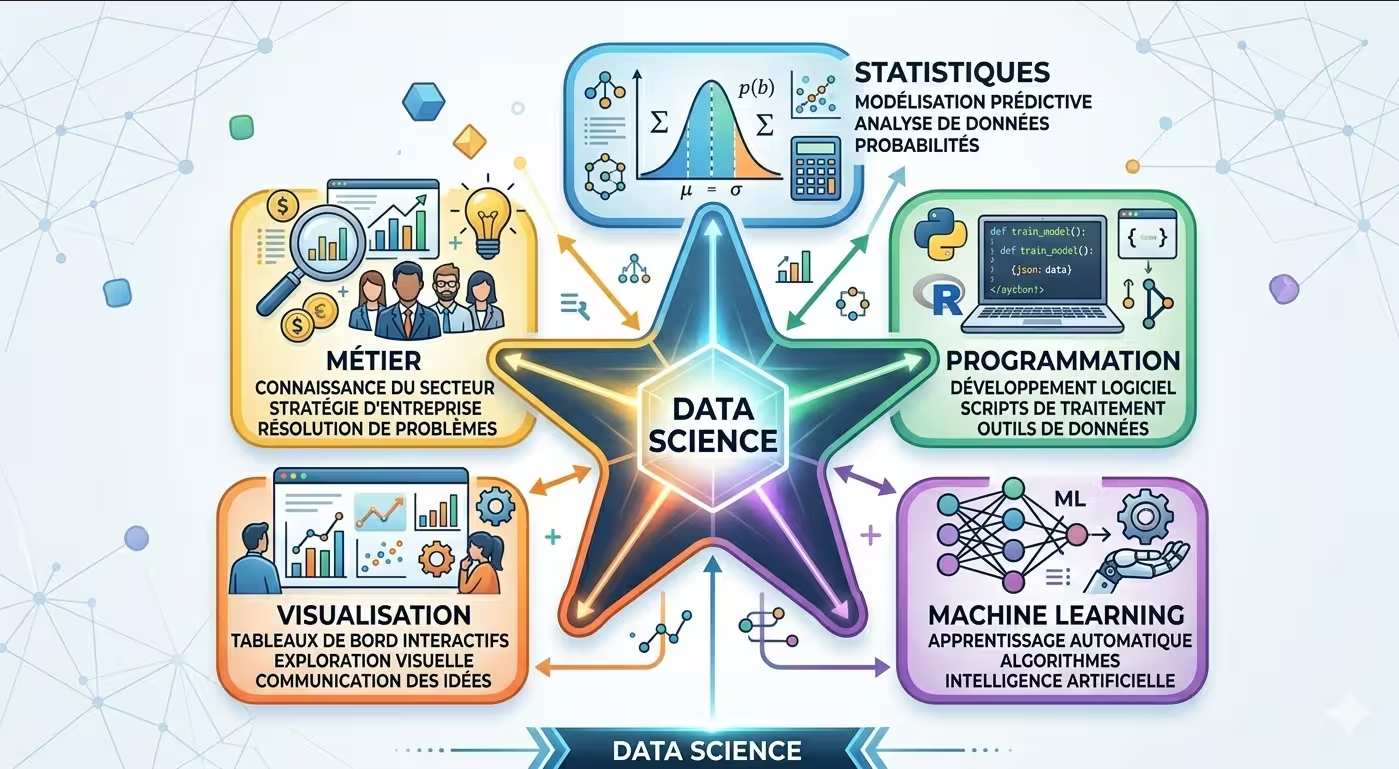

La Data Science se distingue de la simple analyse de données par son ambition prédictive et prescriptive. Là où un data analyst décrit ce qui s’est passé (« reporting »), le data scientist cherche à comprendre pourquoi (« diagnostic »), à anticiper ce qui va se passer (« prédiction »), et parfois à recommander une action (« prescription »). Cette dimension prospective explique pourquoi la Data Science est devenue si stratégique pour les entreprises.

Dans beaucoup de projets, 60 à 80 % du travail consiste à comprendre et préparer les données, bien avant de construire un modèle prédictif. Un guide dédié à l’IA générative et à la donnée approfondit cette dimension pour les approches modernes.

Infographie n°2 – Les cinq composantes clés de la Data Science : statistiques, programmation, machine learning, visualisation, métier.

La croissance massive des données produites par les entreprises, les capteurs, les plateformes numériques et les systèmes informatiques a profondément changé la manière de prendre des décisions. En 2026, le volume mondial de données dépasse les 175 zettaoctets. Face à cette abondance, la Data Science joue un rôle central : elle permet de transformer de grandes quantités de données en informations utiles, de détecter des tendances invisibles à l’œil humain et d’anticiper certains phénomènes. Pour une vision complémentaire sur l’exploitation stratégique des données, consultez notre analyse du lien entre IA et prise de décision.

Les organisations utilisent la Data Science pour mieux comprendre leurs clients, optimiser leurs opérations, détecter des biais potentiels ou encore améliorer leurs produits et services. Dans le secteur public, elle aide à optimiser les ressources et à détecter les fraudes fiscales. Dans la santé, elle accélère le diagnostic et la recherche de nouveaux médicaments. La Data Science est devenue un levier de compétitivité incontournable.

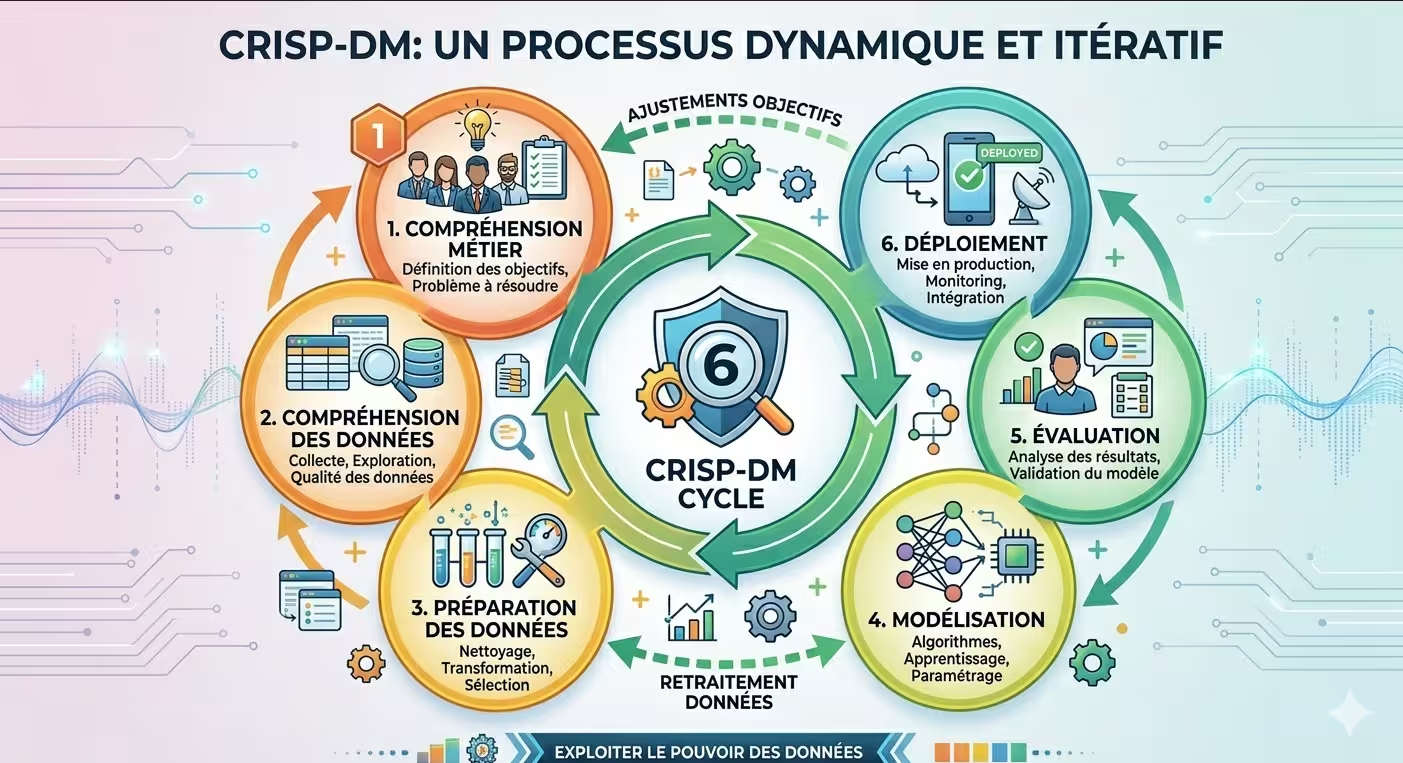

Un projet de Data Science suit généralement plusieurs étapes structurées. Même si les outils et méthodes peuvent varier, la logique globale reste relativement stable. La méthodologie la plus répandue est CRISP-DM (Cross Industry Standard Process for Data Mining), créée à la fin des années 1990 et toujours d’actualité.

Cette approche est souvent décrite par la méthodologie CRISP-DM (Cross Industry Standard Process for Data Mining), qui reste l’un des cadres les plus utilisés dans l’industrie. Pour les projets plus récents, l’intégration de l’IA générative dans les workflows Data Science est une piste explorée par les entreprises matures.

Une particularité importante : le processus n’est pas linéaire. On revient souvent en arrière (par exemple, après l’EDA, on peut décider de collecter de nouvelles données ou de modifier le nettoyage). L’itération est au cœur de la Data Science.

La Data Science ne commence pas par les algorithmes. Elle commence par une question métier claire. La meilleure modélisation du monde ne sert à rien si elle ne répond pas à un vrai besoin.

Infographie n°3 – Les six étapes du processus CRISP-DM, avec les boucles de rétroaction itératives.

L’analyse exploratoire des données (EDA) est la phase d’un projet Data Science où l’on étudie les données sous tous leurs angles : distribution, valeurs manquantes, relations entre variables, points aberrants. C’est l’étape la plus créative et la plus cruciale. C’est aussi celle qui permet d’éviter des erreurs coûteuses en aval. Pour aller en profondeur, découvrez notre guide complet de l’EDA.

Lors de l’EDA, on cherche à répondre à des questions fondamentales :

Les outils d’EDA incluent des statistiques descriptives (moyenne, médiane, écart-type), des graphiques (histogrammes, boxplots, scatter plots), et des tests statistiques. Une EDA bien menée évite de construire des modèles sur des données non nettoyées et permet de choisir la méthode de modélisation la plus adaptée. Elle est systématiquement documentée dans les bonnes pratiques de structuration de projet ML.

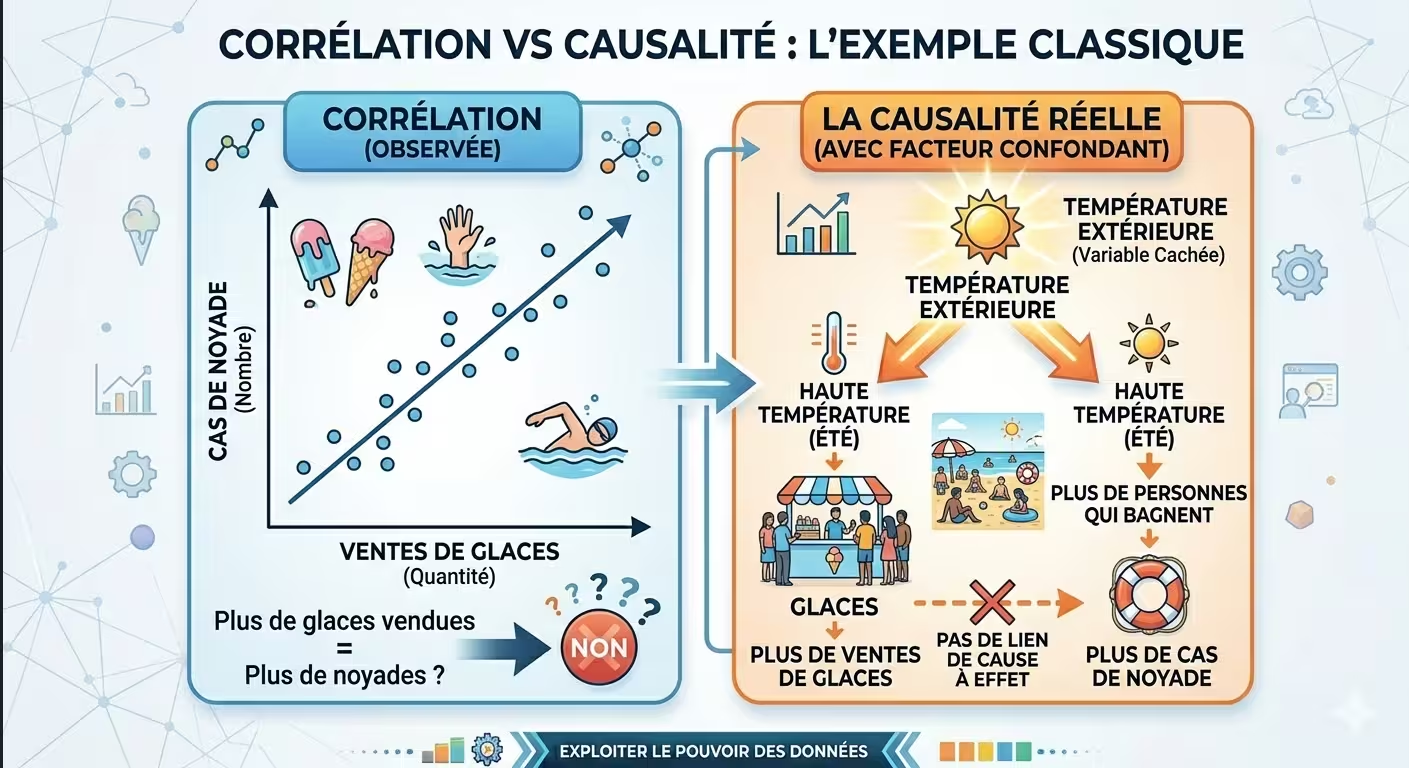

L’une des erreurs les plus fréquentes en analyse de données est de confondre corrélation et causalité. Une corrélation forte entre deux variables signifie qu’elles varient ensemble, mais ne prouve pas qu’une variable est la cause de l’autre. Par exemple, les ventes de glaces et les noyades sont corrélées, mais le facteur causal est la température (il fait chaud → plus de glaces vendues et plus de baignades). Pour une présentation détaillée, consultez notre explication complète sur le calcul et l’interprétation de la corrélation ainsi que notre différence entre corrélation et causalité.

Pour démontrer une relation causale, des méthodes spécifiques sont nécessaires (variables instrumentales, tests de causalité, expériences contrôlées). Dans un cadre observationnel (pas de randomisation possible), l’inférence causale est un domaine complexe. Les méthodes d’inférence causale avec Python et R méritent une attention particulière dans les projets où la cause est plus importante que la prédiction.

Infographie n°4 – Corrélation vs causalité : exemples et contre-exemples pour ne plus confondre.

La Data Science mobilise de nombreuses méthodes statistiques et algorithmiques. Le choix de la technique dépend du type de problème et de la nature des données disponibles (supervisées ou non supervisées, continues ou catégorielles).

Ces techniques peuvent être combinées avec des méthodes de Machine Learning plus avancées lorsque la complexité des données augmente. Pour un cas pratique de modèle de classification, intéressez-vous à la prédiction du churn client avec Python.

La régression est l’une des méthodes les plus fondamentales en Data Science. Elle permet de prédire une valeur numérique (prix, température, durée, etc.) à partir d’autres variables. La régression linéaire est le point de départ incontournable. Si vous débutez, notre introduction à la régression linéaire multiple vous guidera pas à pas.

Dans les projets avancés, on utilise des régressions régularisées (Ridge, Lasso) pour éviter le sur-apprentissage (overfitting), ou non paramétriques (arbres de décision, forêts aléatoires) pour capturer des relations non linéaires. Découvrez comment appliquer la régression à des cas d’usage concrets.

La classification (apprentissage supervisé) attribue une étiquette à une observation : un email est-il un spam ou non ? Un client va-t-il se désabonner (churn) ou rester ? Les algorithmes classiques incluent la régression logistique, les arbres de décision, les forêts aléatoires, les SVM et les réseaux de neurones.

Le clustering (apprentissage non supervisé) cherche à regrouper des observations similaires sans étiquettes préexistantes. Les applications typiques : segmentation clients, regroupement de documents, analyse de similarité. L’algorithme le plus célèbre est K-Means, mais on utilise aussi DBSCAN ou le clustering hiérarchique.

Un cas pratique de clustering est proposé dans notre analyse de sentiments sur les avis Amazon.

La Data Science s’appuie sur un écosystème technologique riche. Certains outils sont devenus incontournables dans la pratique quotidienne.

| Type | Exemples | Usage principal |

|---|---|---|

| Langages | Python, R, SQL | Analyse et modélisation – comparatif Python vs R |

| Bibliothèques Python | pandas, numpy, scikit-learn, tensorflow, pytorch | Manipulation, ML, deep learning |

| Bibliothèques R | dplyr, ggplot2, tidyr, caret, randomForest | Manipulation, visualisation, statistiques |

| Visualisation | Matplotlib, Seaborn, Plotly, ggplot2, Tableau | Graphiques et exploration – comparatif Power BI vs Tableau |

| Environnements | Jupyter Notebook, RStudio, VS Code, Google Colab | Expérimentation et prototypage |

Le choix entre Python et R dépend souvent du secteur : Python domine l’industrie et le deep learning, tandis que R reste très présent dans la recherche statistique et le milieu académique. D’autres langages comme Julia ou Scala s’imposent pour le calcul intensif (big data). La pratique montre que les data scientists utilisent souvent plusieurs outils (Python pour le prototypage, SQL pour l’extraction, Tableau pour la visualisation).

Un aspect essentiel de la Data Science est la capacité à communiquer les résultats. Une analyse très sophistiquée peut rester inutile si elle n’est pas compréhensible par les décideurs. La visualisation de données permet de transformer des résultats statistiques complexes en représentations intuitives. Pour approfondir, consultez notre guide sur la puissance des visualisations et comment réussir une présentation des données.

Les bonnes pratiques de visualisation incluent : choisir le type de graphique adapté aux données (histogramme, barres, nuage de points, boîte à moustaches), ne pas surcharger le graphique, ajouter des titres et des légendes claires, et raconter une histoire (data storytelling).

Une bonne visualisation doit rendre l’information plus claire, pas simplement plus esthétique. Le mensonge par graphique existe : les échelles tronquées, les couleurs trompeuses, les omissions.

D’autres secteurs émergent : l’agriculture de précision (prédiction des rendements), l’énergie (optimisation des réseaux électriques), les transports (prédiction d’affluence, tarification dynamique), et le secteur public (optimisation des tournées de collecte, détection de fraudes fiscales). La Data Science n’a de limites que celles des données disponibles et des questions posées.

Un exemple concret permet de mieux comprendre l’articulation entre SQL et Python. Prenons le cas d’un data scientist qui souhaite analyser les ventes d’une entreprise :

SELECT categorie, SUM(ventes), DATE_TRUNC(‘month’, date) FROM transactions GROUP BY categorie, date_truncPour mettre en pratique, explorez nos cas concrets : nettoyage d’un fichier CSV avec SQL et analyse des ventes avec Window Functions SQL. La complémentarité SQL (extraction) / Python (analyse) est centrale en Data Science.

| Métier | Responsabilité principale | Compétences clés |

|---|---|---|

| Data Scientist | Analyse et modélisation des données | Stats, ML, Python, communication |

| Data Engineer | Infrastructure et pipelines de données – pipelines ETL/ELT | SQL, Spark, cloud |

| Data Analyst | Exploration et reporting – EDA détaillée | SQL, Excel, visualisation |

| ML Engineer | Déploiement des modèles (MLOps) | DevOps, Python, cloud, API |

Une enquête récente montre que les data scientists passent environ 45 % de leur temps sur la préparation des données (nettoyage, ETL) et seulement 20 % sur le vrai model building. Cette réalité est souvent méconnue des débutants.

Malgré son potentiel, la Data Science présente plusieurs défis.

Une analyse avancée ne peut pas compenser des données de mauvaise qualité. Garbage In, Garbage Out.

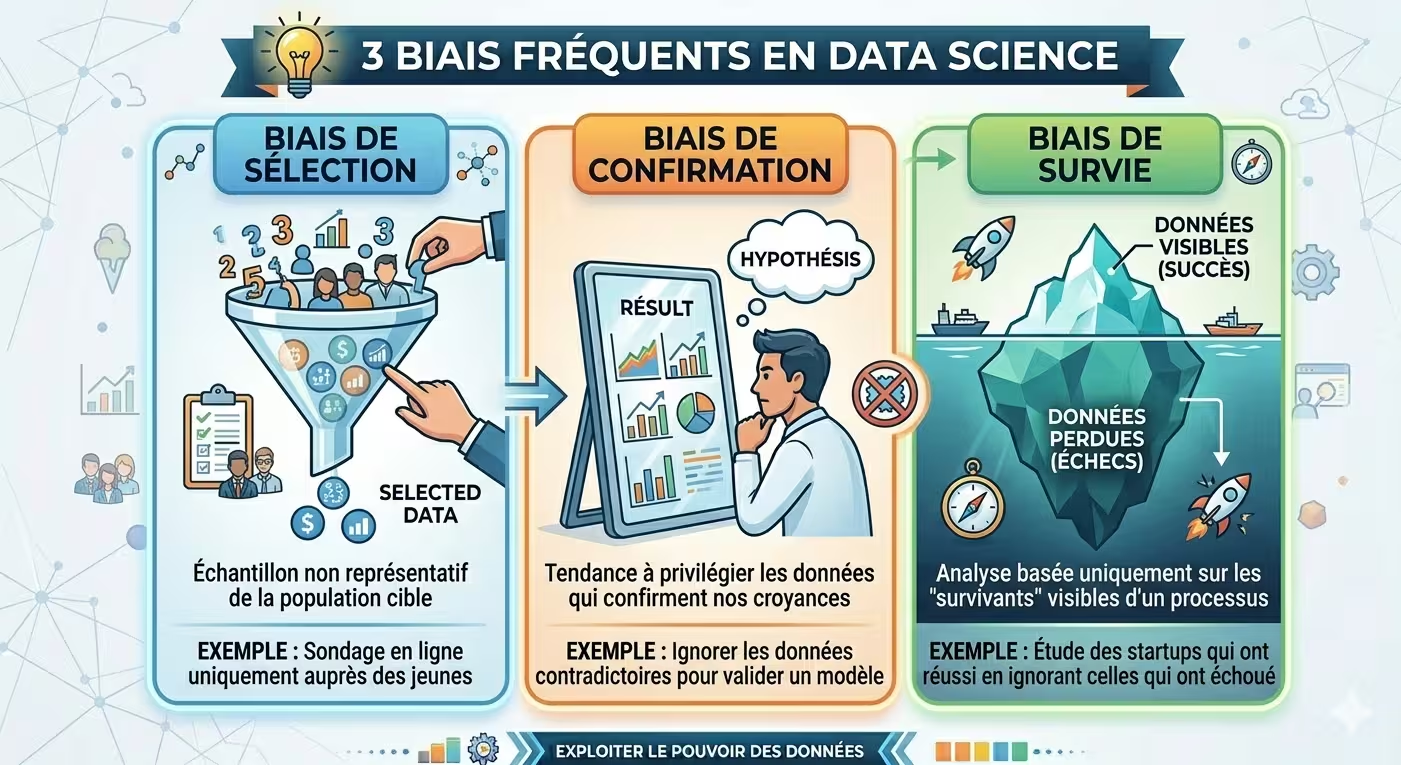

Même les data scientists expérimentés peuvent introduire des biais :

Un complément incontournable : notre analyse des biais cognitifs en analyse de données. Les biais peuvent aussi être amplifiés par les modèles (cf. biais algorithmiques et risques d’injustice).

Infographie n°5 – Les biais les plus fréquents en analyse de données : sélection, confirmation, survie, et comment les éviter.

Plusieurs tendances structurent l’évolution de la discipline :

La Data Science évolue vers des systèmes plus industrialisés, où les modèles et les analyses sont intégrés directement dans les produits numériques. La généralisation de l’IA générative en entreprise créera des passerelles entre Data Science classique et nouveaux usages.

La Data Analysis se concentre surtout sur l’analyse descriptive (reporting, tableaux de bord), tandis que la Data Science inclut aussi la modélisation, la prédiction et le Machine Learning. Un data scientist a généralement des compétences étendues en statistiques et en programmation.

Les bases statistiques sont importantes (probabilités, tests d’hypothèses, régression), mais de nombreux outils permettent aujourd’hui de se concentrer davantage sur l’interprétation et la compréhension métier. Le niveau de mathématiques requis dépend du métier : data analyst vs ML engineer.

Python est recommandé pour la polyvalence et la richesse des bibliothèques (pandas, scikit-learn, tensorflow). R reste pertinent pour les statisticiens. SQL est indispensable dans tous les cas.

Oui, la demande reste très forte, même si elle n’est plus aussi frénétique qu’en 2020-2022. Les salaires sont attractifs, et les missions sont variées. L’évolution vers des postes de lead data scientist ou de MLOps engineer est naturelle après quelques années d’expérience.

La Data Science occupe aujourd’hui une place centrale dans l’exploitation des données. Elle permet de transformer des informations brutes en connaissances exploitables, d’améliorer les décisions et de créer de nouvelles capacités analytiques. Sa valeur dépend autant de la qualité des données et de la compréhension métier que de la sophistication des algorithmes utilisés. Dans un monde où la quantité de données continue de croître, la capacité à analyser, interpréter et communiquer devient une compétence stratégique pour les organisations.

Que vous soyez débutant ou professionnel confirmé, la formation continue est indispensable. Pour approfondir votre maîtrise de la Data Science, explorez notre guide pratique de formation à l’IA en entreprise.