Apprentissage automatique : les bases

Une introduction aux concepts fondamentaux du machine learning.

Prédire, expliquer, relier des variables entre elles. Derrière ces intentions se cache un modèle simple en apparence, mais fondamental : la régression linéaire multiple. Une méthode qui tente, avec une certaine humilité mathématique, de capturer la réalité à travers des relations linéaires.

La régression linéaire multiple est une méthode statistique permettant de modéliser la relation entre une variable dépendante et plusieurs variables explicatives. Autrement dit, il ne s’agit plus de comprendre une relation simple entre deux variables, mais un ensemble d’influences, parfois complémentaires, parfois contradictoires.

Ce modèle repose sur une idée presque naïve : le monde peut être approximé par des relations linéaires. Une simplification, certes. Mais une simplification souvent utile.

On pourrait dire qu’il s’agit d’un compromis. Entre précision et interprétabilité. Entre complexité et lisibilité. Dans un contexte où les modèles de machine learning sont souvent perçus comme des « boîtes noires », la régression linéaire multiple reste un outil privilégié pour comprendre les phénomènes sous-jacents.

Elle est utilisée aussi bien en science économique, en épidémiologie, en marketing qu’en analyse de données industrielles. Son atout principal : elle permet de quantifier l’impact de chaque facteur tout en contrôlant les autres influences. On dit alors que les coefficients représentent un effet « toutes choses égales par ailleurs » (ceteris paribus).

Imaginons une situation simple. Le prix d’un logement dépend de plusieurs facteurs : surface, localisation, nombre de pièces, ancienneté. Aucun de ces éléments ne suffit seul à expliquer le prix.

La régression linéaire multiple tente de combiner ces variables pour produire une estimation.

Elle attribue un poids à chaque variable. Un coefficient. Une importance relative.

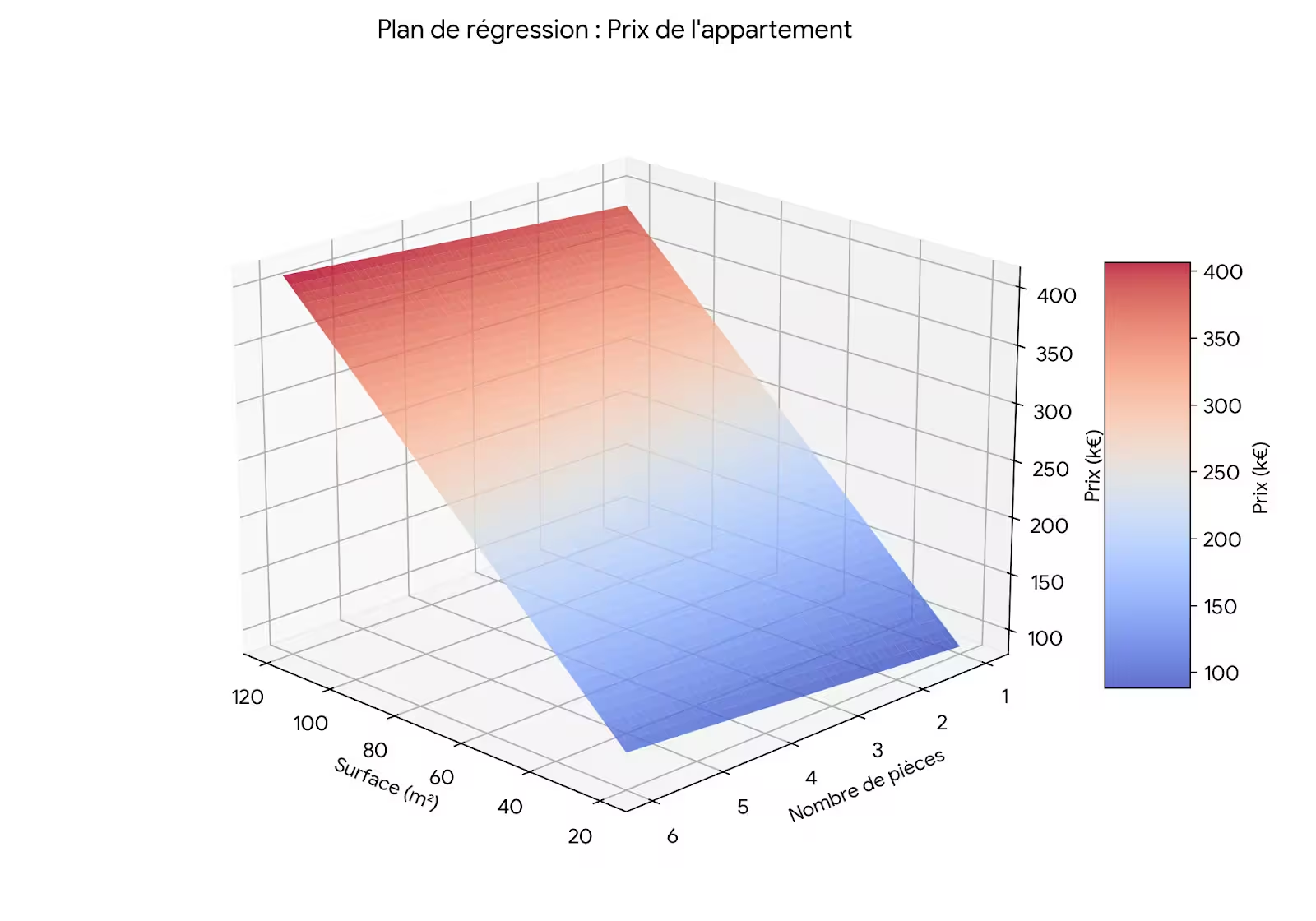

Prenons un exemple chiffré. Supposons que l’on estime le prix d’un appartement (en milliers d’euros) avec deux variables : la surface (m²) et le nombre de pièces. Le modèle pourrait être :

Prix = 20 + 3 × Surface + 5 × Pièces

Selon cette équation, chaque mètre carré supplémentaire augmente le prix de 3 000 €, et chaque pièce supplémentaire (toutes choses égales par ailleurs) augmente le prix de 5 000 €. L’intercept (20 000 €) correspond au prix de base lorsque la surface et le nombre de pièces sont nuls — une valeur qui n’a pas de sens concret mais qui permet de caler la droite.

Ce modèle permet donc de quantifier l’influence de chaque facteur. Et c’est peut-être là son intérêt principal : comprendre autant que prédire.

Puisque le prix dépend de deux variables (surface et nombre de pièces), le résultat n'est plus une simple droite, mais un plan 3D.

Ce que montre le graphique :

La régression linéaire multiple s’exprime par une équation relativement simple :

Y = β₀ + β₁X₁ + β₂X₂ + ... + βₙXₙ + ε

Dans cette équation :

Cette formule, en apparence simple, cache en réalité un processus d’optimisation. Les coefficients sont estimés de manière à minimiser l’erreur entre les prédictions et les observations réelles. La méthode standard est celle des moindres carrés ordinaires (MCO) : on cherche à minimiser la somme des carrés des résidus :

min Σ (Yᵢ – Ŷᵢ)² = min Σ (Yᵢ – (β₀ + β₁X₁ᵢ + ... + βₙXₙᵢ))²

Autrement dit, le modèle cherche la meilleure droite — ou plutôt, le meilleur hyperplan — qui s’ajuste aux données. La solution analytique existe sous forme matricielle : β = (XᵀX)⁻¹XᵀY, sous réserve que la matrice XᵀX soit inversible (absence de colinéarité parfaite).

Chaque coefficient β représente l’effet d’une variable sur la variable cible, toutes choses égales par ailleurs.

C’est une précision importante. Car dans un modèle multiple, les variables interagissent indirectement.

Mais cette interprétation peut devenir délicate lorsque les variables sont corrélées entre elles. On parle alors de multicolinéarité.

Dans ces situations, les coefficients peuvent devenir instables, voire trompeurs. Par exemple, si deux variables sont très corrélées, le modèle aura du mal à attribuer l’effet à l’une ou à l’autre. Les coefficients peuvent alors prendre des valeurs extrêmes (positives ou négatives) sans signification réaliste.

Pour évaluer la significativité statistique de chaque coefficient, on utilise le test de Student (t‑test) et la p‑value associée. Une p‑value inférieure à 0,05 indique généralement que la variable a un effet statistiquement détectable.

Enfin, pour comparer l’importance relative des variables mesurées dans des unités différentes, on recourt aux coefficients standardisés (bêta), qui expriment l’effet d’un écart‑type de la variable explicative sur la variable réponse.

La régression linéaire multiple est utilisée dans de nombreux domaines. Voici des exemples détaillés :

Analyse de l’impact de plusieurs variables sur la croissance du PIB : taux d’investissement, niveau d’éducation, ouverture commerciale, stabilité politique. Le modèle permet de quantifier la contribution de chaque facteur, en isolant les effets.

Évaluation de l’effet des campagnes publicitaires, du prix, de la saisonnalité, de la présence en points de vente sur les ventes d’un produit. On peut ainsi déterminer quel levier est le plus efficace et ajuster le mix marketing.

Étude des facteurs influençant la tension artérielle : âge, indice de masse corporelle, consommation de sel, activité physique, antécédents familiaux. La régression aide à identifier les facteurs de risque ajustés des autres variables.

Estimation des prix en fonction de caractéristiques multiples : surface, nombre de chambres, étage, présence d’un ascenseur, proximité des transports, année de construction. Ces modèles sont utilisés par les agences et les évaluateurs pour l’estimation de biens.

Prédiction de la qualité de l’air à partir des émissions industrielles, du trafic routier, des conditions météorologiques, etc. La régression permet de quantifier les contributions de chaque source de pollution.

Dans chacun de ces cas, le modèle offre une lecture structurée des relations entre variables et peut servir de base à la prise de décision.

La régression linéaire multiple repose sur plusieurs hypothèses théoriques, dites hypothèses de Gauss‑Markov, qui garantissent les propriétés optimales des estimateurs MCO (non‑biais, variance minimale).

Ces hypothèses sont rarement parfaitement vérifiées. Mais elles servent de cadre, de repère. Dans la pratique, des écarts modérés peuvent être tolérés, mais des violations graves remettent en cause la fiabilité du modèle.

Avant d’utiliser un modèle de régression, il est indispensable de réaliser des diagnostics pour vérifier la validité des hypothèses et la qualité de l’ajustement.

Les résidus (différences entre valeurs observées et prédites) doivent être examinés :

Certaines observations peuvent avoir un effet disproportionné sur les coefficients. Des outils comme la distance de Cook ou la leverage permettent de les identifier. Il est important de les examiner pour éviter qu’elles ne biaisent le modèle.

Elle est détectée par le Facteur d’inflation de la variance (VIF). Un VIF > 10 (ou parfois > 5) indique une colinéarité forte entre une variable et les autres. Des solutions existent : suppression d’une variable redondante, régularisation, ou combinaison (PCA).

Malgré sa simplicité, la régression linéaire multiple présente plusieurs limites.

Le monde réel est rarement linéaire. Des relations curvilignes, des interactions complexes entre variables ou des effets de seuil peuvent échapper au modèle.

Les variables explicatives peuvent être corrélées entre elles, rendant instables les coefficients et difficiles à interpréter.

Un modèle avec trop de variables (par rapport au nombre d’observations) peut s’ajuster au bruit plutôt qu’à la structure réelle, et mal généraliser.

Les valeurs extrêmes peuvent influencer fortement les coefficients estimés.

Oublier une variable importante (confondante) peut entraîner un biais de coefficient. Par exemple, si l’on modélise le salaire en fonction du diplôme sans inclure l’expérience, le coefficient du diplôme sera biaisé par l’effet de l’expérience.

La régression linéaire multiple n’est pas une méthode causale. Même avec un bon R², on ne peut pas conclure à une relation de cause à effet sans hypothèses supplémentaires (design expérimental, variables instrumentales, etc.).

Ces limites rappellent une chose : le modèle n’est qu’une approximation.

La régression linéaire multiple reste une base, mais elle évolue.

Techniques comme Ridge (L2) ou Lasso (L1) pour stabiliser les coefficients, gérer la multicolinéarité et la sélection automatique de variables. Ces approches sont particulièrement utiles lorsque le nombre de variables est élevé par rapport au nombre d’observations.

La régression linéaire est souvent une première étape avant des modèles plus complexes (arbres, réseaux de neurones). Elle sert de baseline pour évaluer l’apport de modèles non linéaires.

Dans un monde dominé par des modèles complexes, la simplicité devient presque une force. Les régulateurs (finance, santé) exigent souvent des modèles interprétables, ce qui maintient la régression linéaire comme outil de référence.

Les modèles linéaires généralisés (GLM) permettent d’étendre la régression à des variables cibles non gaussiennes (binaire, comptage, etc.).

Lorsque les hypothèses de la régression linéaire ne sont pas satisfaites, d’autres méthodes peuvent être envisagées :

Le choix du modèle dépend du contexte, de l’objectif (prédiction vs interprétation) et des contraintes de données.

La régression simple utilise une seule variable explicative, tandis que la régression multiple en utilise plusieurs pour expliquer la variable cible. La régression multiple permet de contrôler l’effet de plusieurs facteurs simultanément.

Elle permet de modéliser des phénomènes influencés par plusieurs facteurs et d’interpréter l’impact de chaque variable, toutes choses égales par ailleurs. Elle est simple, rapide, et fournit des coefficients interprétables.

Non. Elle suppose des relations linéaires, une variance constante, l’indépendance des résidus, et l’absence de multicolinéarité parfaite. Si ces hypothèses sont trop violées, d’autres modèles peuvent être plus appropriés.

Des indicateurs comme le VIF (Variance Inflation Factor) permettent de mesurer la corrélation entre variables explicatives. Un VIF supérieur à 5 ou 10 indique un problème. Des solutions incluent la suppression de variables redondantes ou l’utilisation de régularisation.

Le R² est la proportion de la variance de Y expliquée par le modèle. Il est compris entre 0 et 1. Un R² élevé ne garantit pas un bon modèle prédictif, ni une relation causale. Le R² ajusté est préférable pour comparer des modèles avec un nombre de variables différent.

Oui, en transformant les catégories en variables indicatrices (dummy coding). On obtient alors des coefficients qui mesurent l’écart par rapport à une catégorie de référence.

On peut les détecter avec la distance de Cook ou le levier (leverage). Ensuite, on peut soit les exclure après vérification, soit utiliser des méthodes robustes (M‑estimateurs) ou la régularisation pour réduire leur influence.