L'intelligence artificielle est devenue un pilier fondamental de notre ère numérique. Elle influence les décisions dans des domaines aussi variés que la santé, l'éducation, la finance, et même la justice. Bien que l'IA ouvre la voie à des progrès technologiques majeurs, elle soulève également des préoccupations importantes concernant les droits humains. C'est dans ce contexte qu'émerge la question cruciale de la réglementation de l'IA.

L'IA est une technologie extrêmement puissante capable de transformer la société dans des directions positives, mais également de causer des dérives dangereuses si elle est mal utilisée. La réglementation de l'IA vise à encadrer son développement et son utilisation afin de prévenir les abus, de garantir la transparence, et de protéger les droits fondamentaux des individus : droit à la vie privée, à l'égalité, à la non-discrimination, et à la liberté.

En l'absence de cadres juridiques stricts, les entreprises et les gouvernements peuvent utiliser l'IA d'une manière qui porte atteinte à ces droits. Par exemple, des systèmes de reconnaissance faciale peuvent être utilisés pour une surveillance massive des populations, tandis que des algorithmes biaisés peuvent mener à des décisions discriminatoires en matière d'emploi, de crédit ou de justice pénale.

Pour approfondir l'ensemble des enjeux éthiques et réglementaires liés à l'IA, consultez notre guide complet : Éthique, société et réglementation de l'IA – guide 2026.

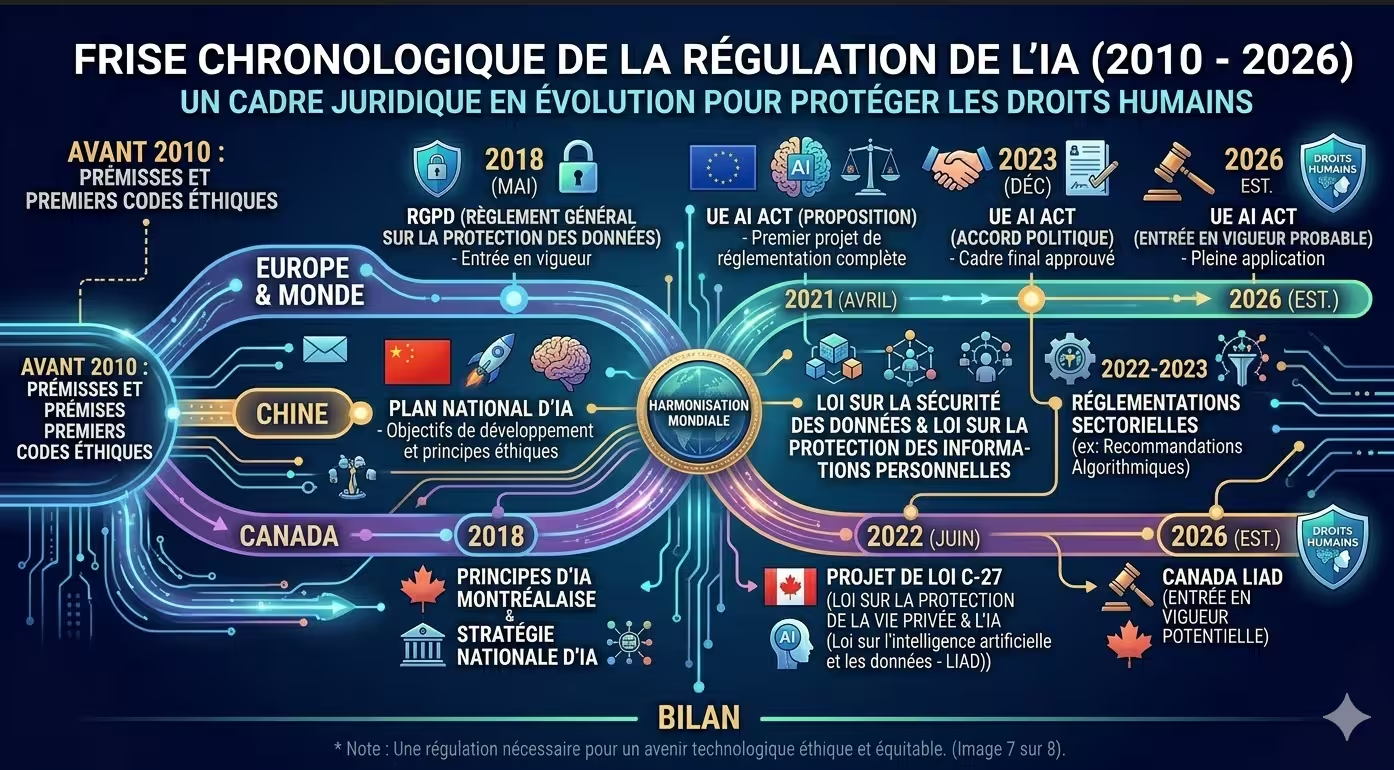

La prise de conscience autour des risques posés par l'IA a émergé au début des années 2000, lorsque les premiers systèmes algorithmiques ont commencé à influencer des décisions humaines importantes. Les questions de biais, de confidentialité des données et d'automatisation ont mis en lumière les lacunes réglementaires.

L'absence de régulation appropriée peut entraîner des conséquences graves pour les droits humains, déjà observées dans plusieurs cas concrets :

| Pays/Organisation | Reglementation/Initiative | Date | Impact principal |

|---|---|---|---|

| Union europeenne | AI Act (Artificial Intelligence Act) | 2024 (adoption) | Classification des IA par risque, interdiction des pratiques inacceptables (notation sociale, manipulation subliminale), obligations pour les IA à haut risque |

| Union europeenne | RGPD (General Data Protection Regulation) | 2018 | Cadre mondial de reference pour la protection des donnees personnelles, droit a l'information, a l'opposition, a l'effacement |

| Etats-Unis | Blueprint for an AI Bill of Rights | 2022 (non contraignant) | Principes pour une IA securisee, equitable, transparente, avec possibilite de recours et alternatives humaines |

| Etats-Unis (local) | Interdictions locales de la reconnaissance faciale | San Francisco (2019), Boston, New York, Oakland | Premieres interdictions municipales de l'utilisation de la reconnaissance faciale par la police et les agences municipales |

| Chine | Loi sur la securite des algorithmes de recommandation (2022), Loi sur l'IA generative (2023) | 2022-2023 | Obligation de transparence, de marquage des contenus generes, de modeles "conformes aux valeurs socialistes" |

| Canada | Artificial Intelligence and Data Act (AIDA) | projet 2024-2026 | Approche par risque inspiree de l'AI Act, avec un accent sur la protection des consommateurs |

| Royaume-Uni | Approche par "principes" (pas de loi specifique initiale) | 2023+ | Creation d'un "taskforce" et adaptation des regulateurs sectoriels (competition, marche, communication) |

| France | Loi pour une Republique numerique (2016), transposition RGPD, participation a l'AI Act | 2016-2024 | Creation d'un droit a l'information sur les algorithmes publics (depuis 2016), application de l'AI Act |

Pour assurer que l'IA sert les intérêts de tous, plusieurs initiatives sont en cours pour développer des cadres éthiques et juridiques internationaux. L'UNESCO a adopté en 2021 une "Recommandation sur l'éthique de l'IA", premier texte mondial de ce type. L'OCDE, le G7, le G20 et l'ONU travaillent à l'harmonisation des régulations pour éviter la fragmentation et les "paradis réglementaires". La régulation de l'IA ne signifie pas freiner l'innovation. Elle permet de créer un environnement de confiance, où les utilisateurs et les développeurs peuvent bénéficier des avantages de l'IA sans porter atteinte aux droits fondamentaux.

Les défis à venir incluent : la mise en œuvre effective de l'AI Act dans les 27 États membres, l'adaptation aux évolutions rapides des technologies (IA générative, IA agentique), la convergence internationale des normes, et l'émergence de nouvelles questions comme la "personnalité juridique" des IA ou la responsabilité civile en cas de dommage causé par un système autonome.

La réglementation de l'IA est devenue indispensable pour protéger les droits humains dans un monde de plus en plus dominé par la technologie. En garantissant que les algorithmes sont transparents, justes, audités, et respectueux de la vie privée, nous pouvons tirer le meilleur parti de cette technologie sans tomber dans les pièges d'une IA non contrôlée. La mise en place de lois adaptées – aux niveaux européen (AI Act), national et international – est donc un enjeu majeur pour l'avenir de nos démocraties.