Sommaire

- 1. Qu’est-ce que le streaming de données ?

- 2. Pourquoi le streaming est-il essentiel ?

- 3. Batch vs Streaming : les différences

- 4. Les principales technologies de streaming

- 5. Architecture type d’un pipeline streaming

- 6. Cas d’usage concrets

- 7. Défis et bonnes pratiques

- 8. Tendances 2026

- 9. FAQ

- Conclusion

- Articles connexes

1. Qu’est-ce que le streaming de données ?

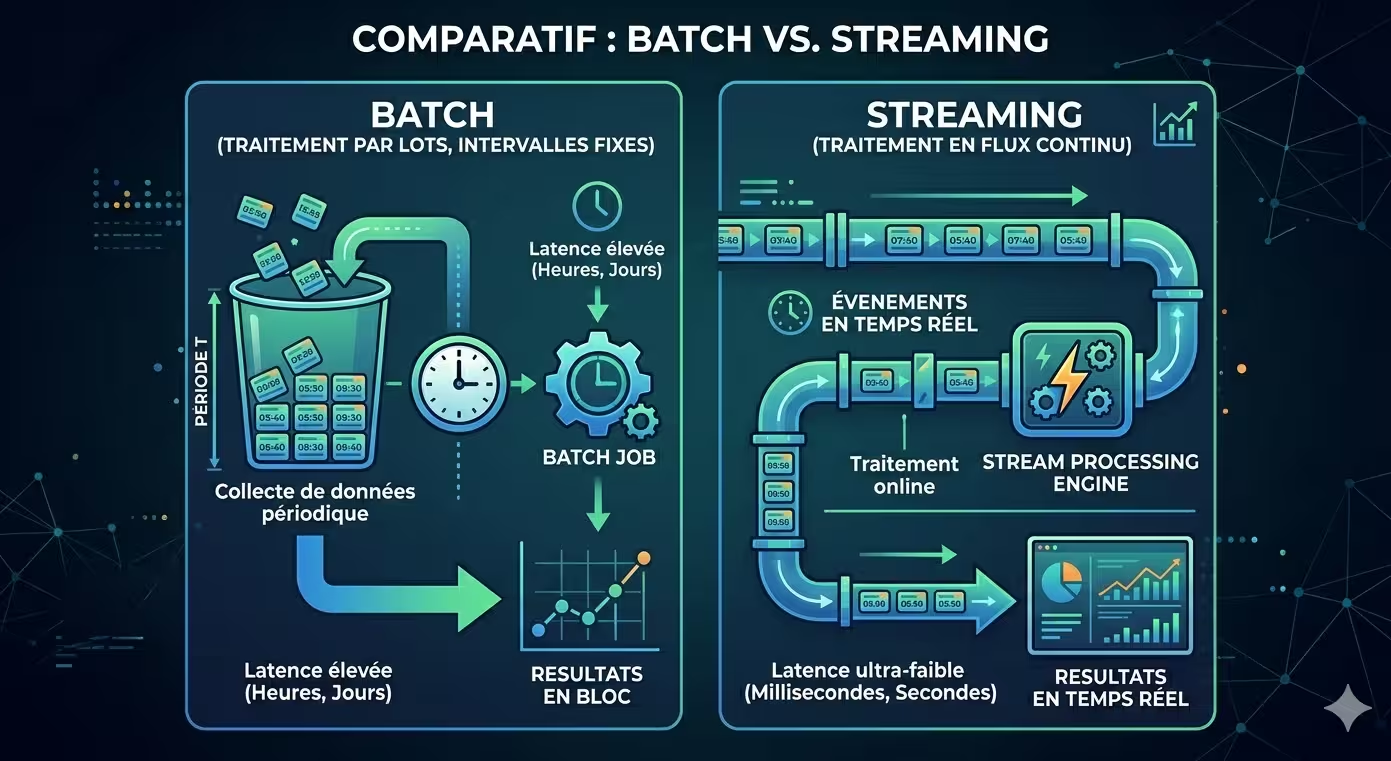

Le streaming de données (ou data streaming) est une technique de traitement de données qui consiste à traiter des flux continus de données au fur et à mesure de leur arrivée, avec une latence très faible (de la milliseconde à la seconde). Contrairement au traitement par lots (batch) qui traite des volumes de données à intervalles réguliers (toutes les heures, tous les jours), le streaming réagit en temps réel.

Définition simple :

Le streaming, c’est comme regarder une rivière couler : vous voyez chaque goutte d’eau passer et vous pouvez réagir immédiatement. Le batch, c’est comme vider un lac une fois par jour : vous avez une vue d’ensemble, mais vous perdez la dynamique fine.

50%

des données seront traitées en streaming d’ici 2027

Gartner, 2026

<100ms

latence typique d’un pipeline streaming moderne

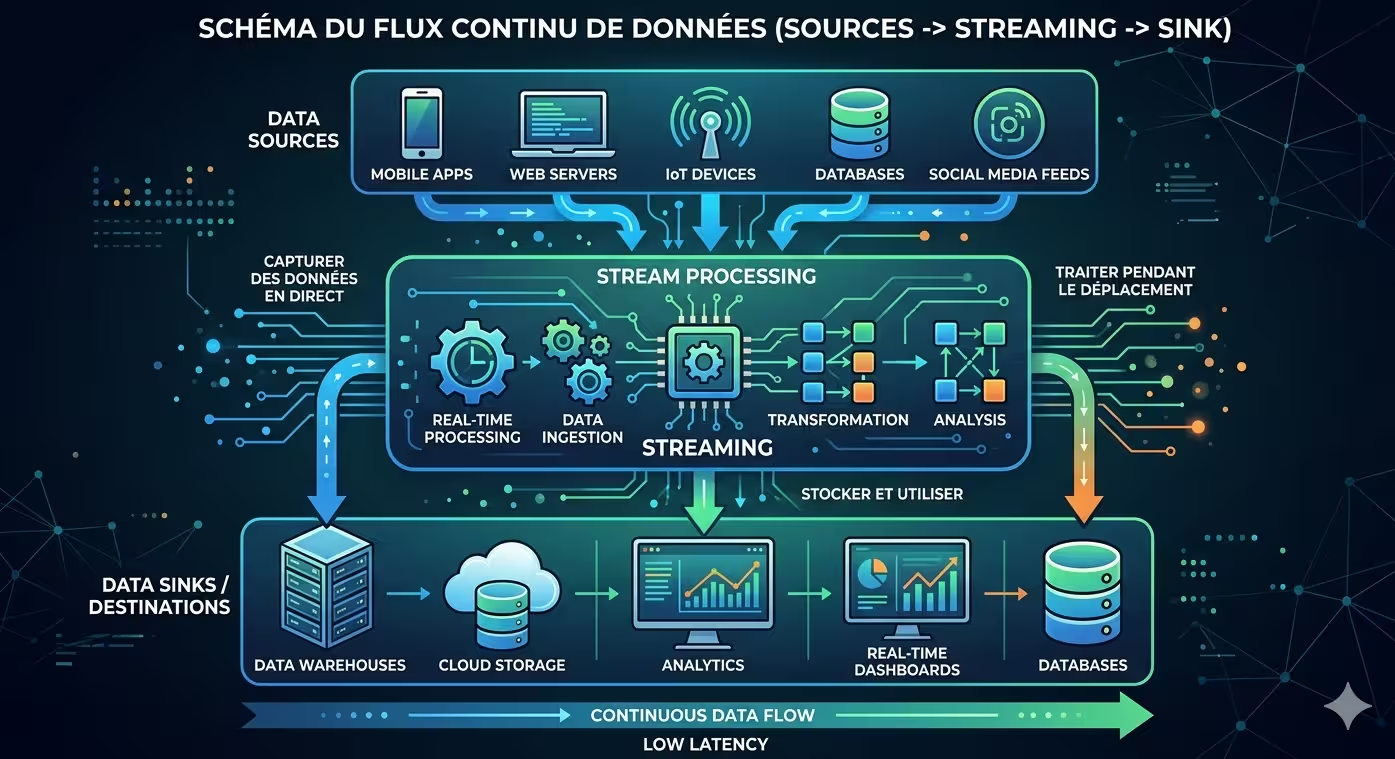

schéma illustrant un flux continu de données (capteurs → brokers → applications).

2. Pourquoi le streaming est-il essentiel ?

Les entreprises modernes ont besoin de réagir instantanément aux événements : transaction suspecte, panne de machine, tweet viral, variation de prix. Le traitement batch (par lots) introduit une latence inacceptable dans ces cas.

Détection de fraude

Une transaction bancaire suspecte doit être bloquée avant qu’elle ne soit validée, pas 24h plus tard. Le streaming permet une analyse en millisecondes.

IoT et industrie 4.0

Des capteurs sur une machine d’usine détectent une vibration anormale. Le streaming déclenche une alerte immédiate, évitant une panne coûteuse (maintenance prédictive).

Expérience client personnalisée

Un client navigue sur un site e-commerce. Le streaming analyse son comportement en temps réel et ajuste les recommandations produits instantanément.

Réseaux sociaux

Les tendances Twitter, les likes Instagram, les vues YouTube sont calculés en temps réel grâce à des pipelines streaming.

Le chiffre clé :

Une entreprise qui passe du batch au streaming peut réduire son temps de réaction de plusieurs heures à quelques secondes, un avantage concurrentiel majeur.

3. Batch vs Streaming : les différences

| Critère | Traitement batch | Traitement streaming |

|---|---|---|

| Latence | Minutes à heures | Millisecondes à secondes |

| Volumes | Très grands volumes (téraoctets) | Flux continu, potentiellement infini |

| Traitement | Périodique (fixe) | Continu (dès réception) |

| Complexité | Plus simple | Plus complexe (état, exactly-once) |

| Cas d’usage | Reporting, analytics, ML batch | Détection de fraude, monitoring, recommandations |

Approche unifiée (Lambda / Kappa) :

De nombreuses architectures combinent batch et streaming : le streaming pour l’alerte temps réel, le batch pour l’analyse historique. L’architecture Kappa va plus loin : tout est traité comme un flux, y compris le batch.

schéma comparatif batch (intervalles fixes) vs streaming (flux continu).

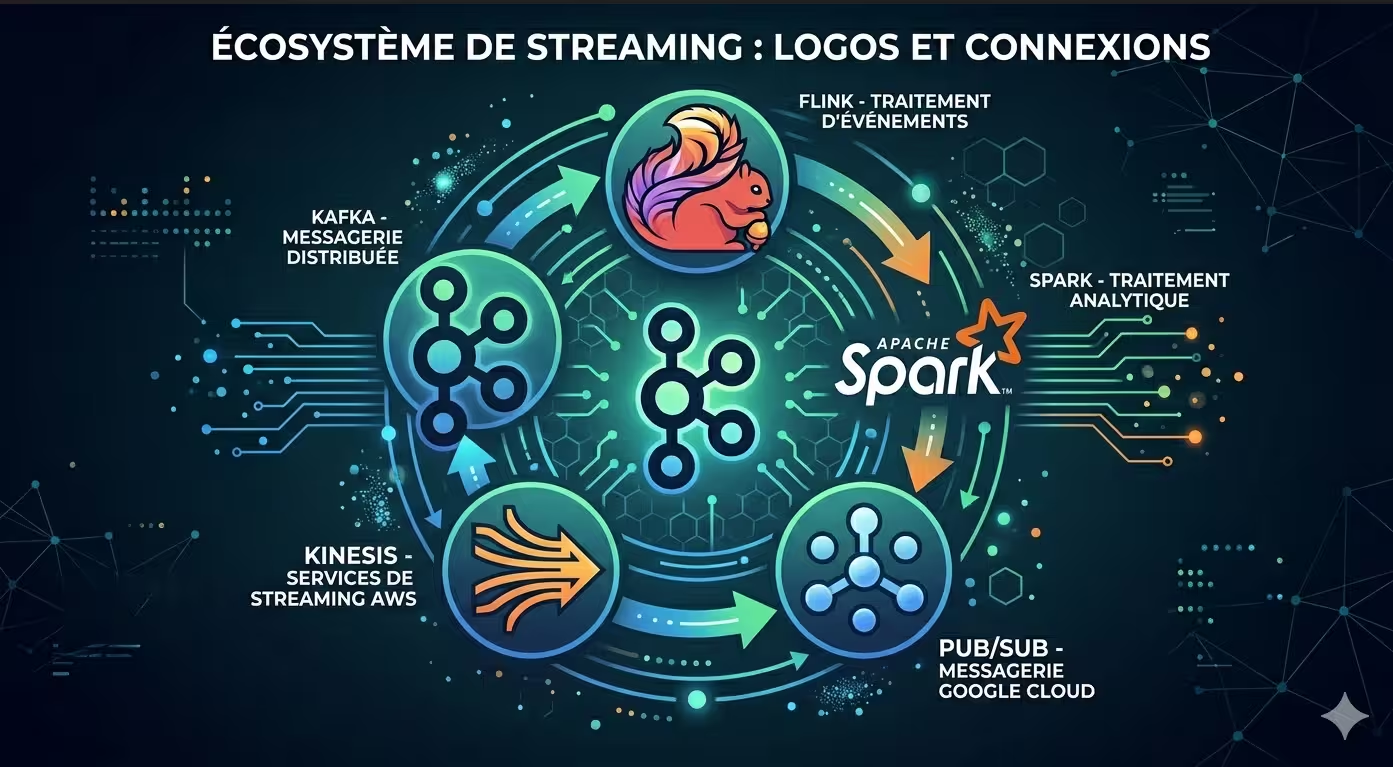

4. Les principales technologies de streaming

| Technologie | Type | Points forts | Utilisation typique |

|---|---|---|---|

| Apache Kafka | Message broker distribué | Haute performance, durable, écosystème riche | Collecte et distribution de flux (épine dorsale) |

| Apache Flink | Moteur de traitement | Vrai streaming (pas micro-batch), état, exactly-once | Traitements complexes, fenêtres, état |

| Spark Streaming | Moteur de traitement | Intégration avec écosystème Spark, mature | Micro-batch, bon compromis |

| Amazon Kinesis | Broker + processing (géré) | Fully managed, intégration AWS | Cloud AWS, sans gestion d’infra |

| Google Pub/Sub + Dataflow | Broker + processing | Fully managed, intégration GCP | Cloud GCP, serverless |

| Redpanda | Broker (compatible Kafka) | Plus rapide que Kafka, sans JVM | Alternative moderne à Kafka |

Stack type :

Kafka pour l’ingestion + Flink ou Spark Streaming pour le traitement. En cloud : Kinesis (AWS) ou Pub/Sub + Dataflow (GCP).

collage des logos Kafka, Flink, Spark, Kinesis, Pub/Sub.

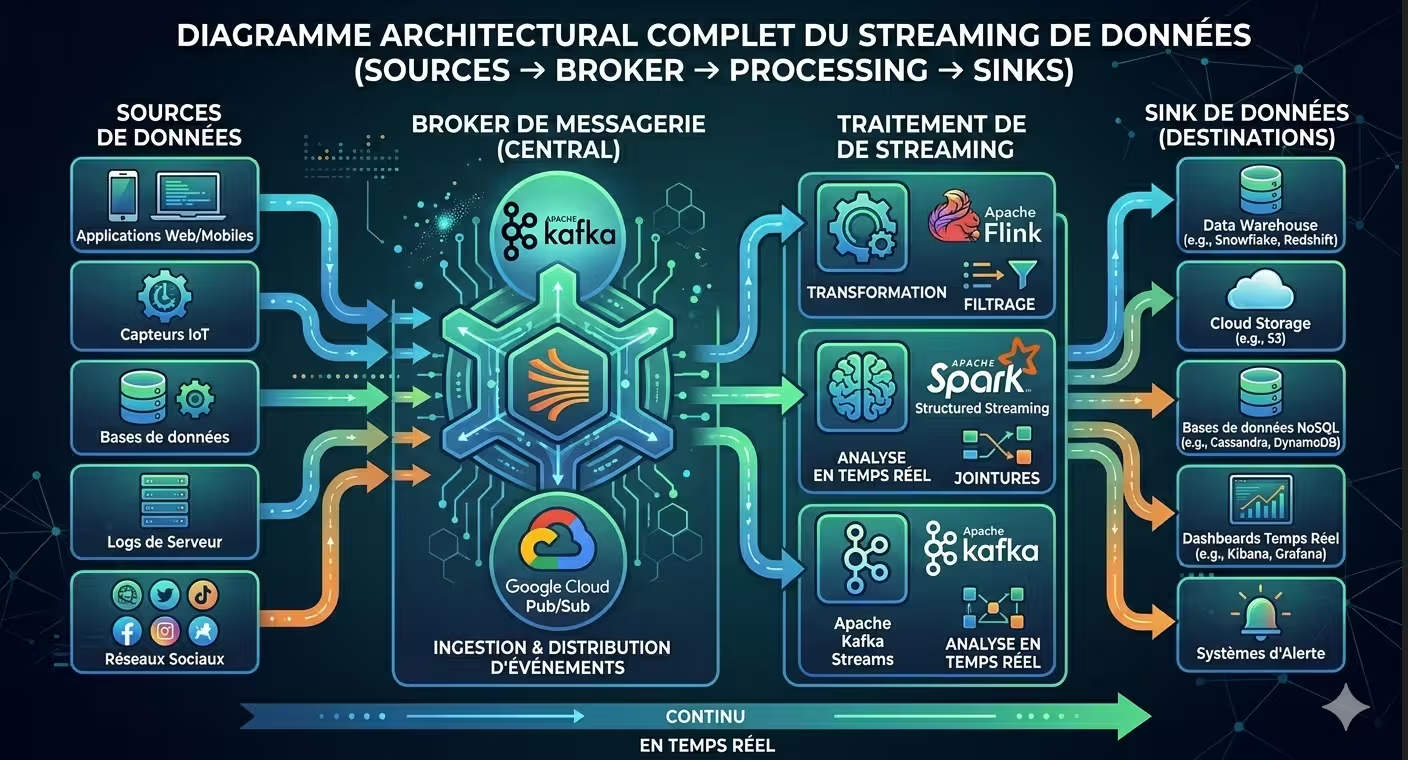

5. Architecture type d’un pipeline streaming

Pipeline streaming typique

Sources (capteurs, logs, apps)

↓

[Message Broker] (Kafka, Kinesis) ← ingestion, buffer, distribution

↓

[Stream Processor] (Flink, Spark) ← transformation, agrégation, fenêtrage

↓

[Sinks] (base de données, data lake, dashboard)Étape 1 : Ingestion

Les données arrivent en continu depuis des sources variées (applications web, capteurs IoT, logs serveur, transactions bancaires).

Étape 2 : Buffer / Distribution (Message Broker)

Un broker comme Kafka ou Kinesis collecte les données, les tamponne et les distribue aux consommateurs. Il garantit la durabilité et l’ordre des messages.

Étape 3 : Traitement (Stream Processor)

Flink ou Spark Streaming applique des transformations : filtres, agrégations, fenêtres (ex: moyenne glissante sur 5 minutes), jointures entre flux.

Étape 4 : Sinks (sorties)

Les résultats sont envoyés vers des bases de données (PostgreSQL, Cassandra), des data lakes (S3, HDFS), des dashboards (Tableau, Grafana) ou des systèmes d’alerte.

diagramme complet de l’architecture (sources → broker → processing → sinks).

6. Cas d’usage concrets

| Entreprise | Cas d’usage | Technologie |

|---|---|---|

| Uber | Suivi des courses en temps réel, calcul des prix dynamiques, matching chauffeur-client | Kafka, Flink |

| Netflix | Recommandations personnalisées en temps réel, monitoring des millions de streams vidéo | Kafka, Flink |

| PayPal | Détection de fraude (analyse des transactions en millisecondes) | Kafka, Flink |

| Airbnb | Pricing dynamique, détection d’anomalies, personnalisation | Kafka, Spark Streaming |

| Fil d’actualité personnalisé, suggestions de connexions | Kafka (créé chez LinkedIn) |

Exemple concret : détection de fraude

Une transaction bancaire arrive → Kafka la reçoit → Flink analyse en moins de 50ms → Si suspecte, envoie une alerte à un système qui bloque la transaction avant validation.

7. Défis et bonnes pratiques

1. Exactly-once semantics

Garantir qu’un événement n’est traité qu’une seule fois (ni perdu, ni dupliqué). Kafka + Flink offrent cette garantie. C’est complexe, mais critique pour la finance.

2. Gestion de l’état (state management)

Les traitements streaming ont besoin de mémoire de l’état (ex: moyenne glissante). Flink gère l’état de manière performante et permet la reprise après panne.

3. Backpressure (surcharge)

Si le consommateur est plus lent que le producteur, il faut ralentir l’ingestion ou bufferiser. Kafka gère bien la backpressure.

4. Fenêtrage (windowing)

Définir des fenêtres de temps (tumbling, sliding, session) pour agréger les données (ex: nombre de transactions par minute).

5. Monitoring et observabilité

Un pipeline streaming est plus complexe qu’un batch. Des outils comme Prometheus + Grafana sont indispensables pour surveiller latence, débit, état.

Bonnes pratiques :

- ✅ Toujours dimensionner le nombre de partitions Kafka

- ✅ Utiliser des checkpoints (Flink) ou des write-ahead logs pour la reprise

- ✅ Sérialiser les messages avec Avro ou Protobuf (pas JSON)

- ✅ Isoler les environnements de développement, test, production

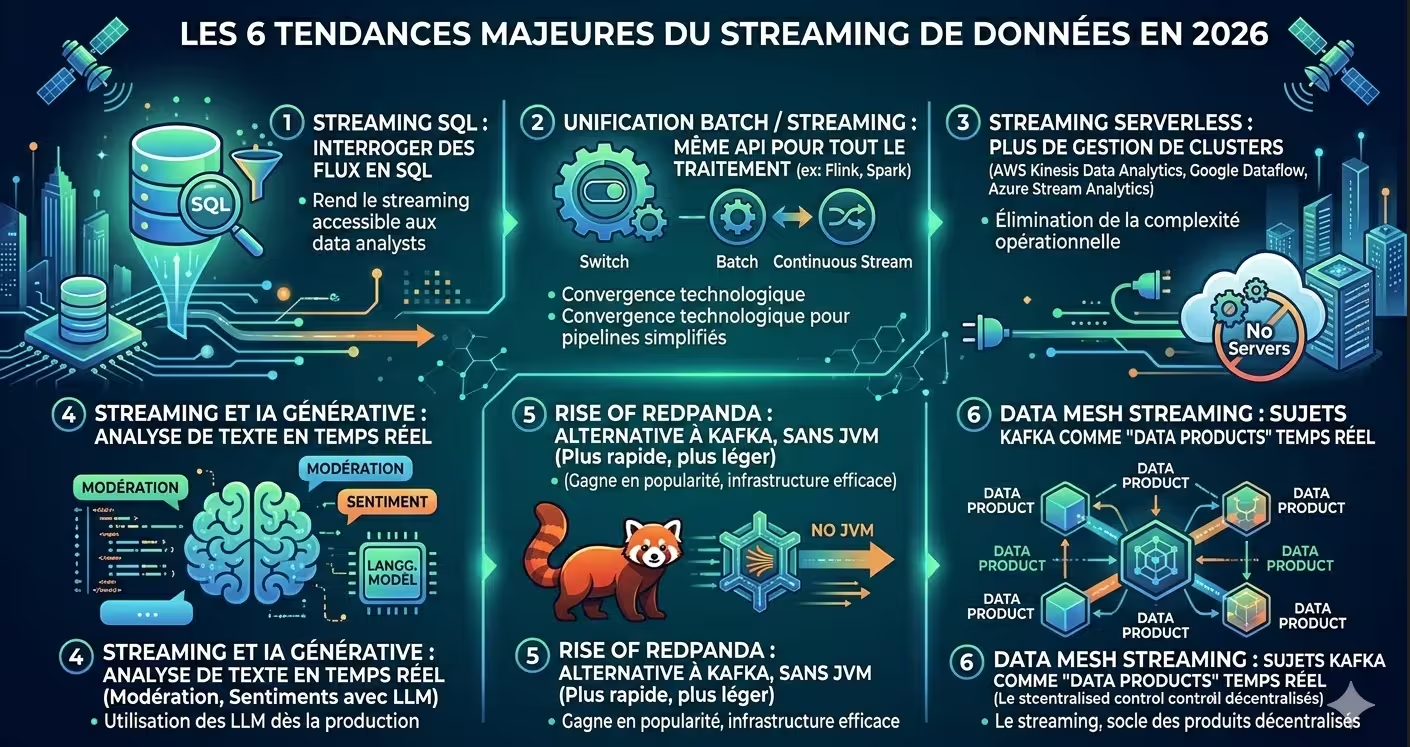

8. Tendances 2026

- Streaming SQL : Utiliser du SQL pour interroger des flux (ex: KSQL, Flink SQL). Rend le streaming accessible aux data analysts.

- Unification batch / streaming : Les moteurs comme Flink et Spark traitent désormais batch et streaming avec la même API.

- Streaming serverless : AWS Kinesis Data Analytics, Google Dataflow, Azure Stream Analytics – plus besoin de gérer des clusters.

- Streaming et IA générative : Analyser des flux de texte en temps réel avec des LLM pour la modération de contenu ou l’analyse de sentiments.

- Rise of Redpanda : Alternative à Kafka, plus rapide et sans JVM, gagne en popularité.

- Data Mesh streaming : Les architectures Data Mesh intègrent des sujets Kafka comme “data products” en temps réel.

Infographie des 6 tendances.

FAQ

Quelle est la différence entre Kafka et Flink ?

Kafka est un message broker (ingestion, buffer, distribution). Flink est un moteur de traitement (analyse, transformation, agrégation). Ils sont complémentaires : Kafka pour transporter les données, Flink pour les traiter.

Spark Streaming est-il encore pertinent face à Flink ?

Oui. Spark Streaming est mature, a un écosystème riche (Spark SQL, MLlib) et est plus simple à prendre en main. Flink est plus performant pour le vrai streaming (latence plus faible, meilleure gestion de l'état). Le choix dépend du besoin.

Qu'est-ce que le micro-batch ?

Le micro-batch (utilisé par Spark Streaming) découpe le flux en petits lots (ex: toutes les 500ms). C'est plus simple à implémenter, mais la latence est légèrement plus élevée que le vrai streaming (Flink).

Faut-il Kafka pour faire du streaming ?

Pas obligatoirement. On peut lire directement depuis une source (API, socket) et traiter avec Flink. Mais Kafka apporte durabilité, rejeu, distribution et est devenu le standard de facto.

Qu'est-ce que exactly-once semantics ?

C'est la garantie qu'un événement est traité exactement une fois (ni perdu, ni dupliqué). Kafka + Flink l'offrent. C'est crucial pour les cas financiers (ne pas débiter deux fois un client).

Le streaming remplace-t-il le batch ?

Non. Le batch reste pertinent pour les analyses historiques, les rapports financiers, les entraînements de modèles ML. Les deux coexistent (architecture Lambda).

Conclusion

Le streaming de données est devenu incontournable pour les entreprises qui veulent réagir en temps réel. Des technologies comme Kafka, Flink et Spark Streaming permettent de traiter des flux continus avec une latence inférieure à la seconde.

À retenir

- Streaming = traitement continu, latence très faible

- Batch vs Streaming : latence vs volume, complémentaires

- Technologies clés : Kafka (broker), Flink/Spark (processing), Kinesis/Pub/Sub (cloud)

- Cas d’usage : fraude, IoT, recommandations, réseaux sociaux

- Défis : exactly-once, état, backpressure, fenêtrage

- Tendances 2026 : Streaming SQL, serverless, unification batch/streaming

Pour aller plus loin : Découvrez notre article Data Mesh pour comprendre comment les architectures de données évoluent.

Revenir au guide complet

Pour explorer l’ensemble des outils et technologies en data science, IA et visualisation, consultez le pilier dédié : Outils, technologies et dataviz – guide complet.