L’intelligence artificielle a profondément transformé le secteur financier au cours des deux dernières décennies. Aujourd’hui, les algorithmes exécutent 85 % des transactions boursières américaines, évaluent votre solvabilité en quelques secondes, détectent les fraudes en temps réel, et gèrent des milliards d’euros d’actifs via des robo-advisors. Ces technologies apportent des opportunités considérables : efficacité accrue, réduction des coûts, meilleure gestion des risques. Mais elles introduisent aussi des risques systémiques : flash crashes, biais algorithmiques discriminatoires, opacité des modèles « boîte noire », et vulnérabilités aux manipulations. Cette page pilier (plus de 3 500 mots) explore les principales applications de l’IA en finance, analyse les risques, et présente les cadres réglementaires (AI Act, MICA, Bâle III, DORA).

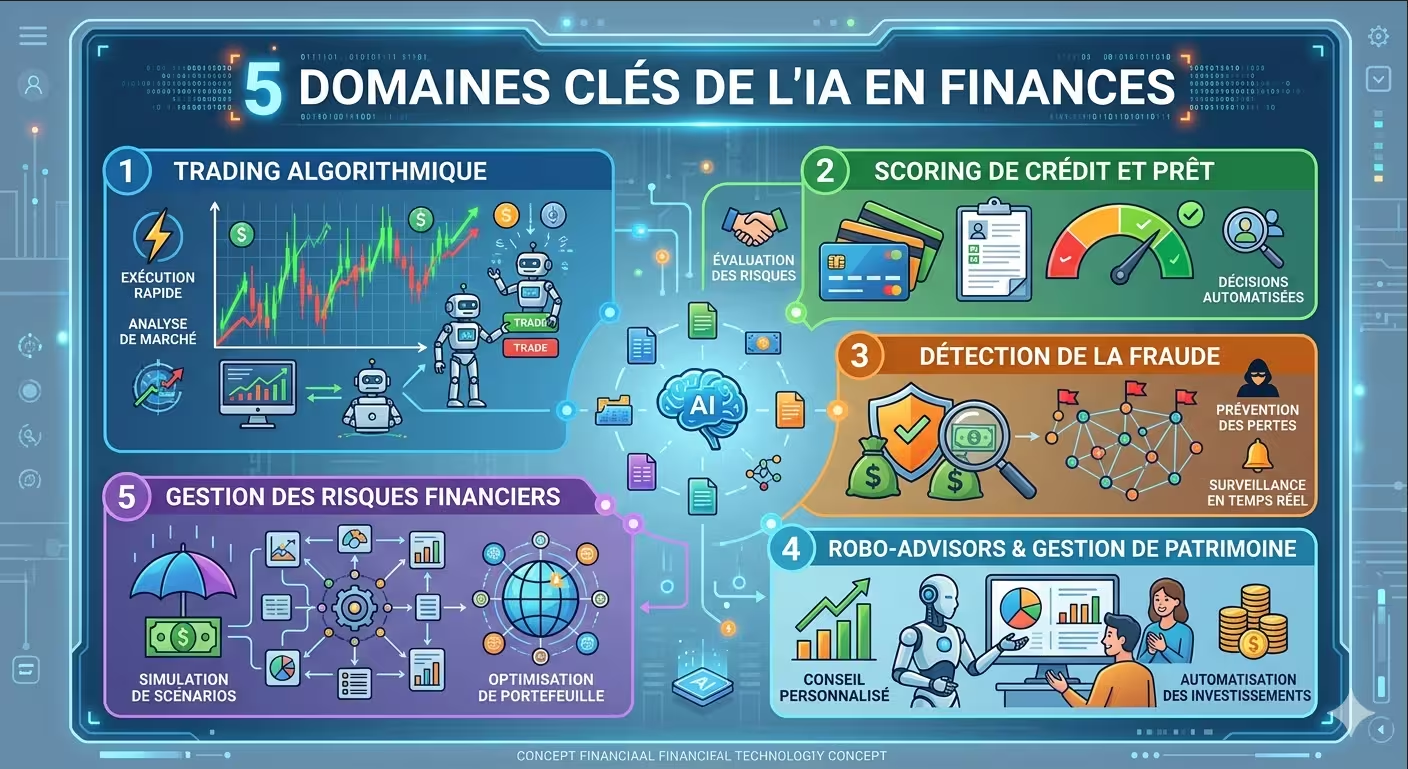

Infographie n°1 – Panorama de l’IA en finance : trading algorithmique, credit scoring, détection de fraude, robo-advisors, gestion des risques.

Le trading algorithmique désigne l’utilisation d’algorithmes pour passer automatiquement des ordres d’achat ou de vente sur les marchés financiers. En 2026, plus de 85 % des transactions sur les actions américaines et plus de 70 % sur les actions européennes sont générées par des algorithmes. Ces systèmes peuvent exécuter des ordres en quelques microsecondes, bien plus vite que le meilleur trader humain. Pour approfondir, consultez nos articles : Le trading algorithmique : quand les machines prennent les rênes des marchés et Trading algorithmique : comment l’IA influence les marchés financiers.

Le HFT est une sous-catégorie extrême du trading algorithmique, caractérisée par des temps de détention très courts (millisecondes, microsecondes) et des volumes faramineux. Les firmes HFT pratiquent la co-localisation (colocation) : leurs serveurs sont placés dans les mêmes centres de données que ceux des bourses (NASDAQ, NYSE, CME) pour gagner quelques microsecondes. Une avance de 5 microsecondes peut suffire à rendre une stratégie profitable. L’activité HFT représente environ 30-40 % du volume total sur les actions américaines. Le HFT est controversé car il peut contribuer aux flash crashes (voir section 8).

Les réseaux de neurones profonds (deep learning) surpassent les modèles statistiques traditionnels (régression linéaire, ARIMA) pour certaines tâches de prédiction financière, notamment lorsqu’il existe des relations non linéaires complexes. Pour approfondir, consultez notre article : Le deep learning : une révolution pour les solutions financières.

Les hedge funds quantitatifs (Two Sigma, Renaissance Technologies) utilisent des milliers de sources de données alternatives. Ils analysent par exemple les images satellite des parkings de magasins pour anticiper les ventes trimestrielles avant la publication officielle. L’avantage informationnel peut être de plusieurs jours.

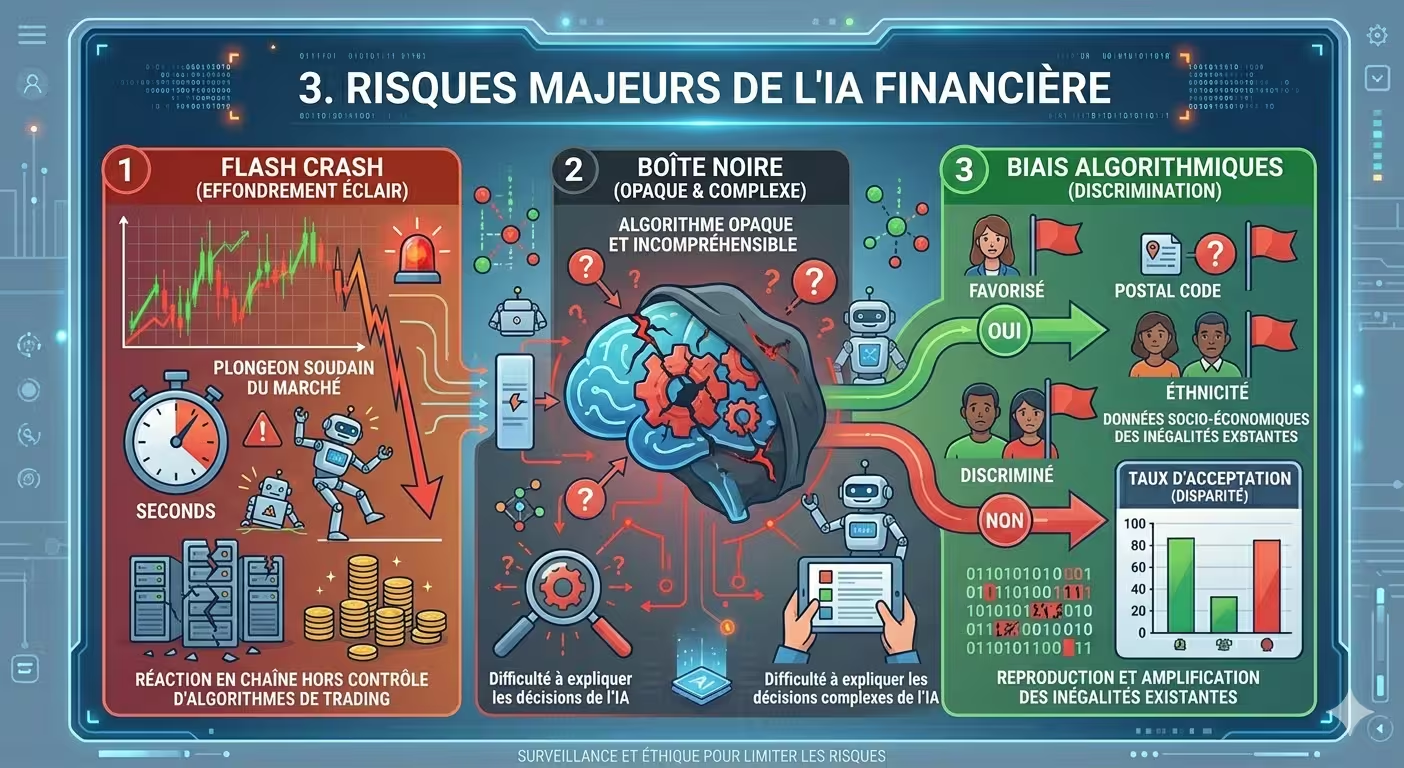

Les modèles de deep learning sont souvent des « boîtes noires » difficilement interprétables. Cela pose un problème pour la conformité réglementaire (exigence d’explicabilité) et la gestion des risques (on ne comprend pas pourquoi le modèle prend telle décision). Les techniques d’IA explicable (XAI – Explainable AI) comme SHAP ou LIME sont en développement.

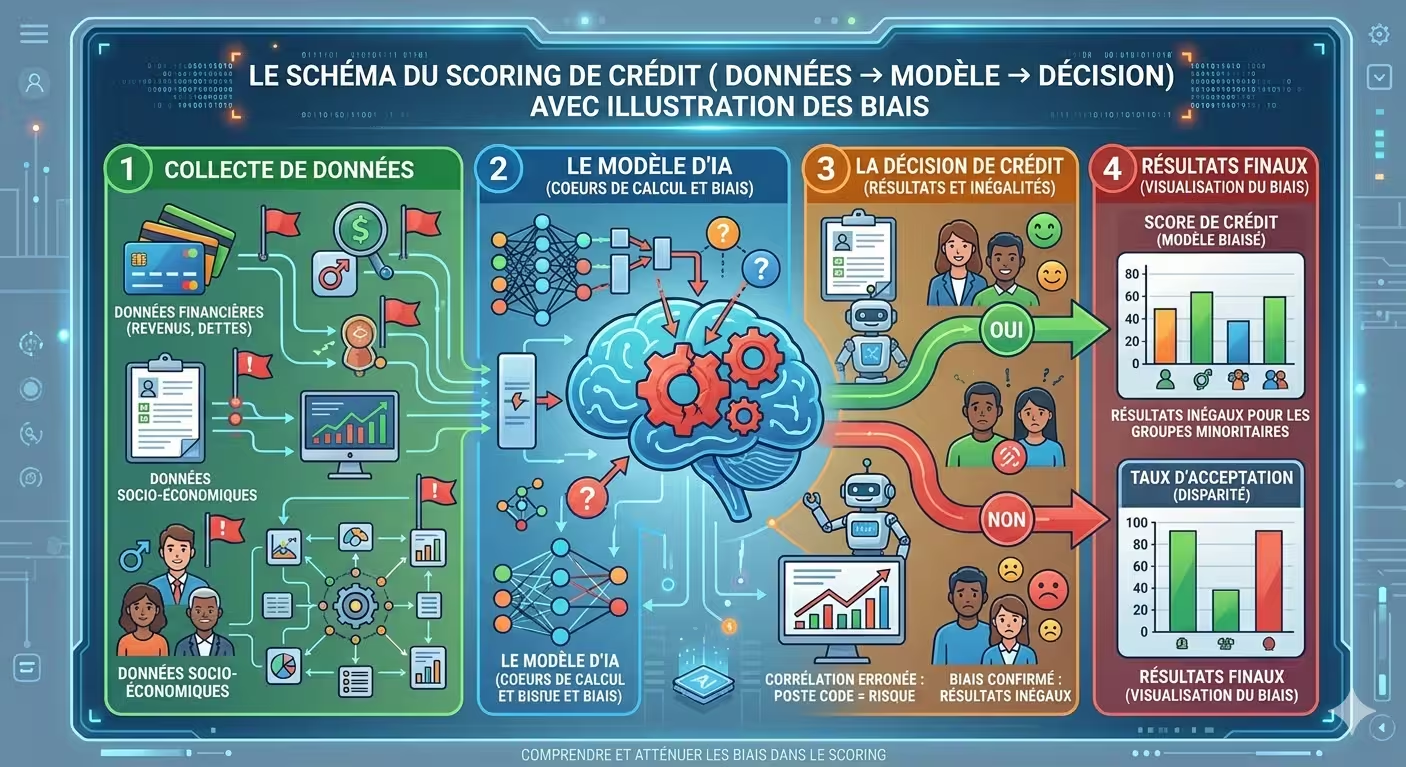

Le credit scoring est l’évaluation de la probabilité qu’un emprunteur rembourse son prêt. Les modèles traditionnels (régression logistique sur quelques dizaines de variables) sont progressivement remplacés par des modèles d’IA (arbres de décision, forêts aléatoires, XGBoost, réseaux de neurones) qui améliorent la prédiction de 15 à 30 %. Pour approfondir, consultez notre article : Credit scoring : comment l’IA évalue votre solvabilité.

Les modèles peuvent apprendre des discriminations historiques : refus de prêt plus fréquent dans certains quartiers (redlining), utilisation de variables proxy corrélées à l’origine ethnique (code postal, type de téléphone, nom de famille). Voir l’article dédié (à venir) : Biais algorithmiques dans le crédit et l’assurance. Le RGPD impose un droit à l’explication (« right to explanation ») : le client doit pouvoir comprendre pourquoi sa demande de prêt a été refusée. Le recours à un modèle « boîte noire » sans explication peut donc être problématique.

Infographie n°2 – Le processus de credit scoring par IA : des données à la décision, avec les biais potentiels.

La fraude bancaire (paiements frauduleux, crédits non remboursés, blanchiment d’argent) coûte chaque année des milliards d’euros dans le monde. L’IA permet de détecter les transactions suspectes en temps réel (quelques millisecondes), avec une réduction des faux positifs (fausses alertes) et une meilleure détection des vrais positifs. Pour approfondir, consultez notre article (à venir) : IA et détection de fraude bancaire.

PayPal utilise un modèle de deep learning qui analyse plus de 1 000 caractéristiques par transaction (montant, localisation, historique, type d’appareil, empreinte numérique). Le système passe 99 % des transactions en moins de 400 millisecondes. Visa et Mastercard ont mis en place des systèmes similaires. Le taux de fraude sur les transactions par carte est tombé à 0,06 % en 2025 (contre 0,12 % en 2019), grâce en grande partie à l’IA. Cependant, les fraudeurs utilisent aussi l’IA pour générer des transactions plus difficiles à détecter.

Les robo-advisors sont des plateformes automatisées de conseil en investissement et de gestion de portefeuille. Elles utilisent des algorithmes pour proposer une allocation d’actifs personnalisée en fonction des objectifs (croissance, sécurité), de l’horizon de placement, du profil de risque de l’utilisateur (profil « prudent », « équilibré », « dynamique »), et des contraintes éventuelles (exclusion ESG, investissement thématique). Pour approfondir, consultez notre article (à venir) : Robo-advisors : comment l’IA transforme le conseil financier.

Les assureurs utilisent l’IA pour évaluer les risques (santé, automobile, habitation, vie), fixer les primes (tarification personnalisée), et détecter les fraudes. Pour approfondir, consultez notre article (à venir) : IA, assurance et scoring de risque.

L’utilisation de données alternatives peut introduire des discriminations indirectes. Par exemple, le refus d’assurance auto basé sur un score de conduite pourrait pénaliser les jeunes conducteurs (discrimination par l’âge ?) ou les zones urbaines denses (discrimination géographique ?). En 2025, l’ACPR (Autorité de Contrôle Prudentiel et de Résolution) a publié des recommandations pour éviter les biais dans les modèles d’assurance. L’AI Act interdit la notation sociale et la reconnaissance des émotions pour la tarification. Voir l’article Biais algorithmiques dans le crédit et l’assurance.

Les banques et les assureurs utilisent l’IA pour améliorer leurs modèles de risque : Value at Risk (VaR) non linéaire, Expected Shortfall (ES), stress tests (scénarios extrêmes), et scénarios de crise. L’IA permet de modéliser des dépendances complexes entre actifs (copules, réseaux de neurones) et de simuler des millions de scénarios de crise en quelques heures.

Les accords de Bâle (Comité de Bâle sur le contrôle bancaire) imposent des exigences de fonds propres. Les banques peuvent utiliser des modèles internes (approche IRB – Internal Ratings-Based) pour calculer leurs risques, sous réserve de validation par le régulateur (ACPR en France, ECB pour les grandes banques). Les modèles d’IA peuvent être utilisés, mais doivent satisfaire aux exigences de gouvernance (d documentation), de validation (backtesting, benchmark) et d’explicabilité.

L’IA en finance n’est pas sans risques. Pour une analyse approfondie, consultez notre article : IA et marchés financiers : risques et opportunités.

Un flash crash est une chute brutale et brève des prix (quelques minutes, parfois quelques heures) causée par une interaction non maîtrisée entre algorithmes de trading. Les plus célèbres : le flash crash du 6 mai 2010, où le Dow Jones a chuté de près de 1000 points en 36 minutes (6 %), avant de remonter presque aussi vite. La cause : un vendeur algorithmique (fonds) a déclenché une cascade de ventes par d’autres algorithmes HFT qui se sont retirés du marché (retrait de liquidité). Depuis, les régulateurs ont imposé des coupe-circuits (circuit breakers) : suspension automatique de 5 minutes en cas de variation brutale (> 10 %).

Les modèles peuvent apprendre des discriminations historiques. Par exemple, un modèle de credit scoring entraîné sur des données passées peut pénaliser les habitants de certains quartiers (redlining) ou — plus indirectement — utiliser des variables proxy corrélées à l’origine ethnique (code postal, type de téléphone, habitudes de consommation). Voir l’article dédié Biais algorithmiques dans le crédit et l’assurance. Le RGPD impose un droit à l’explication (« right to explanation ») pour toute décision automatisée ayant un impact significatif sur une personne (ex. refus de prêt). Le recours à un modèle « boîte noire » sans explication est donc problématique.

Les modèles de deep learning sont souvent difficilement interprétables. Cela pose un problème pour la conformité réglementaire (exigence d’explicabilité) et la gestion des risques (on ne comprend pas pourquoi le modèle a pris une décision). L’AI Act européen impose des exigences de transparence pour les systèmes à haut risque (crédit scoring, assurance, trading). Les techniques d’IA explicable (XAI), comme SHAP (SHapley Additive exPlanations) ou LIME (Local Interpretable Model-agnostic Explanations), sont en développement pour répondre à ce besoin.

Infographie n°3 – Les trois grands risques : flash crashes, boîtes noires, biais algorithmiques.

Plusieurs textes réglementaires encadrent l’IA en finance. Cette section présente les principales dispositions.

L’AI Act classe les systèmes d’IA utilisés pour le credit scoring, la détection de fraude, la gestion des risques, et le trading algorithmique comme « haut risque » (annexe III). Obligations : transparence (documentation, explicabilité), traçabilité (logs des décisions), supervision humaine (human-in-the-loop), audits réguliers (tous les 2 ans), enregistrement dans une base de données européenne. Les systèmes d’IA en « temps réel » pour le trading et la gestion des risques sont soumis à des exigences particulières (kill switch, backtesting quotidien). Amendes pouvant atteindre 15 M€ ou 3 % du CA mondial.

MICA est le premier cadre réglementaire européen pour les crypto-actifs. Il impose des règles de transparence et de gouvernance aux algorithmes de trading sur cryptomonnaies (ex. bots de trading automatisés sur Binance, Coinbase). Les algorithmes doivent être enregistrés et leurs paramètres clés accessibles au régulateur.

Les accords de Bâle imposent des exigences de fonds propres aux banques. Les banques peuvent utiliser des modèles internes (approche IRB – Internal Ratings-Based) pour calculer leurs risques de crédit, sous réserve de validation par le régulateur. Les modèles d’IA peuvent être utilisés, mais doivent satisfaire aux exigences de gouvernance (documentation complète), de validation (backtesting, benchmark, stress tests) et d’explicabilité (au moins partielle).

DORA impose des exigences de cybersécurité et de résilience opérationnelle pour les entités financières, couvrant les risques liés aux fournisseurs tiers (cloud, plateformes IA). Les banques doivent tester régulièrement la résilience de leurs systèmes critiques (tests d’intrusion) et avoir un plan de reprise après sinistre (PRA).

Un flash crash est une chute brutale et brève des prix (quelques minutes) causée par des algorithmes de trading. Le plus célèbre : le 6 mai 2010, le Dow Jones a chuté de 1000 points en 36 minutes. Les régulateurs ont imposé des coupe-circuits (circuit breakers) pour limiter le risque.

Oui, pour les profils d’investissement standard. Ils ne remplacent pas un conseiller humain pour les situations complexes (fiscalité, succession). Les frais sont bien inférieurs (0,2-0,5 % contre 1-2 %).

Oui, si les données d’entraînement contiennent des biais historiques (discrimination passée). Le scoring peut pénaliser des groupes défavorisés. Le RGPD impose un droit à l’explication. L’AI Act classe le credit scoring comme « haut risque ».

En 2025, le taux de fraude sur les transactions par carte est tombé à 0,06 % (contre 0,12 % en 2019), grâce à l’IA. En France, il est légèrement plus élevé (~0,08 %).