Les algorithmes d’intelligence artificielle sont aujourd’hui omniprésents sur les marchés financiers. Ils exécutent des ordres en quelques microsecondes, détectent des opportunités d’arbitrage invisibles à l’œil humain, optimisent la gestion de portefeuille, et aident à détecter des fraudes. Mais cette automatisation massive comporte des risques : flash crashes, bulles algorithmiques, opacité des décisions (black box), et vulnérabilités aux manipulations. Alors que les régulateurs (AMF, SEC, ESMA) tentent de s’adapter, cet article explore en profondeur les opportunités offertes par l’IA aux acteurs financiers et les menaces qu’elle fait peser sur la stabilité du système financier mondial.

En 2026, l’IA est devenue un outil incontournable pour l’ensemble des acteurs financiers : banques d’investissement, hedge funds, assureurs, sociétés de gestion, et même régulateurs. Selon une étude du Forum économique mondial, 72 % des institutions financières utilisent l’IA de manière opérationnelle (contre 45 % en 2022). L’adoption s’est accélérée avec les progrès du machine learning, des LLM, et la baisse des coûts de calcul.

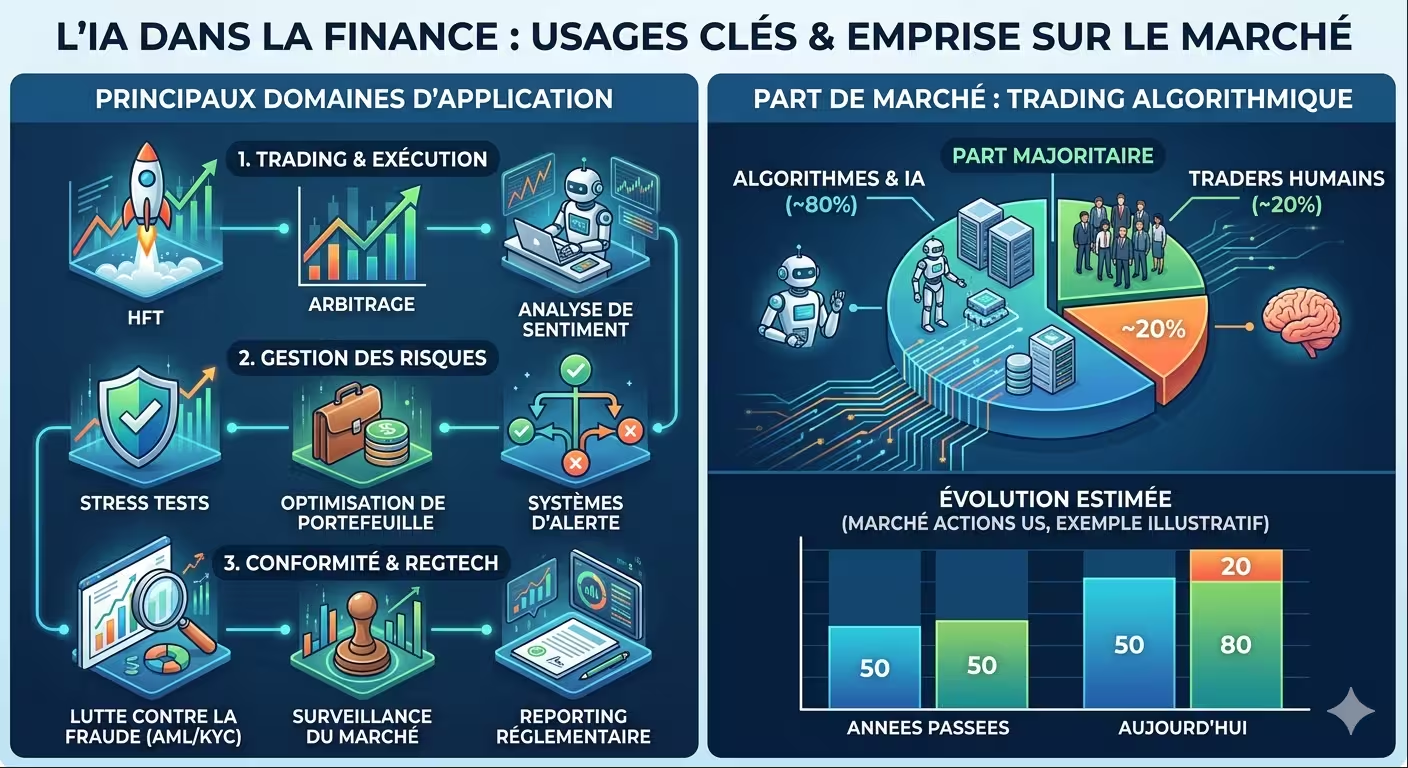

Infographie n°1 – Les principaux domaines d’application de l’IA en finance : trading, gestion de risque, conformité, analyse prédictive.

L’IA n’est pas qu’un facteur de risque. Elle apporte des bénéfices considérables aux marchés financiers.

Les modèles d’IA (forêts aléatoires, réseaux de neurones, transformers) analysent des masses de données (prix, volumes, actualités, données alternatives) pour générer des signaux prédictifs. Les hedge funds quantitatifs (Renaissance Technologies, Two Sigma) utilisent l’IA depuis des années. Les modèles récents (LLM) analysent les communiqués de presse et rapports trimestriels.

L’IA améliore la mesure et la gestion des risques : Value at Risk (VaR) non linéaire, stress tests (scénarios extrêmes), détection précoce de risques de contrepartie, et surveillance des expositions en temps réel. Les banques centrales utilisent l’IA pour modéliser les chocs systémiques.

Les algorithmes détectent les opérations suspectes (blanchiment d’argent, délits d’initiés) en analysant des millions de transactions. Les fausses alertes diminuent (moins de « cry wolf »), et les véritables fraudes sont détectées plus tôt. Coûts de conformité réduits.

L’IA minimise l’impact des gros ordres sur le marché (slippage) en les fractionnant et en les acheminant intelligemment vers les plateformes les plus liquides. Gain de 10-20 points de base (bps) sur les grosses transactions.

Le trading algorithmique (exécution automatisée selon des règles) et le HFT (haute fréquence, microsecondes) sont les applications les plus connues de l’IA en finance. En 2026, on estime que plus de 85 % du volume des actions américaines est généré par des algorithmes. En Europe, le chiffre dépasse 70 %. La majorité des teneurs de marché (market makers) sont des algorithmes HFT (Citadel Securities, Virtu, XTX).

Les avantages pour le marché : liquidité abondante, spreads réduits (coûts de transaction plus faibles), correction quasi instantanée des anomalies de prix. Les risques : flash crashes (cascades de ventes par algo), procyclicité (les algorithmes amplifient les mouvements), et inégalités technologiques (seuls les acteurs très rapides profitent du HFT).

Le Dow Jones a chuté de près de 1000 points en 36 minutes. La cause : un vendeur algorithmique a déclenché une cascade de ventes par d’autres algorithmes HFT. Depuis, des coupe-circuits (« circuit breakers ») ont été mis en place.

Infographie n°2 – Les principaux risques : flash crashes, procyclicité, opacité, manipulation.

En mai 2022, un mini-flash crash a touché l’or et le pétrole. En 2024, des algorithmes d’une grande banque ont déclenché une chute brutale d’une action européenne (15 % en 10 minutes). Les régulateurs ont durci les règles (coupe-circuits obligatoires).

En période de stress, les algorithmes de trading suivent la tendance (momentum), amplifiant les chutes. Les algorithmes de gestion des risques exigent des ajustements de positions qui accentuent les mouvements. Le risque de « bulle algorithmique » (valorisation aberrante poussée par des algorithmes auto-référents) reste faible mais étudié sérieusement.

En cas de forte volatilité, les teneurs de marché algorithmiques se retirent (« pull out »), la liquidité s’évapore, et les spreads explosent. Le marché devient illiquide au pire moment.

Les modèles d’IA modernes (deep learning) sont des « boîtes noires » : on observe leur entrée et leur sortie, mais on ne comprend pas le raisonnement interne. Cette opacité est problématique pour les régulateurs, actionnaires, et auditeurs.

Comment un régulateur peut-il vérifier qu’un algorithme ne manipule pas le marché ? Comment un risk manager peut-il certifier qu’un modèle neural ne prend pas des risques excessifs cachés ? L’opacité empêche une supervision efficace.

L’AI Act européen (2025) impose pour les systèmes à haut risque (dont trading algorithmique) la capacité à expliquer les décisions. Des techniques XAI (SHAP, LIME) tentent de rendre les modèles moins opaques, mais au prix d’une performance parfois réduite.

Un modèle peut trouver une corrélation purement fortuite entre deux variables (ex. prix du beurre au Bangladesh et S&P 500). Sans compréhension humaine, le modèle peut prendre des risques inexpliqués.

Les algorithmes peuvent être manipulés intentionnellement (attaques adverses) par des acteurs malveillants.

Manipulation via des ordres fictifs. Un algorithme malveillant passe puis annule des ordres pour créer une fausse impression d’offre ou de demande. Pratique répandue, difficile à détecter. L’IA détecte aussi ces manipulations (analyse des patterns).

Un attaquant introduit des données faussées (ex. fausses transactions, signaux) pour biaiser les modèles. Les LLM de trading peuvent être manipulés par des textes malveillants. La recherche en cybersécurité financière est en plein essor.

Les régulateurs financiers et européens ont renforcé l’encadrement de l’IA.

Le trading algorithmique désigne l’exécution automatisée d’ordres selon des règles prédéfinies. Le trading haute fréquence (HFT) est une variante ultra-rapide. L’IA ajoute une couche d’apprentissage : les algorithmes ajustent leurs règles en fonction des données.

Impossible de comprendre pourquoi un modèle a pris une décision. Risque de décisions erronées non détectables, de contagion systémique, et de non-conformité réglementaire.

Ils exigent des logs, des tests de résistance (stress tests), la possibilité de désactiver l’algo (kill switch), et la traçabilité complète. L’AMF a une unité spécialisée « Surveillance algorithmique ».