Qui est l’auteur d’un texte généré par ChatGPT ? D’une image créée par Midjourney ? D’un morceau de musique composé par Suno ? Ces questions, simples en apparence, sont devenues un casse-tête juridique mondial. Les contentieux se multiplient, les législations s’adaptent péniblement, et les utilisateurs — particuliers comme entreprises — naviguent à vue. Ce guide fait le point sur l’état du droit d’auteur appliqué à l’IA générative en 2026 : protection des œuvres générées, droits des artistes dont les œuvres ont servi à l’entraînement, responsabilités des utilisateurs, et évolutions réglementaires en Europe et aux États-Unis.

Le droit d’auteur, tel qu’il a été conçu depuis la Convention de Berne (1886), repose sur un principe fondamental : l’œuvre doit être originale et refléter la personnalité de son auteur, une personne physique. L’IA générative bouleverse ce cadre pour deux raisons principales.

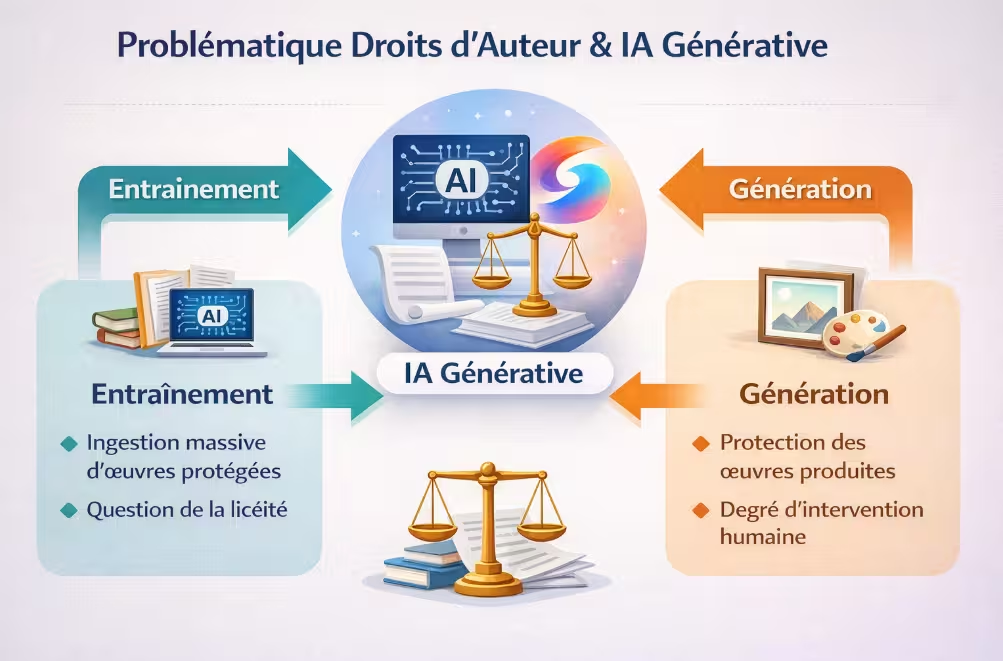

D’abord, elle peut produire des œuvres (textes, images, musiques, vidéos) sans intervention humaine directe — ou avec une intervention minimale, réduite à quelques mots dans un prompt. Ensuite, elle s’entraîne sur des millions d’œuvres préexistantes (livres, tableaux, photos, chansons), souvent sans l’autorisation explicite des ayants droit. Ce double mouvement — ingestion massive d’œuvres protégées et génération automatisée de contenus — met à rude épreuve les catégories juridiques héritées du XXe siècle.

Infographie n°1 – Les deux grands défis juridiques de l’IA générative : la protection des œuvres générées et la licéité des entraînements massifs.

La réponse varie selon les juridictions, mais un consensus émerge : la protection dépend du degré d’intervention humaine. Distinguons trois cas de figure.

Prompt minimal (« dessine un chat ») exécuté par l’IA, sans retouche ni sélection créative. Dans ce cas, la quasi-totalité des législations refusent la protection par le droit d’auteur, faute d’« auteur humain ». Aux États-Unis, le Copyright Office l’a confirmé à plusieurs reprises (décision « Zarya of the Dawn », réf. 2023). En Europe, la jurisprudence va dans le même sens. Ces œuvres tombent dans le domaine public (ou dans un statut juridique flou, selon les pays).

L’utilisateur écrit un prompt détaillé (plusieurs lignes, spécifications précises), effectue des choix créatifs (sélection parmi plusieurs propositions, modifications manuelles, assemblage de plusieurs générations), et apporte sa « patte » personnelle. Dans ce cas, la partie « humaine » de l’œuvre peut être protégée. Le droit d’auteur s’applique alors non pas à la « génération brute », mais à l’ensemble du processus créatif. Cette position est celle de l’US Copyright Office (2024) et tend à se diffuser en Europe.

La loi française pour une République numérique ne traite pas spécifiquement l’IA générative. La doctrine majoritaire est qu’une œuvre générée par IA n’est pas protégeable en l’absence d’apport intellectuel humain. En revanche, le prompteur créatif (qui écrit un prompt original, fait des choix esthétiques, sélectionne, modifie) peut revendiquer un droit sur le résultat final, à condition de pouvoir démontrer sa contribution substantielle. Les tribunaux français n’ont pas encore eu à trancher définitivement.

Un studio utilise l’IA comme outil parmi d’autres (comme un pinceau ou un logiciel de retouche). L’œuvre finale est le produit d’un processus complexe mêlant IA et interventions humaines multiples. Dans ce cas, le droit d’auteur s’applique normalement, car l’IA est considérée comme un outil au service de l’auteur humain. C’est la position la plus consensuelle : l’IA ne supprime pas la protection, à condition qu’il y ait une « paternité humaine » réelle.

Un prompt original, long et détaillé, peut-il être considéré comme une œuvre littéraire protégeable ? La question est débattue. Aux États-Unis, le Copyright Office a refusé d’enregistrer un prompt seul (décision 2024). En revanche, un recueil de prompts (ex. un livre de prompts) peut être protégé comme compilation. En pratique, les prompts ne bénéficient pas d’une protection forte, ce qui pousse certains créateurs à garder secrets leurs prompts les plus efficaces.

Le droit d’auteur étant territorial, il est essentiel de comprendre les différences majeures entre les principales juridictions.

| Pays / région | Position sur les œuvres 100 % IA | Position sur les œuvres « augmentées » | Entraînement des modèles |

|---|---|---|---|

| États-Unis | Non protégeable (pas d’auteur humain) | Protégeable si contribution humaine substantielle | Fair use possible (contentieux en cours) |

| Europe (droit de l’UE) | Non protégeable (jurisprudence constante) | Protégeable si originalité humaine démontrée | Exception pour text and data mining (opt-out possible) |

| France (au sein de l’UE) | Non protégeable (identique à position UE) | Protégeable sous conditions (créativité humaine) | Transposition de la directive DSM (opt-out) |

| Chine | Décision favorable à la protection (2024, cas Thunberg) | Oui, protection possible | Favorable aux développeurs d’IA (aucune restriction forte) |

| Royaume-Uni (post-Brexit) | Protection proposée (réforme en cours) projet | Oui, comme dans l’UE | Réforme en discussion (2026) |

Tableau comparatif des positions juridiques mises à jour en avril 2026. Les positions peuvent évoluer avec les contentieux en cours.

Cas chinois : En novembre 2024, un tribunal de Pékin a reconnu le droit d’auteur sur une image générée par IA, au motif que le prompt et les ajustements de l’utilisateur constituaient une « création intellectuelle » suffisante. Cette décision a surpris la communauté juridique internationale et pourrait influencer d’autres juridictions asiatiques. Elle ne fait toutefois pas autorité en Europe ou aux États-Unis.

Au-delà de la protection des œuvres générées, une question encore plus fondamentale agite les tribunaux : est-il légal de former des modèles d’IA générative sur des millions d’œuvres protégées, sans autorisation ni rémunération des ayants droit ?

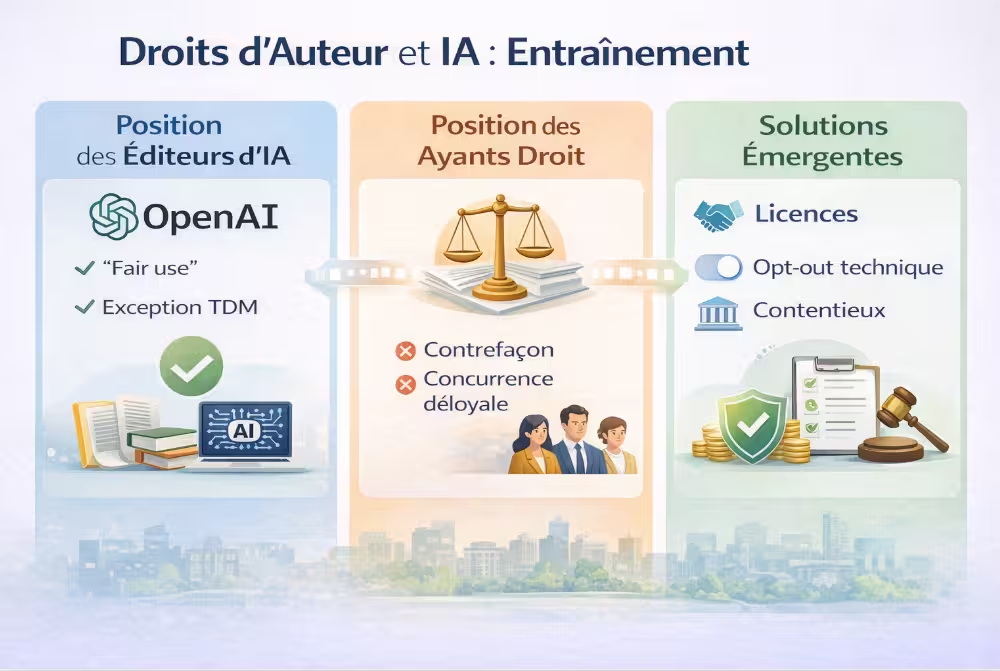

Les grandes entreprises technologiques invoquent la doctrine du « fair use » (aux États-Unis) ou les exceptions au droit d’auteur pour l’exploration de données (en Europe). Leur argument : l’entraînement d’un modèle ne constitue pas une « reproduction » au sens classique, mais une analyse statistique à des fins de recherche et de progrès technologique. De plus, les modèles ne « stockent » pas les œuvres (contrairement à une copie illicite), mais en extraient des motifs statistiques.

La directive européenne sur le droit d’auteur (2019) a introduit une exception permettant l’extraction de données textuelles et de données (TDM) à des fins de recherche scientifique. Pour les usages commerciaux (c’est le cas des modèles d’IA générative), l’exception s’applique également, mais avec une possibilité pour les ayants droit de « s’opposer » (opt-out). En pratique, les éditeurs d’IA ont largement ignoré les opt-out, faute de mécanisme technique standardisé. Plusieurs contentieux sont en cours sur ce point.

Des milliers d’artistes, d’écrivains, de photographes et d’éditeurs estiment que l’entraînement de modèles sur leurs œuvres constitue une contrefaçon massive. Ils avancent que les modèles génératifs peuvent reproduire des extraits significatifs d’œuvres protégées (« mémorisation ») et qu’ils concurrencent directement les marchés des créateurs. Plusieurs actions collectives ont été lancées aux États-Unis (Getty Images contre Stability AI, New York Times contre OpenAI, auteurs contre Meta).

Face à la pression juridique, certains éditeurs proposent des solutions : OpenAI a signé des accords de licence avec des éditeurs de presse (Associated Press, Le Monde, Prisa). Des outils techniques comme « robots.txt » pour l’IA (protocol « noai ») ou le « Data Provenance Initiative » permettent aux créateurs d’indiquer leur opposition à l’entraînement. Google a développé un outil de « opt-out » pour les images (Google’s AI Principles). La standardisation reste toutefois insuffisante.

Infographie n°2 – L’entraînement des modèles IA : positions des éditeurs, des ayants droit, et solutions émergentes (licences, opt-out).

La jurisprudence se construit en temps réel. Voici les affaires les plus importantes à suivre.

Le prestigieux quotidien américain accuse OpenAI d’avoir utilisé des millions de ses articles pour entraîner ChatGPT, sans autorisation ni compensation. Le NYT démontre que ChatGPT peut reproduire des passages entiers d’articles (y compris ceux derrière un paywall). OpenAI invoque le fair use. L’affaire, qui pourrait aller jusqu’à la Cour suprême américaine, est considérée comme le « test décisif » pour l’entraînement des LLM. Une décision de première instance est attendue pour fin 2026 ou 2027.

Le géant de la banque d’images accuse Stability AI (créateur de Stable Diffusion) d’avoir utilisé 12 millions de ses images protégées pour entraîner son modèle, en effaçant les métadonnées (mention de copyright). En 2025, un tribunal britannique a autorisé le procès à aller en jugement. Une décision est attendue en 2026. Parallèlement, Getty a signé un accord de licence avec Nvidia pour un autre modèle, montrant la voie des solutions négociées.

Sarah Silverman, Paul Tremblay et d’autres auteurs accusent OpenAI d’avoir utilisé leurs livres protégés sans autorisation. En 2025, un juge fédéral a rejeté certaines demandes (notamment l’infraction directe), mais a autorisé la plainte à poursuivre sur d’autres fondements (violation du DMCA). L’affaire suit son cours.

En France, plusieurs syndicats d’auteurs ont assigné Meta (Llama) en justice pour utilisation non autorisée d’œuvres francophones dans l’entraînement de leurs modèles. L’affaire est en instruction. Elle pose la question de l’applicabilité de l’exception « text and data mining » aux modèles open source.

Depuis 2025, l’AI Act a créé un Office européen de l’IA, chargé entre autres de surveiller le respect des règles sur les données d’entraînement. Les fournisseurs de modèles doivent publier un résumé détaillé des œuvres utilisées. Les ayants droit peuvent contester ces résumés. Cet office pourrait devenir un acteur central des contentieux en Europe, sans passer par les tribunaux nationaux.

Face à un cadre juridique incertain, les entreprises et les créateurs ne sont pas démunis. Voici des recommandations pratiques pour naviguer dans ce flou juridique.

Le droit d’auteur sur l’IA générative évolue rapidement. Aucune position n’est définitivement figée. Pour les usages professionnels engageants (commercialisation d’œuvres générées, exploitation à grande échelle), il est impératif de consulter un avocat spécialisé en propriété intellectuelle et en droit du numérique. Une consultation préventive de quelques centaines d’euros peut éviter des contentieux coûteux.

Le règlement européen sur l’IA (AI Act), entré en application progressive depuis 2025, comporte des dispositions importantes pour l’IA générative et le droit d’auteur.

Les fournisseurs de modèles d’IA générative doivent : publier un résumé détaillé des données d’entraînement utilisées (incluant les sources protégées par le droit d’auteur), concevoir leurs modèles pour éviter de générer du contenu illicite (contrefaçon, diffamation, etc.), et mettre en place des mécanismes de signalement et de recours pour les ayants droit.

L’AI Act prévoit des allègements pour les modèles open source et de recherche, sauf s’ils présentent un risque systémique. Cette exception a été critiquée par les ayants droit, qui estiment qu’elle crée une « zone grise » propice aux abus.

Les amendes peuvent atteindre 15 millions d’euros ou 3 % du chiffre d’affaires mondial (7 % pour les infractions les plus graves). Les autorités nationales de contrôle (en France, la CNIL et l’ARCOM) sont chargées de la mise en œuvre. Les premières sanctions sont attendues en 2026-2027.

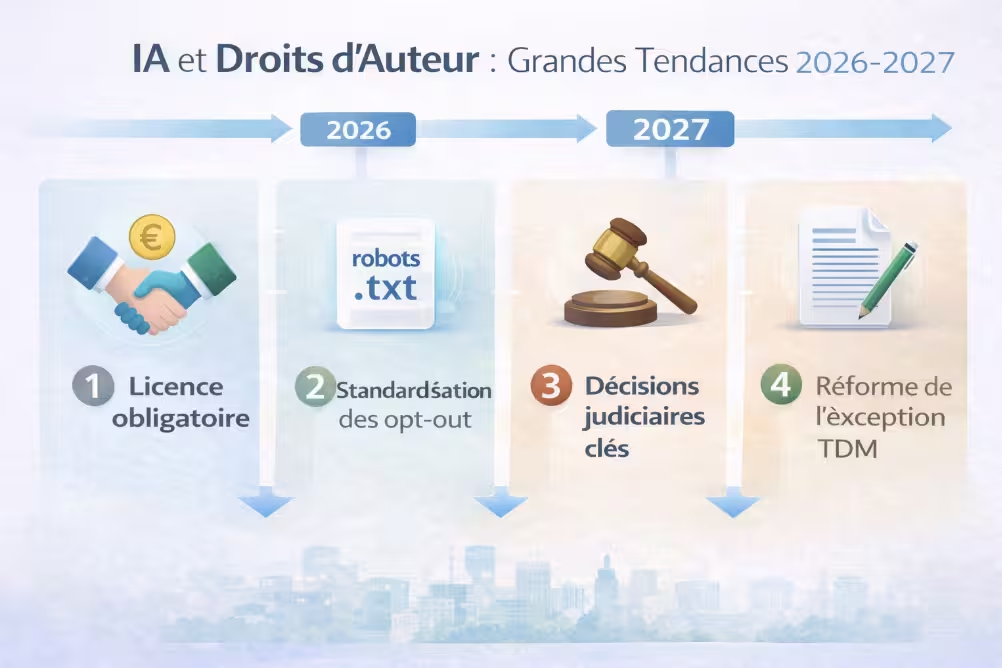

Le droit d’auteur appliqué à l’IA générative est en pleine effervescence. Plusieurs tendances se dessinent pour les mois et années à venir.

Infographie n°3 – Tendances à surveiller : standardisation des opt-out, licence obligatoire, décisions judiciaires clés, réforme de l’exception TDM.

Certains experts proposent un système de licence légale obligatoire (comme pour la musique diffusée en radio) : les éditeurs d’IA paieraient une redevance globale aux ayants droit, répartie selon l’utilisation réelle de leurs œuvres. Cette solution, défendue par certains syndicats d’auteurs, est très discutée. Elle nécessiterait une harmonisation internationale, difficile à obtenir.

Les acteurs techniques travaillent sur un standard universel d’opt-out, analogue au « robots.txt » des moteurs de recherche. Le « AI-opt-out » (ou « noai ») permettrait aux créateurs d’indiquer une fois pour toutes leur opposition à l’entraînement de modèles. Une adoption large par les éditeurs d’IA est attendue pour 2027, sous la pression réglementaire.

Plusieurs contentieux clés devraient aboutir dans les 12-24 mois (NYT c. OpenAI, Getty c. Stability). Leurs décisions, y compris en appel, créeront des précédents majeurs, notamment aux États-Unis. Une décision défavorable aux éditeurs d’IA pourrait bouleverser leur modèle économique.

Le cœur du débat juridique est de savoir si l’entraînement d’un modèle constitue une « reproduction » illicite au sens du droit d’auteur. Les juges devront trancher cette question technique. La réponse conditionnera l’ensemble du droit de l’IA générative.

Oui, sous conditions. Les conditions d’utilisation de Midjourney (payant) vous donnent les droits sur les images générées, sauf si vous êtes une entreprise de plus de 2 millions de dollars de chiffre d’affaires (conditions spécifiques). Pour DALL-E (OpenAI), vous êtes propriétaire des générations, mais OpenAI peut utiliser vos images pour améliorer ses modèles (sauf option de désactivation). Attention : ces droits « d’utilisation » ne sont pas équivalents à un droit d’auteur au sens juridique. Si vous souhaitez une protection juridique forte (par exemple pour déposer une marque ou défendre l’image devant un tribunal), la contribution humaine doit être substantielle (modifications, sélection créative).

Oui, dans la très grande majorité des cas. Les prompts courts sont considérés comme trop « banals » pour être protégés par le droit d’auteur. Même les prompts longs et originaux bénéficient d’une protection très faible (ils ne sont pas enregistrés comme œuvres littéraires). En pratique, vous pouvez utiliser n’importe quel prompt trouvé en ligne sans risque juridique notable. L’exception serait un recueil organisé de prompts (un « livre de prompts ») qui, lui, peut être protégé comme compilation.

Oui, c’est possible, surtout si l’œuvre est très présente dans les données d’entraînement (sur-apprentissage). On parle de « mémorisation » du modèle. Des chercheurs ont montré qu’il est possible d’extraire des passages entiers de livres ou d’images protégées en utilisant des prompts spécifiques. Si cela vous arrive, vous risquez une action en contrefaçon, même si vous ignoriez que l’IA allait reproduire cette œuvre. La prudence est de mise : ne générez pas de contenu imitant délibérément le style d’un artiste vivant identifiable (pas de « dans le style de Van Gogh » ou « à la manière de Tim Burton » sans autorisation).

Les risques principaux sont : 1) la contrefaçon si l’IA génère un contenu trop similaire à une œuvre protégée (rare mais possible), 2) l’absence de protection de vos propres contenus générés (un concurrent pourrait les réutiliser librement), 3) la violation des droits des tiers si vous entraînez un modèle sur des données non autorisées. Pour limiter ces risques, utilisez des modèles dont les conditions d’utilisation vous donnent des garanties (indemnisation en cas de contrefaçon — certains éditeurs commencent à proposer cette protection juridique). Consultez un avocat pour les usages sensibles.

Partiellement. L’AI Act impose aux éditeurs de modèles de publier un résumé des données d’entraînement, ce qui donne de la visibilité aux ayants droit. Il renforce aussi les obligations de transparence. Cependant, il ne crée pas de nouveau droit d’auteur ni de mécanisme de rémunération automatique. Les créateurs doivent donc se manifester individuellement (ou via des syndicats) pour faire valoir leurs droits. L’AI Act est un début, mais il ne résout pas tout.

Plusieurs options. D’abord, vérifiez si votre œuvre est effectivement dans un dataset d’entraînement (outils comme Have I Been Trained, Spawning AI). Ensuite, utilisez les mécanismes d’opt-out disponibles (certains éditeurs proposent des formulaires de retrait). Si l’éditeur ignore votre demande, vous pouvez envisager une action en justice, mais les frais peuvent être élevés. L’option collective (rejoindre un contentieux groupé) est souvent plus efficace. En Europe, vous pouvez aussi saisir l’Office européen de l’IA (depuis 2025) qui a des pouvoirs de médiation et d’injonction.