ChatGPT, Gemini, Claude, Midjourney : ces outils d’IA générative ont envahi le grand public en 2023-2024. Mais qu’en est-il dans l’entreprise ? Comment les déployer efficacement, sans risque juridique ni fuite de données confidentielles ? Quels usages apportent un véritable retour sur investissement, et lesquels relèvent encore du gadget ? Ce guide pratique, actualisé pour 2026, s’adresse aux managers, chefs de projet et décideurs qui souhaitent passer de l’expérimentation individuelle à une stratégie d’entreprise cohérente et maîtrisée.

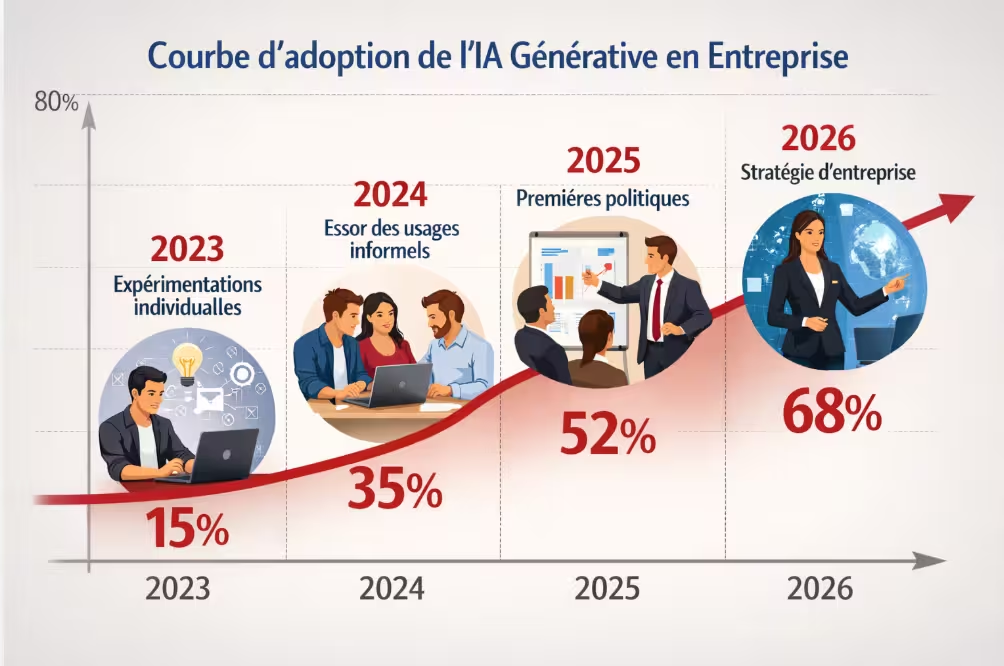

L’année 2023 a marqué l’irruption de l’IA générative dans le grand public avec ChatGPT. 2024 a été celle des expérimentations individuelles : des salariés, souvent dans leur coin, utilisaient l’outil pour rédiger des emails, résumer des documents ou générer des idées. 2025 a vu les premières politiques d’entreprise (interdiction pure et simple, ou au contraire encadrement bienveillant). Et 2026 est l’année de la maturation stratégique : l’IA générative n’est plus une option, mais un impératif concurrentiel pour de nombreuses entreprises.

Plusieurs facteurs expliquent cette accélération soudaine. D’abord, la maturité technologique : les modèles de 2026 (GPT-5 partiel, Gemini Ultra 2.0, Claude 4 Opus) sont bien plus fiables, moins « hallucinants » et mieux adaptés aux contextes professionnels que leurs prédécesseurs de 2023. Ensuite, la disponibilité d’offres enterprise : OpenAI, Google, Anthropic et Microsoft proposent désormais des versions dédiées aux entreprises avec des garanties de confidentialité, des contrats de sous-traitance conformes au RGPD, et des interfaces d’administration centralisée. Enfin, la pression concurrentielle : les entreprises qui n’adoptent pas l’IA générative subissent un handicap de productivité croissant face à celles qui l’ont intégrée.

Infographie n°1 – Courbe d’adoption de l’IA générative en entreprise : de l’expérimentation individuelle à la stratégie d’entreprise (2023-2026).

Tous les usages de l’IA générative ne se valent pas. Certains apportent un retour sur investissement rapide et mesurable ; d’autres restent anecdotiques ou même contre-productifs. Voici les domaines où l’IA générative a fait ses preuves en entreprise.

Le cas d’usage le plus répandu et le plus mature. L’IA aide à rédiger des emails professionnels (propositions commerciales, réponses à des réclamations, relances), des notes de synthèse, des comptes rendus de réunion (à partir de notes brutes ou de transcriptions), et des comptes rendus d’entretien. Gain de temps typique : 30 à 50 % sur ces tâches, avec une qualité souvent supérieure à celle d’un premier jet rédigé à la hâte.

Articles de blog, fiches produits, descriptions pour site e-commerce, posts pour réseaux sociaux, newsletters : l’IA génère un premier jet structuré, que le rédacteur humain retravaille, personnalise et valide. L’équipe marketing peut ainsi produire deux à trois fois plus de contenu à budget constant, ou maintenir le volume avec une équipe réduite.

Un contrat de 50 pages, un rapport annuel de 200 pages, une revue de presse de 30 articles : l’IA peut résumer, extraire les points clés, répondre à des questions précises (« que dit le contrat sur la durée de préavis ? »), et même comparer plusieurs documents. Des outils comme Claude (200 000 tokens de contexte, soit environ 150 000 mots) ou Gemini 1.5 Pro (2 millions de tokens) excellent sur cet usage.

Les modèles modernes (GPT-4o, Gemini, Claude) traduisent dans des dizaines de langues avec une qualité équivalente ou supérieure aux solutions spécialisées (DeepL) pour les textes généraux. Pour les textes techniques ou juridiques, une relecture humaine reste recommandée, mais le gain de temps est considérable.

« Propose dix noms pour ce nouveau produit », « Quels sont les arguments de vente potentiels pour cette offre ? », « Quelles questions anticiper de la part des clients ? » — l’IA ne remplace pas la créativité humaine, mais elle l’augmente en suggérant des pistes, en débloquant les situations de page blanche, et en apportant des angles auxquels on n’avait pas pensé.

Selon une étude de Boston Consulting Group menée auprès de 758 entreprises (publiée en juin 2025), les entreprises qui ont déployé l’IA générative sur au moins trois cas d’usage constatent en moyenne une réduction de 27 % des coûts opérationnels sur les périmètres concernés et une amélioration de 22 % de la satisfaction client (CSAT). Le retour sur investissement est positif dès la première année dans 64 % des cas.

Tout aussi important que de savoir ce que l’IA peut faire, il faut savoir ce qu’il ne faut pas lui confier — du moins sans précautions extrêmes.

C’est la règle d’or, trop souvent violée. Les versions gratuites ou grand public des outils IA (ChatGPT gratuit, Gemini gratuit, etc.) utilisent les conversations pour entraîner et améliorer leurs modèles. Si un salarié y copie un fichier client, un contrat confidentiel, une liste de salaires ou des données personnelles (nom, adresse, numéro de téléphone), ces informations peuvent potentiellement resurgir dans les réponses données à d’autres utilisateurs. Les versions « Enterprise » (payantes) offrent des garanties contractuelles de non-utilisation des données, mais même avec celles-ci, la prudence reste de mise.

L’IA générative peut « halluciner » — inventer des faits, des citations, des références juridiques inexistantes. Confier à un LLM une décision importante (recrutement, crédit, diagnostic médical) sans validation humaine est dangereux et, dans certains secteurs, illégal (ex : règlement européen sur l’IA — AI Act — qui classe certains usages comme « à haut risque »).

Un texte généré par IA semble souvent très convaincant, bien écrit, structuré. Cette apparence de compétence peut conduire à une validation trop rapide. Des études montrent que les utilisateurs non experts valident les réponses de l’IA comme correctes dans 70 à 80 % des cas, alors que le taux d’erreur réel sur des sujets complexes peut atteindre 20 à 30 %. La relecture humaine critique est indispensable.

Appliquez la « règle des trois C » : ne confiez à l’IA que ce qui est Courant, Contrôlable et Corrigible. Courant : des tâches fréquentes où l’erreur est peu coûteuse. Contrôlable : vous pouvez vérifier facilement le résultat. Corrigible : une erreur peut être rattrapée sans dommage majeur. En dehors de ce périmètre, la supervision humaine est obligatoire.

Le choix de l’outil dépend de vos besoins spécifiques, de votre budget et de votre infrastructure existante (Microsoft, Google Workspace, etc.). Voici un tableau comparatif des principales offres « entreprise » en 2026.

| Outil | Version Enterprise | Prix indicatif (par utilisateur/mois) | Force principale | Intégration native |

|---|---|---|---|---|

| ChatGPT Enterprise | OpenAI | 60-80 € (négociable) | Polyvalence, qualité générale, vaste écosystème de plugins | API, peu d’intégrations bureautiques natives |

| Gemini for Google Workspace | 30-40 € (en sus de Workspace) | Intégration Gmail, Docs, Sheets, Meet, Slides | Google Workspace (excellente) | |

| Microsoft Copilot | Microsoft 365 Copilot | 30 € (licence Microsoft 365 requise) | Intégration Word, Excel, PowerPoint, Outlook, Teams | Microsoft 365 (excellente) |

| Claude Enterprise | Anthropic | 50-70 € | Très grand contexte (200k tokens), moindre hallucination | API, peu d’intégrations natives |

Tableau comparatif mis à jour en avril 2026. Les prix sont indicatifs et varient selon le volume d’utilisateurs, la durée d’engagement et les fonctionnalités optionnelles.

Recommandation : Si votre entreprise utilise déjà Microsoft 365, Copilot est un choix naturel (intégration transparente). Si vous êtes sur Google Workspace, Gemini s’impose. Pour des usages très spécifiques (analyse de très longs documents), Claude est imbattable. ChatGPT Enterprise reste le plus polyvalent et le plus riche en fonctionnalités, mais sans intégration bureautique poussée.

Passer de l’expérimentation individuelle à un déploiement structuré nécessite une méthode. Voici les étapes recommandées par les cabinets de conseil spécialisés.

Quels salariés utilisent déjà l’IA générative (même sans autorisation officielle) ? Pour quels usages ? Avec quels outils (versions gratuites ou payantes) ? Un audit interne, de préférence anonyme, permet de cartographier les pratiques réelles et d’identifier les risques (fuites de données notamment).

Rédigez une charte d’utilisation de l’IA générative qui précise : les usages autorisés et interdits, les outils recommandés (versions Enterprise avec garanties), la procédure en cas de doute, les obligations de relecture humaine, et les sanctions en cas de non-respect.

Sélectionnez un ou deux outils adaptés à vos besoins (voir tableau comparatif). Déployez-les d’abord auprès d’une équipe pilote (10 à 30 personnes volontaires, représentatives des métiers). Formez-les, recueillez leurs retours, mesurez les gains de productivité.

Sur la base du pilote, déployez à plus grande échelle. Organisez des sessions de formation obligatoires : comment rédiger un prompt efficace, comment vérifier les réponses, quelles données ne jamais partager, comment signaler une anomalie.

Mesurez régulièrement l’adoption (quel pourcentage d’utilisateurs actifs ?), les usages dominants, les gains de productivité, et les incidents éventuels. Ajustez la politique, les outils, les formations en conséquence.

Ne sous-estimez pas l’étape de formation. La plupart des salariés ne savent pas rédiger un prompt efficace. Un prompt vague (« écris un email ») donne un résultat médiocre. Un prompt structuré (contexte, rôle, instruction précise, format, ton, contraintes) donne un résultat utilisable. Une demi-journée de formation change la donne.

La formation à l’IA générative ne consiste pas à apprendre à « programmer » ou à « coder ». Il s’agit avant tout d’acquérir une nouvelle compétence rédactionnelle : l’art du prompt. Voici les éléments clés à intégrer dans votre plan de formation.

Un bon prompt suit généralement une structure en quatre parties : 1) Contexte : quel est le cadre ? 2) Rôle : qui est l’IA (expert, conseiller, rédacteur) ? 3) Instruction : que faire exactement ? 4) Format et ton : comment présenter la réponse ? Exemple : « Tu es un expert en communication commerciale. Rédige un email de relance pour un client qui n’a pas donné suite à notre proposition. Le ton doit être courtois mais pas insistant. Structure : rappel de la proposition, valeur ajoutée rappelée, proposition d’un appel de 5 minutes, formule de politesse. »

L’IA « hallucine » régulièrement, surtout sur des sujets précis ou récents. Il faut former les équipes à ne jamais prendre une réponse IA pour argent comptant, surtout quand elle cite des chiffres, des dates, des noms, des références juridiques ou des études. La règle : « l’IA propose, l’humain dispose ».

Un premier résultat est rarement parfait. La compétence clé est de savoir affiner le prompt en fonction du résultat obtenu : « plus concis », « ajoute un exemple », « change le ton pour qu’il soit plus formel », « structure en trois paragraphes avec sous-titres ». Cette boucle de rétroaction est au cœur de l’utilisation efficace de l’IA.

Le cadre juridique de l’IA générative en entreprise s’est précisé ces deux dernières années. Voici les principaux points à connaître pour les entreprises européennes.

Entré en application progressive à partir de 2025, l’AI Act classe les systèmes d’IA en fonction de leur niveau de risque. L’utilisation de l’IA générative dans l’entreprise n’est pas interdite, mais elle impose des obligations de transparence : informer les utilisateurs qu’ils interagissent avec une IA, publier un résumé des données d’entraînement, et mettre en place une supervision humaine pour les usages « à haut risque » (ex : recrutement automatisé, évaluation de solvabilité).

Le RGPD reste pleinement applicable. Si l’IA générative traite des données personnelles (nom, email, adresse, etc.), l’entreprise doit respecter les principes de minimisation, de finalité et de sécurité. L’injection de données personnelles dans un modèle tiers (ex : ChatGPT) est généralement interdite sans consentement explicite des personnes concernées et sans garanties contractuelles du fournisseur. Les versions « Enterprise » avec clauses RGPD sont une solution, mais la prudence reste de mise.

En droit européen, un contenu généré entièrement par IA n’est pas éligible au droit d’auteur, faute d’auteur humain. En revanche, un contruit « augmenté » par l’IA avec une contribution humaine significative (sélection, arrangement, modification) peut être protégé. Pour les entreprises, il est conseillé de conserver une trace de la « relecture et validation humaine » et d’éviter de revendiquer un droit d’auteur exclusif sur du contenu 100 % IA.

Faites-vous accompagner par un avocat spécialisé en droit du numérique pour rédiger votre politique interne d’utilisation de l’IA générative. Les contentieux sur ce sujet commencent à émerger (fuites de données, utilisation non autorisée d’œuvres protégées, non-respect du RGPD). Mieux vaut prévenir que guérir.

L’IA générative ne va pas stagner. Plusieurs tendances structurent les 18 prochains mois et doivent influencer votre stratégie d’entreprise.

Au lieu de simplement répondre à des questions, les prochaines générations d’IA pourront agir : envoyer des emails, mettre à jour un CRM, programmer des réunions, déclencher des paiements, etc. Ces « agents IA » fonctionneront sous supervision humaine, mais automatiseront des chaînes complètes de tâches. Les entreprises doivent anticiper cette évolution en identifiant quels processus pourraient être confiés à des agents.

Les modèles génériques (ChatGPT, Gemini) laissent progressivement place à des modèles spécialisés par secteur : juridique (Harvey), médical (Glass Health), financier (Bloomberg GPT), etc. Ces modèles, entraînés sur des données de domaine, sont plus précis et moins hallucinants. Les entreprises devraient évaluer ces offres spécialisées plutôt que de tout faire avec un modèle généraliste.

Pour les entreprises très sensibles à la confidentialité (défense, banque, santé, R&D stratégique), les modèles déployés en interne (sur leurs propres serveurs) deviennent une option réaliste. Des modèles comme Llama 4, Mistral Large 3 ou Falcon 3 peuvent être exécutés localement avec des performances proches des modèles cloud. Le coût (matériel, maintenance) reste élevé, mais la tendance est à la baisse.

Les versions gratuites utilisent vos conversations pour entraîner les modèles (risque de fuite de données confidentielles), n’offrent aucune garantie contractuelle, et ne respectent pas le RGPD par défaut. Les versions Enterprise proposent des garanties de non-utilisation des données, des contrats de sous-traitance conformes au RGPD, une interface d’administration centralisée (gestion des utilisateurs, logs), et souvent des fonctionnalités avancées (plus de contexte, API plus rapides). Le surcoût (30 à 80 €/utilisateur/mois) est généralement justifié pour un usage professionnel régulier.

Commencez par un projet pilote à petite échelle (une équipe, un mois). Mesurez les gains de temps (par exemple, 30 % de temps gagné sur la rédaction des comptes rendus). Calculez le retour sur investissement projeté (temps gagné × coût horaire × nombre d’utilisateurs). Présentez également les risques de ne pas investir (retard concurrentiel, départ des talents attirés par des entreprises plus modernes). Les études de cas sectorielles (disponibles chez McKinsey, BCG, Accenture) sont également utiles pour appuyer votre argumentaire.

L’interdiction pure et simple est difficile à faire respecter (les salariés continueront à les utiliser en cachette). Mieux vaut une approche nuancée : autoriser les versions gratuites pour les usages sans donnée confidentielle (brainstorming, reformulation, correction orthographique), mais les interdire formellement pour tout traitement de données personnelles, commerciales sensibles ou stratégiques. Accompagnez cette règle d’une formation et de sanctions proportionnées en cas de non-respect.

Pour une PME, commencez par trois usages à faible risque et fort ROI : 1) assistance à la rédaction d’emails commerciaux et de relances, 2) génération d’idées pour les posts sur les réseaux sociaux, 3) synthèse de comptes rendus de réunion. Utilisez une version payante peu coûteuse (ChatGPT Plus à 20 €/mois pour quelques utilisateurs clés) ou une version Enterprise si vous avez plus de 10 utilisateurs. Évitez les usages à risque (données clients, décisions financières).

Plusieurs indicateurs possibles : temps moyen passé sur une tâche avant/après (ex : rédaction d’un email commercial), volume de production (ex : nombre d’articles de blog par mois), taux d’erreur ou de relecture, satisfaction des équipes (enquête interne), et pour les usages clients, taux de réponse, délai de réponse, satisfaction client. Idéalement, mesurez sur une période de 2-3 mois avec un groupe test et un groupe témoin. Les gains de productivité varient de 20 à 50 % selon les tâches.

Les métiers les plus impactés positivement sont ceux où la production de texte, la synthèse d’information ou la traduction sont centraux : marketing, communication, service client, juridique (première analyse), ressources humaines (rédaction d’offres, comptes rendus d’entretien), formation (génération d’exercices). Les métiers les plus menacés à moyen terme sont ceux où la production de contenu standardisé est l’essentiel de la valeur : rédacteurs techniques de contenu basique, traducteurs de textes non littéraires, certains postes de saisie ou de relecture de bas niveau. Dans tous les cas, l’IA augmente plus qu’elle ne remplace : les professionnels qui savent l’utiliser deviennent plus productifs que ceux qui l’ignorent.