C’est quoi le data engineering : rôle, outils et architectures modernes

Une introduction complète au métier de data engineer et aux fondements des architectures data contemporaines.

Dans un contexte où les volumes de données explosent et où les usages liés à l’intelligence artificielle se multiplient, construire des pipelines de données efficaces est devenu un enjeu central. Cet article propose un tour d’horizon complet des fondements, outils, bonnes pratiques et pièges à éviter pour concevoir des pipelines robustes, scalables et adaptés aux exigences modernes. Un guide structuré, à destination des professionnels de la donnée, pour bâtir des architectures performantes et durables.

À l’ère du Big Data et de l’intelligence artificielle, la quantité, la vitesse et la diversité des données produites chaque seconde ont atteint des niveaux inédits. Pour tirer parti de ce déluge d’informations, les entreprises doivent s’appuyer sur des pipelines de données robustes, capables de traiter et d’acheminer les flux de données en temps réel ou en batch, tout en garantissant qualité, sécurité et performance.

Or, face à des enjeux technologiques de plus en plus complexes, il devient essentiel de concevoir des pipelines qui soient non seulement scalables et fiables, mais aussi optimisés pour minimiser les coûts et répondre à des contraintes de latence réduite.

Ce guide a pour ambition de fournir une vision claire et structurée des meilleures pratiques pour construire des pipelines de données efficaces. Il propose des repères concrets sur :

Ce guide s’adresse aux :

Dans l’univers de la Big Data et de l’intelligence artificielle, les pipelines de données jouent un rôle central. Ils assurent le transport, le traitement et la mise à disposition des données à chaque étape du cycle analytique. Bien conçus, ils permettent d’alimenter efficacement les tableaux de bord, les modèles de machine learning ou encore les systèmes décisionnels. Comprendre les fondamentaux d’un pipeline de données est donc essentiel pour tout projet de traitement de données à grande échelle.

Un pipeline de données (ou pipeline de traitement de données) désigne l’ensemble des étapes permettant de collecter, stocker, transformer et servir les données de manière automatisée et reproductible. Il s’agit d’une infrastructure logicielle qui orchestre le flux d’informations depuis leur source jusqu’à leur destination finale (analyse, visualisation, machine learning).

Un pipeline de données est généralement constitué des éléments suivants :

Les sources de données sont les points d’entrée du pipeline. Elles peuvent être multiples et hétérogènes :

La diversité des formats et des protocoles rend cette phase complexe, nécessitant des connecteurs robustes et évolutifs.

Les données collectées doivent ensuite être stockées dans des environnements adaptés à leur volumétrie et leur fréquence de mise à jour. On distingue généralement :

La phase de transformation des données est cruciale pour garantir leur qualité et leur pertinence. Deux grandes approches coexistent :

Les traitements peuvent être réalisés en mode batch (traitement par lots) ou en streaming (traitement en temps réel), selon les cas d’usage.

La dernière étape du pipeline consiste à servir les données transformées aux utilisateurs finaux ou aux systèmes consommateurs. Cela peut prendre plusieurs formes :

Les pipelines batch exécutent les traitements à intervalles réguliers (toutes les heures, une fois par jour, etc.). Ils sont adaptés aux contextes où les données n’évoluent pas en continu ou lorsqu’une faible latence n’est pas nécessaire. Par exemple, l’agrégation des ventes quotidiennes d’une enseigne de distribution peut être réalisée via un batch quotidien.

Les pipelines en streaming traitent les données en temps réel ou quasi-réel, dès leur arrivée. Ils utilisent des technologies comme Apache Kafka, Apache Flink, ou Apache Spark Structured Streaming. Ce type de pipeline est privilégié lorsqu’il faut détecter des événements en temps réel, comme dans le cas de la fraude bancaire ou de la maintenance prédictive dans l’industrie.

Les architectures hybrides combinent les avantages du batch et du streaming :

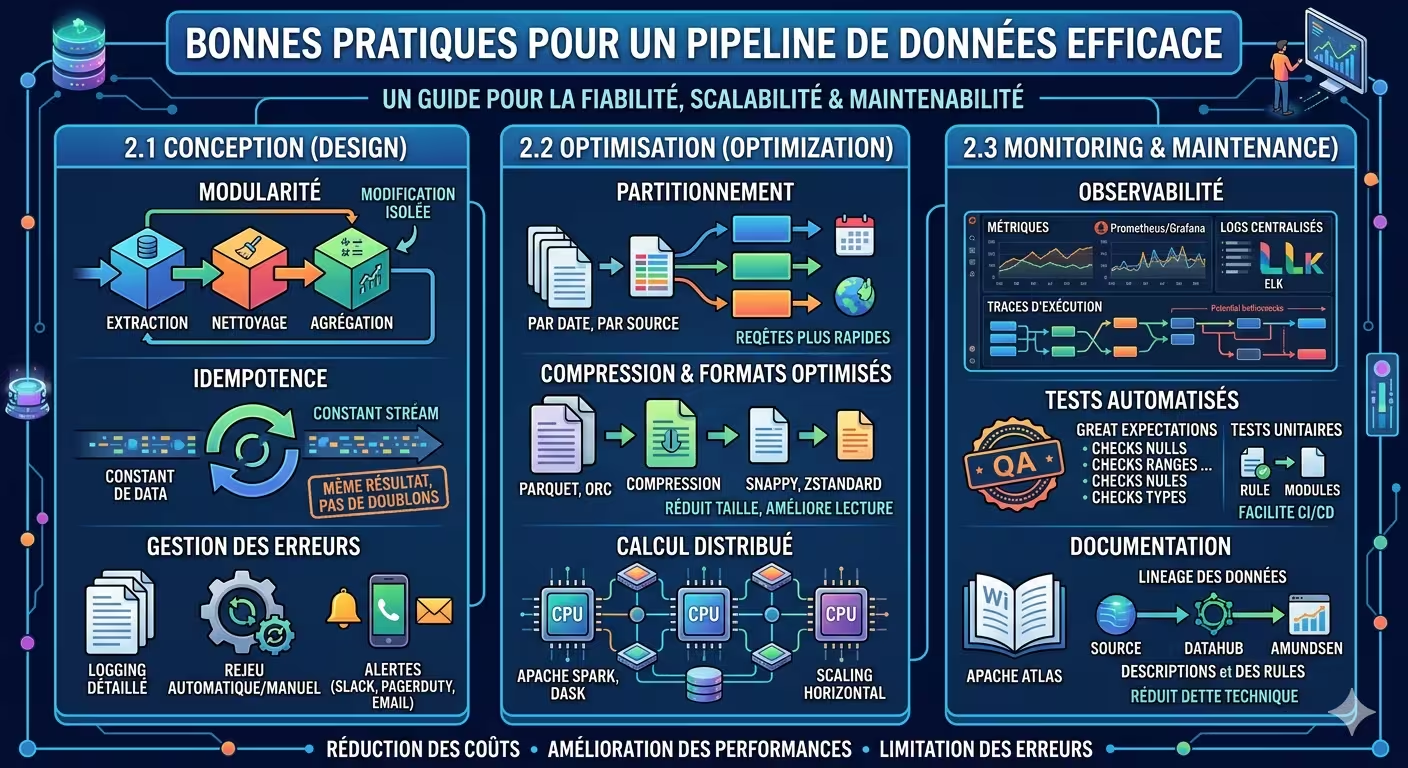

La construction d’un pipeline de données ne se limite pas à faire circuler l'information d’un point A à un point B. Pour garantir la fiabilité, la scalabilité et la maintenabilité des flux de données, certaines bonnes pratiques s’imposent dès la conception. Un pipeline bien conçu permet de réduire les coûts, d’améliorer les performances et de limiter les erreurs. Voici les recommandations essentielles pour bâtir un pipeline de données robuste et évolutif.

La modularité est au cœur de tout pipeline de données durable. Il est recommandé de découper les étapes en blocs fonctionnels indépendants :

Chaque module peut être testé, modifié ou remplacé sans impacter l’ensemble, ce qui favorise l’agilité dans les évolutions futures.

Un pipeline bien conçu doit être idempotent, c’est-à-dire qu’un même traitement rejoué plusieurs fois doit produire le même résultat, sans générer de doublons. Cela permet de réexécuter des étapes en cas de panne, sans risque de corruption des données en aval.

Un bon pipeline doit savoir faire face aux erreurs sans s’écrouler. Les pratiques recommandées incluent :

Ces outils renforcent la résilience du pipeline face aux imprévus.

Le partitionnement des données, notamment par date ou par source, est une stratégie d’optimisation incontournable dans un Data Lake ou un entrepôt de données. Il permet :

Cette pratique est souvent couplée à des moteurs comme Apache Hive, Presto ou Trino.

Utiliser des formats columnaires comme Parquet ou ORC, combinés à des algorithmes de compression efficaces (Snappy, Zstandard), permet de réduire drastiquement la taille des fichiers tout en améliorant les temps de lecture.

Ces optimisations sont essentielles pour les traitements massifs.

Pour le scaling horizontal et le traitement de grands volumes de données, le recours à des frameworks de calcul distribué est fortement recommandé :

Ces outils permettent de paralléliser les traitements sur plusieurs nœuds, améliorant ainsi la vitesse d’exécution.

Un pipeline sans monitoring est une boîte noire. L’observabilité repose sur trois piliers :

Une bonne visibilité permet de réagir rapidement et d’anticiper les défaillances.

Assurer la qualité des données est aussi critique que celle du code. Il est recommandé d’intégrer des tests automatisés :

Ces pratiques facilitent le déploiement en continu (CI/CD) des pipelines.

La documentation du pipeline doit être claire, à jour et accessible. Elle inclut notamment :

Une bonne documentation facilite l’onboarding des nouveaux collaborateurs et réduit la dette technique.

Le paysage technologique autour des pipelines de données évolue rapidement. Les entreprises disposent aujourd’hui d’un large éventail d’outils, allant des solutions open source robustes aux services managés en cloud. Le choix de l’outil dépend du contexte : exigences métiers, scalabilité, gouvernance, compétences internes. Voici un panorama des technologies modernes à connaître pour bâtir des pipelines performants et évolutifs.

Les outils open source restent plébiscités pour leur flexibilité, leur communauté active et leur capacité à s’intégrer dans des architectures personnalisées. Voici les solutions phares :

Ces outils open source permettent de garder un contrôle total sur l’architecture et les coûts, au prix toutefois d’une gestion plus complexe.

Les services cloud simplifient le déploiement, la scalabilité et la maintenance des pipelines de données. Les principaux fournisseurs (AWS, GCP, Azure) proposent des outils managés couvrant l’ensemble du cycle de vie des données :

Ces plateformes offrent des services managés, scalables et intégrés à l’écosystème cloud, réduisant la charge d’administration au profit d’une mise en production rapide.

Les besoins d’agilité, de gouvernance distribuée et d’intégration IA font émerger de nouveaux paradigmes technologiques. Parmi eux :

Le Data Mesh propose une alternative à l’approche centralisée du data lake ou du data warehouse. Il repose sur la décentralisation des responsabilités :

Cette architecture favorise l’évolutivité organisationnelle, notamment dans les grandes entreprises ou les structures multi-équipes.

Avec la montée en puissance des cas d’usage IA, l’intégration de pratiques MLOps devient incontournable. Parmi les outils émergents :

D’autres solutions comme Kubeflow, Metaflow ou Weights & Biases viennent compléter cet écosystème centré sur l’industrialisation du machine learning.

La théorie et les outils sont essentiels, mais rien ne vaut des cas concrets pour comprendre comment bâtir un pipeline de données efficace. Cette section propose deux exemples typiques de pipelines (batch et streaming), suivis des erreurs courantes qui freinent la réussite des projets data.

Une grande chaîne de distribution souhaite analyser quotidiennement ses ventes issues de plusieurs systèmes (e-commerce, caisses en magasin, partenaires tiers).

Architecture :

Ce pipeline batch, exécuté chaque nuit, permet de piloter l’activité commerciale à J+1 tout en assurant robustesse et scalabilité.

Une fintech souhaite détecter en temps réel des transactions suspectes afin de bloquer immédiatement les comportements frauduleux.

Architecture :

Ce pipeline streaming réduit le temps de réaction de plusieurs minutes à quelques millisecondes, améliorant la sécurité et la confiance des clients.

Même avec les meilleurs outils, des choix techniques mal adaptés ou une gouvernance négligée peuvent ruiner l’efficacité d’un pipeline. Voici les pièges les plus fréquents :

L’un des travers les plus répandus est de choisir des outils inadaptés à la simplicité du besoin. Par exemple :

Résultat : surcoût, dette technique, surcharge cognitive pour les équipes… Il est essentiel d’ajuster la sophistication technique au besoin métier réel.

Sans stratégie claire de gouvernance des données, les pipelines deviennent des boîtes noires, difficiles à maintenir et à faire évoluer :

À terme, le Data Lake se transforme en Data Swamp, rendant l’analyse plus risquée que bénéfique. D’où l’importance d’intégrer dès le début des outils de catalogage, de versioning et de documentation automatique.

Construire un pipeline de données performant ne repose pas sur l'accumulation d'outils sophistiqués, mais sur un équilibre entre simplicité, résilience et évolutivité. De la définition des composants essentiels (extraction, transformation, stockage, serving) jusqu’au choix entre traitement batch ou streaming, chaque décision technique doit être guidée par le besoin métier, la qualité des données et la capacité de maintenance à long terme.

Les bonnes pratiques – comme la modularité, l'idempotence, l'observabilité ou encore la documentation – permettent non seulement de garantir la fiabilité des flux de données, mais aussi de préparer le pipeline à évoluer au rythme des usages et des volumes croissants.

À l’horizon 2024 et au-delà, plusieurs tendances émergent et redéfinissent les architectures data modernes :

Face à ces évolutions, les ingénieurs data sont appelés à développer une culture de l’adaptabilité : savoir choisir le bon outil, au bon moment, pour le bon usage. Car au final, un pipeline de données efficace n’est pas figé : il est vivant, itératif et orienté impact.

Pour approfondir la mise en œuvre et la compréhension des pipelines de données, plusieurs ressources peuvent servir de base solide :

Un pipeline de données (ou pipeline de traitement de données) est une série d’étapes automatisées qui collectent, transforment et acheminent des données depuis des sources variées vers des systèmes d’analyse, de visualisation ou d’IA. Il garantit la fiabilité, la reproductibilité et la scalabilité des flux de données.

ETL (Extract, Transform, Load) transforme les données avant de les charger dans l’entrepôt. ELT (Extract, Load, Transform) charge d’abord les données brutes dans l’entrepôt (souvent un Data Lake ou un Data Warehouse moderne), puis les transforme à la demande. L’ELT tire parti de la puissance de calcul des entrepôts cloud (BigQuery, Snowflake) et est aujourd’hui privilégié pour les architectures scalables.

Le choix dépend du contexte. Pour l’orchestration : Apache Airflow, Dagster, Prefect. Pour le streaming : Apache Kafka, Apache Flink. Pour la transformation : dbt (SQL), Apache Spark (big data). Les clouds proposent des alternatives managées (AWS Glue, Cloud Dataflow, Azure Data Factory). L’important est d’aligner la techno sur la complexité du besoin.

La qualité des données se construit par : des tests automatisés (Great Expectations, tests unitaires), des contrôles de validation en amont et en aval des transformations, une observabilité poussée (métriques, logs, alertes), et une documentation du lineage. L’idempotence des traitements est également essentielle pour éviter les doublons.

Un pipeline batch traite les données par lots à intervalles fixes (par exemple toutes les heures ou chaque nuit). Un pipeline streaming traite les données en temps réel, dès qu’elles arrivent. Le choix dépend de la latence acceptable : quelques minutes/heures pour le batch, quelques secondes/millisecondes pour le streaming.

Pour éviter le Data Swamp (lac de données non gouverné), il faut : mettre en place un catalogue de données (DataHub, Amundsen), documenter le lineage, appliquer des schémas de données dès l’ingestion, et instaurer des bonnes pratiques de nommage et de partitionnement. La gouvernance doit être pensée dès le départ, pas après.

Les tendances majeures incluent : l’IA générative pour la génération automatique de pipelines, l’Edge Computing pour rapprocher les traitements des sources, l’observabilité accrue (Data Observability), et l’adoption du Data Mesh pour une gouvernance distribuée. Les architectures serverless gagnent également du terrain pour réduire les coûts d’infrastructure.