Monitoring vs observabilité

Les approches complémentaires pour la cybersécurité.

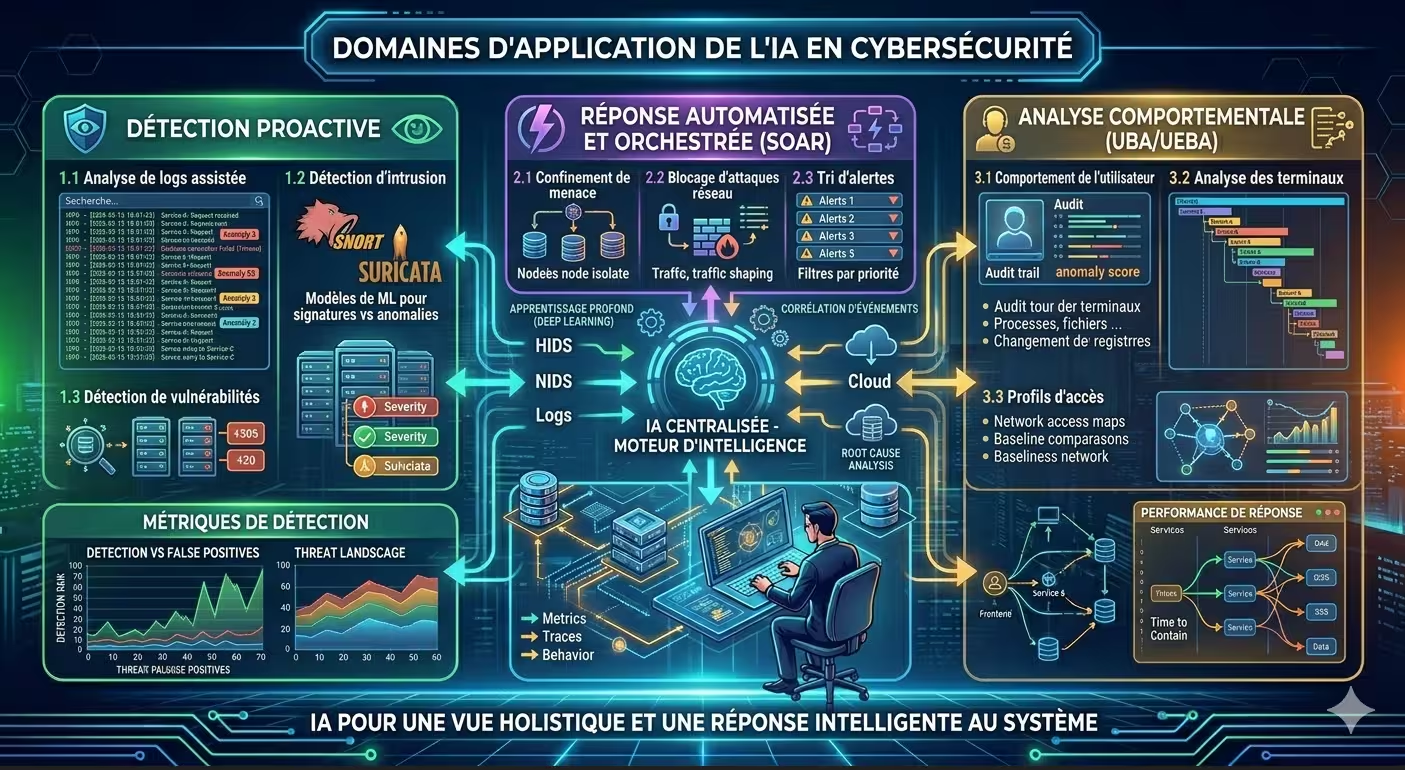

Détection des menaces en temps réel, analyse comportementale, réponse automatisée aux incidents : comment l'IA transforme la cyberdéfense des entreprises.

Les cyberattaques sont de plus en plus fréquentes, sophistiquées et coûteuses. Face à cette menace grandissante, les entreprises ne peuvent plus compter uniquement sur des défenses traditionnelles basées sur des règles et des signatures. L'intelligence artificielle (IA) s'impose comme un bouclier essentiel pour anticiper, détecter et neutraliser les cybermenaces en temps réel.

L'IA ne remplace pas les experts en cybersécurité, elle les augmente. Elle analyse des volumes massifs de données, détecte des anomalies invisibles à l'œil humain et automatise les réponses aux incidents courants.

schéma des domaines d'application de l'IA en cybersécurité.

Les cybercriminels innovent en permanence. Les ransomwares, les attaques par hameçonnage (phishing), les menaces internes et les attaques zero-day se multiplient. Les approches traditionnelles (antivirus, pare-feu basés sur des signatures) sont dépassées car elles ne détectent que les menaces connues.

Les entreprises génèrent des téraoctets de données de sécurité chaque jour (logs, trafic réseau, alertes). Les humains ne peuvent pas analyser ces volumes. L'IA, si.

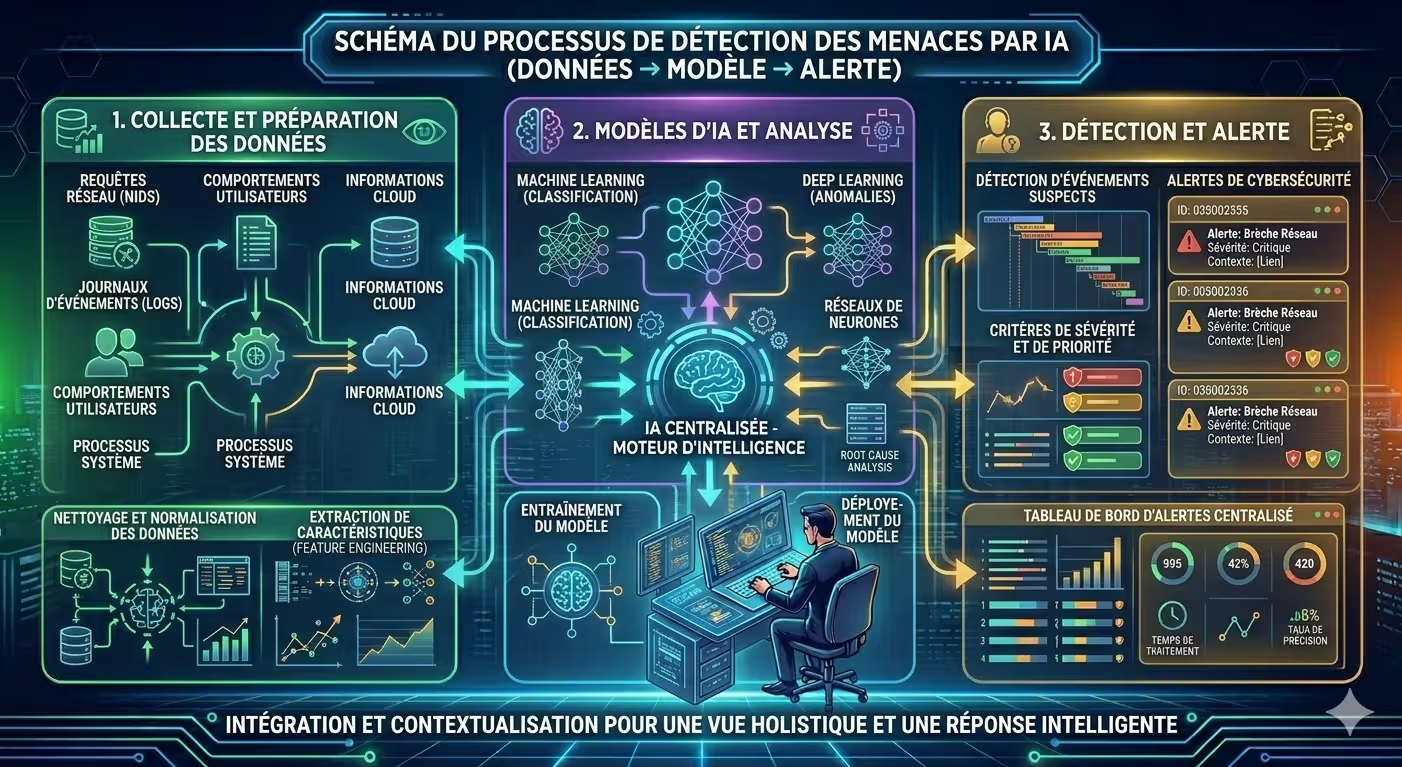

L'IA excelle dans l'analyse de volumes massifs de données pour identifier des comportements suspects. Contrairement aux systèmes traditionnels basés sur des signatures, l'IA peut détecter des menaces inconnues (zero-day) en identifiant des anomalies statistiques.

Le modèle est entraîné sur des millions d'échantillons de trafic normal et malveillant pour apprendre à distinguer les deux.

Le modèle identifie des comportements anormaux sans connaître à l'avance ce qui est malveillant. Idéal pour les attaques zero-day.

Les réseaux de neurones profonds analysent des patterns complexes dans le trafic réseau ou les logs système.

# Détection de tentative de brute force sur logs SSH

Pattern normal : 1-2 tentatives échouées par heure

Pattern anormal : 1000+ tentatives en 5 minutes depuis une même IP

L'IA détecte l'anomalie et déclenche une alerte ou un blocage automatique.

schéma du processus de détection des menaces par IA.

Une fois une menace détectée, la vitesse de réponse est cruciale. L'IA peut automatiser des actions de remédiation immédiates :

Les plateformes SOAR intègrent l'IA pour orchestrer la réponse aux incidents, réduisant le temps de réaction de plusieurs heures à quelques secondes.

L'analyse comportementale (User and Entity Behavior Analytics - UEBA) utilise l'IA pour établir une "baseline" du comportement normal des utilisateurs et des systèmes, puis détecter les écarts.

| Comportement normal | Comportement suspect |

|---|---|

| Connexion depuis Paris, 9h-18h | Connexion depuis un pays étranger à 3h du matin |

| Transfert de 10 Mo de données par jour | Transfert de 10 Go de données vers un serveur inconnu |

| Accès à 5 fichiers par heure | Accès à 500 fichiers en 5 minutes |

L'analyse comportementale détecte les menaces internes (insiders malveillants ou comptes compromis) que les solutions traditionnelles ne voient pas.

schéma de la baseline comportementale et de la détection d'anomalies.

L'IA peut générer de nombreuses alertes erronées, submergeant les équipes sécurité. Un bon équilibre est essentiel.

Les cybercriminels peuvent concevoir des attaques spécifiquement pour tromper les modèles d'IA (ex: modification infime d'un malware pour éviter la détection).

Si les données d'entraînement ne représentent pas la réalité, l'IA aura des angles morts.

Certains modèles (deep learning) sont des "boîtes noires" : on ne sait pas pourquoi ils ont pris une décision.

Les cybercriminels utilisent aussi l'IA pour automatiser leurs attaques (phishing personnalisé, contournement des captchas, génération de malwares polymorphes). C'est une course à l'armement.

L'IA ne remplacera jamais complètement les experts en cybersécurité. La meilleure stratégie est hybride :

Les équipes de cybersécurité seront composées d'experts IA + humains. Les analystes sécurité deviendront des "chasseurs de menaces" (threat hunters) aidés par l'IA.

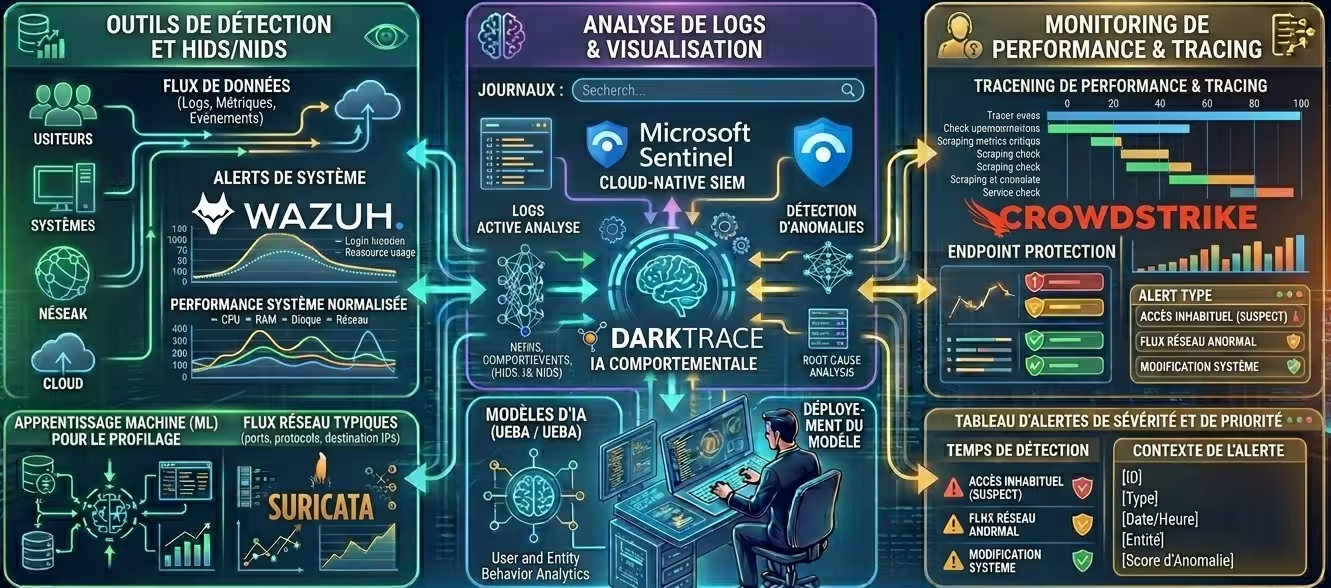

| Outil | Fonction | Type |

|---|---|---|

| Darktrace | Détection des anomalies par IA (UEBA) | Propriétaire |

| CrowdStrike Falcon | Endpoint Detection and Response (EDR) avec IA | Propriétaire |

| Microsoft Sentinel | SIEM + SOAR avec IA intégrée | Cloud (Azure) |

| Wazuh | SIEM open source (avec capacités IA via ELK) | Open source |

| Suricata | NIDS open source avec détection avancée | Open source |

collage des logos Darktrace, CrowdStrike, Sentinel, Wazuh, Suricata.

Non. L'IA est très efficace pour détecter les anomalies et les attaques connues, mais les attaques sophistiquées et ciblées (APT) peuvent passer sous les radars. D'où l'importance de l'approche hybride IA + humains.

Une attaque où l'attaquant modifie subtilement les données d'entrée pour tromper le modèle d'IA. Exemple : ajouter quelques pixels imperceptibles sur une image pour qu'un classifieur la reconnaisse comme un objet différent.

Oui, des solutions abordables existent : Wazuh (open source), Microsoft Defender for Business, ou des solutions cloud avec paiement à l'usage. Le coût d'une violation est bien plus élevé que l'investissement dans la protection.

EDR (Endpoint Detection and Response) : se concentre sur les endpoints (PC, serveurs). XDR (Extended Detection and Response) : intègre endpoints, réseau, cloud, emails. L'IA est au cœur des deux.

Oui. Si les données d'entraînement sont biaisées (ex: sous-représentation de certains types d'attaques), le modèle aura des angles morts. D'où l'importance de la diversité des données et des audits réguliers.

Certifications : CompTIA Security+, CISSP, GIAC. Cours en ligne : "AI for Cybersecurity" (Coursera), "Machine Learning for Security" (Fast.ai). Pratiquez avec des plateformes comme TryHackMe ou Hack The Box.

L'intelligence artificielle est devenue un bouclier indispensable dans la lutte contre les cybermenaces. Elle permet une détection plus rapide, une réponse automatisée et une analyse comportementale que les humains ne pourraient pas réaliser seuls. Cependant, l'IA n'est pas une solution miracle : elle a ses limites (faux positifs, attaques adversariales) et doit être combinée avec l'expertise humaine.