L'utilisation excessive de l'IA altère-t-elle nos capacités cognitives ?

Un autre angle sur l'impact de l'IA sur notre cerveau.

Pensée en tout ou rien, surgénéralisation, filtrage mental… L'intelligence artificielle peut-elle devenir un outil pour détecter et corriger nos biais cognitifs ? Analyse des promesses et des limites.

Les distorsions cognitives sont ces filtres invisibles à travers lesquels nous interprétons le monde, souvent de manière erronée et défavorable. Elles façonnent notre pensée de manière automatique, créant des schémas déformés qui influencent notre perception de nous-mêmes, des autres et de notre environnement.

Une distorsion cognitive est un biais systématique dans le traitement de l'information qui conduit à des interprétations irréalistes ou négatives de la réalité. Elles sont au cœur de nombreuses thérapies cognitivo-comportementales (TCC).

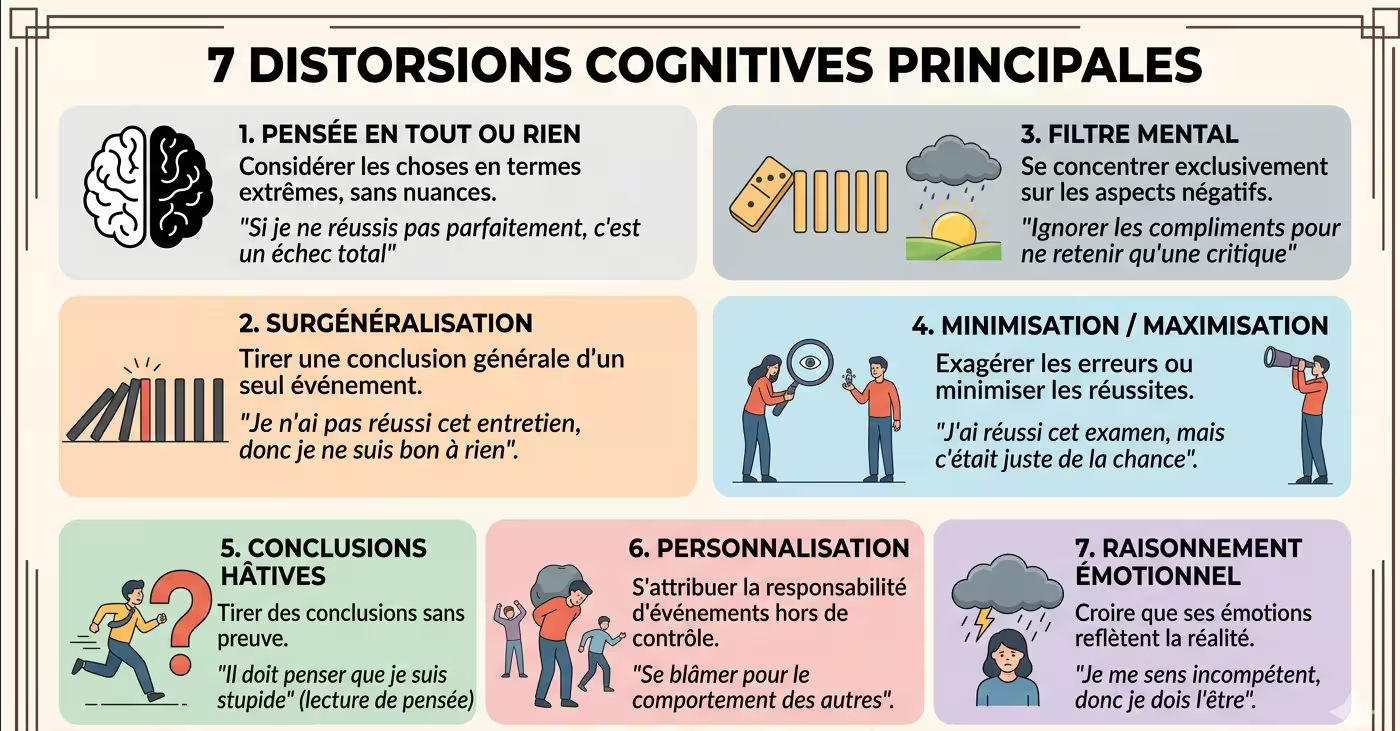

Voici les principales distorsions cognitives identifiées par la psychologie cognitive :

| Distorsion | Définition | Exemple |

|---|---|---|

| Pensée en tout ou rien | Considérer les choses en termes extrêmes, sans nuances | "Si je ne réussis pas parfaitement, c'est un échec total" |

| Surgénéralisation | Tirer une conclusion générale d'un seul événement | "Je n'ai pas réussi cet entretien, donc je ne suis bon à rien" |

| Filtre mental | Se concentrer exclusivement sur les aspects négatifs | Ignorer les compliments pour ne retenir qu'une critique |

| Minimisation / Maximisation | Exagérer les erreurs ou minimiser les réussites | "J'ai réussi cet examen, mais c'était juste de la chance" |

| Conclusions hâtives | Tirer des conclusions sans preuve | "Il doit penser que je suis stupide" (lecture de pensée) |

| Personnalisation | S'attribuer la responsabilité d'événements hors de contrôle | Se blâmer pour le comportement des autres |

| Raisonnement émotionnel | Croire que ses émotions reflètent la réalité | "Je me sens incompétent, donc je dois l'être" |

Infographie des 7 distorsions cognitives principales

Le schéma de pensée idéal serait celui qui reflète une vision juste et équilibrée de la réalité. Ce modèle repose sur quelques principes fondamentaux :

Prendre du recul pour analyser une situation de manière factuelle, sans la teinter de biais émotionnels.

Comprendre que la plupart des situations ne sont ni totalement noires ni totalement blanches. La réalité est complexe.

Avoir une perception réaliste de ses compétences et de ses limites, sans sombrer dans l'auto-critique excessive.

Ne pas laisser ses émotions dominer la raison, mais reconnaître et accepter ses ressentis tout en analysant les faits.

Si cet équilibre mental semble difficile à atteindre, l'intelligence artificielle pourrait-elle jouer un rôle clé pour aider à corriger ces distorsions et guider les individus vers un schéma de pensée plus optimal ?

Les outils d'intelligence artificielle sont déjà utilisés dans le domaine de la santé mentale. Mais pourrait-on aller plus loin en développant une IA capable d'intervenir spécifiquement sur les distorsions cognitives ?

Imaginons une application qui, grâce aux capteurs et aux algorithmes d'apprentissage automatique, enregistre et analyse vos paroles, vos gestes et vos habitudes quotidiennes. Elle pourrait collecter des données sur vos interactions, détecter vos moments de stress ou d'anxiété, et analyser votre langage pour repérer des distorsions cognitives.

Par exemple, si vous prononcez des phrases du type "je ne suis bon à rien", l'IA pourrait interpréter cela comme une surgénéralisation. Elle pourrait ensuite vous proposer des corrections en temps réel : "Avez-vous envisagé que ce seul échec ne définit pas votre valeur globale ?".

Une autre fonctionnalité clé pourrait être la capacité de l'IA à interpréter les événements de votre vie et à vous aider à prendre du recul. Si une situation vous rend particulièrement anxieux, l'IA pourrait vous guider à travers un processus de réflexion rationnelle : "Quelles preuves avez-vous que cette situation est catastrophique ? Quelles autres explications peuvent être envisagées ?".

La méthode des cinq pourquoi est une technique utilisée pour découvrir la cause profonde d'un problème. Une IA bien conçue pourrait utiliser cette méthode pour vous amener à réfléchir plus profondément sur vos pensées biaisées.

Utilisateur : "Je vais échouer à cette tâche."

IA : "Pourquoi pensez-vous que vous allez échouer ?"

Utilisateur : "Parce que j'ai déjà échoué une fois."

IA : "Pourquoi cet échec passé signifie-t-il que vous allez échouer à nouveau ?"

Utilisateur : "Parce que je ne suis pas assez compétent."

IA : "Quelles preuves avez-vous que vous n'êtes pas compétent ?"

Illustration d'un échange avec un chatbot thérapeutique

Des exemples actuels montrent que cette vision n'est pas qu'un rêve lointain.

Wysa est un chatbot d'IA conçu pour la gestion des émotions. Il utilise des techniques de thérapie cognitive pour aider les utilisateurs à surmonter leurs pensées négatives. Il guide les utilisateurs dans la restructuration de leurs pensées, leur suggérant des exercices en fonction de leurs réponses émotionnelles.

Replika agit comme un compagnon numérique, écoutant les utilisateurs et offrant des perspectives et des conseils pour améliorer leur santé mentale. Bien qu'encore limité en termes de profondeur de compréhension émotionnelle, Replika montre que l'IA peut jouer un rôle significatif dans le soutien émotionnel.

Malgré ses promesses, l'IA thérapeutique présente des limites importantes qu'il ne faut pas négliger.

Une IA peut simuler l'empathie, mais elle ne la ressent pas. La relation thérapeutique humaine repose sur une connexion émotionnelle authentique qu'une machine ne peut reproduire.

L'accessibilité permanente d'un chatbot peut créer une dépendance à l'outil, au détriment du développement de l'autonomie émotionnelle.

Les conversations intimes partagées avec une IA soulèvent des questions majeures de confidentialité et de sécurité des données. Qui a accès à ces échanges ? Comment sont-ils stockés ?

L'IA peut manquer des subtilités culturelles, sociales ou personnelles essentielles à la compréhension d'une situation.

Une IA mal conçue pourrait renforcer certaines distorsions plutôt que les corriger, en proposant des réponses inadaptées.

Utilisez ces outils comme un complément à un suivi thérapeutique professionnel, pas comme un substitut. En cas de détresse psychologique importante, consultez un médecin ou un psychologue.

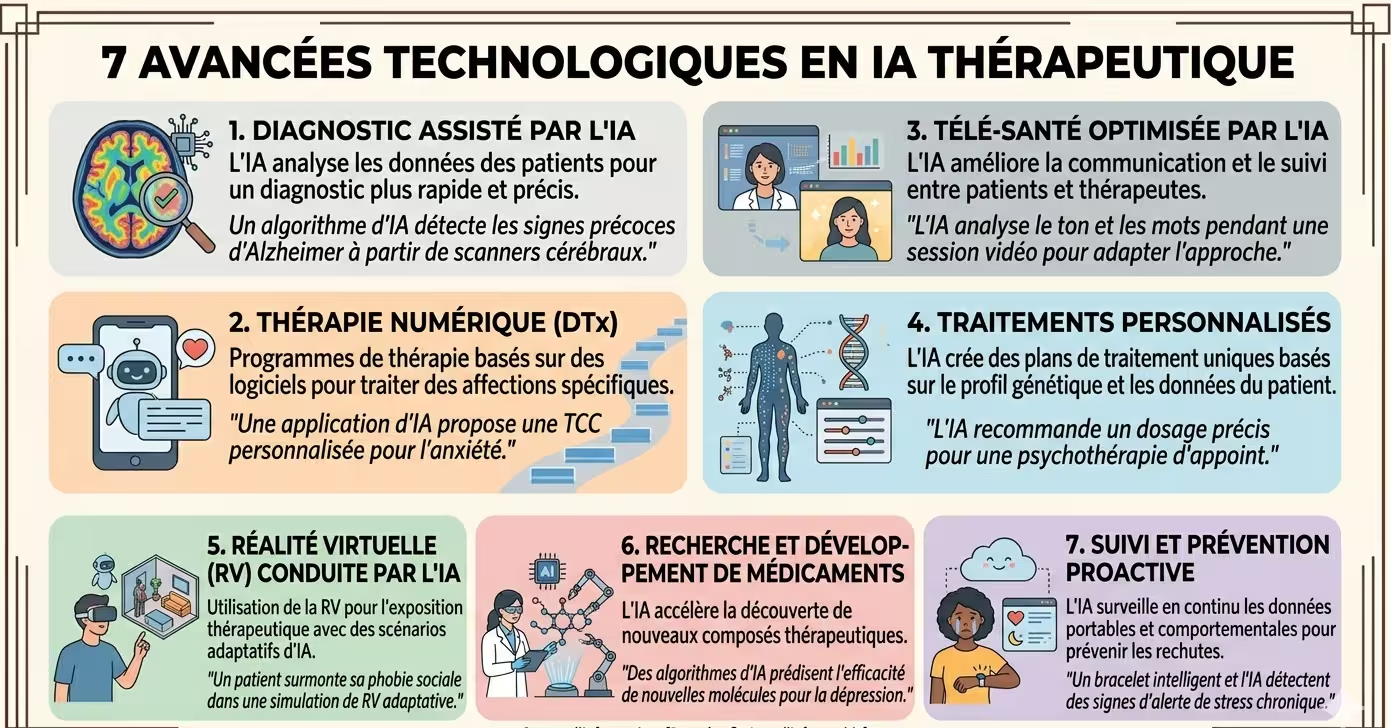

Peut-on aller jusqu'à dire que l'IA pourrait un jour remplacer les thérapeutes et les coachs en développement personnel ?

L'IA deviendra un assistant thérapeutique de plus en plus sophistiqué, mais elle restera un outil d'aide à la décision pour les professionnels, pas un remplacement. La relation humaine reste irremplaçable.

Illustration des avancées technologiques en IA thérapeutique

Non, ces applications sont des outils privés. En France, certaines applications de santé mentale peuvent être prescrites par un médecin dans le cadre du parcours de soins, mais c'est encore rare. Les chatbots d'IA ne sont pas remboursés.

Non. L'IA peut aider à détecter des signaux d'alerte (ex: répétition de schémas de pensée négatifs), mais le diagnostic doit être posé par un professionnel de santé qualifié. Une IA ne remplace pas une évaluation clinique.

Les applications sérieuses respectent le RGPD en Europe. Cependant, il est recommandé de lire attentivement les conditions d'utilisation et les politiques de confidentialité. Évitez de partager des informations personnellement identifiables si vous avez des doutes.

Les distorsions cognitives sont spécifiques aux pensées automatiques négatives (surgénéralisation, pensée dichotomique). Les biais cognitifs sont des erreurs systématiques de raisonnement qui affectent tout le monde (biais de confirmation, effet de halo). Les deux se recoupent partiellement.

Oui, des initiatives françaises émergent comme Klinik (orientation vers les soins), Moka.care (suivi psychologique), ou Teale (gestion du stress). Cependant, les chatbots conversationnels restent principalement anglophones.

Des applications comme Wysa for Schools sont adaptées aux adolescents. Pour les jeunes enfants, l'interaction avec une IA doit être supervisée par un adulte. Des études sont en cours sur l'efficacité des chatbots pour cette population.

L'intelligence artificielle offre une opportunité prometteuse pour améliorer la santé mentale en aidant les individus à corriger leurs distorsions cognitives. Si une IA ne peut pas encore remplacer entièrement les thérapeutes humains, elle peut devenir un puissant outil pour :