Impact du Big Data sur la prise de décision stratégique

Une analyse des usages concrets des données dans les entreprises.

Les données sont devenues omniprésentes. Elles s’accumulent, se diversifient, circulent à une vitesse parfois difficile à suivre. Mais derrière cette masse apparente, une structure se dessine. Une tentative d’ordre, presque une grille de lecture : les 5V du Big Data.

Le Big Data désigne un ensemble de données massives, complexes, et souvent difficiles à traiter avec les outils traditionnels. Mais cette définition reste, en un sens, insuffisante. Elle décrit une quantité, mais pas forcément une réalité.

Le Big Data n’est pas seulement une question de taille. Ce n’est pas simplement « beaucoup de données ». C’est une transformation profonde dans la manière dont les données sont produites, collectées, analysées et utilisées.

On pourrait dire que le Big Data est moins une technologie qu’un changement de paradigme. Une évolution dans la façon de penser l’information. Les données ne sont plus statiques. Elles deviennent dynamiques, continues, presque vivantes.

Pour comprendre cette complexité, cinq dimensions sont généralement utilisées : les 5V. Elles permettent de structurer ce qui pourrait autrement sembler chaotique.

Ces cinq dimensions — volume, variété, vélocité, véracité et valeur — ne sont pas indépendantes. Elles s’entrelacent, se complètent, parfois se contredisent.

Le volume est souvent la première chose que l’on associe au Big Data. Et pour cause : les quantités de données produites chaque jour sont vertigineuses.

Des capteurs IoT, des réseaux sociaux, des transactions numériques… tout génère des données. En continu. Sans interruption.

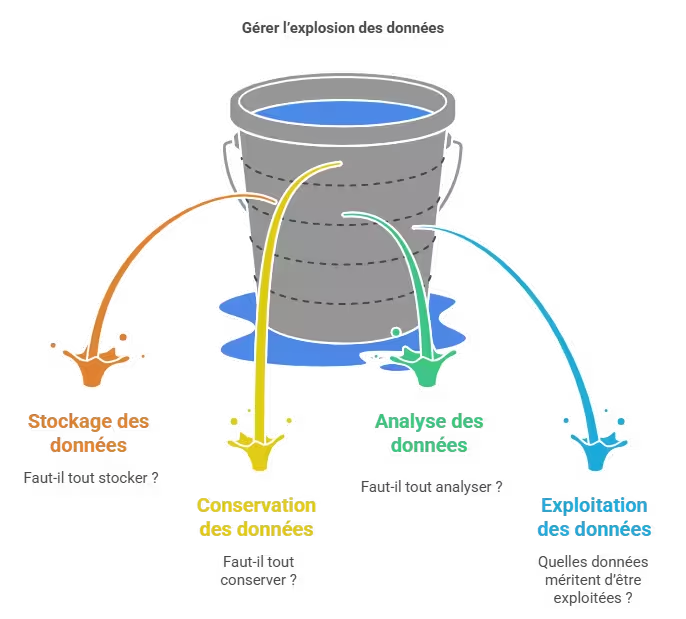

Mais ce volume pose une question implicite : faut-il tout stocker ? Tout conserver ? Tout analyser ? La réponse n’est pas toujours évidente.

Le volume impose donc des infrastructures adaptées : data lakes, systèmes distribués, stockage cloud.

Les données ne se ressemblent pas. Elles ne parlent pas toutes le même langage. Certaines sont structurées, comme des tables SQL. D’autres sont semi-structurées, comme des fichiers JSON. Et beaucoup sont totalement non structurées : texte, images, vidéos.

Cette diversité complique l’analyse. Il ne suffit pas de traiter des données. Il faut les harmoniser, les comprendre, les transformer.

La variété oblige à développer des pipelines complexes, capables d’intégrer des sources multiples.

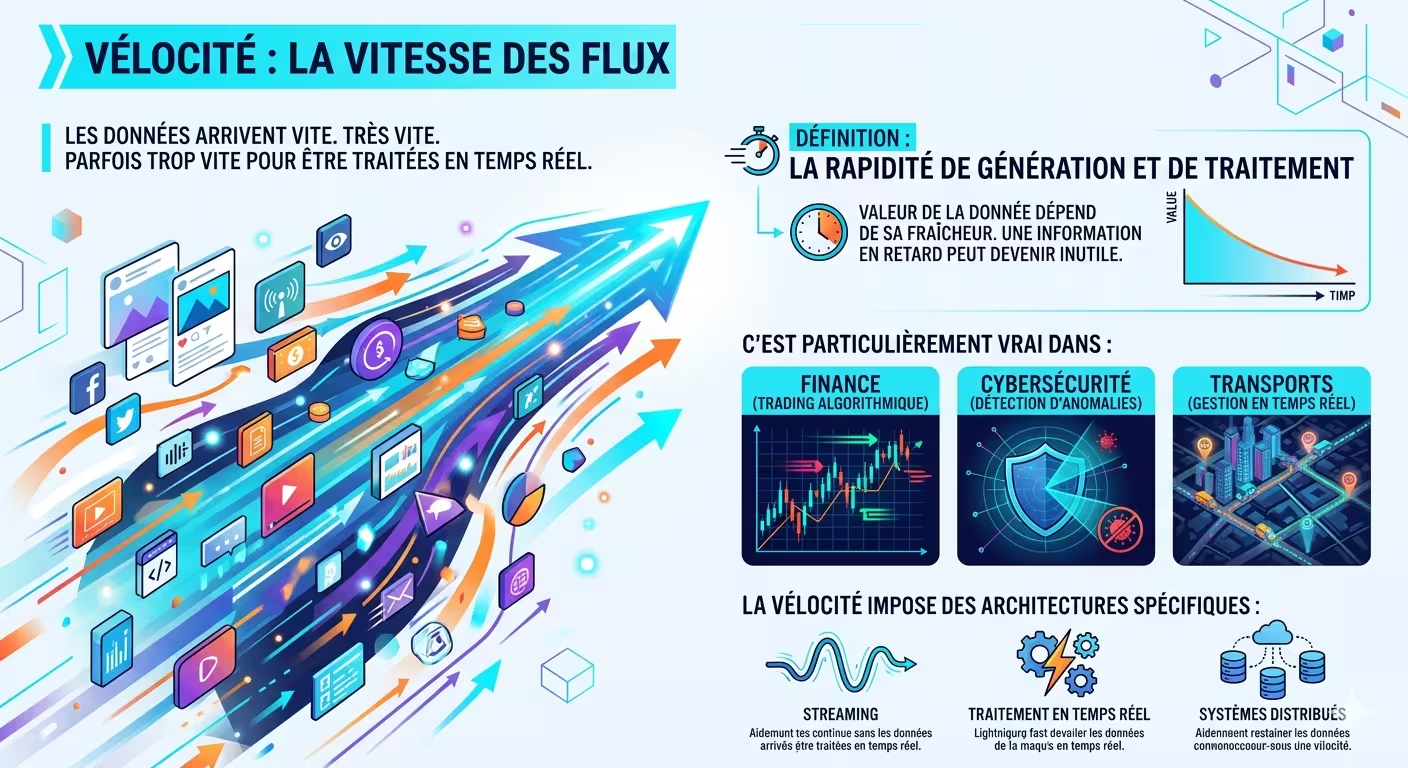

Les données arrivent vite. Très vite. Parfois trop vite pour être traitées en temps réel.

La vélocité désigne cette rapidité de génération et de traitement. Dans certains cas, la valeur d’une donnée dépend de sa fraîcheur. Une information en retard peut devenir inutile.

C’est particulièrement vrai dans :

La vélocité impose des architectures spécifiques : streaming, traitement en temps réel, systèmes distribués.

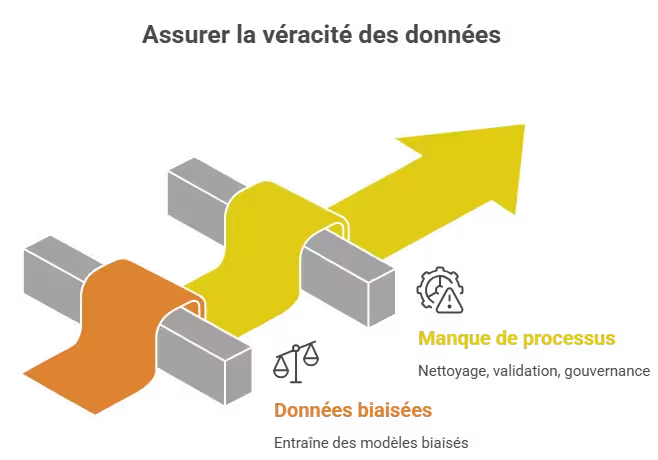

Toutes les données ne se valent pas. Certaines sont incomplètes, biaisées, erronées. La véracité concerne la fiabilité des données.

Une mauvaise donnée peut conduire à une mauvaise décision. Et à grande échelle, les conséquences peuvent être importantes.

La véracité nécessite des processus de nettoyage, de validation, de gouvernance des données.

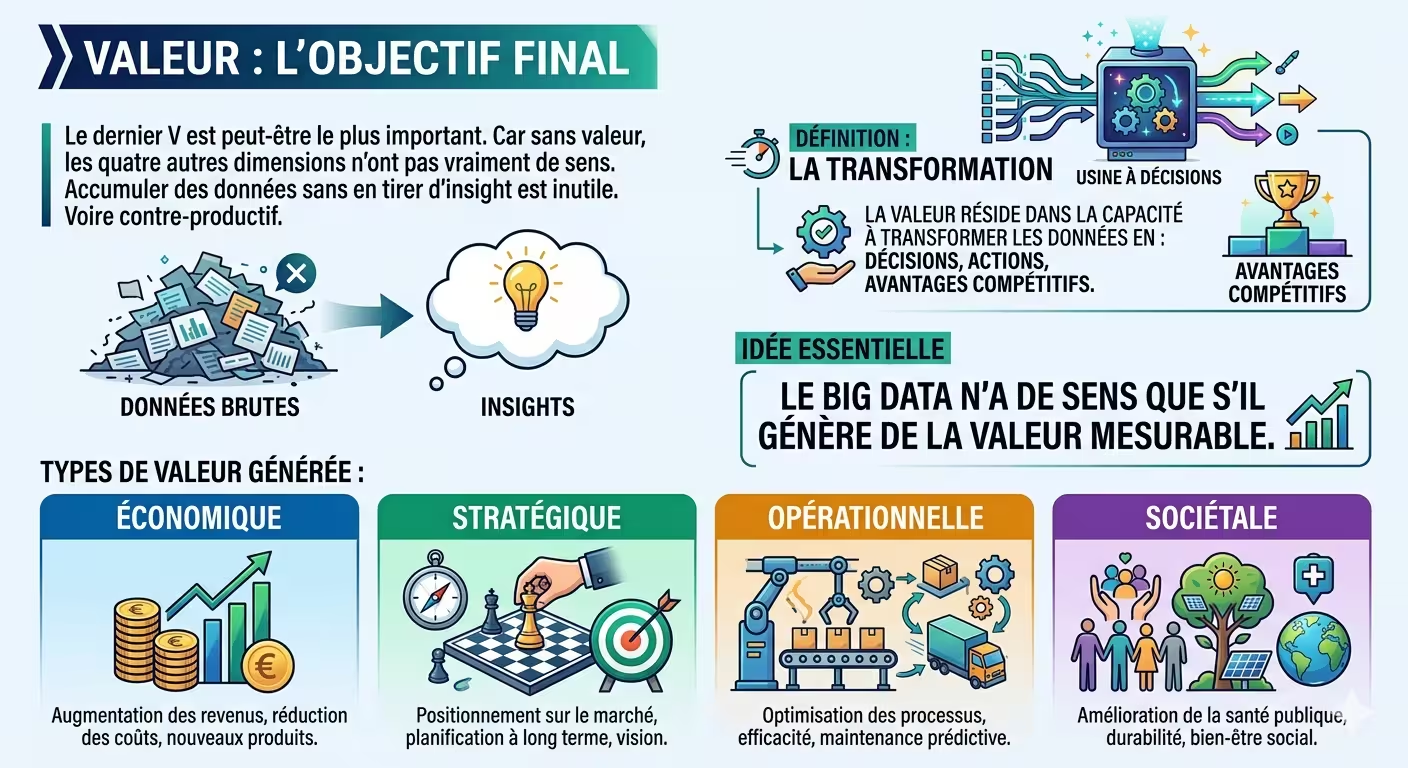

Le dernier V est peut-être le plus important. Car sans valeur, les quatre autres dimensions n’ont pas vraiment de sens.

Accumuler des données sans en tirer d’insight est inutile. Voire contre-productif.

La valeur réside dans la capacité à transformer les données en décisions, en actions, en avantages compétitifs.

Cette valeur peut être économique, stratégique, opérationnelle ou même sociétale.

Le Big Data est utilisé dans de nombreux domaines :

Optimisation des processus, marketing prédictif, analyse client.

Analyse de données médicales, médecine personnalisée.

Maintenance prédictive, optimisation des chaînes de production.

Gestion du trafic, énergie, services publics.

Dans chacun de ces cas, les 5V permettent de structurer les défis et les solutions.

Le Big Data n’est pas sans limites.

Stockage, calcul, infrastructure.

Gestion des pipelines, des architectures distribuées.

Protection des données, vie privée, biais.

Trop de données peut nuire à la prise de décision.

Le Big Data est donc à la fois une opportunité et une contrainte. Une richesse… mais aussi une responsabilité.

Les 5V permettent de structurer les caractéristiques principales des données massives. Ils offrent une grille de lecture simple pour comprendre des phénomènes complexes.

Non. Même des PME exploitent aujourd’hui des données massives grâce au cloud et aux outils accessibles.

Le Big Data concerne les données elles-mêmes et leur gestion. La Data Science se concentre sur leur analyse et leur exploitation.

Ils constituent une base, mais certains ajoutent d’autres dimensions selon les contextes.