Chaque minute, 500 heures de vidéo sont mises en ligne sur YouTube. Chaque jour, plus de 300 milliards d’e-mails sont envoyés dans le monde. Chaque année, le volume mondial de données créées dépasse les 175 zettaoctets — soit 175 milliards de téraoctets. Pour donner un ordre de grandeur : 175 Zo représentent l’équivalent de 175 milliards de disques durs de 1 téraoctet. Empilés, ces disques formeraient une tour haute de 2,6 millions de kilomètres — environ 6 fois la distance entre la Terre et la Lune. Derrière ces chiffres vertigineux se cache un défi technique, économique et environnemental immense : comment stocker, traiter, analyser et valoriser ces données massives ? C’est là qu’intervient le Big Data. Ce guide complet explore la définition, l’histoire, les architectures (data lake, data warehouse, data lakehouse, data mesh), les outils (BigQuery, Spark, Kafka), les usages en entreprise, et les enjeux éthiques et environnementaux du Big Data en 2026. Que vous soyez étudiant, data scientist, data engineer ou dirigeant d’entreprise, vous trouverez ici les clés pour comprendre et maîtriser l’univers du Big Data.

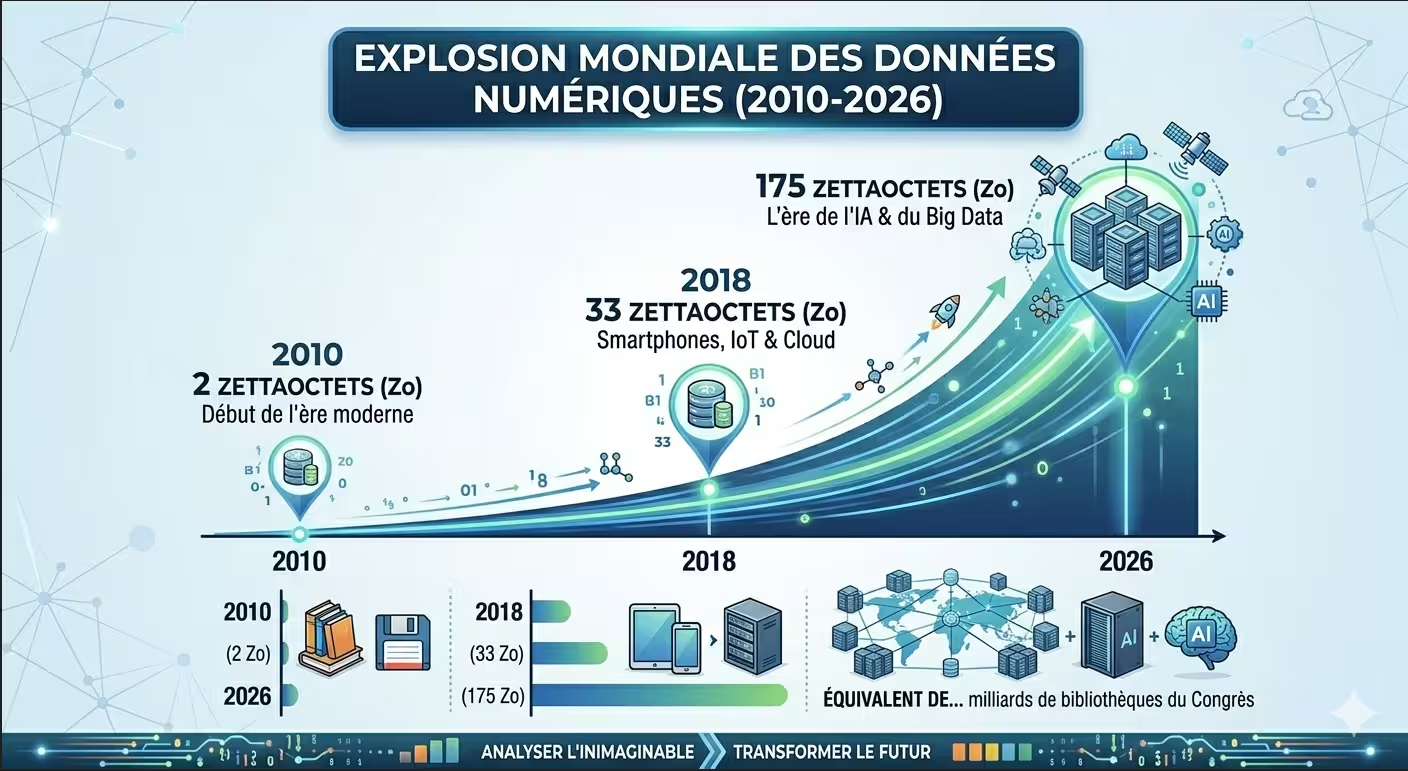

Infographie n°1 – Croissance exponentielle des données mondiales 2010-2026 et projections à 2030. Le volume mondial de données double tous les deux ans.

Le Big Data désigne des ensembles de données si volumineux, complexes, et générés à grande vitesse qu’ils dépassent les capacités des outils traditionnels de gestion et d’analyse de données (bases de données relationnelles, feuilles de calcul, outils de BI classiques). Il ne s’agit pas seulement de « grosses données » — c’est un paradigme complet qui englobe la collecte, le stockage, le traitement, l’analyse et la valorisation de données massives. Le Big Data est souvent associé à la notion de « data-driven decision making » : prendre des décisions basées sur les données plutôt que sur l’intuition ou l’expérience personnelle.

Le terme « Big Data » a été popularisé au début des années 2000 par Doug Laney, analyste chez Gartner, qui a formalisé les « 3V » (Volume, Vélocité, Variété). Depuis, deux autres V (Véracité, Valeur) ont été ajoutés pour affiner le concept. Aujourd’hui, certains parlent même de 7V en ajoutant la Visualisation et la Volatilité (durée de vie des données). Pour aller plus loin sur la définition et l’histoire, consultez notre article dédié : Le Big Data : quand les données révèlent l’avenir et Big Data : quand la quantité d’informations devient une force.

En 2026, le volume mondial de données atteint 175 zettaoctets (Zo), contre 33 Zo en 2018 et seulement 2 Zo en 2010. Une progression fulgurante portée par l’IoT, les réseaux sociaux, la vidéo HD/4K, et l’activité économique numérique. 90 % des données mondiales ont été créées depuis 2020. Selon IDC, le volume mondial de données devrait atteindre 300 Zo en 2030.

Pourquoi le Big Data est-il si important ? Parce que la donnée est devenue une ressource stratégique, comparable au pétrole dans l’économie industrielle. Les entreprises qui savent exploiter leurs données — pour mieux connaître leurs clients, optimiser leurs processus, innover — acquièrent un avantage concurrentiel décisif. À l’inverse, celles qui ignorent le Big Data se laissent distancer. Le data scientist est d’ailleurs devenu l’un des métiers les plus recherchés de la décennie.

Le Big Data se caractérise par cinq dimensions fondamentales, les « 5V ». Pour une exploration détaillée avec exemples et bonnes pratiques, consultez notre article complet sur les 5V du Big Data.

C’est la dimension la plus évidente. Les organisations collectent des données à des échelles jamais vues : téraoctets (10¹²), pétaoctets (10¹⁵), exaoctets (10¹⁸) ou zettaoctets (10²¹). Exemple : Facebook traite chaque jour plus de 500 To de données (photos, likes, commentaires, partages). CERN (physique des particules) génère des pétaoctets de données par an. Les objets connectés (IoT) ajoutent des milliards de capteurs supplémentaires. Ce volume impose des infrastructures de stockage distribuées et des techniques de partitionnement (sharding), de compression, et de déduplication.

Les données ne sont pas seulement massives, elles arrivent à très grande vitesse. Une usine connectée capte des milliers de mesures par seconde. Une plateforme boursière traite des millions de transactions par minute. Les données de géolocalisation ou de trafic doivent être analysées en quasi-temps réel pour être utiles. D’où l’importance du streaming de données et des bases orientées séquences temporelles (time series).

Contrairement aux bases relationnelles traditionnelles (données structurées en lignes et colonnes), le Big Data comprend des données semi-structurées (JSON, XML, logs) et non structurées (texte libre, images, vidéos, audio, PDF). Ces formats coexistent et doivent être stockés, indexés et analysés. Les systèmes NoSQL (MongoDB, Cassandra, Elasticsearch) ont été conçus pour cette variété.

« Garbage In, Garbage Out ». Des données massives mais de mauvaise qualité produisent des analyses erronées. Les problématiques : données manquantes, valeurs aberrantes, incohérences, duplications, biais de collecte. L’étape de nettoyage (data cleansing) est souvent la plus chronophage (60-80 % du temps projet). La gouvernance des données et la mise en place de pipelines qualité sont essentielles.

C’est la V la plus importante. Avoir des données ne sert à rien si on n’en extrait pas de la valeur. Cela suppose de combiner le Big Data avec des techniques d’analyse (data mining, machine learning, visualisation) et une compréhension métier fine. La valeur peut être directe (augmentation des ventes, baisse des coûts) ou indirecte (amélioration de l’expérience client, détection précoce de risques).

Le Big Data n’est pas né avec Internet. Ses racines remontent aux années 1960 avec les premiers systèmes de bases de données relationnelles et les « data warehouses ». Mais l’expression « Big Data » a émergé dans les années 1990-2000 avec l’explosion du Web (logs serveurs, clics) et la difficulté croissante à traiter ces volumes. L’article Histoire et évolution du Big Data : des bases de données aux data lakes retrace cette épopée technologique.

Apparition des premiers SGBD (Systèmes de Gestion de Bases de Données) relationnels (IBM System R, Oracle). Les data warehouses (entrepôts de données) émergent dans les années 1980-1990 pour centraliser les données décisionnelles. Les volumes restent modestes (gigaoctets).

Avec la popularisation d’Internet, les logs de serveurs web, les clics utilisateurs, l’email génèrent des volumes que les bases traditionnelles peinent à traiter. Les premières bases NoSQL apparaissent. Google publie les articles fondateurs sur GFS (Google File System, 2003), MapReduce (2004) et BigTable (2006), qui inspireront Hadoop.

Lancement de Hadoop (Doug Cutting, Yahoo!) en 2006, qui rend accessible le traitement distribué open source. Émergence de l’écosystème Hadoop (HDFS, MapReduce, Hive, Pig, HBase). Parallèlement, explosion des bases NoSQL : MongoDB (documents), Cassandra (wide column), Redis (clé-valeur), Elasticsearch (recherche). Les volumes passent au pétaoctet.

AWS S3 (stockage objet), Azure Data Lake, Google BigQuery (serverless data warehouse) démocratisent le Big Data sans investissement matériel. Apache Spark (traitement en mémoire) supplante MapReduce pour la rapidité. Le streaming (Kafka, Flink) se généralise.

Le data lakehouse (Delta Lake, Iceberg, Hudi) fusionne les avantages du data lake (flexibilité, coût) et du data warehouse (performances SQL). Le data mesh (décentralisation) répond aux limites des architectures centralisées dans les grandes organisations. L’IA générative (LLM) pousse à de nouvelles architectures Big Data.

Le stockage est le premier défi technique du Big Data. Les infrastructures doivent être capables d’accueillir des volumes colossaux tout en permettant un accès rapide et fiable, avec des garanties de redondance (tolérance aux pannes). Pour approfondir, consultez notre article complet sur le stockage de la Big Data.

Une bonne pratique consiste à classifier les données par « température » pour optimiser les coûts :

Les data centers (centres de données) abritent ces infrastructures. En 2026, on compte environ 8 000 data centers dans le monde, consommant près de 2 % de l’électricité mondiale (autant que l’industrie aéronautique). Les géants du cloud (AWS, Azure, Google Cloud) proposent du stockage distribué, redondé à l’échelle planétaire, avec des contrats de durabilité (99,999999999 %).

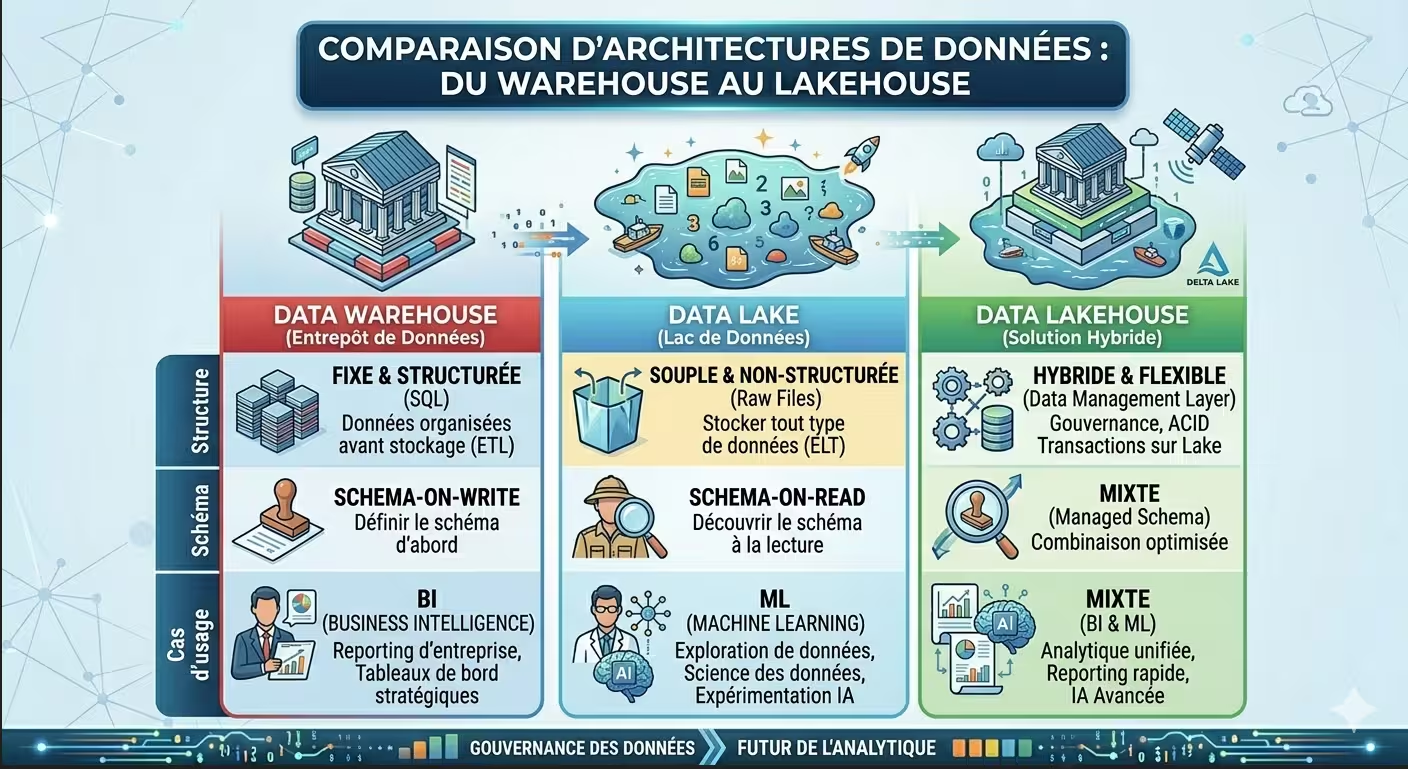

Le choix de l’architecture est crucial pour la performance, le coût, et la gouvernance des données. Pour une aide à la décision, consultez notre guide pour choisir la meilleure architecture Big Data.

Architecture traditionnelle (depuis les années 1980-1990). Structure rigide : schéma défini à l’avance (schema-on-write). Les données sont nettoyées, transformées et chargées (ETL) avant d’être stockées. Idéal pour le reporting et la Business Intelligence (BI) : tableaux de bord, KPI, analyses standardisées. Exemples : Snowflake, Google BigQuery, Amazon Redshift, Microsoft Azure Synapse, Teradata. Points forts : performances SQL rapides, gouvernance centralisée. Points faibles : rigidité, coût, pas adapté aux données non structurées.

Architecture apparue avec Hadoop (2010). Structure flexible : données brutes stockées dans leur format natif (JSON, CSV, Parquet, Avro, vidéo, images). Le schéma est appliqué à la lecture (schema-on-read). Idéal pour l’exploration de données, le machine learning, et les données non structurées. Exemples : AWS S3 + Hive/Iceberg, Azure Data Lake, Google Cloud Storage. Points forts : flexibilité, coût faible (stockage objet), adapté à la data science. Points faibles : risque de data swamp (marécage de données sans gouvernance), performances SQL moins bonnes (sans couche d’indexation).

Sans gouvernance (catalogue des données, qualité, documentation), un data lake peut rapidement dégénérer en « data swamp » : données non documentées, dupliquées, de qualité inconnue, impossible à exploiter. Des outils comme AWS Glue, Apache Atlas, Collibra, ou avec des formats comme Delta Lake, aident à maintenir un data lake propre.

Architecture émergente (popularisée par Databricks à partir de 2020) qui combine la flexibilité du data lake (stockage de données brutes, faible coût) avec les performances d’un data warehouse (requêtes SQL rapides, transactions ACID). Le secret : des formats de table ouverts comme Delta Lake, Apache Iceberg, ou Apache Hudi, qui apportent une couche de gestion de métadonnées et d’index au-dessus du data lake. Idéal pour les organisations qui ont besoin à la fois de data science et de BI. Exemple : Databricks Lakehouse Platform, Google BigLake, AWS Lake Formation + Athena.

Infographie n°2 – Comparaison des architectures Big Data : avantages, inconvénients et cas d’usage typiques.

Le traitement batch (par lots) ne suffit plus face aux besoins de réactivité de l’économie numérique. Le streaming de données permet d’analyser des flux en temps réel, avec des latences de l’ordre de la milliseconde à la seconde. Pour approfondir, consultez notre article sur le streaming de données en temps réel.

Applications typiques du streaming :

Outils leaders :

Le Data Mesh est un paradigme architectural qui répond aux limites des data lakes centralisés dans les grandes organisations (plusieurs centaines de data engineers, milliers de sources). Popularisé par Zhamak Dehghani (ThoughtWorks) en 2019, le Data Mesh est devenu une tendance forte en 2026. Pour une présentation complète, lisez notre article sur Data Mesh.

Quatre principes fondent le Data Mesh :

Adopté par des entreprises comme Netflix, Zalando, Intuit, ou La Poste, le Data Mesh n’est pas une solution miracle : sa mise en œuvre demande une maturité organisationnelle et technique importante. Il n’est adapté qu’aux organisations de grande taille (> 500 data engineers, > 1000 sources).

L’écosystème Big Data est riche et en constante évolution. Voici les outils incontournables en 2026, classés par catégorie.

Apache Spark : moteur unifié (batch, streaming, SQL, machine learning, graph) devenu le standard. Écrit en Scala, mais utilisable en Python (PySpark), R et SQL. Traitement en mémoire, bien plus rapide que l’ancien MapReduce. Hadoop : framework historique (HDFS + MapReduce). Encore présent dans les legacy systems, mais les nouveaux projets préfèrent Spark avec stockage objet cloud.

Apache Kafka : plateforme de streaming distribuée, colonne vertébrale des architectures microservices et Big Data temps réel. Gère des millions de messages par seconde. Apache Flink : traitement de flux avec état, faible latence, exactement une fois. Idéal pour des pipelines temps réel complexes.

Google BigQuery : data warehouse serverless de Google Cloud. Paie à l’usage (par To traité), excellente scalabilité. Pour une plongée dédiée, consultez notre article : BigQuery et autres plateformes de traitement massif de données. Snowflake : data warehouse cloud multi-cloud (AWS, Azure, GCP). Connu pour sa séparation compute/storage et son partage de données. Amazon Redshift : data warehouse cloud de AWS, historique mais toujours utilisé. Azure Synapse : solution intégrée Microsoft.

Cassandra (wide column, décentralisé), MongoDB (documents, le plus populaire), Elasticsearch (recherche et logs), Redis (clé-valeur, cache), Neo4j (graphes).

Delta Lake (Databricks), Apache Iceberg (Netflix, Apple, Airbnb), Apache Hudi (Uber). Apportent les ACID et les performances de requêtes aux data lakes.

| Outil | Type | Usage principal | Éditeur |

|---|---|---|---|

| Spark | Moteur distribué | Batch, streaming, SQL, ML, graph | Apache / Databricks |

Le cloud computing a démocratisé le Big Data en rendant accessibles des ressources de calcul et de stockage massives sans investissement initial lourd. En 2026, les trois principaux fournisseurs de cloud (AWS, Azure, Google Cloud) dominent le marché, suivis par des acteurs chinois (Alibaba Cloud) et européens (OVH, Scaleway, Outscale). Pour approfondir, lisez notre article sur le cloud computing.

AWS : S3 (stockage), EMR (Spark/Hadoop), Kinesis (streaming), Redshift (data warehouse), Athena (SQL serverless sur S3), Glue (ETL). Azure : Data Lake Storage, Databricks (partenariat), Synapse Analytics, Event Hubs (Kafka-like). Google Cloud : BigQuery, Dataflow (Flink/Beam), Pub/Sub, Dataproc (Spark/Hadoop).

Le Big Data n’est pas une fin en soi. Il doit répondre à des cas d’usage métier concrets et générer un retour sur investissement mesurable.

Les projets Big Data sont coûteux (data engineers, infrastructure, data scientists). Les études de marché (Forrester, Gartner) montrent que 60-70 % des projets atteignent leurs objectifs de ROI. Les facteurs de succès : alignement métier (pas de projet technique sans cas d’usage), données de qualité, compétences, et gouvernance. Les principaux freins : coût élevé, manque de compétences, complexité d’intégration dans les systèmes existants, difficulté à créer une véritable culture data-driven.

Cas 1 – E-commerce (Amazon) : recommandations produit → Le Big Data capture en temps réel l’historique d’achat, les clics, les recherches, les avis. Les modèles de recommandation (filtrage collaboratif) traitent ces pétaoctets pour prédire les produits susceptibles d’intéresser chaque client (> 35 % du CA d’Amazon).

Cas 2 – Santé (AP-HP) : prédiction des réadmissions → Les dossiers médicaux électroniques contiennent des millions d’observations. L’architecture Big Data (data lake + Spark ML) permet de construire des modèles prédictifs pour anticiper les réadmissions à 30 jours, cibler les patients à risque et réduire les coûts.

Cas 3 – Transport SNCF : maintenance prédictive des trains → Les capteurs IoT sur les trains génèrent des téraoctets par jour. L’architecture Big Data (Kafka pour les streams + Spark pour le traitement) analyse ces données en temps réel et prédit les pannes jusqu’à 2 semaines avant qu’elles ne surviennent.

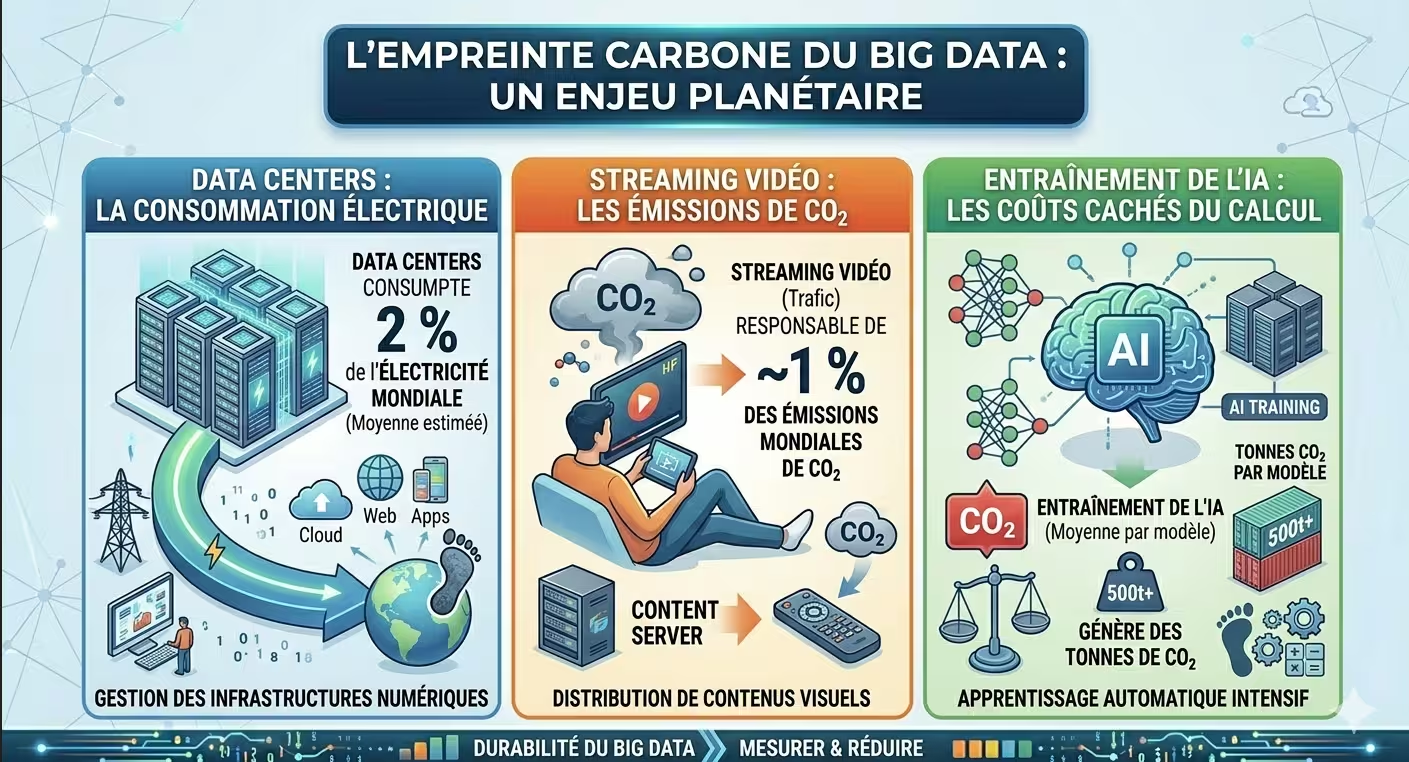

Le Big Data a un coût environnemental considérable, souvent sous-estimé. Selon le Shift Project (2025), la pollution numérique (data centers, réseaux, terminaux) représente 4-5 % des émissions mondiales de CO₂, soit plus que l’aviation civile (2-3 %). Et cette part croît de 6-8 % par an.

Les data centers (centres de données) consomment environ 2 % de l’électricité mondiale (IEA, 2025), soit autant que la consommation électrique du Japon ou de l’Allemagne. La moitié sert à alimenter les serveurs (donc le stockage et le calcul), l’autre moitié sert au refroidissement. Le PUE (Power Usage Effectiveness) mesure l’efficacité énergétique : un PUE de 1,5 signifie que pour 1 watt utilisé par les serveurs, 0,5 watt est utilisé pour le refroidissement. Les data centers modernes atteignent des PUE de 1,1-1,2, les anciens sont autour de 1,8-2,0. L’entraînement d’un seul grand modèle de langage (LLM) comme GPT-4o peut émettre plusieurs centaines de tonnes de CO₂, soit l’équivalent de 50 allers-retours Paris-New York en avion.

Infographie n°3 – Data centers, streaming, entraînement IA : l’empreinte carbone du Big Data et les leviers d’action pour réduire l’impact.

Le Big Data soulève des questions éthiques majeures, que les entreprises et les régulateurs peinent encore à traiter.

La collecte massive de données personnelles (localisation, navigation, achats, santé) permet de profiler les individus avec une précision inédite. Les plateformes publicitaires (Google, Meta) et les data brokers (courtiers en données) revendent ces profils, parfois sans consentement explicite. Le risque d’utilisation politique (surveillance électorale) ou discriminatoire (assurance santé, recrutement) est réel. Le RGPD en Europe (2018) a établi des garde-fous : consentement explicite, droit à l’oubli, à la portabilité, notification de fuites. Mais son application est inégale et contournée.

Un algorithme de scoring de crédit entraîné sur des données historiques peut apprendre des biais raciaux ou sexuels (redlining). Un outil de recrutement IA peut pénaliser les femmes si les CV d’entraînement sont majoritairement masculins. Le Big Data amplifie ces biais. La solution : audit régulier des modèles, datasets diversifiés, explicabilité (XAI). Voir notre article détaillé sur les biais algorithmiques.

Les données des citoyens européens sont souvent stockées sur les serveurs des GAFAM (Google, Apple, Meta, Amazon, Microsoft) situés aux États-Unis, ce qui les expose au Cloud Act américain (accès possible par les autorités US). En réaction, l’Europe développe des « clouds de confiance » souverains (Bleu : Microsoft + Orange, NumSpot, Outscale). Le projet Gaia-X vise à créer une infrastructure de données européenne décentralisée.

Plusieurs évolutions structurent le Big Data pour les années à venir :

Le Big Data concerne l’infrastructure (stockage, ingestion, traitement, architecture). La data science concerne l’analyse et la modélisation (statistiques, ML, visualisation). Ils sont complémentaires : la data science a besoin du Big Data pour traiter des volumes massifs (big data infrastructure), et le Big Data a besoin de la data science pour générer de la valeur (insights).

En France, un data engineer junior (0-2 ans) gagne 35-45 k€ ; un confirmé (3-5 ans) 50-70 k€ ; un senior (6+ ans) 70-100 k€. Les compétences en cloud (AWS, GCP, Azure) et en streaming (Kafka, Flink) sont très valorisées. Aux États-Unis, les salaires sont environ 2x plus élevés (100-200 k$). En Suisse, 120-180 kCHF.

Hadoop reste présent dans les legacy systems (entreprises qui ont investi massivement il y a 5-10 ans). Mais les nouveaux projets privilégient Spark (sur conteneurs ou cloud) et les services managés (BigQuery, Snowflake). Savoir Spark est bien plus utile que Hadoop. Le HDFS (Hadoop Distributed File System) est remplacé par le stockage objet cloud (S3, GCS, Azure Blob). À moins de devoir maintenir un cluster Hadoop existant, ne priorisez pas Hadoop.

Le RGPD impose : information préalable sur les données collectées, consentement explicite, droit d’accès, droit de rectification, droit à l’effacement (« droit à l’oubli »), droit à la portabilité, et notification des fuites de données en moins de 72 heures. Les violations peuvent entraîner des amendes pouvant atteindre 20 M€ ou 4 % du CA mondial.