Python, le roi incontesté de la data science et de l'IA

Pourquoi Python domine l'écosystème IA.

TensorFlow, PyTorch, Pandas, Scikit-learn, Jupyter, Docker... Découvrez les 12 outils que tout développeur IA doit maîtriser en 2026. Comparatifs et conseils de choix.

Le développement en intelligence artificielle repose sur un écosystème riche et diversifié d'outils et de technologies. Parmi eux, les bibliothèques et les frameworks jouent un rôle central en fournissant aux développeurs les outils de base pour construire des modèles d'IA performants.

La quasi-totalité des outils présentés sont en Python, le langage roi de l'IA et de la data science (66% des data scientists l'utilisent comme langage principal).

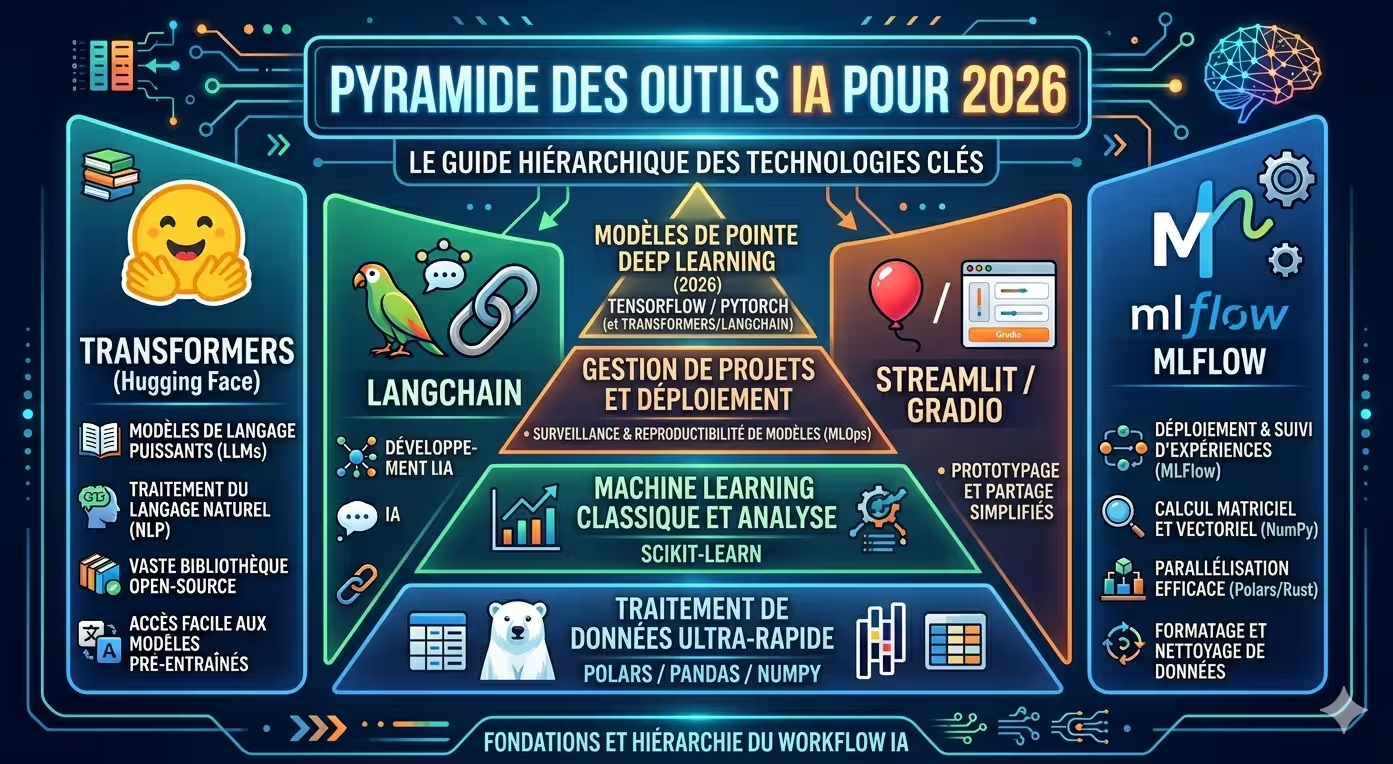

Pyramide des outils IA (NumPy/Pandas à la base → Scikit-learn → TensorFlow/PyTorch au sommet).

Probablement le framework le plus populaire, TensorFlow offre une flexibilité exceptionnelle pour la création de modèles de deep learning de toutes tailles. Il est soutenu par une vaste communauté et dispose d'une documentation abondante.

Points forts : Production, écosystème complet (TFX, TF Lite, TF.js), déploiement facile.

Connu pour sa simplicité d'utilisation et sa flexibilité, PyTorch est particulièrement apprécié pour la recherche et le développement rapide de prototypes. En 2026, PyTorch domine la recherche académique (80% des papiers).

Points forts : Debugging facile, style impératif, communauté recherche active.

Initialement conçue comme une interface de haut niveau pour TensorFlow, Keras est devenue un standard pour la création de modèles de deep learning de manière rapide et intuitive. Idéal pour les débutants et le prototypage rapide.

Points forts : API simple, intégrée à TensorFlow, excellente documentation.

Commencez par Keras (intégré à TensorFlow) pour comprendre les concepts du deep learning. Puis passez à PyTorch si vous faites de la recherche, ou à TensorFlow si vous visez la production industrielle.

Fondamentale pour le calcul numérique en Python, NumPy offre des structures de données performantes (tableaux multidimensionnels) pour manipuler des données de grandes dimensions. C'est la base de toutes les autres bibliothèques.

Spécialisée dans l'analyse de données, Pandas permet de manipuler et d'explorer des données tabulaires de manière efficace. Indispensable pour le nettoyage, la transformation et l'agrégation des données.

Cette bibliothèque propose une large gamme d'algorithmes de machine learning classiques, de la régression linéaire aux forêts aléatoires, en passant par le clustering et la réduction de dimension. Idéal pour les projets ML standards.

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y)

model = RandomForestClassifier()

model.fit(X_train, y_train)

predictions = model.predict(X_test)

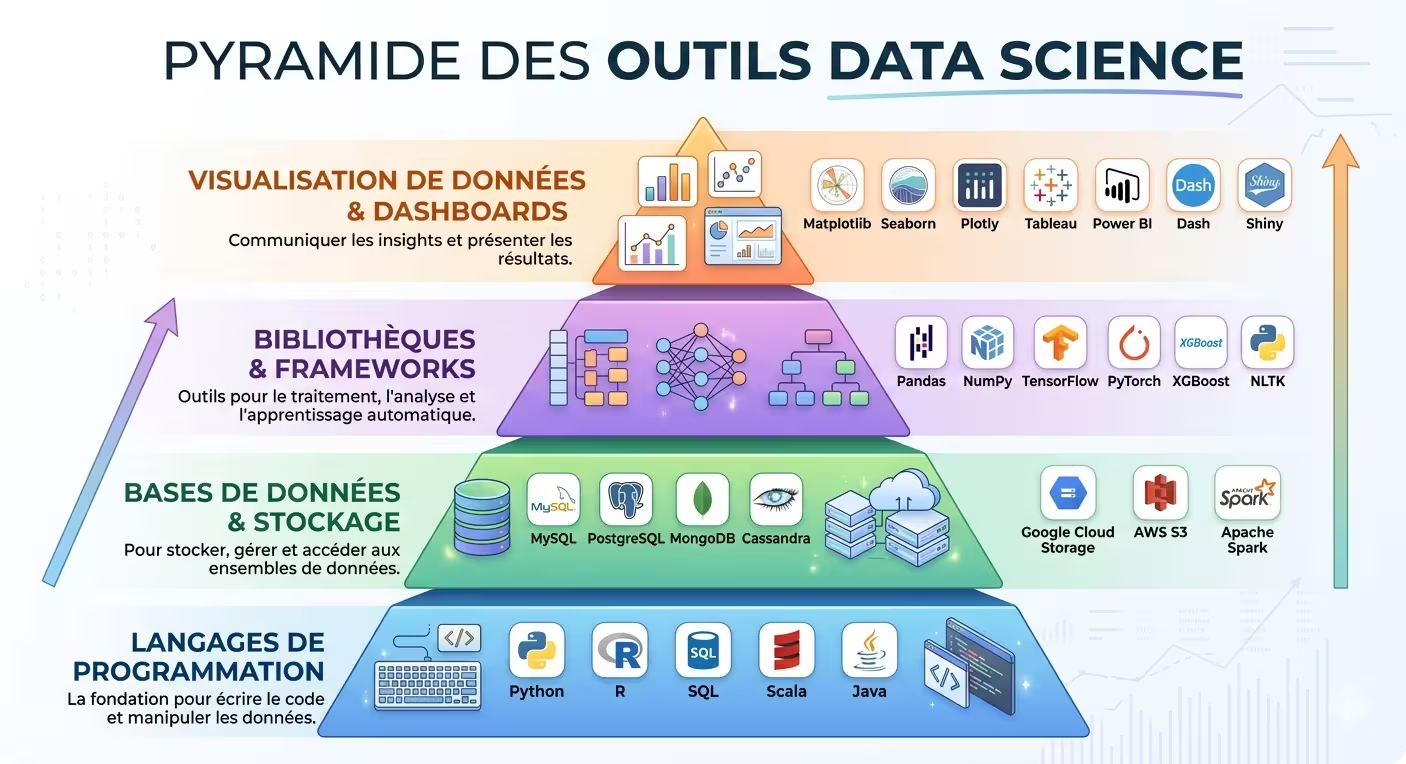

schéma de la stack data science.

Une bibliothèque de visualisation 2D très flexible, permettant de créer des graphiques personnalisés de haute qualité. C'est la bibliothèque de base sur laquelle reposent les autres.

Basé sur Matplotlib, Seaborn offre une interface plus intuitive pour créer des visualisations statistiques attrayantes (heatmaps, pairplots, boxplots). Idéal pour l'exploration rapide.

import seaborn as sns

import matplotlib.pyplot as plt

sns.heatmap(df.corr(), annot=True, cmap='coolwarm')

plt.title('Matrice de corrélation')

plt.show()Une plateforme complète pour le traitement du langage naturel en Python, offrant des outils pour la tokenisation, la lemmatisation, l'analyse syntaxique, et l'accès à de nombreux corpus. Idéal pour l'apprentissage et la recherche.

Conçu pour être rapide et efficace, spaCy est particulièrement adapté aux tâches de traitement du langage naturel à grande échelle. Il offre des modèles pré-entraînés pour de nombreuses langues (dont le français).

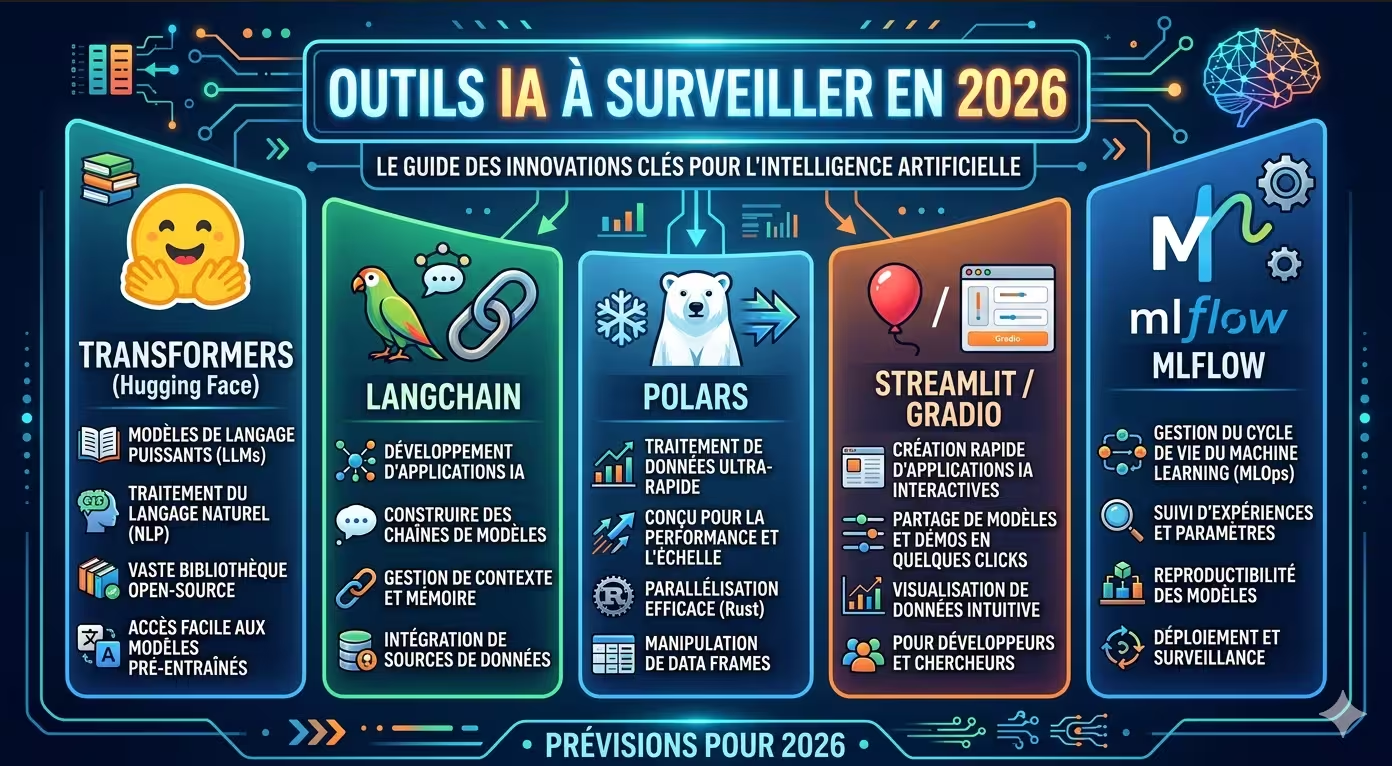

Les bibliothèques Transformers (Hugging Face) et LangChain sont devenues incontournables pour l'IA générative (LLM). Elles mériteraient un article dédié.

Un environnement interactif qui permet de combiner du code, du texte et des visualisations dans un même document. Indispensable pour l'exploration, le prototypage et le partage d'analyses.

Un outil de conteneurisation qui facilite le déploiement et la gestion d'applications d'IA. Permet de garantir la reproductibilité des environnements (mêmes versions de Python, bibliothèques, GPU).

Ces outils sont conçus pour fonctionner ensemble. NumPy alimente Pandas, qui alimente Scikit-learn, qui peut utiliser TensorFlow en backend. Cette interopérabilité est la clé de leur succès.

| Outil | Domaine | Pourquoi l'adopter ? | |

|---|---|---|---|

| Transformers (Hugging Face) | LLM / NLP | Modèles pré-entraînés (BERT, GPT, Llama) faciles à utiliser | |

| LangChain | IA générative | Chaînes d'appels à LLM, agents autonomes | |

| Polars | Manipulation de données | Alternative ultra-rapide à Pandas (10x plus rapide) | |

| Dask | Big Data | Pandas et Scikit-learn sur clusters | |

| Streamlit / Gradio | Déploiement | Créer des applications web IA en quelques lignes de code | |

| MLflow | MLOps | Traçage des expériences, gestion des modèles |

Infographie des outils émergents à surveiller.

| Critère | TensorFlow | PyTorch | Keras |

|---|---|---|---|

| Facilité d'apprentissage | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Flexibilité | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Débogage | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Écosystème production | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| Recherche académique | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐ |

| Mobile / Edge | ⭐⭐⭐⭐⭐ (TF Lite) | ⭐⭐⭐ (ExecuTorch) | ⭐⭐⭐⭐ |

Commencez par Python + Jupyter. Ajoutez NumPy, Pandas, Matplotlib. Puis Scikit-learn pour le ML classique. Enfin Keras pour le deep learning.

Privilégiez PyTorch pour sa flexibilité et son débogage facile. Utilisez Weights & Biases pour le tracking d'expériences.

Adoptez TensorFlow pour son écosystème production. Utilisez Docker et MLflow pour le MLOps.

Utilisez spaCy pour le NLP classique, Transformers (Hugging Face) pour les LLM, et LangChain pour les applications agents.

Pour un débutant, commencez par Keras (API haut niveau, intégrée à TensorFlow). Ensuite, apprenez PyTorch si vous visez la recherche, ou TensorFlow si vous visez la production. Les deux sont d'excellents choix et les concepts se transfèrent.

Oui, Pandas reste le standard et le plus utilisé (90% des projets). Polars est plus rapide sur les très gros volumes, mais son écosystème est moins mature. Pour la plupart des projets, Pandas suffit. Pour le big data, passez à Polars ou Dask.

Commencez par Matplotlib pour comprendre les bases. Puis passez à Seaborn pour des graphiques statistiques plus beaux et plus simples. Pour l'interactif, explorez Plotly.

Non, Jupyter est conçu pour l'exploration et le prototypage. Pour la production, transformez votre code en scripts Python (.py) et utilisez des outils comme Docker, MLflow ou des pipelines Airflow.

Les incontournables : Transformers (Hugging Face) pour les modèles pré-entraînés, LangChain pour les chaînes et agents, Chroma ou Pinecone pour les bases vectorielles (RAG).

Non, la plupart des data scientists maîtrisent Python, NumPy, Pandas, Scikit-learn, et un framework deep learning. Les autres outils (visualisation, NLP, conteneurs) s'apprennent selon les besoins du projet.

Le développement en intelligence artificielle repose sur un écosystème riche et cohérent d'outils open source. La maîtrise de ces 12 outils (et des nouveaux venus comme Transformers et LangChain) vous permettra de mener à bien la plupart des projets IA, de l'exploration des données à la mise en production.