C'est quoi le NLTK ?

La version technique : code, pipeline NLP, cas d'usage et comparatif avec spaCy et Transformers.

Des années 1950 aux modèles transformers : découvrez l'histoire du Natural Language Toolkit, la bibliothèque Python qui a démocratisé le traitement du langage naturel.

Le traitement du langage naturel (TLN), c'est l'art et la science d'enseigner aux machines à comprendre, interpréter et générer du langage humain. Au cœur de cette discipline, on retrouve le NLTK (Natural Language Toolkit), un outil qui a révolutionné la façon dont nous interagissons avec les ordinateurs.

NLTK est une bibliothèque Python open-source, lancée au début des années 2000, qui fournit des outils pour tokeniser, lemmatiser, analyser syntaxiquement et sémantiquement des textes. Elle a été la porte d'entrée du NLP pour des milliers de chercheurs et développeurs.

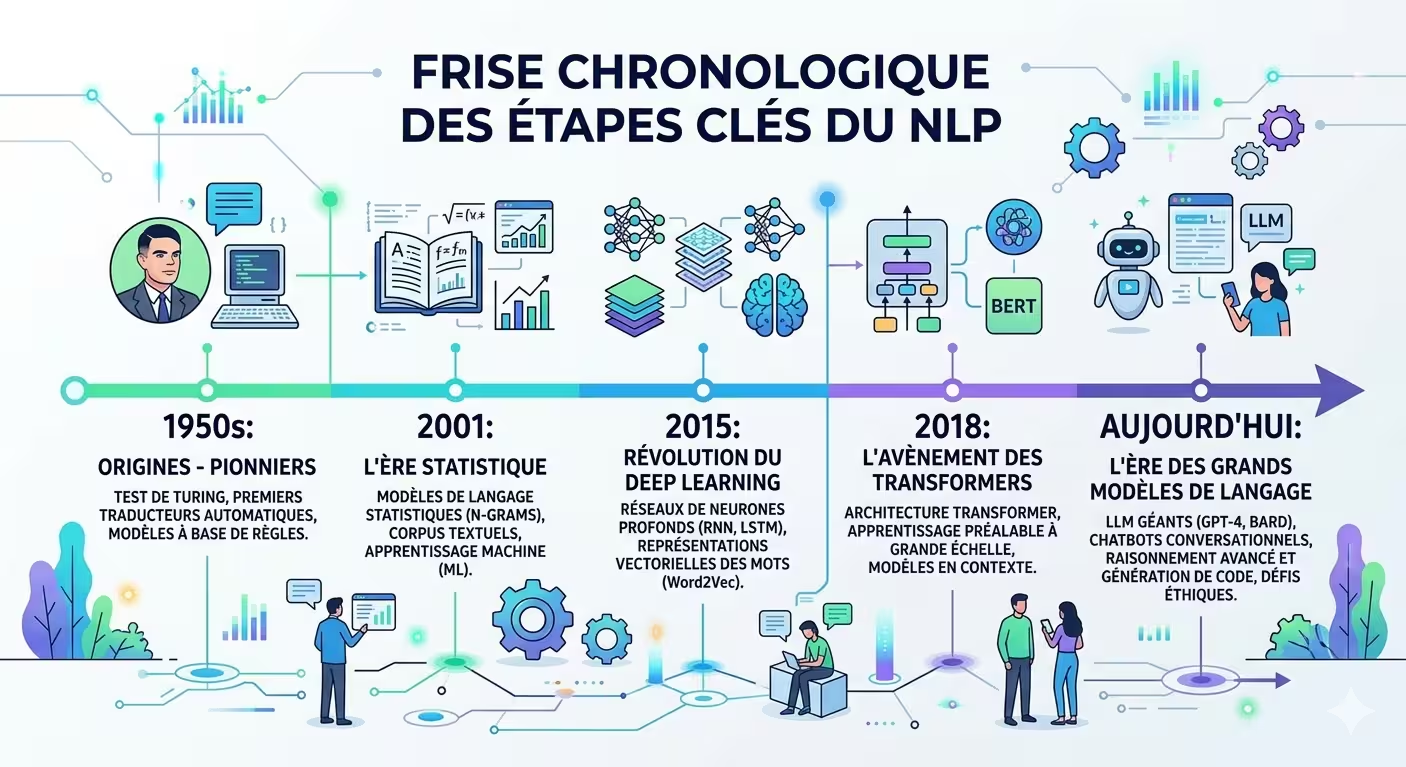

frise chronologique des étapes clés du NLP.

L'idée de faire communiquer des machines en langage naturel est aussi vieille que l'informatique elle-même. Les premiers travaux dans ce domaine remontent aux années 1950, avec l'objectif ambitieux de créer des machines capables de traduire des langues étrangères ou de tenir des conversations cohérentes.

Alan Turing propose un test pour évaluer si une machine peut imiter un comportement intelligent au point de tromper un interlocuteur humain. C'est l'acte de naissance philosophique du NLP.

Le système Georgetown-IBM traduit 60 phrases du russe vers l'anglais. Un succès médiatique, mais les limites apparaissent rapidement face à la complexité du langage.

Les premiers systèmes NLP utilisent des grammaires et des dictionnaires. ELIZA (1966) simule une conversation avec un psychothérapeute. C'est l'un des premiers chatbots.

C'est dans ce contexte que le NLTK voit le jour. Lancé au début des années 2000 par Steven Bird et Edward Loper à l'Université de Pennsylvanie, il se positionne rapidement comme une référence en matière de traitement du langage naturel. Sa force ? Être open-source et accessible à tous, chercheurs comme développeurs.

Le NLTK offre une boîte à outils complète pour :

import nltk

nltk.download('punkt')

from nltk.tokenize import word_tokenize

texte = "Le traitement du langage naturel fascine les chercheurs depuis 1950."

tokens = word_tokenize(texte, language='french')

print(tokens)

# Output: ['Le', 'traitement', 'du', 'langage', 'naturel', 'fascine', 'les', 'chercheurs', 'depuis', '1950', '.']Grâce au NLTK, les chercheurs ont pu réaliser des avancées significatives dans de nombreux domaines :

Le chemin a été semé d'embûches. Le langage humain est complexe et riche de nuances : ambiguïté (un mot peut avoir plusieurs sens), ironie, expressions idiomatiques, erreurs grammaticales, langues variées. Les premiers systèmes étaient souvent limités par leur incapacité à gérer cette complexité.

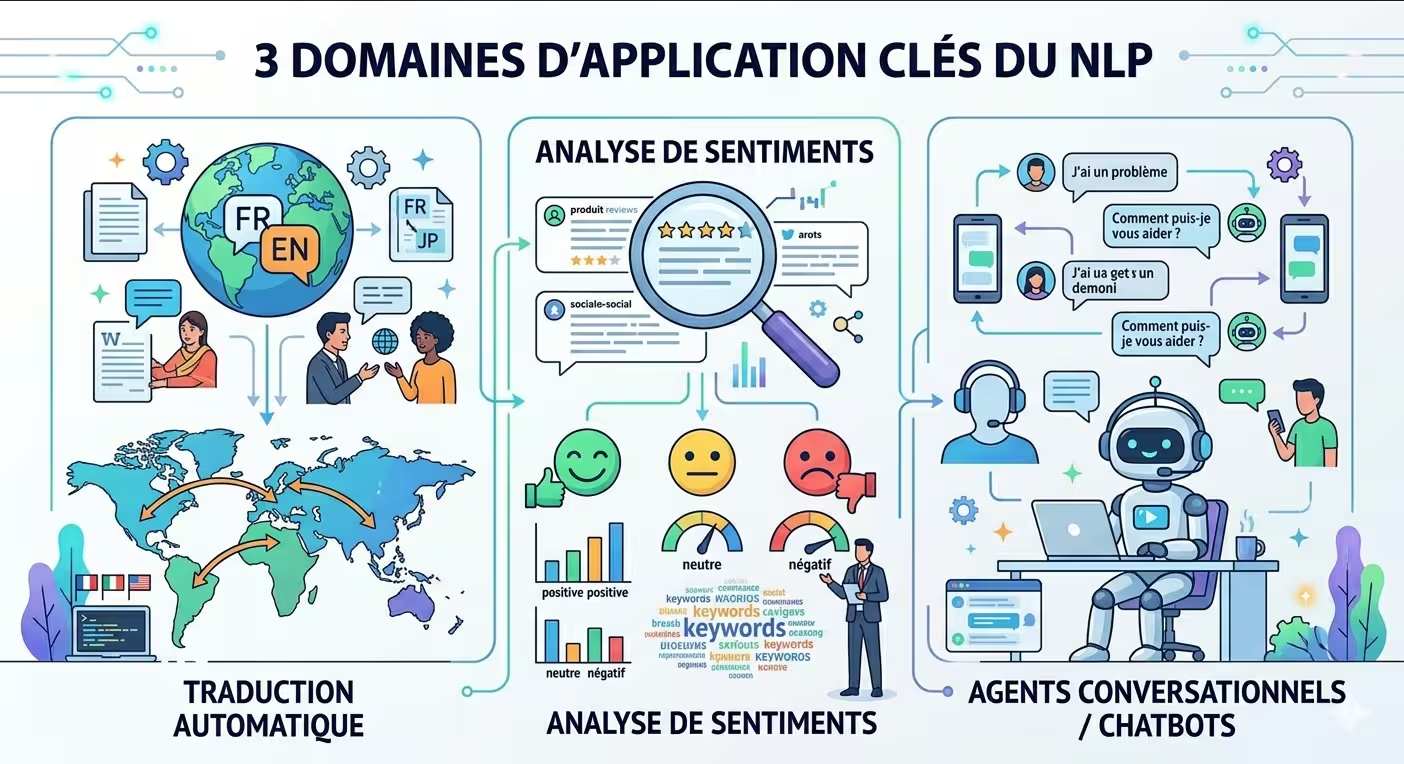

collage des 3 domaines d'application.

Le développement du traitement du langage naturel est motivé par de nombreux enjeux socio-économiques :

Les assistants vocaux (Siri, Alexa, Google Assistant), les chatbots et les moteurs de recherche reposent en grande partie sur le traitement du langage naturel.

Les entreprises ont besoin d'outils pour analyser les données textuelles générées par leurs clients (avis, emails, tickets support) et leurs employés.

La mondialisation nécessite des outils de traduction efficaces et rapides. Google Translate, DeepL en sont les exemples emblématiques.

Le NLTK a ouvert la voie à de nombreuses innovations dans le domaine de l'intelligence artificielle. Aujourd'hui, de nouveaux outils et de nouvelles techniques permettent de repousser encore plus loin les limites du traitement du langage naturel.

NLTK reste aujourd'hui un outil de choix pour :

Découvrez notre article C'est quoi le NLTK ? pour des exemples de code, un comparatif avec spaCy et Transformers, et des cas d'usage concrets.

NLTK a été créé par Steven Bird et Edward Loper à l'Université de Pennsylvanie au début des années 2000. L'objectif était de fournir un outil pédagogique pour l'enseignement du traitement du langage naturel, combinant des données linguistiques (corpus) et des algorithmes.

Oui, principalement pour l'enseignement et le prototypage. Pour la production, spaCy ou les modèles Transformers sont plus adaptés (performance, modèles pré-entraînés). NLTK reste une excellente porte d'entrée pour comprendre les concepts fondamentaux du NLP.

NLTK : pédagogique, complet, plus lent, idéal pour apprendre. spaCy : industriel, rapide, optimisé pour la production, modèles pré-entraînés performants. Les deux sont complémentaires : NLTK pour comprendre, spaCy pour industrialiser.

Oui, partiellement. NLTK est principalement orienté anglais, mais il existe des ressources pour le français (tokenizers, stopwords). Pour un NLP français de qualité, spaCy (modèle fr_core_news_sm) ou des modèles Transformers sont plus adaptés.

Oui, si vous voulez comprendre le NLP. Les LLM (ChatGPT, Gemini) sont des boîtes noires. NLTK vous apprend les briques fondamentales : tokenisation, lemmatisation, extraction de features, classification. Ces concepts restent utiles même avec l'IA générative.

"Natural Language Processing with Python" (Bird, Klein, Loper) est le livre officiel. Il est disponible gratuitement en ligne sur le site de NLTK. Il couvre à la fois les concepts théoriques et la mise en pratique avec NLTK.

Le NLTK a joué un rôle essentiel dans le développement de l'intelligence artificielle en mettant à disposition des chercheurs et des développeurs un ensemble d'outils puissants et flexibles pour traiter le langage naturel. Bien que de nombreux défis restent à relever, l'avenir du traitement du langage naturel s'annonce prometteur, avec des applications toujours plus nombreuses et variées.